Ubuntu 서버에서 정적 IP 주소를 변경하는 방법

리눅스에서 정적 IP 구성에 관한 참고 사항

이 가이드는 Ubuntu 서버에서 정적 IP 주소 변경 방법을 단계별로 안내합니다.

리눅스에서 정적 IP 구성에 관한 참고 사항

이 가이드는 Ubuntu 서버에서 정적 IP 주소 변경 방법을 단계별로 안내합니다.

현재 Ollama 개발 상태에 대한 제 의견

Ollama은 LLM을 로컬에서 실행하는 데 사용되는 가장 인기 있는 도구 중 하나로 빠르게 자리 잡았습니다. 간단한 CLI와 스트리밍된 모델 관리 기능으로 인해 클라우드 외부에서 AI 모델을 다루고자 하는 개발자들에게 필수적인 선택지가 되었습니다.

대체 VoIP 통신 플랫폼

Mumble은 주로 실시간 음성 통신을 위해 설계된 무료이고 오픈소스의 음성 통화(VoIP) 애플리케이션입니다. 사용자들이 공유된 서버에 연결하여 서로와 대화할 수 있도록 클라이언트-서버 아키텍처를 사용합니다.

메لبourn에서 어디로 가면 좋을까요?

다음은 2025년 8월부터 2026년 12월 사이에 호주 멜버른에서 개최되는 소프트웨어 개발, 클라우드 컴퓨팅, IT 및 AI 관련 컨퍼런스, 미팅, 워크숍의 정리된 목록입니다.

멜버른에서 열리는 이 행사들에 대한 정보는 다음과 같습니다.

2025년 Ollama의 가장 주목받는 UI에 대한 간략한 개요

로컬에서 호스팅된 Ollama는 자신의 기계에서 대규모 언어 모델을 실행할 수 있게 해주지만, 명령줄을 통해 사용하는 것은 사용자 친화적이지 않습니다.

다음은 로컬 Ollama에 연결되는 **ChatGPT 스타일 인터페이스**를 제공하는 여러 오픈소스 프로젝트입니다.

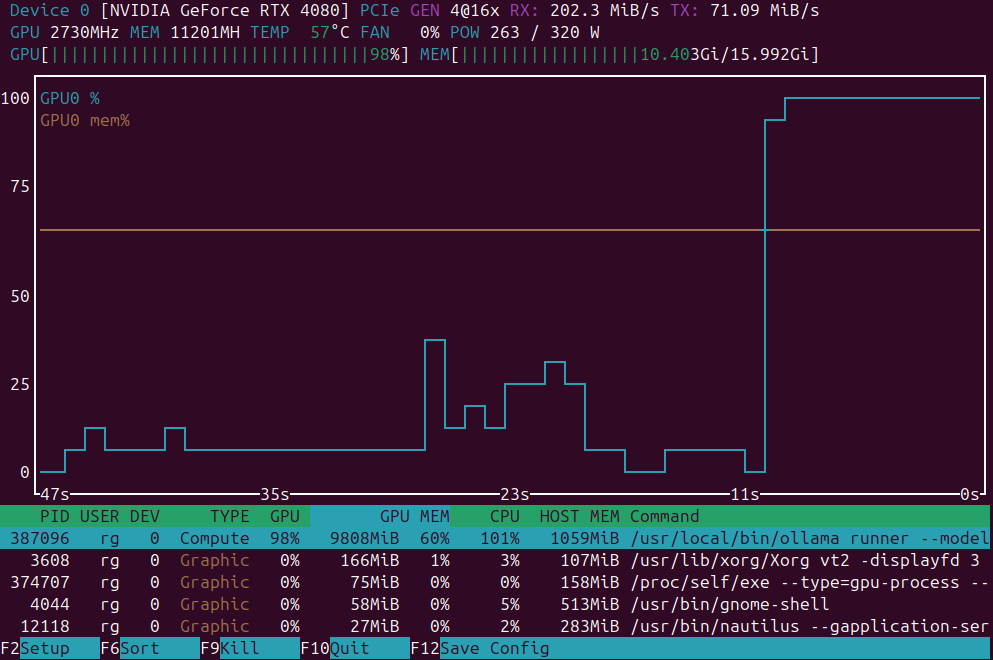

GPU 부하 모니터링을 위한 애플리케이션 목록

GPU 로드 모니터링 애플리케이션: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

홈랩 클러스터에 little k3s 쿠버네티스 설치

3노드 K3s 클러스터의 설치 단계별 가이드를 아래에 제공합니다.

이 가이드는 물리 서버(1 마스터 + 2 워커)에서 실행되는

**3노드 K3s 클러스터 설치**에 대한 것입니다.

쿠버네티스 변종에 대한 매우 짧은 개요

자체 호스팅 Kubernetes(self-hosting Kubernetes) 분포를 비교하여, 베어메탈 또는 홈 서버에 호스팅할 때 설치 용이성, 성능, 시스템 요구사항, 기능 세트에 초점을 맞추고 있습니다.

AWS 플랫폼 엔지니어링에 유용한 도구

AWS Cloud Development Kit (AWS CDK)

는 TypeScript, Python, Java, Go와 같은 익숙한 프로그래밍 언어를 사용하여 클라우드 인프라를 정의하고 배포할 수 있도록 해주는 프레임워크입니다.

TypeScript,

Python,

Java 및

Go와 같은 언어를 사용할 수 있습니다.

Enshittification에 대해 조금 알아보기 및 그 의미

**Enshittification**은 수익을 추구하는 결정으로 인해 사용자 경험을 저하시키는 온라인 플랫폼을 포함한 서비스의 점진적인 악화라는 현상을 가리키는 말입니다.

자신의 홈 랩에 가장 적합한 Kubernetes 플레버 선택

저는 Ubuntu 기반 홈랩에 적합한 3개 노드(각각 16GB RAM, 4코어)를 갖춘 자체 호스팅 Kubernetes 변형을 비교하고 있으며, 설치 및 유지보수가 용이하고, Persistent Volumes(PV) 및 LoadBalancer(LB) 서비스를 지원하는 것을 중심으로 살펴보고 있습니다.

설치, 실행, 타입, 클래스 등 모든 기초 사항

다음은 개발자들이 자주 참조하는 핵심 개념, 문법 및 코드 예제를 다루는 내 간결한 TypeScript 치트시트입니다:

일부 검색 엔진은 웹사이트에 제목이 동일한 페이지가 있을 경우 이를 좋아하지 않습니다...

블로그 게시물 목록 페이지 제목에 **페이지 번호를 추가하는 방법**을 적용하려면 목록 템플릿을 수정해야 합니다.

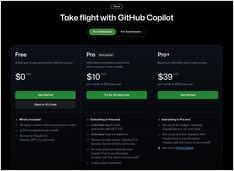

설명, 계획, 명령어 목록 및 키보드 단축키

여기 최신 GitHub Copilot 단축키 시트가 있습니다. 이 문서는 Visual Studio Code와 Copilot Chat을 위한 필수 단축키, 명령어, 사용 팁, 컨텍스트 기능을 다룹니다.

공통 GitHub Actions 와 그 구조에 대한 간단한 소개입니다.

GitHub Actions 는 GitHub 내의 자동화 및 CI/CD 플랫폼으로, 푸시, 풀 리퀘스트, 일정 기반 이벤트 등 특정 이벤트에 따라 코드를 빌드, 테스트, 배포하는 데 사용됩니다.

VirtualBox 공유 폴더 설정을 위한 단계별 지침

Linux Guest OS에서 VirtualBox 공유 폴더 구성을 설정하려면 다음 단계를 따르세요: