Создание GraphQL BFF с использованием Apollo Server

Оптимизируйте фронтенд-API с помощью GraphQL BFF и Apollo Server

Шаблон Backend for Frontend (BFF) в сочетании с GraphQL и Apollo Server создает мощную архитектуру для современных веб-приложений.

Оптимизируйте фронтенд-API с помощью GraphQL BFF и Apollo Server

Шаблон Backend for Frontend (BFF) в сочетании с GraphQL и Apollo Server создает мощную архитектуру для современных веб-приложений.

Команды Elasticsearch для поиска, индексации и аналитики

Elasticsearch — это мощный распределенный поисковый и аналитический движок, построенный на базе Apache Lucene. Эта всеобъемлющая шпаргалка охватывает основные команды, лучшие практики и быстрые справочники для работы с кластерами Elasticsearch.

Создавайте серверы MCP для ИИ-ассистентов с примерами на Python

Протокол Контекста Модели (MCP) революционизирует способ взаимодействия ИИ-ассистентов с внешними источниками данных и инструментами. В этом руководстве мы исследуем, как строить MCP-серверы на Python, с примерами, сосредоточенными на возможностях веб-поиска и парсинга.

Быстрая справка по командам Docker Model Runner

Docker Model Runner (DMR) — это официальное решение Docker для запуска моделей ИИ локально, представленное в апреле 2025 года. Этот справочник предоставляет быстрый доступ ко всем основным командам, настройкам и лучшим практикам.

Сравните Docker Model Runner и Ollama для локальных LLM

Запуск больших языковых моделей (LLM) локально стал все более популярным из-за приватности, контроля затрат и возможностей офлайн-работы. Ландшафт значительно изменился в апреле 2025 года, когда Docker представил Docker Model Runner (DMR), свое официальное решение для развертывания моделей ИИ.

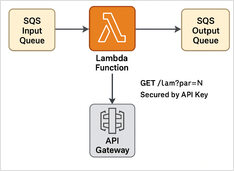

Пошаговый пример

Здесь представлен пример Python Lambda для обработки сообщений SQS (Пример Python Lambda для обработки сообщений SQS + REST API) с защитой API Key + скрипт Terraform для развертывания его для безсерверного выполнения.

+ Конкретные примеры использования мыслящих ЛЛМ

В этой статье мы рассмотрим два способа подключения вашего Python-приложения к Ollama: 1. Через HTTP REST API; 2. Через официальную библиотеку Ollama для Python.

Для работы с несколько отличающимися API требуется особый подход.

Вот сравнительная таблица поддержки структурированного вывода (получение надежного JSON) у популярных провайдеров LLM, а также минимальные примеры на Python