올라마 엔시티피케이션 - 초기 징후

현재 Ollama 개발 상태에 대한 제 의견

Ollama은 LLM을 로컬에서 실행하는 데 사용되는 가장 인기 있는 도구 중 하나로 빠르게 자리 잡았습니다. 간단한 CLI와 스트리밍된 모델 관리 기능으로 인해 클라우드 외부에서 AI 모델을 다루고자 하는 개발자들에게 필수적인 선택지가 되었습니다.

현재 Ollama 개발 상태에 대한 제 의견

Ollama은 LLM을 로컬에서 실행하는 데 사용되는 가장 인기 있는 도구 중 하나로 빠르게 자리 잡았습니다. 간단한 CLI와 스트리밍된 모델 관리 기능으로 인해 클라우드 외부에서 AI 모델을 다루고자 하는 개발자들에게 필수적인 선택지가 되었습니다.

2025년 Ollama의 가장 주목받는 UI에 대한 간략한 개요

로컬에서 호스팅된 Ollama는 자신의 기계에서 대규모 언어 모델을 실행할 수 있게 해주지만, 명령줄을 통해 사용하는 것은 사용자 친화적이지 않습니다.

다음은 로컬 Ollama에 연결되는 **ChatGPT 스타일 인터페이스**를 제공하는 여러 오픈소스 프로젝트입니다.

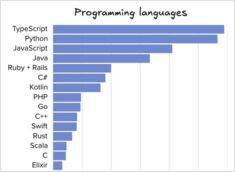

소프트웨어 엔지니어링 도구 및 언어 비교

The Pragmatic Engineer 뉴스레터가 며칠 전에 발표한 설문 조사 통계에 따르면, 2025년 중반의 프로그래밍 언어, IDE, AI 도구의 인기 및 기타 데이터가 포함되어 있습니다.

2025 년 7 월이면 곧 이용 가능할 것입니다.

Nvidia 가 곧 NVIDIA DGX Spark를 출시합니다. 128GB 이상의 통합 RAM 과 1 PFLOPS AI 성능을 갖춘 블랙웰 (Blackwell) 아키텍처 기반의 소형 AI 슈퍼컴퓨터입니다. LLM 을 실행하기에 훌륭한 기기입니다.

RAG 구현 중이신가요? 여기 Go 코드 조각이 있습니다 - 2...

표준 Ollama 에는 직접적인 rerank API 가 없으므로, 쿼리 - 문서 쌍에 대한 임베딩을 생성하고 점수를 매기는 방식으로 GO 에서 Qwen3 Reranker 를 사용한 재순위 지정 을 구현해야 합니다.

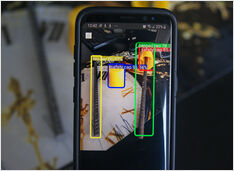

얼마 전에 저는 객체 감지 AI를 훈련시켰습니다.

한 여름의 추운 날, 호주에서는 여름이 아니라 겨울이죠…

AI 모델을 훈련하여 비캡된 콘크리트 강화 철근을 감지하는 것이 급한 필요성을 느꼈습니다…

qwen3 8b, 14b 및 30b, devstral 24b, mistral small 24b

이 테스트에서는 Ollama에 호스팅된 다양한 LLM이 Hugo 페이지를 영어에서 독일어로 번역하는 방식을 비교하고 있습니다. 다른 LLM이 호스팅된 Ollama에서 Hugo 페이지를 영어에서 독일어로 번역하는 방식 비교.

RAG 구현 중이신가요? Golang 코드 스니펫을 소개합니다.

이 작은 Go 코드 예시는 쿼리와 각 후보 문서에 대해 임베딩을 생성하기 위해 Ollama 를 호출합니다 그리고 코사인 유사도 기준으로 내림차순으로 정렬합니다.

LLM용으로 두 번째 GPU를 설치할 생각이신가요?

PCIe 랜의 수가 LLM 성능에 미치는 영향? 작업에 따라 다릅니다. 훈련 및 멀티 GPU 추론의 경우 성능 저하가 상당합니다.

LLM을 사용하여 HTML에서 텍스트 추출...

Ollama 모델 라이브러리에는 HTML 콘텐츠를 Markdown으로 변환할 수 있는 모델이 포함되어 있습니다. 이는 콘텐츠 변환 작업에 유용합니다. 이 가이드는 우리의 2026년 문서화 도구: Markdown, LaTeX, PDF 및 인쇄 워크플로우 허브의 일부입니다.

이 둘은 얼마나 다를까요?

커서 AI 대 GitHub Copilot 대 Cline AI 대...

여기 몇 가지 AI 지원 코딩 도구와 AI 코딩 어시스턴트 및 그들의 장점을 나열할 것입니다.

LLM 제공업체 짧은 목록

LLM을 사용하는 것은 매우 비용이 많이 들지 않으며, 새로운 고성능 GPU를 구매할 필요가 있을 수도 있습니다.

클라우드에서 제공하는 LLM 제공업체 목록을 확인해보세요. 이 목록에는 제공업체가 호스팅하는 LLM이 나와 있습니다.

인텔 CPU의 효율성 코어 vs 성능 코어에서의 Ollama

제가 테스트하고 싶은 이론은, 인텔 CPU에서 모든 코어를 사용하면 LLM의 속도가 빨라질까?입니다.

새로운 gemma3 27비트 모델(gemma3:27b, ollama에서 17GB)이 제 GPU의 16GB VRAM에 맞지 않아, 부분적으로 CPU에서 실행되고 있다는 점이 제게 짜증을 주고 있습니다.

AI는 많은 컴퓨팅 파워가 필요합니다...

현대 세계의 혼란 속에서 저는 다른 카드의 기술 사양 비교를 진행하고 있습니다. 이는 AI 작업에 적합한 카드들입니다.

(딥러닝,

객체 감지,

LLMs).

하지만 이 모든 카드는 매우 비싸죠.

병렬 요청 실행을 위해 ollama 구성하기.

Ollama 서버가 동일한 시간에 두 개의 요청을 받을 경우, 그 동작은 구성 설정과 사용 가능한 시스템 자원에 따라 달라집니다.