Open WebUI: interfaccia self-hosted per LLM

Alternativa self-hosted a ChatGPT per LLM locali

Open WebUI è una potente, estensibile e ricca di funzionalità interfaccia web autoospitata per interagire con i grandi modelli linguistici.

Alternativa self-hosted a ChatGPT per LLM locali

Open WebUI è una potente, estensibile e ricca di funzionalità interfaccia web autoospitata per interagire con i grandi modelli linguistici.

Inferenza rapida di LLM con l'API OpenAI

vLLM è un motore di inferenza e servizio ad alto throughput e a basso consumo di memoria per modelli linguistici su larga scala (LLM), sviluppato dal laboratorio Sky Computing dell’Università della California, Berkeley.

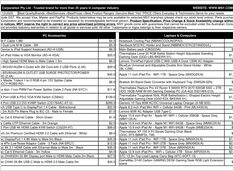

Prezzi AUD reali dai rivenditori australiani ora

L' NVIDIA DGX Spark (GB10 Grace Blackwell) è ora disponibile in Australia nei principali rivenditori di PC con scorte locali. Se segui le prezzi e disponibilità globali del DGX Spark, sarà interessante sapere che i prezzi in Australia variano da 6.249 a 7.999 AUD a seconda della configurazione di archiviazione e del rivenditore.

Test di Cognee con LLM locali - risultati reali

Cognee è un framework Python per costruire grafi di conoscenza da documenti utilizzando LLM. Ma funziona con modelli auto-hostati?

Riflessioni sui modelli LLM per Cognee autoospitati

Scegliere il miglior LLM per Cognee richiede di bilanciare la qualità della costruzione del grafo, i tassi di allucinazione e i vincoli hardware. Cognee eccelle con modelli più grandi a bassa allucinazione (32B+) tramite Ollama ma le opzioni di dimensioni medio-piccole funzionano per le configurazioni più leggere.

Costruisci agenti di ricerca AI con Python e Ollama

La libreria Python di Ollama ora include funzionalità native di ricerca web OLLama. Con poche righe di codice, puoi arricchire i tuoi LLM locali con informazioni in tempo reale dal web, riducendo le illusioni e migliorando l’accuratezza.

Scegli il database vettoriale giusto per il tuo stack RAG

La scelta del giusto vettore store può fare la differenza per le prestazioni, i costi e la scalabilità della tua applicazione RAG. Questo confronto completo copre le opzioni più popolari nel 2024-2025.

Costruisci agenti di ricerca AI con Go e Ollama

L’API di ricerca web di Ollama ti permette di integrare LLM locali con informazioni in tempo reale dal web. Questa guida ti mostra come implementare le capacità di ricerca web in Go, dal semplice utilizzo dell’API alle funzionalità complete degli agenti di ricerca.

I prezzi della RAM schizzano del 163-619% mentre la domanda di AI mette sotto pressione l'offerta.

Il mercato della memoria sta vivendo una volatilità dei prezzi senza precedenti alla fine del 2025, con i prezzi della RAM in forte aumento che si stanno verificando drammaticamente in tutti i segmenti.

Confronta i migliori strumenti di hosting locale per LLM nel 2026: maturità dell'API, supporto hardware, tool calling e casi d'uso reali.

L’esecuzione di LLM in locale è ora pratica per sviluppatori, startup e persino team aziendali.

Ma la scelta dello strumento giusto — Ollama, vLLM, LM Studio, LocalAI o altri — dipende dai tuoi obiettivi:

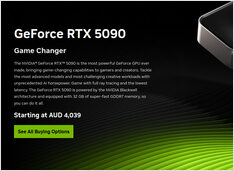

Prezzi delle GPU consumer adatte all'AI - RTX 5080 e RTX 5090

Confrontiamo i prezzi per le GPU consumer di fascia alta, in particolare quelle adatte per le LLM e per l’IA in generale. Nello specifico, sto esaminando i prezzi di RTX-5080 e RTX-5090.

Distribuisci l'AI enterprise su hardware economico con modelli open source.

La democratizzazione dell’IA è qui. Con LLM open-source come Llama, Mistral e Qwen che ora competono con i modelli proprietari, i team possono costruire potenti infrastrutture AI utilizzando hardware consumer - riducendo drasticamente i costi mantenendo il controllo totale sulla privacy dei dati e sul deployment.

Configura un monitoraggio dell'infrastruttura robusto con Prometheus

Prometheus è diventato lo standard de facto per il monitoraggio delle applicazioni e dell’infrastruttura cloud-native, offrendo la raccolta di metriche, interrogazioni e integrazione con strumenti di visualizzazione.

Impostare correttamente Grafana per il monitoraggio e la visualizzazione

Grafana è la piattaforma open-source leader per il monitoraggio e l’osservabilità, trasformando metriche, log e tracce in insight utili attraverso visualizzazioni straordinarie.

Distribuisci applicazioni stateful con scalabilità ordinata e dati persistenti

Kubernetes StatefulSets sono la soluzione ideale per gestire applicazioni stateful che richiedono identità stabili, archiviazione persistente e modelli di distribuzione ordinati—essenziali per database, sistemi distribuiti e strati di caching.

Accelerare FLUX.1-dev con la quantizzazione GGUF

FLUX.1-dev è un potente modello di generazione di immagini da testo che produce risultati straordinari, ma il suo requisito di memoria di 24GB+ rende difficile il suo utilizzo su molti sistemi. Quantizzazione GGUF di FLUX.1-dev offre una soluzione, riducendo l’utilizzo della memoria del circa 50% mantenendo comunque una buona qualità delle immagini.