LLM

Prestazioni degli LLM nel 2026: benchmark, colli di bottiglia e ottimizzazione

Self-hosting di LLM e sovranità dell'IA

Controlla dati e modelli con LLM ospitati in-house

L’auto-ospedalizzazione degli LLM mantiene dati, modelli e inferenza sotto il tuo controllo: una via pratica per la sovranità dell’IA per team, imprese e nazioni.

Confronto delle prestazioni degli LLM su Ollama con GPU da 16 GB di VRAM

Test di velocità LLM su RTX 4080 con 16 GB di VRAM

Eseguire modelli linguistici di grandi dimensioni (LLM) localmente offre privacy, funzionalità offline e costi zero per le API. Questo benchmark rivela esattamente cosa ci si può aspettare da 14 popolari LLM su Ollama con una RTX 4080.

I migliori 17 progetti Python in tendenza su GitHub

Repository Python in tendenza nel gennaio 2026

L’ecosistema Python di questo mese è dominato da Claude Skills e dagli strumenti per agenti AI. Questa panoramica analizza i repository Python più in tendenza su GitHub.

Top 23 progetti Rust più in voga su GitHub - Gennaio 2026

Repositori Rust più popolari di gennaio 2026

L’ecosistema Rust sta esploso con progetti innovativi, in particolare negli strumenti per la codifica AI e nelle applicazioni per terminale. Questo riepilogo analizza i repository Rust più popolari su GitHub di questo mese.

Top 19 Progetti Go più popolari su GitHub - Gennaio 2026

Repositori Go più popolari di gennaio 2026

L’ecosistema Go continua a prosperare grazie a progetti innovativi che spaziano dall’AI, alle applicazioni auto-hosted e all’infrastruttura per sviluppatori. Questa panoramica analizza i repository Go più popolari su GitHub di questo mese.

Open WebUI: interfaccia self-hosted per LLM

Alternativa self-hosted a ChatGPT per LLM locali

Open WebUI è una potente, estensibile e ricca di funzionalità interfaccia web autoospitata per interagire con i grandi modelli linguistici.

vLLM Quickstart: Servizio di LLM ad alte prestazioni - nel 2026

Inferenza rapida di LLM con l'API OpenAI

vLLM è un motore di inferenza e servizio ad alto throughput e a basso consumo di memoria per modelli linguistici su larga scala (LLM), sviluppato dal laboratorio Sky Computing dell’Università della California, Berkeley.

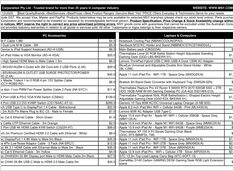

Prezzo DGX Spark AU: 6.249–7.999 USD presso i principali rivenditori

Prezzi AUD reali dai rivenditori australiani ora

L' NVIDIA DGX Spark (GB10 Grace Blackwell) è ora disponibile in Australia nei principali rivenditori di PC con scorte locali. Se segui le prezzi e disponibilità globali del DGX Spark, sarà interessante sapere che i prezzi in Australia variano da 6.249 a 7.999 AUD a seconda della configurazione di archiviazione e del rivenditore.

Rilevare l'AI Slop: Tecniche & Segnali di Allarme

Guida tecnica per la rilevazione del contenuto generato da AI

La proliferazione del contenuto generato dall’IA ha creato una nuova sfida: distinguere la scrittura umana autentica da “AI slop” - testo sintetico di bassa qualità, prodotto in massa.

Self-Hosting Cognee: Scegliere LLM su Ollama

Test di Cognee con LLM locali - risultati reali

Cognee è un framework Python per costruire grafi di conoscenza da documenti utilizzando LLM. Ma funziona con modelli auto-hostati?

BAML vs Instructor: Output Strutturati per LLM

Output di LLM type-safe con BAML e Instructor

Quando si lavora con i Large Language Models (LLM) in produzione, ottenere output strutturati e type-safe è fondamentale. Due framework popolari - BAML e Instructor - adottano approcci diversi per risolvere questo problema.

Scegliere il giusto LLM per Cognee: Configurazione locale di Ollama

Riflessioni sui modelli LLM per Cognee autoospitati

Scegliere il miglior LLM per Cognee richiede di bilanciare la qualità della costruzione del grafo, i tassi di allucinazione e i vincoli hardware. Cognee eccelle con modelli più grandi a bassa allucinazione (32B+) tramite Ollama ma le opzioni di dimensioni medio-piccole funzionano per le configurazioni più leggere.

Utilizzo dell'API di ricerca Web di Ollama in Python

Costruisci agenti di ricerca AI con Python e Ollama

La libreria Python di Ollama ora include funzionalità native di ricerca web OLLama. Con poche righe di codice, puoi arricchire i tuoi LLM locali con informazioni in tempo reale dal web, riducendo le illusioni e migliorando l’accuratezza.

Confronto dei Vettori Store per RAG

Scegli il database vettoriale giusto per il tuo stack RAG

La scelta del giusto vettore store può fare la differenza per le prestazioni, i costi e la scalabilità della tua applicazione RAG. Questo confronto completo copre le opzioni più popolari nel 2024-2025.