Open WebUI: samowystarczalny interfejs LLM

Autonomiczna alternatywa do ChatGPT dla lokalnych modeli językowych

Open WebUI to potężny, rozszerzalny i bogaty w funkcje samozostawiana aplikacja webowa do interakcji z dużymi modelami językowymi.

Autonomiczna alternatywa do ChatGPT dla lokalnych modeli językowych

Open WebUI to potężny, rozszerzalny i bogaty w funkcje samozostawiana aplikacja webowa do interakcji z dużymi modelami językowymi.

Szybkie wnioskowanie LLM z wykorzystaniem API OpenAI

vLLM to wysokioprądowy, oszczędny pamięciowo silnik inferencji i serwowania dla Dużych Modeli Językowych (LLM), opracowany przez Laboratorium Obliczeń Nieba UC Berkeley.

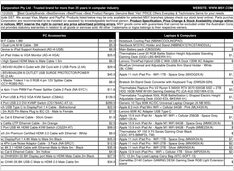

Prawdziwe ceny w AUD od australijskich sprzedawców już teraz.

NVIDIA DGX Spark](https://www.glukhov.org/pl/hardware/ai/nvidia-dgx-spark/ “NVIDIA DGX Spark - mały superkomputer AI”) (GB10 Grace Blackwell) jest dostępny w Australii w głównych sklepach z komputerami, z miejscowym zapasem. Jeśli śledzicie ceny i dostępność DGX Spark na świecie, zainteresuje Was zapewne, że ceny w Australii wahają się od 6 249 do 7 999 AUD w zależności od konfiguracji pamięci masowej i sprzedawcy.

Techniczny przewodnik po wykrywaniu treści wygenerowanych przez AI

Proliferacja treści wygenerowanych przez AI stworzyła nowe wyzwania: rozróżnianie rzeczywistego pisania ludzkiego od “AI slop” - niskiej jakości, masowo produkowanej syntetycznej treści.

Testowanie Cognee z lokalnymi modelami LLM - rzeczywiste wyniki

Cognee to framework w Pythonie do budowania grafów wiedzy z dokumentów za pomocą LLM. Ale działa on z modelami samozhostowanymi?

Bezpieczne pod względem typów wyniki z LLM z użyciem BAML i Instructora

Pracując z modelami dużych języków w środowisku produkcyjnym, uzyskiwanie strukturalnych, typowo bezpiecznych wyjść jest krytyczne. Dwa popularne frameworki – BAML i Instructor – podejmują różne podejścia do rozwiązywania tego problemu.

Refleksje nad LLM dla samowystarczalnego Cognee

Wybór najlepszego LLM dla Cognee wymaga zrównoważenia jakości budowania grafów, poziomu halucynacji i ograniczeń sprzętowych.

Cognee wyróżnia się w przypadku większych modeli o niskim poziomie halucynacji (32B+) poprzez Ollama, jednak opcje o średnich parametrach są odpowiednie dla prostszych konfiguracji.

Tworzenie agentów wyszukiwania AI za pomocą Pythona i Ollama

Biblioteka Pythona Ollama zawiera teraz natywne możliwości wyszukiwania w sieci OLlama web search. Dzięki kilku linijkom kodu możesz wzbogacić swoje lokalne modele językowe o rzeczywiste informacje z sieci, zmniejszając halucynacje i poprawiając dokładność.

Wybierz odpowiednią bazę wektorową dla swojej architektury RAG.

Wybór odpowiedniej bazy wektorowej może zadecydować o powodzeniu Twojej aplikacji RAG pod względem wydajności, kosztów i skalowalności. To kompleksowe porównanie obejmuje najpopularniejsze opcje w latach 2024-2025.

Twórz agentów wyszukiwania AI za pomocą Go i Ollama

API do wyszukiwania w sieci Ollama pozwala na wzbogacenie lokalnych modeli językowych danymi z sieci w czasie rzeczywistym. Niniejszy przewodnik pokazuje, jak zaimplementować możliwości wyszukiwania w sieci w Go, od prostych wywołań API po pełne agenty wyszukiwania.

Porównaj najlepsze lokalne narzędzia do hostowania LLM w 2026 roku. Dojrzałość API, obsługa sprzętu, wywoływanie narzędzi i rzeczywiste przypadki użycia.

Uruchamianie modeli językowych (LLM) lokalnie jest teraz praktyczne dla programistów, startupów i nawet zespołów z branży korporacyjnej.

Ale wybór odpowiedniego narzędzia — Ollama, vLLM, LM Studio, LocalAI lub innych — zależy od Twoich celów:

Twórz wydajne potoki AI/ML za pomocą mikrousług w Go

Z racji zwiększającej się złożoności obciążeń AI i ML, rosnące zapotrzebowanie na solidne systemy orkiestracji staje się jeszcze większe.

Prosta konstrukcja, wydajność i współbieżność Go czynią z niego idealny wybór do budowania warstwy orkiestracji rur ML, nawet wtedy, gdy same modele są napisane w Pythonie.

Zjednocz tekst, obrazy i dźwięk w współdzielonych przestrzeniach osadzeń.

Przestrzenne reprezentacje przekrojowe stanowią przełom w sztucznej inteligencji, umożliwiając zrozumienie i rozumowanie na przekrój danych w jednolitej przestrzeni reprezentacji.

Wdrażanie przedsiębiorstwowej sztucznej inteligencji na budżetowym sprzęcie przy użyciu modeli open-source.

Demokratyzacja sztucznej inteligencji jest tuż przed nami. Dzięki otwartym modelom LLM takim jak Llama, Mistral i Qwen, które dorównują już modelom własnościowym, zespoły mogą budować potężną infrastrukturę AI na sprzęcie konsumenckim – drastycznie obniżając koszty, jednocześnie zachowując pełną kontrolę nad prywatnością danych i wdrożeniem.

LongRAG, Self-RAG, GraphRAG – techniki następnego pokolenia

Generowanie Wspomagane Odtwarzaniem (RAG) ewoluowało znacznie poza proste wyszukiwanie wektorowe oparte na podobieństwie. LongRAG, Self-RAG oraz GraphRAG reprezentują wiodącą krawędź tych możliwości.

Przyspiesz FLUX.1-dev za pomocą kwantyzacji GGUF

FLUX.1-dev to potężny model generowania obrazów na podstawie tekstu, który daje wspaniałe wyniki, ale jego wymagania co do pamięci (24 GB i więcej) sprawiają, że trudno go uruchomić na wielu systemach. GGUF quantization of FLUX.1-dev oferta rozwiązania, które zmniejsza zużycie pamięci o około 50%, jednocześnie zachowując bardzo dobre jakość obrazów.