Costruire un BFF GraphQL con Apollo Server

Ottimizza le API frontend con GraphQL BFF e Apollo Server

Il modello Backend for Frontend (BFF) combinato con GraphQL e Apollo Server crea un’architettura potente per le moderne applicazioni web.

Ottimizza le API frontend con GraphQL BFF e Apollo Server

Il modello Backend for Frontend (BFF) combinato con GraphQL e Apollo Server crea un’architettura potente per le moderne applicazioni web.

Comandi Elasticsearch per la ricerca, l'indicizzazione e l'analisi

Elasticsearch è un potente motore di ricerca e analisi distribuito basato su Apache Lucene. Questa guida completa copre comandi essenziali, best practice e riferimenti rapidi per lavorare con i cluster Elasticsearch.

Costruisci server MCP per assistenti AI con esempi in Python

Il Model Context Protocol (MCP) sta rivoluzionando il modo in cui gli assistenti AI interagiscono con le fonti di dati esterne e gli strumenti. In questa guida, esploreremo come costruire server MCP in Python, con esempi focalizzati sulle capacità di ricerca web e scraping.

Riferimento rapido per i comandi di Docker Model Runner

Docker Model Runner (DMR) è la soluzione ufficiale di Docker per eseguire modelli AI localmente, introdotta nel aprile 2025. Questo foglio di riferimento fornisce un rapido riferimento per tutti i comandi essenziali, le configurazioni e le best practice.

Confronta Docker Model Runner e Ollama per LLM locali

Running large language models (LLMs) locally ha guadagnato popolarità per la privacy, il controllo dei costi e le capacità offline. Il panorama si è notevolmente modificato nel aprile 2025 quando Docker ha introdotto Docker Model Runner (DMR), la sua soluzione ufficiale per il deployment di modelli AI.

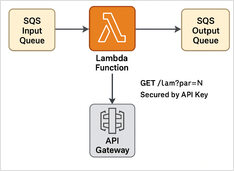

Esempio passo passo

Ecco un esempio di Python Lambda per il processore di messaggi SQS + API REST con protezione tramite chiave API + Terraform script per il deployment per l’esecuzione serverless.

+ Esempi Specifici Utilizzando LLM Pensanti

In questo post, esploreremo due modi per connettere la tua applicazione Python a Ollama: 1. Attraverso l’HTTP REST API; 2. Attraverso la libreria ufficiale Python di Ollama.

API leggermente diverse richiedono un approccio specifico.

Ecco un confronto tra il supporto per output strutturati (ottenimento di JSON affidabili) tra i principali provider di LLM, insieme a esempi Python minimi.