Farfalle против Perplexica

Сравнение двух саморазмещённых поисковых систем на базе ИИ

Вкусная еда доставляет удовольствие и глазам. Однако в этой статье мы сравним две системы поиска на базе ИИ: Farfalle и Perplexica.

Кстати, такая форма пасты тоже называется “фарфалле”.

Но здесь я сравниваю только то, как ведут себя эти две системы. Не формы пасты.

Ладно. Сосредоточьтесь!

Также рекомендую обратить внимание на: Установка и настройка Perplexica — с Ollama и Установка и настройка Ollama.

Двигатель ответов, который в этой статье обозначен как Perplexica, теперь поставляется в upstream под именем Vane; Быстрый старт Vane (Perplexica 2.0) с Ollama и llama.cpp — здесь можно найти актуальные Docker-образы, инструкции по подключению к SearxNG и информацию о смене названия.

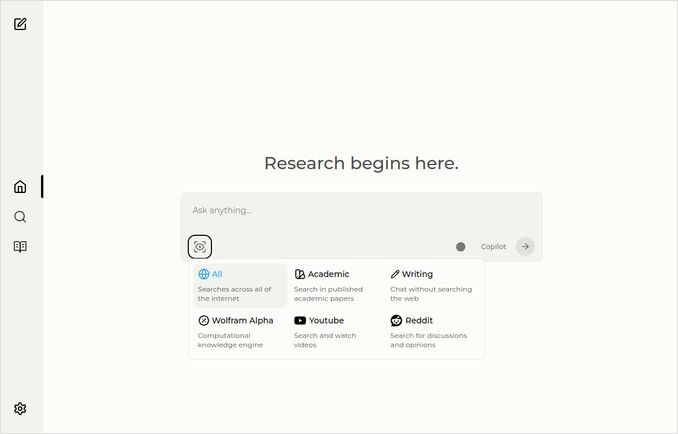

Perplexica

Вот главная страница с выпадающим списком выбора источников.

- Perplexica реализован на:

- TypeScript и React.Js (интерфейс)

- TypeScript и Express.Js (бэкенд)

- также включает конфигурацию для метапоисковика SearxNG

- Есть режим Copilot

- Возможность использовать любую модель LLM, размещенную на Ollama, в качестве чат-модели или модели эмбеддингов

- Есть три небольшие встроенные модели эмбеддингов

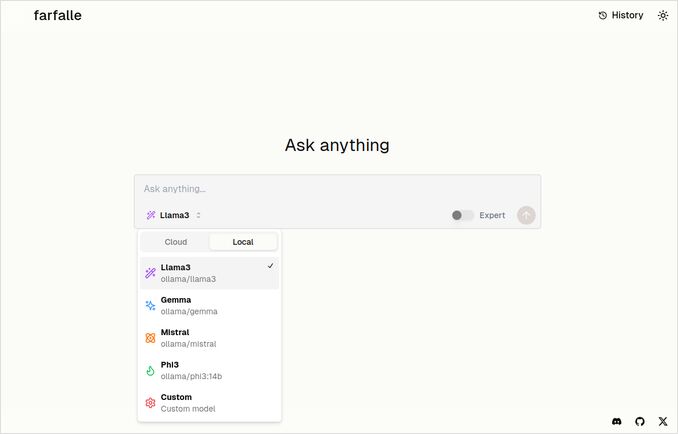

Farfalle

- Farfalle реализован на:

- TypeScript и React.Js (интерфейс)

- Python Fastapi (бэкенд)

- также включает ссылку на метапоисковик SearxNG. Конфигурация здесь минимальна, используется стандартный Docker-образ.

- Есть режим “Эксперт”, который должен формировать несколько запросов на основе исходного и объединять ответы. Однако в наших тестах это не сработало.

- Возможность использовать четыре модели LLM, размещенные на Ollama, в качестве чат-модели (llama3, mistral, gemma, phi3). Это хороший набор опций, но я бы предпочел большую гибкость и возможность использования любой модели, предоставляемой Ollama.

- Нет опций для модели эмбеддингов

Сравение, выполненное самими Perplexica и Farfalle

Я отправил одинаковый запрос: Сравните Farfalle и Perplexica по критериям надежности, сообщества, поддержки и поддерживаемых LLM.

Оба Perplexica и Farfalle использовали модель llama3, размещенную на локальном Ollama. Полное название модели: llama3 8b q4.

Не верьте на 100% тому, что говорят ответы, просто обратите внимание на длину текста, структуру и общее качество ответа.

Я бы поверил примерно на 70%…

Ответ Perplexica при сравнении

Сравнение Farfalle и Perplexica

Надежность (Robustness)

Farfalle: 8/10 — Farfalle — популярный поисковик на базе ИИ, известный своей надежностью и способностью обрабатывать сложные запросы. У него прочная основа в области обработки естественного языка (NLP) и машинного обучения (ML). Хотя он может быть не идеальным, надежность Farfalle хорошо установлена.

Perplexica: 9/10 — Perplexica построен на базе модели Phi-3 от Meta AI, которая разработана для обеспечения надежности. Он был протестирован и способен предоставлять точные ответы даже при неоднозначных или неясных запросах. Его способность перефразировать вопросы и адаптироваться к разным контекстам делает его надежным поисковиком.

Сообщество (Community)

Farfalle: 7/10 — У Farfalle есть преданное сообщество пользователей, которые ценят его возможности. Хотя уровень его внедрения может быть не таким высоким, как у Perplexica, база пользователей Farfalle все еще значительна.

Perplexica: 8.5/10 — Perplexica получил широкое признание благодаря инновационному подходу к поисковым системам. Его сообщество быстро растет, и многие пользователи ценят его способность предоставлять точные и релевантные результаты.

Поддержка (Support)

Farfalle: 6.5/10 — Farfalle обеспечивает базовую поддержку через разделы FAQ, документацию и форумы. Хотя она не так обширна, как поддержка Perplexica, пользователи Farfalle в целом способны решать свои задачи самостоятельно.

Perplexica: 9/10 — Perplexica предлагает обширные ресурсы поддержки, включая подробную документацию, FAQ и общественные форумы. Его разработчики активно взаимодействуют с сообществом, гарантируя пользователям своевременную и эффективную помощь.

Поддерживаемые LLM

Farfalle: Нет — Farfalle — это автономный поисковик на базе ИИ, который не полагается на большие языковые модели (LLM) для своих возможностей.

Perplexica: Да — Perplexica построен на базе модели Phi-3 от Meta AI, которая является LLM. Это позволяет Perplexica использовать возможности глубокого обучения для получения более точных и релевантных результатов.

Общий балл: Farfalle: 22/30, Perplexica: 34.5/40

На основе этих критериев Perplexica, по-видимому, имеет небольшое преимущество перед Farfalle в плане надежности, поддержки сообщества и интеграции LLM. Однако оба поисковика имеют свои сильные стороны, и выбор в конечном счете зависит от ваших конкретных потребностей и предпочтений.

Рекомендация: Если вы ищете надежный поисковик на базе ИИ с сильными возможностями NLP, Perplexica может быть лучшим выбором. Если вы предпочитаете более прямой, простой подход к поиску, Farfalle все еще может обеспечить отличные результаты.

Ответ Farfalle при сравнении

Сравнение Farfalle и Perplexica

Farfalle и Perplexica — это два поисковика на базе ИИ, которые привлекли внимание в последнее время. Вот сравнение этих двух проектов на основе надежности, сообщества, поддержки и поддержки LLM (больших языковых моделей).

Надежность

- Farfalle разработан для самостоятельного размещения с локальными или облачными LLM, что делает его более надежным вариантом для пользователей, которые хотят контролировать свой поисковик.

- Perplexica, с другой стороны, является открытым альтернативным решением для Perplexity AI и постоянно улучшается его разработчиками.

Сообщество

- Perplexica имеет преданное сообщество разработчиков и пользователей, которые способствуют его развитию и предоставляют поддержку.

- Сообщество Farfalle меньше, но оно все еще присутствует на GitHub.

Поддержка

- Perplexica предлагает регулярные обновления и улучшения, а также канал Discord для обсуждения вопросов вне рамок обычной поддержки.

- Поддержка Farfalle ограничена вопросами и pull-запросами на GitHub.

Поддержка LLM: Оба Farfalle и Perplexica поддерживают LLM. Perplexica использует Ollama (локальную LLM), в то время как Farfalle поддерживает как локальные, так и облачные LLM.

В заключение, Farfalle более надежен благодаря своей архитектуре самостоятельного размещения, в то время как Perplexica имеет более сильное сообщество и лучшую поддержку. Оба проекта поддерживают LLM, но Perplexica использует конкретно Ollama.

Заключение

В чем разница между Perplexica и Farfalle?

Ответ:

- Оставив в стороне некоторые фактические ошибки, обе системы считают, что Perplexica лучше, чем Farfalle, с чем я бы согласился.

- Мне очень нравится интерфейс Farfalle, хотя они довольно близки.

- Мне нравится идея режима “Эксперт” в Farfalle, хотя он не работал в моей среде.

- При запуске Farfalle я столкнулся с 3 ошибками. Код Perplexica более отполирован.

- После настройки Perplexica работал без каких-либо ошибок.

- Perplexica позволяет использовать любую модель, размещенную на Ollama. А Farfalle позволяет использовать только Gemma, Llama3, Mistral и Phi3 (предопределенные версии, которые немного устарели).

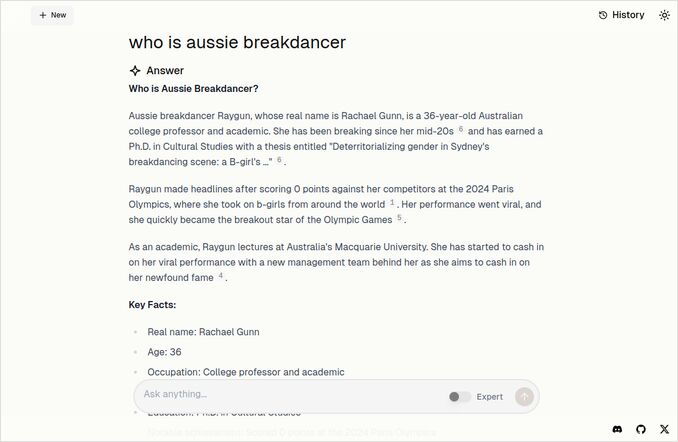

- Мне больше нравятся ответы Farfalle. Посмотрите на изображение Farfalle ниже. Прямо к делу, без этих фраз вроде “Согласно предоставленному контексту…”

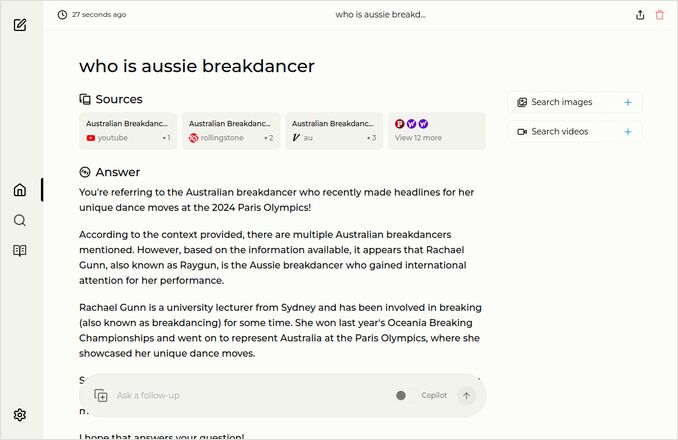

Дополнительные примеры

Здесь показаны ответы на один и тот же вопрос об австралийском брейк-дансере. Вы знаете, того, у которого есть PhD, который получил 0 (ноль) баллов и, вероятно, из-за чего брейк-данс был удален из программы Олимпийских игр.

Ответ Farfalle

Ответ Perplexica

Если вы прочитаете (или пролистаете) до этого последнего абзаца, спасибо за то, что у нас одинаковые интересы. Это действительно захватывающее время. Всего вам наилучшего!

Полезные ссылки

- Поиск vs Глубокий поиск vs Глубокое исследование

- Тест: как Ollama использует производительность CPU Intel и эффективные ядра

- Как Ollama обрабатывает параллельные запросы

- Самостоятельное развертывание Perplexica — с Ollama

- Сравнение способностей LLM к суммаризации

- Написание эффективных промптов для LLM

- Тестирование обнаружения логических ошибок новыми LLM: gemma2, qwen2 и mistral Nemo

- Шпаргалка по Ollama

- Шпаргалка по Markdown

- Облачные провайдеры LLM

- Модели эмбеддинга и реранкера Qwen3 на Ollama: передовой уровень производительности