Tworzenie GraphQL BFF z użyciem Apollo Server

Optymalizuj API前端 z użyciem GraphQL BFF i Apollo Server

Wzorzec Backend for Frontend (BFF) w połączeniu z GraphQL i Apollo Server tworzy potężną architekturę dla nowoczesnych aplikacji webowych.

Optymalizuj API前端 z użyciem GraphQL BFF i Apollo Server

Wzorzec Backend for Frontend (BFF) w połączeniu z GraphQL i Apollo Server tworzy potężną architekturę dla nowoczesnych aplikacji webowych.

Polecenia Elasticsearch do wyszukiwania, indeksowania i analizy

Elasticsearch to potężny, rozproszony silnik wyszukiwania i analityczny oparty na Apache Lucene. Ten kompleksowy skrypt zawiera podstawowe polecenia, najlepsze praktyki i szybkie odniesienia do pracy z klastrami Elasticsearch.

Tworzenie serwerów MCP dla asystentów AI z przykładami w Pythonie

Protokół Kontekstu Modelu (MCP) rewolucjonizuje sposób, w jaki asystenci AI interagują z zewnętrznymi źródłami danych i narzędziami. W tym przewodniku omówimy, jak zbudować serwery MCP w Pythonie, z przykładami skupionymi na możliwościach wyszukiwania w sieci i skrapowania.

Szybki przewodnik po poleceniach Docker Model Runnera

Docker Model Runner (DMR) to oficjalne rozwiązanie firmy Docker do uruchamiania modeli AI lokalnie, wprowadzone w kwietniu 2025. Ten cheatsheet zawiera szybki przewodnik po wszystkich istotnych poleceniach, konfiguracjach i najlepszych praktykach.

Porównaj Docker Model Runner i Ollama w kontekście lokalnych modeli LLM

Uruchamianie dużych modeli językowych (LLM) lokalnie staje się coraz bardziej popularne ze względu na prywatność, kontrolę kosztów i możliwości offline. Landscape zmienił się znacząco w kwietniu 2025 roku, gdy Docker wprowadził Docker Model Runner (DMR), oficjalne rozwiązanie do wdrażania modeli AI.

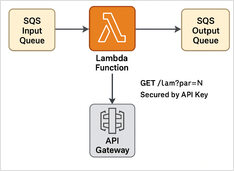

Przykład krok po kroku

Oto przykład Python Lambda do przetwarzania wiadomości SQS + interfejsu API REST z ochroną za pomocą klucza API + Terraform skryptu do wdrożenia w trybie bezserwerowym.

+ Konkretne Przykłady Używania Myślących LLMów

W tym wpisie omówimy dwa sposoby połączenia swojej aplikacji Python z Ollama: 1. Poprzez HTTP REST API; 2. Poprzez oficjalną bibliotekę Pythona do Ollama.

Nieco odmienne interfejsy API wymagają specjalnego podejścia.

Oto porównanie obsługi strukturyzowanej odpowiedzi (uzyskiwanie niezawodnego JSONa) u popularnych dostawców modeli LLM, wraz z minimalnymi przykładami w języku Python