Enshittification Ollama – wczesne objawy

Moje spojrzenie na obecnym stanie rozwoju Ollama

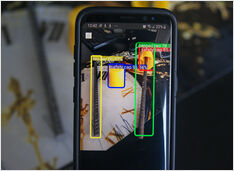

Ollama szybko stało się jednym z najpopularniejszych narzędzi do uruchamiania modeli językowych na lokalnym komputerze.

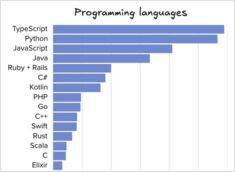

Jego proste CLI i zoptymalizowane zarządzanie modelami sprawiły, że stało się preferowanym wyborem dla programistów, którzy chcą pracować z modelami AI poza chmurą.