팔팔레 대 퍼플렉시카

두 개의 자체 호스팅 AI 검색 엔진 비교

아름다운 음식은 눈으로도 즐길 수 있는 즐거움입니다. 하지만 이번 포스팅에서는 두 가지 AI 기반 검색 시스템인 Farfalle 와 Perplexica 를 비교해 보겠습니다.

그런데 이 파스타의 모양도 “파르팔레 (farfalle)“라고 부릅니다.

하지만 여기서는 파스타 모양이 아니라, 이 두 시스템 이 어떻게 작동하는지만 비교하겠습니다.

좋습니다. 집중하세요!

아래의 내용도 참고하시기 바랍니다. Perplexica 설치 및 설정 - Ollama 사용 그리고 Ollama 설치 및 설정.

이 글에서 Perplexica라고 표기한 답변 엔진은 이제 Vane으로 상류 (upstream) 에 출시되었습니다. 최신 Docker 이미지, SearxNG 연동 방법, 그리고 이름 변경 타임라인은 Vane (Perplexica 2.0) Ollama 와 llama.cpp 를 활용한 빠른 시작 에서 확인하실 수 있습니다.

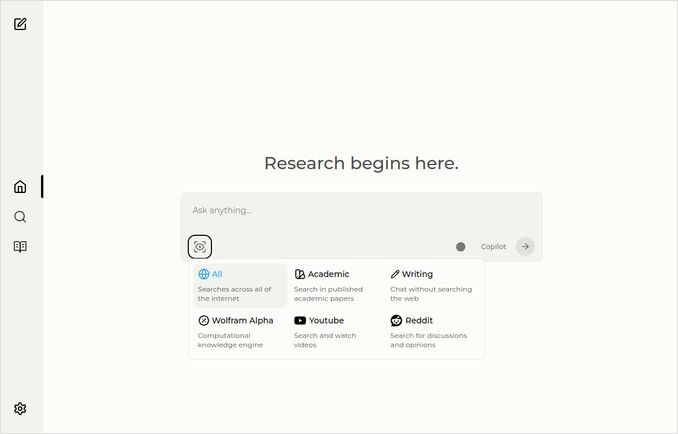

Perplexica

여기 소스 선택 드롭다운이 있는 홈 페이지입니다.

- Perplexica 는 다음으로 구현되었습니다.

- TypeScript 와 React.Js (UI)

- TypeScript 와 Express.Js (Backend)

- 또한 SearxNG 메타검색 엔진 설정을 포함합니다.

- Copilot 모드를 제공합니다.

- Ollama 에서 호스팅된 임의의 LLM 을 채팅 또는 임베딩 모델로 사용할 수 있습니다.

- 세 개의 소형 내부 임베딩 모델을 포함합니다.

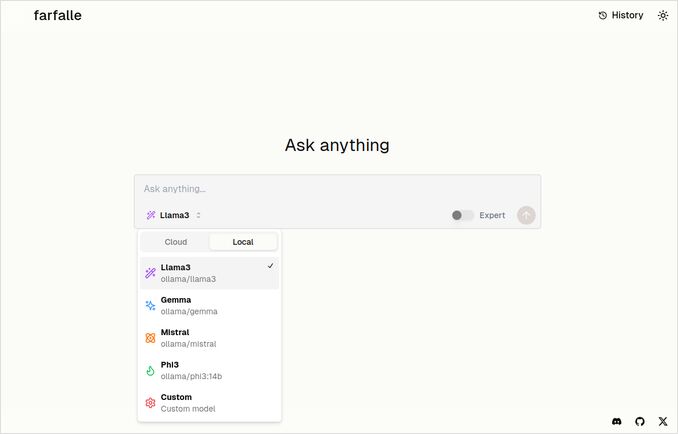

Farfalle

- Farfalle 는 다음으로 구현되었습니다.

- TypeScript 와 React.Js (UI)

- Python Fastapi (Backend)

- 또한 SearxNG 메타검색 엔진에 대한 참조를 포함합니다. 이 설정은 많지 않으며, 꽤 표준적인 Docker 이미지를 사용합니다.

- 원본 요청에서 여러 요청을 준비하고 응답을 결합해야 하는 전문가 (Expert) 모드를 제공합니다. 하지만 저희 테스트에서는 작동하지 않았습니다.

- 네 가지 Ollama 호스팅 LLM(llama3, mistral, gemma, phi3) 을 채팅 모델로 사용할 수 있습니다. 좋은 옵션이지만, Ollama 에서 제공하는 모든 모델을 사용할 수 있도록 더 유연했으면 좋겠습니다.

- 임베딩 모델에 대한 옵션이 없습니다.

Perplexica 와 Farfalle 자가 비교

저는 동일한 요청을 실행했습니다. 강건성, 커뮤니티, 지원 및 지원되는 LLM 을 기준으로 Farfalle 와 Perplexica 를 비교하세요.

Perplexica 와 Farfalle 모두 로컬 Ollama 에 호스팅된 llama3 모델을 사용했습니다. 모델의 전체 이름은 llama3 8b q4 입니다.

응답이 말하는 내용을 100% 믿지는 마시고, 텍스트 길이, 구조 및 전반적인 응답 품질을 확인하세요.

약 70% 정도 믿을 만합니다…

Perplexica 비교 응답

Farfalle 와 Perplexica 비교

강건성 (Robustness)

Farfalle: 8/10 - Farfalle 는 신뢰성과 복잡한 쿼리 처리 능력으로 유명한 인기 AI 검색 엔진입니다. 자연어 처리 (NLP) 와 기계 학습 (ML) 에 튼튼한 기반을 두고 있습니다. 완벽하지는 않을 수 있지만 Farfalle 의 강건성은 잘 입증되어 있습니다.

Perplexica: 9/10 - Perplexica 는 강건성을 위해 설계된 Meta AI 의 Phi-3 모델 위에 구축되었습니다. 모호하거나 명확하지 않은 쿼리를 마주하더라도 정확한 답변을 제공하도록 테스트되었습니다. 질문을 재구성하고 다양한 상황에 적응할 수 있는 능력으로 인해 강건한 검색 엔진이 됩니다.

커뮤니티 (Community)

Farfalle: 7/10 - Farfalle 는 그 기능을 높이 평가하는 충성도 높은 사용자 커뮤니티가 있습니다. Perplexica 만큼 널리 채택되지는 않았을 수 있지만, Farfalle 의 사용자 기반 역시 상당합니다.

Perplexica: 8.5/10 - Perplexica 는 검색 엔진에 대한 혁신적인 접근 방식으로 널리 인정받고 있습니다. 그 커뮤니티는 빠르게 성장하고 있으며 많은 사용자가 정확하고 관련성 높은 결과를 제공하는 능력을 높이 평가합니다.

지원 (Support)

Farfalle: 6.5/10 - Farfalle 는 FAQ, 문서, 포럼을 통해 기본 지원을 제공합니다. Perplexica 의 지원만큼 포괄적이지는 않지만, Farfalle 의 사용자 기반은 일반적으로 스스로 해결할 수 있습니다.

Perplexica: 9/10 - Perplexica 는 상세한 문서, FAQ, 커뮤니티 포럼을 포함한 광범위한 지원 리소스를 제공합니다. 개발자들이 커뮤니티와 적극적으로 소통하여 사용자가 시기적절하고 효과적인 지원을 받을 수 있도록 보장합니다.

지원되는 LLM

Farfalle: 아님 - Farfalle 는 기능에 대형 언어 모델 (LLM) 에 의존하지 않는 독립형 AI 검색 엔진입니다.

Perplexica: 네 - Perplexica 는 LLM 인 Meta AI 의 Phi-3 모델 위에 구축되었습니다. 이를 통해 Perplexica 는 더 정확하고 관련성 높은 결과를 위해 딥러닝의 힘을 활용할 수 있습니다.

종합 점수 Farfalle: 22/30 Perplexica: 34.5/40

이 기준에 따르면 Perplexica 는 강건성, 커뮤니티 지원, LLM 통합 측면에서 Farfalle 보다 약간 우세한 것으로 보입니다. 그러나 두 검색 엔진 모두 장점이 있으며, 선택은 궁극적으로 사용자의 특정 필요와 선호도에 달려 있습니다.

추천: 강력한 NLP 기능을 갖춘 신뢰할 수 있는 AI 검색 엔진을 찾고 있다면 Perplexica 가 더 나은 선택일 수 있습니다. 만약 더 직관적이고 간소한 검색 방식을 선호한다면 Farfalle 도 여전히 훌륭한 결과를 제공할 수 있습니다.

Farfalle 비교 응답

Farfalle 와 Perplexica 비교

Farfalle 와 Perplexica 는 최근 주목을 받은 두 가지 AI 기반 검색 엔진입니다. 여기 강건성, 커뮤니티, 지원 및 LLM(대형 언어 모델) 지원에 기반한 두 프로젝트의 비교입니다.

강건성

- Farfalle 는 로컬 또는 클라우드 LLM 을 사용하여 자체 호스팅되도록 설계되어 검색 엔진을 완전히 제어하려는 사용자에게 더 강건한 옵션을 제공합니다.

- 반면 Perplexica 는 Perplexity AI 의 오픈소스 대안이며 개발자들에 의해 지속적으로 개선되고 있습니다.

커뮤니티

- Perplexica 는 개발과 지원을 위해 기여하는 개발자와 사용자의 전용 커뮤니티를 보유하고 있습니다.

- Farfalle 의 커뮤니티는 작지만 GitHub 에서 여전히 존재감을 보여줍니다.

지원

- Perplexica 는 정기적인 업데이트와 개선을 제공하며, 일반적인 지원 범위 외의 사항을 논의하기 위한 Discord 채널을 운영합니다.

- Farfalle 의 지원은 GitHub 이슈와 풀 리퀘스트로 제한됩니다.

LLM 지원: Farfalle 와 Perplexica 모두 LLM 을 지원합니다. Perplexica 는 로컬 LLM 인 Ollama 를 사용하는 반면, Farfalle 는 로컬 및 클라우드 LLM 모두를 지원합니다.

요약하자면, Farfalle 는 자체 호스팅 설계로 인해 더 강건한 반면, Perplexica 는 더 강력한 커뮤니티와 더 나은 지원을 제공합니다. 두 프로젝트 모두 LLM 을 지원하지만, Perplexica 는 구체적으로 Ollama 를 사용합니다.

결론

Perplexica 와 Farfalle 의 차이점은 무엇일까요?

답변:

- 몇 가지 사실적 오류를 제외하고, 두 시스템 모두 Perplexica 가 Farfalle 보다 낫다고 생각하는데, 저도 이에 동의합니다.

- UI 는 매우 비슷하지만, 저는 Farfalle UI 를 훨씬 더 선호합니다.

- Farfalle 의 전문가 (Expert) 모드 아이디어는 마음에 들어요. 다만 저의 환경에서는 작동하지 않았습니다.

- Farfalle 를 실행하는 동안 3 개의 버그를 발견했습니다. Perplexica 코드가 더 다듬어진 편입니다.

- 한 번 설정되면 Perplexica 는 오류 없이 실행되었습니다.

- Perplexica 는 Ollama 호스팅된 어떤 모델이라도 사용할 수 있게 해줍니다. 반면 Farfalle 는 Gemma, Llama3, Mistral, Phi3(사전 정의된 버전으로 약간 구식임) 만 사용할 수 있습니다.

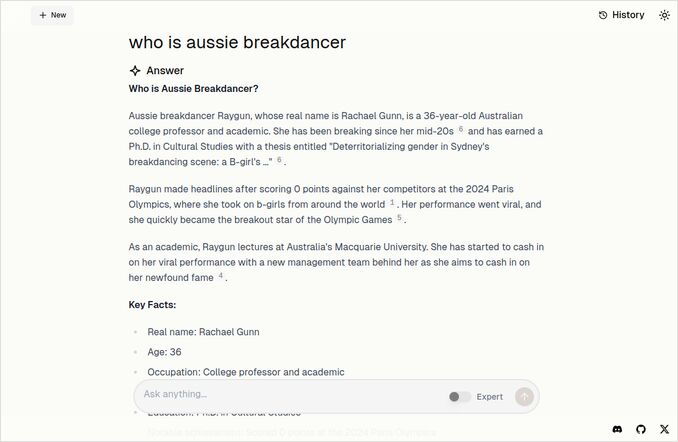

- 저는 Farfalle 의 응답이 더 마음에 듭니다. 아래 Farfalle 이미지를 보세요. “제공된 컨텍스트에 따르면…” 같은 말 없이 바로 핵심을 찌릅니다.

더 많은 예시

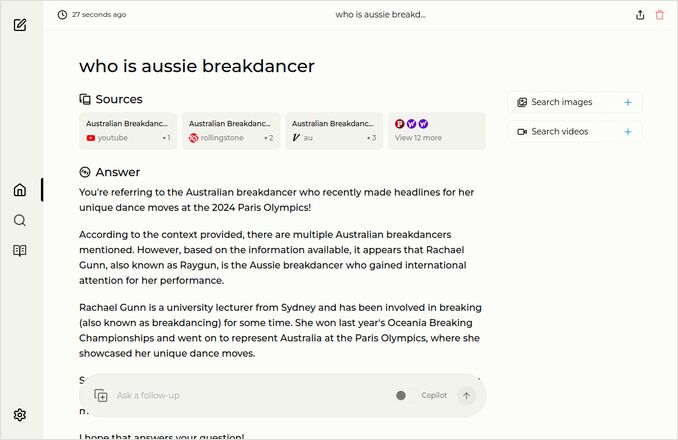

이것들은 호주 브레이크댄서 (aussie breakdancer) 에 관한 동일한 질문에 대한 응답입니다. PhD 학위가 있지만 0 점 (제로) 을 받아 올림픽 프로그램에서 브레이크댄싱이 제거될 가능성이 있는 그 사람에 대한 질문입니다.

Farfalle 응답

Perplexica 응답

이 마지막 단락을 위 (또는 아래) 로 읽으시면, 저와 같은 관심을 가지고 주셔서 감사합니다. 정말 흥미진진한 시기입니다. 좋은 하루 되세요!