Netlify と Hugo および静的サイト:料金プラン、無料枠、および代替案

Git ベースのデプロイ、CDN、クレジット、およびトレードオフ。

Netlify は、開発者フレンドリーな方法の一つであり、Hugo サイトやモダンな Web アプリを、本番環境グレードのワークフローで配信するためのプラットフォームです。プルリクエストごとのプレビュー URL、アトミックなデプロイ、グローバル CDN、およびオプションのサーバーレス機能やエッジ機能を備えています。

Git ベースのデプロイ、CDN、クレジット、およびトレードオフ。

Netlify は、開発者フレンドリーな方法の一つであり、Hugo サイトやモダンな Web アプリを、本番環境グレードのワークフローで配信するためのプラットフォームです。プルリクエストごとのプレビュー URL、アトミックなデプロイ、グローバル CDN、およびオプションのサーバーレス機能やエッジ機能を備えています。

後悔せずに、ドメイン向けのホストメールサービスを選択しましょう。

独自ドメインへのメール設定は、週末の DNS 設定作業のように聞こえますが、実際には 20 年の歴史を持つ小さな分散システムです。

Kafka 4.2 をインストールし、数分でイベントをストリーミング処理します。

Apache Kafka 4.2.0 は現在のサポート対象リリースであり、Kafka 4.x は完全に ZooKeeper 不要化され、デフォルトで KRaft に基づいて構築されているため、モダンな Quickstart の最適な基準となります。

OpenCode LLM テスト — コーディングと精度の統計

OpenCode が、ローカルでホストされているいくつかの Ollama LLM とどのように連携するかをテストしました。また比較のために、OpenCode Zen から Free モデルもいくつか追加しています。

Airtable - 無料プランの制限、API、Webhook、GoおよびPython。

Airtableは、協力的な「データベースに似た」スプレッドシートUIを中心に構築された低コードアプリケーションプラットフォームと考えるのが最も適切です。これは、非開発者が友好的なインターフェースを必要とするが、開発者も自動化と統合のためにAPI表面が必要な場合に、運用ツール(内部トラッカー、軽量なCRM、コンテンツパイプライン、AI評価キュー)を迅速に作成するのに非常に適しています。

プロメテウスとグラファナでLLMをモニタリングする

LLMの推論は「単なるAPI」のように見えるが、レイテンシーが急激に増加し、キューが再び詰まり、GPUが95%のメモリ使用率で動いていても明らかに原因が分からないという状況に陥るまでには至らない。

ローカルに OpenClaw を Ollama でインストールする

OpenClawは、OllamaなどのローカルLLMランタイムや、Claude Sonnetなどのクラウドベースのモデルを使用して動作する、セルフホスト型のAIアシスタントです。

AWS S3、Garage、またはMinIO - 概要と比較。

AWS S3はオブジェクトストレージの「デフォルト」の基準であり、完全に管理されており、強い一貫性を持ち、非常に高い耐久性と可用性が設計されています。

GarageおよびMinIOは、自己ホスト型のS3互換の代替案: Garageは軽量で、地理的に分散された小規模から中規模のクラスター向けに設計されていますが、MinIOはS3 APIの幅広い機能カバレッジと、大規模な展開での高パフォーマンスを強調しています。

LLM推論およびLLMアプリケーション向けのエンドトゥーエンドの観測性戦略

LLMシステムは、従来のAPIモニタリングでは表面化できない方法で失敗します。キューが静かに満たされ、GPUメモリがCPUが忙しくなる前に飽和し、レイテンシがアプリケーション層ではなくバッチング層で爆発します。本ガイドでは、LLM推論およびLLMアプリケーション向けのエンドツーエンドの観測性戦略について説明します。測定すべき項目、Prometheus、OpenTelemetry、Grafanaを使ってどのようにインストゥルメント化するか、そしてテレメトリーパイプラインをスケールしてデプロイする方法をカバーします。

AWS CLI を使用して CloudFront の Pay-as-you-go を作成します。

AWS Freeプランは私の場合動作しておらず、AWSコンソール上で新しいCloudFrontディストリビューションではPay-as-you-goが非表示となっています。

セルフホストされたLLMでデータとモデルを制御する

LLMを自社でホストすることで、データ、モデル、推論を自らの管理下に置くことができます。これは、チームや企業、国家にとっても実用的な**AI主権**への道です。

AWS S3 への Hugo のデプロイを自動化する

AWS CLIを使用してHugo静的サイトをAWS S3にデプロイすることで、ウェブサイトをホストするための堅牢でスケーラブルなソリューションが提供されます。このガイドでは、初期設定から高度な自動化およびキャッシュ管理戦略まで、完全なデプロイメントプロセスをカバーしています。

ハーグоサイトの開発と運用を最適化する

Hugoのキャッシュ戦略は、静的サイトジェネレータのパフォーマンスを最大化するために不可欠です。Hugoは本来静的なファイルを生成するため、処理が高速ですが、複数のレイヤーで適切なキャッシュを実装することで、ビルド時間の大幅な改善、サーバー負荷の軽減、ユーザー体験の向上が可能です。

専用チップにより、AIの推論がより高速かつ低コストになっている。

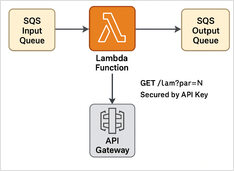

ステップバイステップの例

ここに、Python LambdaのSQSメッセージプロセッサの例 + REST APIとAPIキー保護 + Terraformスクリプトがあり、サーバーレス実行のためにそれをデプロイします。