OpenClaw クイックスタート:Dockerによるインストール(Ollama GPUまたはClaude + CPU)

Ollamaを使ってOpenClawをローカルにインストール

OpenClawは、OllamaなどのローカルLLMランタイム、またはClaude Sonnetなどのクラウドベースのモデルと連携して実行される、セルフホスト型AIアシスタントです。

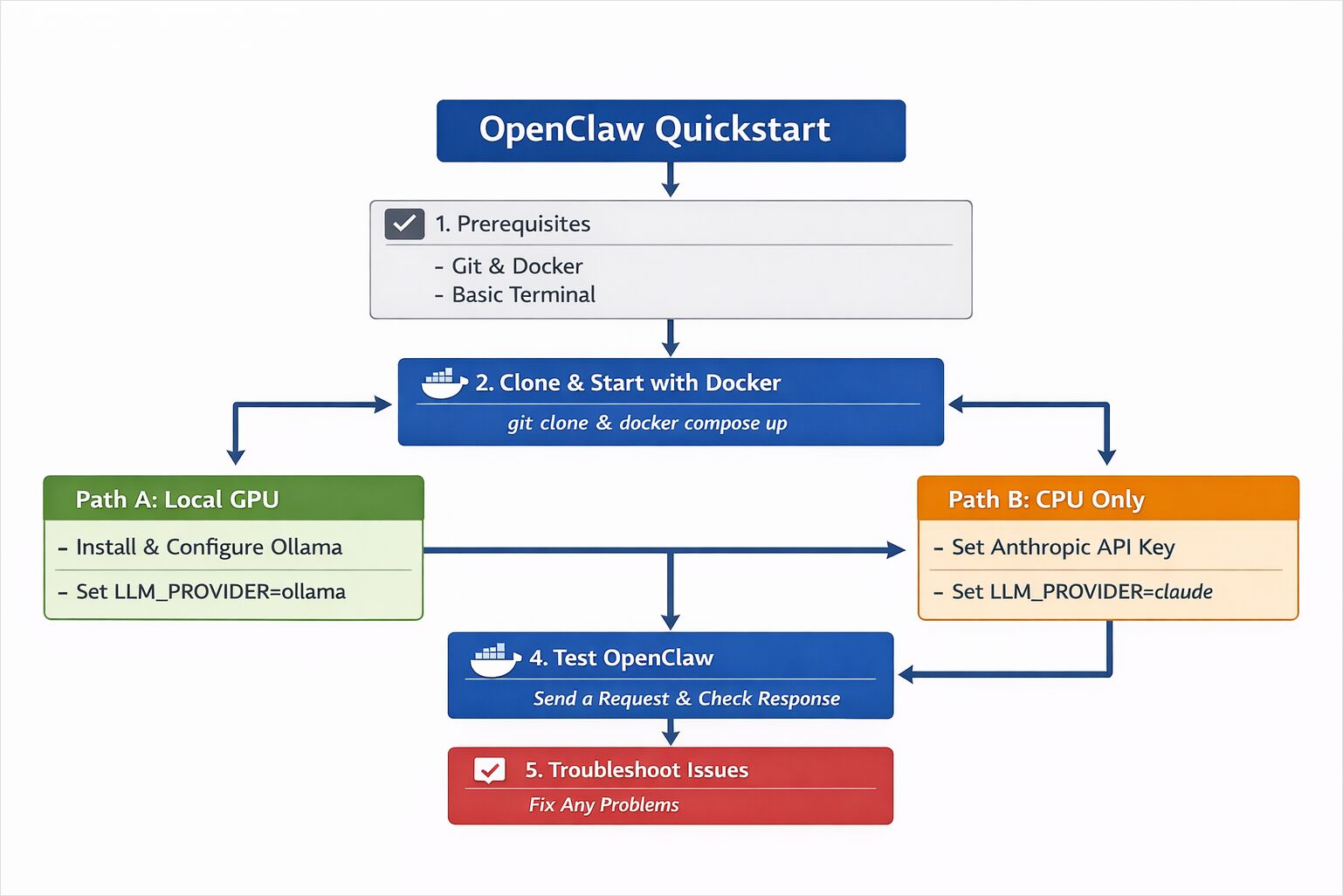

このクイックスタートガイドでは、Dockerを使用してOpenClawをデプロイし、GPU搭載のローカルモデルまたはCPU専用のクラウドモデルのいずれかを設定し、AIアシスタントがエンドツーエンドで正常に動作していることを確認する方法を示します。

このガイドでは、OpenClawの最小限の設定手順を説明し、ご自身のマシンで実行して応答を得るまでのプロセスを解説します。

目標はシンプルです。

- OpenClawを実行させる。

- リクエストを送信する。

- 動作が正常であることを確認する。

これは本番環境向けの堅牢化ガイドではありません。

これはパフォーマンスチューニングのガイドでもありません。

これは実践的なスタートポイントです。

以下の2つのオプションから選べます。

- パスA — ローカルGPU(Ollamaを使用。GPUをお持ちの場合は推奨)

- パスB — CPU専用(Anthropic API経由でClaude Sonnet 4.6を使用)

両方のパスとも、コアとなるインストールプロセスは共通しています。

OpenClawを初めてご利用になる方で、システム構造の詳細な概要を知りたい場合は、OpenClawシステム概要をお読みください。 tighterなサンドボックスとポリシー制御を備えた常時稼働のアシスタントを実行する予定の場合は、NemoClawセキュリティ運用ガイドに従ってください。

システム要件と環境設定

OpenClawは外部サービスに接続できるアシスタント型のシステムです。このクイックスタートでは以下の点にご注意ください。

- 可能な限りテストアカウントを使用する。

- 機密性の高い本番システムへの接続は避ける。

- Docker内で実行する(推奨)。

エージェント型ソフトウェアを試用する際は、分離環境をデフォルトとするのが良いアプローチです。

OpenClawの前提条件(OllamaによるGPU利用、またはClaudeによるCPU利用)

両方のパスで必要

- Git

- Docker Desktop(またはDocker + Docker Compose)

- ターミナル

パスA(ローカルGPU)の場合

- 互換性のあるGPUを搭載したマシン(NVIDIAまたはAMD推奨)

- Ollamaがインストールされていること

パスB(CPU + クラウドモデル)の場合

- Anthropic APIキー

- Claude Sonnet 4.6へのアクセス権

ステップ1 — DockerでOpenClawをインストール(クローン&起動)

OpenClawはDocker Composeを使用して起動できます。これにより、設定が分離され、再現性も保たれます。

リポジトリのクローン

git clone https://github.com/openclaw/openclaw.git

cd openclaw

環境設定のコピー

cp .env.example .env

エディタで.envファイルを開きます。次に、選択したモデルパスに応じて設定を行います。

コンテナの起動

docker compose up -d

すべてが正常に起動した場合、以下のようにコンテナが実行中であることが確認できます。

docker ps

この段階で、OpenClawは実行状態ですが、まだモデルには接続されていません。

ステップ2 — LLMプロバイダの設定(Ollama GPUまたはClaude CPU)

ここで、推論をどのように実行するか決定します。

パスA — OllamaによるローカルGPU

GPUが利用可能な場合、これが最もシンプルで自己完結型のオプションです。

Ollamaのインストールまたは確認

より詳細なインストールガイドが必要な場合、またはモデルストレージの場所を設定したい場合は、以下を参照してください。

Ollamaがインストールされていない場合は、以下を実行します。

curl -fsSL https://ollama.com/install.sh | sh

動作確認を行います。

ollama pull llama3

ollama run llama3

モデルが応答すれば、推論が正常に動作していることになります。

OpenClawでOllamaを使用するように設定

.envファイルで以下のように設定します。

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

コンテナを再起動します。

docker compose restart

これで、OpenClawはリクエストをローカルのOllamaインスタンスにルーティングします。

16GBのGPUでどのモデルを実行するか検討中、ベンチマーク比較が必要な場合、あるいはツール多用のアシスタント向けに適切なQwen / Gemma サンプリングデフォルト値が必要な場合は、以下を参照してください。

負荷下での並行処理とCPUの動作を理解するために:

パスB — Claude Sonnet 4.6によるCPU専用

GPUをお持ちでない場合は、ホストされたモデルを使用できます。

APIキーの追加

.envファイルで以下を設定します。

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

再起動します。

docker compose restart

これで、OpenClawは推論にClaude Sonnet 4.6を使用し、オーケストレーションはローカルで実行されます。

この設定は、計算負荷の重いモデル演算がクラウドで行われるため、CPU専用のマシンでも問題なく動作します。

Anthropicモデルを使用している場合、このClaudeサブスクリプションポリシーの変更は、OpenClawがClaudeプランの再利用ではなく、APIベースの課金が必要となる理由を説明しています。

ステップ3 — 最初のプロンプトでOpenClawをテスト

コンテナが実行され、モデルが設定されれば、アシスタントをテストできます。

設定状況により、以下を通じてテスト可能です。

- Webインターフェース

- メッセージング統合

- ローカルAPIエンドポイント

基本的なAPIテストの場合:

curl http://localhost:3000/health

正常なステータス応答が表示されるはずです。

次に、シンプルなプロンプトを送信します。

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explain what OpenClaw does in simple terms."}'

構造化された応答が返ってくれば、システムは正常に動作しています。

実行した内容のまとめ

この時点で、以下が完了しています。

- 稼働中のOpenClawインスタンス

- 設定済みのLLMプロバイダ(ローカルまたはクラウド)

- 動作しているリクエスト-レスポンスループ

GPUパスを選択した場合、推論はOllama経由でローカルで行われます。

CPUパスを選択した場合、推論はClaude Sonnet 4.6経由で行われ、オーケストレーション、ルーティング、メモリ処理はローカルのDockerコンテナ内で実行されます。

見える相互作用はシンプルに思えるかもしれません。しかしその裏では、複数のコンポーネントが連携してリクエストを処理しています。

OpenClawのインストールとランタイムの問題トラブルシューティング

モデルが応答しない場合

.env設定を確認してください。- コンテナのログを確認:

docker compose logs

Ollamaに接続できない場合

- Ollamaが実行中であることを確認:

ollama list

- ベースURLが環境と一致していることを確認してください。

無効なAPIキー

ANTHROPIC_API_KEYを再確認してください。.envを更新した後、コンテナを再起動してください。

GPUが使用されていない場合

- GPUドライバがインストールされていることを確認してください。

- DockerでGPUアクセスクが有効になっていることを確認してください。

OpenClawインストール後の次のステップ

これで、動作するOpenClawインスタンスが整いました。

ここから、以下を行うことができます。

- メッセージングプラットフォームを接続する

- 文書取得を有効にする

- ルーティング戦略を試す

- 可視性とメトリクスを追加する

- パフォーマンスとコスト動作を調整する

より深いアーキテクチャの議論は、システムが稼働してからの方が理解しやすいでしょう。

動作させることが第一のステップです。

稼働した後、自然な次の記事は以下になります。

- OpenClawプラグインガイド — メモリ、ツール、チャネル、可視性のためにどのプラグインをインストールするか、およびライフサイクルがどのように機能するか

- OpenClawスキルガイド — ClawHubからインストールする価値のあるスキル、およびエージェントロールごとにそれらを安全にゲートする方法

- OpenClaw本番環境セットアップパターン — 開発者、自動化チーム、研究者、サポートオペレーターといった実際のユーザータイプのために、プラグインとスキルがどのように組み合わせられるか

より多くのAIシステム事例研究については、AIシステムセクションを参照してください。