Farfalle contro Perplexica

Confronto tra due motori di ricerca AI self-hosted

Il cibo meraviglioso è un piacere anche per i tuoi occhi. Ma in questo post confronteremo due sistemi di ricerca basati sull’IA, Farfalle e Perplexica.

A proposito, anche questa forma di pasta si chiama “farfalle”.

Ma qui mi limiterò a confrontare come si comportano questi due sistemi. Non le forme di pasta.

Bene. Concentrati!

Vedi anche Installazione e configurazione di Perplexica - con ollama e Installare e configurare Ollama.

Il motore di risposta etichettato in questo articolo come Perplexica è ora disponibile a monte come Vane; Vane (Perplexica 2.0) Guida rapida con Ollama e llama.cpp è il punto di riferimento per le immagini Docker attuali, l’integrazione con SearxNG e la cronologia del rinominamento.

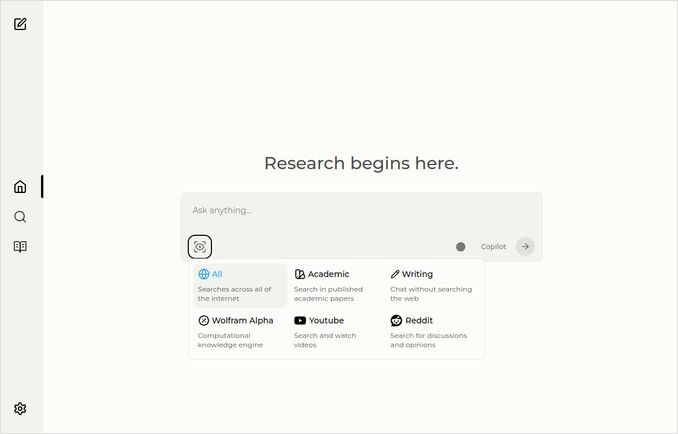

Perplexica

Ecco la homepage con il menu a tendina per la selezione delle fonti.

- Perplexica è implementato in

- TypeScript e React.Js (UI)

- TypeScript e Express.Js (Backend)

- include inoltre la configurazione per il motore di metaricerca SearxNG

- Dispone di una modalità Copilot

- Ha la capacità di utilizzare qualsiasi LLM ospitato su Ollama come modello per chat o embeddings

- Include tre piccoli modelli di embedding interni

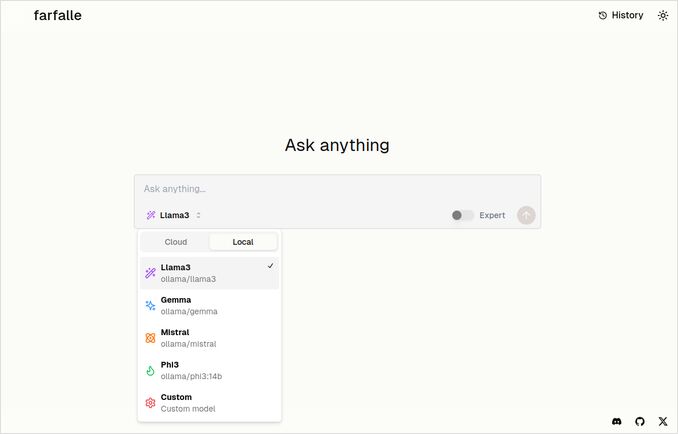

Farfalle

- Farfalle è implementato in

- TypeScript e React.Js (UI)

- Python Fastapi (Backend)

- include inoltre un riferimento al motore di metaricerca SearxNG. Non c’è molta configurazione per questo, è un’immagine Docker piuttosto standard.

- Dispone di una modalità Esperto che dovrebbe preparare diverse richieste partendo da quella originale e combinarne le risposte. Ma questo non ha funzionato nei nostri test.

- Ha la capacità di utilizzare quattro LLM ospitati su Ollama come modello per chat (llama3, mistral, gemma, phi3). È un buon set di opzioni, ma preferirei che fosse più flessibile e consentisse di utilizzare qualsiasi modello servito da Ollama.

- Nessuna opzione per il modello di embedding

Confronto effettuato da Perplexica e Farfalle stesse

Ho eseguito la stessa richiesta: Confronta Farfalle e Perplexica in base a robustezza, comunità, supporto e LLM supportati

Sia Perplexica che Farfalle utilizzavano il modello llama3 ospitato su ollama locale. Il nome completo del modello è llama3 8b q4.

Non credere al 100% a ciò che dicono le risposte, guarda semplicemente la lunghezza del testo, la struttura e la qualità complessiva della risposta.

Credo per circa il 70%…

Risposta di confronto di Perplexica

Confronto tra Farfalle e Perplexica

Robustezza

Farfalle: 8/10 - Farfalle è un motore di ricerca IA popolare noto per la sua affidabilità e capacità di gestire query complesse. Ha una solida base nell’elaborazione del linguaggio naturale (NLP) e nel machine learning (ML). Sebbene possa non essere perfetto, la robustezza di Farfalle è ben consolidata.

Perplexica: 9/10 - Perplexica è costruito sul modello Phi-3 di Meta AI, progettato per la robustezza. È stato testato per fornire risposte accurate anche di fronte a query ambigue o poco chiare. La sua capacità di riformulare le domande e adattarsi a diversi contesti lo rende un motore di ricerca robusto.

Comunità

Farfalle: 7/10 - Farfalle ha una comunità dedicata di utenti che apprezzano le sue capacità. Sebbene possa non avere lo stesso livello di adozione di Perplexica, la base utenti di Farfalle è comunque significativa.

Perplexica: 8.5/10 - Perplexica ha ottenuto un’ampia riconoscenza per il suo approccio innovativo ai motori di ricerca. La sua comunità sta crescendo rapidamente, con molti utenti che apprezzano la sua capacità di fornire risultati accurati e pertinenti.

Supporto

Farfalle: 6.5/10 - Farfalle fornisce un supporto di base tramite FAQ, documentazione e forum. Sebbene non sia così completo come il supporto di Perplexica, la base utenti di Farfalle è generalmente autosufficiente.

Perplexica: 9/10 - Perplexica offre estese risorse di supporto, inclusa documentazione dettagliata, FAQ e forum di comunità. I suoi sviluppatori sono attivamente impegnati con la comunità, garantendo che gli utenti ricevano assistenza tempestiva ed efficace.

LLM Supportati

Farfalle: No - Farfalle è un motore di ricerca IA standalone che non si basa su grandi modelli linguistici (LLM) per le sue capacità.

Perplexica: Sì - Perplexica è costruito sul modello Phi-3 di Meta AI, che è un LLM. Questo permette a Perplexica di sfruttare la potenza dell’apprendimento profondo per risultati più accurati e pertinenti.

Punteggio Complessivo Farfalle: 22/30 Perplexica: 34.5/40

In base a questi criteri, Perplexica sembra avere un leggero vantaggio su Farfalle in termini di robustezza, supporto della comunità e integrazione LLM. Tuttavia, entrambi i motori di ricerca hanno i loro punti di forza, e la scelta dipende infine dalle tue esigenze e preferenze specifiche.

Raccomandazione Se stai cercando un motore di ricerca IA affidabile con forti capacità NLP, Perplexica potrebbe essere la scelta migliore. Se preferisci un approccio di ricerca più diretto e senza fronzoli, Farfalle potrebbe comunque fornire ottimi risultati.

Risposta di confronto di Farfalle

Confronto tra Farfalle e Perplexica

Farfalle e Perplexica sono due motori di ricerca alimentati dall’IA che hanno attirato l’attenzione negli ultimi tempi. Ecco un confronto tra questi due progetti basato su robustezza, comunità, supporto e supporto LLM (Large Language Model).

Robustezza

- Farfalle è progettato per essere auto-ospitato con LLM locali o cloud, rendendolo un’opzione più robusta per gli utenti che desiderano il controllo sul proprio motore di ricerca.

- Perplexica, d’altra parte, è un’alternativa open source a Perplexity AI ed è in costante miglioramento da parte dei suoi sviluppatori.

Comunità

- Perplexica ha una comunità dedicata di sviluppatori e utenti che contribuiscono al suo sviluppo e forniscono supporto.

- La comunità di Farfalle è più piccola, ma ha comunque una presenza su GitHub.

Supporto

- Perplexica offre aggiornamenti e miglioramenti regolari, oltre a un canale Discord per discutere argomenti al di fuori del supporto regolare.

- Il supporto di Farfalle è limitato alle issue e alle pull request su GitHub.

Supporto LLM Sia Farfalle che Perplexica supportano LLM. Perplexica utilizza Ollama, un LLM locale, mentre Farfalle supporta sia LLM locali che cloud.

In sintesi, Farfalle è più robusto grazie al suo design auto-ospitato, mentre Perplexica ha una comunità più forte e un supporto migliore. Entrambi i progetti supportano LLM, ma Perplexica utilizza specificamente Ollama.

Conclusione

Qual è la differenza tra Perplexica e Farfalle?

La risposta:

- A prescindere da alcuni errori fattuali, entrambi i sistemi ritengono che Perplexica sia migliore di Farfalle, cosa con cui sono d’accordo.

- Mi piace molto l’interfaccia utente di Farfalle, anche se sono molto simili.

- Mi piace l’idea della modalità esperto di Farfalle, anche se non ha funzionato nel mio ambiente.

- Ho riscontrato 3 bug durante l’esecuzione di Farfalle. Il codice di Perplexica è più rifinito.

- Una volta configurato, Perplexica ha funzionato senza errori.

- Perplexica permette di utilizzare qualsiasi modello ospitato su Ollama. Farfalle permette di utilizzare solo Gemma, Llama3, Mistral e Phi3 (versioni predefinite, che sono un po’ datate).

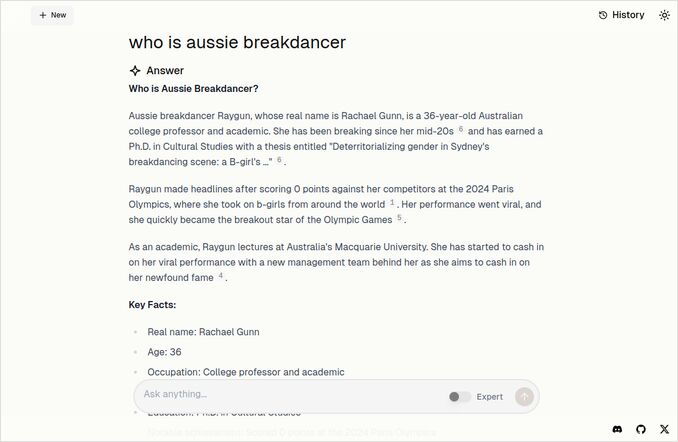

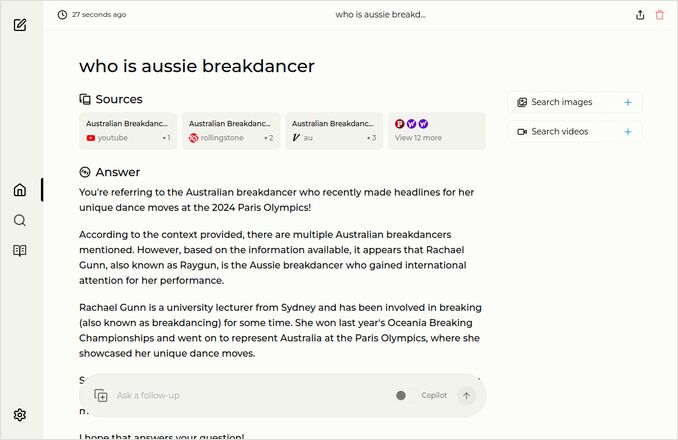

- Preferisco le risposte di Farfalle. Guarda l’immagine di Farfalle qui sotto. Diritto al punto, senza frasi come “Secondo il contesto fornito”…

Altri esempi

Questi mostrano le risposte alla stessa domanda sul ballerino di breakdance australiano. Sai, quello con il dottorato che ha ottenuto 0 (Zero) punti e probabilmente ha fatto rimuovere il breakdance dal programma olimpico.

Risposta di Farfalle

Risposta di Perplexica

Se leggi (su o giù) questo ultimo paragrafo, grazie per avere gli stessi interessi di me. È davvero un periodo emozionante. Buona giornata!

Link utili

- Search vs Deepsearch vs Deep Research

- Test: Come Ollama utilizza le CPU Intel e i Core Efficient

- Come Ollama gestisce le richieste parallele

- Auto-ospitare Perplexica - con Ollama

- Confronto delle capacità di sintesi degli LLM

- Scrittura di prompt efficaci per gli LLM

- Test del rilevamento delle fallacie logiche da parte dei nuovi LLM: gemma2, qwen2 e mistral Nemo

- Scheda di riferimento di Ollama

- Scheda di riferimento Markdown

- Fornitori di LLM Cloud

- Modelli di Embedding e Reranker Qwen3 su Ollama: Performance all’avanguardia