Hugoページ翻訳品質の比較 - Ollama上のLLM

Qwen3 8B、14Bおよび30B、Devstral 24B、Mistral Small 24B

このテストでは、Ollama上でホストされているさまざまなLLMがHugoページを英語からドイツ語に翻訳する方法を比較しています。英語からドイツ語への翻訳。

Qwen3 8B、14Bおよび30B、Devstral 24B、Mistral Small 24B

このテストでは、Ollama上でホストされているさまざまなLLMがHugoページを英語からドイツ語に翻訳する方法を比較しています。英語からドイツ語への翻訳。

RAG の実装ですね。Golang 用のコードスニペットをいくつか紹介します。

この小さな Reranking Go コード例は、クエリと各候補ドキュメントの埋め込みを生成するために Ollama を呼び出し、 その後、コサイン類似度で降順にソートします。

Ollama で利用可能な新しい素晴らしい LLM

Qwen3 埋め込みモデルとreranker モデル は、Qwen ファミリー最新リリースであり、高度なテキスト埋め込み、検索、再ランク付けタスクに特じて設計されています。

LLM用に2番目のGPUをインストールすることを考慮していますか?

PCIe レーンがLLM性能に与える影響? タスクによります。トレーニングやマルチGPUの推論では、パフォーマンスの低下が顕著です。

LLMでHTMLからテキストを抽出する...

Ollama モデルライブラリには、HTML コンテンツを Markdown に変換できるモデルが存在します。これはコンテンツ変換タスクに役立ちます。このガイドは、2026年のドキュメンテーションツール: Markdown、LaTeX、PDFおよび印刷ワークフロー ハブの一部です。

Cursor AI vs GitHub Copilot vs Cline AI vs...

ここに、AI 支援コーディングツールと AI コーディングアシスタント の良い点についていくつかリストアップします。

インテルCPUにおけるOllamaの効率的なコアとパフォーマンスコアの比較

私はある仮説をテストしたいと思っています。すなわち、「インテルCPUのすべてのコアを活用することで、LLMの速度が向上するか?」というものです。このテストについては、ALL cores on Intel CPU would raise the speed of LLMs?をご覧ください。

新しいgemma3 27bitモデル(gemma3:27b、ollama上では17GB)が私のGPUの16GB VRAMに収まらず、部分的にCPU上での実行に頼っているという点が気になります。

オラマを並列リクエストの実行に設定する。

Ollama サーバーが同時に2つのリクエストを受け取った場合、その動作は設定と利用可能なシステムリソースに依存します。

2つのdeepseek-r1モデルを2つのベースモデルと比較する

DeepSeekの 1世代目の推論モデルで、OpenAI-o1と同等の性能を備えています。 これは、LlamaおよびQwenに基づいてDeepSeek-R1から蒸留された6つの密結合モデルです。

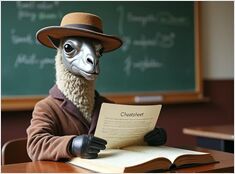

Ollama コマンドリストの更新 - ls、ps、run、serve など

この Ollama CLI チートシート は、毎日使用するコマンド(ollama ls、ollama serve、ollama run、ollama ps、モデル管理、一般的なワークフローなど)に焦点を当てており、コピー&ペーストできる例を備えています。

次のLLMテストラウンド

ほども前、リリースされました。最新の状況を確認し、Mistral Smallの他のLLMと比較したパフォーマンスをテストしてみましょう。

RAG のrerankingに関するPythonコード

2 つのセルフホスト型 AI 検索エンジンの比較

素晴らしい料理は目でも楽しむことができます。 しかし、この記事では、2 つの AI ベースの検索システム、Farfalle と Perplexica を比較します。

ローカルで Copilot 風サービスを実行?簡単です!

それはとても素晴らしいことです! Copilot や Perplexity.ai を呼び出して、世界中に何を求めているかを知られる代わりに、 今ではご自身の PC やラップトップで同様のサービスをホストできるようになりました!

論理的誤謬の検出のテスト

最近、いくつかの新しいLLMがリリースされました。

非常にエキサイティングな時代です。

論理的誤謬の検出能力を確認するためにテストしてみましょう。

いくつかの試行錯誤が必要ですが、

まだ、LLMがあなたの意図を理解しようとする際に混乱しないようにするための、良いプロンプトを書くためのいくつかの一般的なアプローチがあります。