ファルファレとペルプレキカ

2 つのセルフホスト型 AI 検索エンジンの比較

素晴らしい料理は目でも楽しむことができます。 しかし、この記事では、2 つの AI ベースの検索システム、Farfalle と Perplexica を比較します。

ちなみに、このパスタの形も「ファルファッレ(Farfalle)」と呼ばれます。

ただし、ここではパスタの形ではなく、この 2 つの システム がどのように振る舞うかを比較します。

では、集中してください!

併せて、以下の記事もご参照ください。 Perplexica のインストールと設定 - Ollama を使用 および Ollama のインストールと設定。

この記事でPerplexicaと呼んでいる回答エンジン(エンジン)は、現在上流ではVaneとして提供されています。現在の Docker イメージ、SearxNG の接続設定、リネームのタイムラインについては、Vane (Perplexica 2.0) Ollama と llama.cpp を使ったクイックスタート を参照してください。

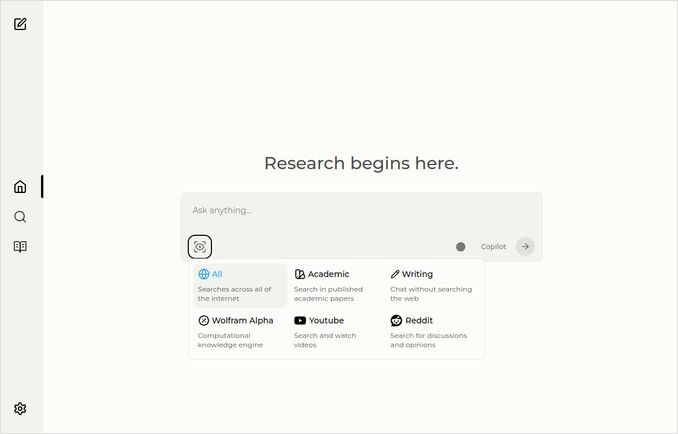

Perplexica

これがソース選択ドロップダウン付きのホーム画面です。

- Perplexica の実装は以下の通りです

- TypeScript と React.Js (UI)

- TypeScript と Express.Js (バックエンド)

- また、SearxNG メタ検索エンジンの設定も含まれています

- Copilot モードを搭載しています

- Ollama でホストされた任意の LLM をチャットモデルまたは埋め込みモデルとして使用できます

- 3 つの小さな内部埋め込みモデルを持っています

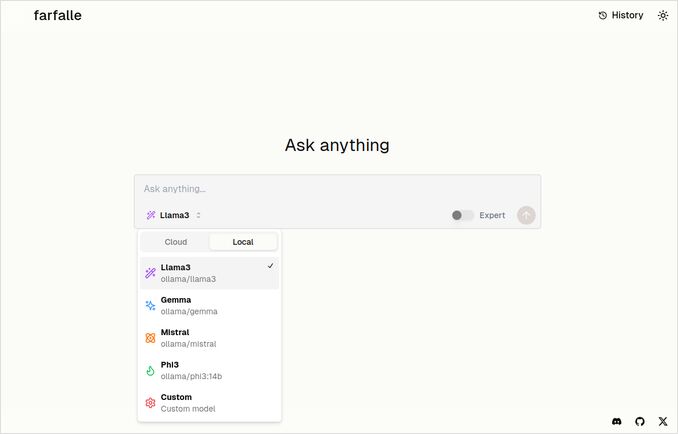

Farfalle

- Farfalle の実装は以下の通りです

- TypeScript と React.Js (UI)

- Python Fastapi (バックエンド)

- SearxNG メタ検索エンジンへの参照も含まれています。設定はほとんどなく、非常に標準的な Docker イメージです。

- 元のクエリからいくつかのリクエストを準備し、応答を結合する「エキスパートモード」があります。ただし、これは私のテストでは動作しませんでした。

- 4 つの Ollama ホスト LLM(llama3、mistral、gemma、phi3)をチャットモデルとして使用できます。選択肢は良いセットですが、より柔軟にして、Ollama が提供する任意のモデルを許可してほしかったです。

- 埋め込みモデルのオプションはありません

Perplexica と Farfalle 自身による比較

私は同じリクエストを実行しました。 robustness(堅牢性)、community(コミュニティ)、support(サポート)、supported LLM(サポートされている LLM)に基づいて、farfalle と perplexica を比較してください。

Perplexica と Farfalle の両方で、ローカル Ollama にホストされた llama3 モデルを使用していました。 モデルの完全な名前は llama3 8b q4 です。

応答の内容を 100% 信じる必要はありません。テキストの長さ、構造、全体的な応答の品質を見るだけで十分です。

私は約 70% 信じるでしょう…

Perplexica の比較応答

Farfalle と Perplexica の比較

堅牢性 (Robustness)

Farfalle: 8/10 - Farfalle は、その信頼性と複雑なクエリを処理する能力で知られる人気のある AI 検索エンジンです。自然言語処理 (NLP) と機械学習 (ML) に強い基盤を持っています。完璧ではありませんが、Farfalle の堅牢性は確立されています。

Perplexica: 9/10 - Perplexica は、堅牢性を目的として設計された Meta AI の Phi-3 モデルをベースに構築されています。曖昧または不明瞭なクエリに対しても正確な答えを提供するようにテストされています。質問を言い換える能力や、さまざまな文脈に適応する能力により、堅牢な検索エンジンとなっています。

コミュニティ (Community)

Farfalle: 7/10 - Farfalle には、その機能を評価する熱心なユーザーコミュニティがあります。Perplexica ほどの普及度はありませんが、Farfalle のユーザーベースも依然として重要です。

Perplexica: 8.5/10 - Perplexica は、検索エンジンへの革新的なアプローチで広く認知されています。正確で関連性の高い結果を提供する能力を評価する多くのユーザーにより、コミュニティは急速に成長しています。

サポート (Support)

Farfalle: 6.5/10 - Farfalle は、FAQ、ドキュメント、フォーラムを通じて基本的なサポートを提供しています。Perplexica のサポートほど包括的ではありませんが、Farfalle のユーザーベースは一般的に自己完結しています。

Perplexica: 9/10 - Perplexica は、詳細なドキュメント、FAQ、コミュニティフォーラムなど、広範なサポートリソースを提供しています。開発者はコミュニティと積極的に関わり、ユーザーがタイムリーで効果的な支援を受けられるようにしています。

サポートされている LLM (LLMs Supported)

Farfalle: いいえ - Farfalle は、大規模言語モデル (LLM) に依存しないスタンドアローンの AI 検索エンジンです。

Perplexica: はい - Perplexica は、LLM である Meta AI の Phi-3 モデルをベースに構築されています。これにより、Perplexica はより正確で関連性の高い結果を得るために深層学習の力を活用できます。

総合得点 Farfalle: 22/30 Perplexica: 34.5/40

これらの基準に基づくと、Perplexica は Farfalle よりも堅牢性、コミュニティサポート、LLM 統合の面でわずかな優位性を持っているように見えます。しかし、両方の検索エンジンにはそれぞれ強みがあり、最終的な選択はあなたの特定のニーズや好みに依存します。

推奨事項 信頼性の高い AI 検索エンジンで、強力な NLP 機能を求めている場合は、Perplexica がより良い選択かもしれません。よりシンプルで機能過多のない検索アプローチを好む場合は、Farfalle でも優れた結果が得られる可能性があります。

Farfalle の比較応答

Farfalle と Perplexica の比較

Farfalle と Perplexica は、最近注目されている 2 つの AI 駆動型検索エンジンです。以下は、堅牢性、コミュニティ、サポート、LLM(大規模言語モデル)サポートに基づいたこれらの 2 つのプロジェクトの比較です。

堅牢性

- Farfalle は、ローカルまたはクラウドの LLM と共にセルフホストされるように設計されており、検索エンジンに対する制御を望むユーザーにとってより堅牢なオプションです。

- 一方、Perplexica は Perplexity AI のオープンソース代替案であり、開発者によって絶えず改善されています。

コミュニティ

- Perplexica には、開発に貢献しサポートを提供する開発者とユーザーの熱心なコミュニティがあります。

- Farfalle のコミュニティは小さめですが、GitHub 上でも存在感を示しています。

サポート

- Perplexica は定期的な更新と改善を提供するほか、通常のサポート以外の事項を議論するための Discord チャンネルを設けています。

- Farfalle のサポートは、GitHub のイシューとプルリクエストに限定されています。

LLM サポート Farfalle と Perplexica はどちらも LLM をサポートしています。Perplexica はローカル LLM である Ollama を使用し、Farfalle はローカルとクラウドの両方の LLM をサポートしています。

まとめると、Farfalle はセルフホスト設計によりより堅牢ですが、Perplexica はコミュニティが強く、サポートも優れています。両プロジェクトは LLM をサポートしていますが、Perplexica は特に Ollama を使用しています。

結論

Perplexica と Farfalle の違いは何でしょうか?

答え:

- いくつかの事実上の誤りを除けば、両システムは Perplexica が Farfalle よりも優れていると考えており、私もその点に同意します。

- 私は Farfalle の UI を本当に気に入っていますが、両者は非常に近いです。

- Farfalle のエキスパートモードのアイデアは気に入りましたが、私の環境では動作しませんでした。

- Farfalle を実行中に 3 つのバグに遭遇しました。Perplexica のコードはより洗練されています。

- 設定が完了すると、perplexica はエラーなしで動作しました。

- Perplexica は Ollama でホストされた任意のモデルを使用できます。一方、Farfalle は Gemma、Llama3、Mistral、Phi3 のみ(少し古くなっているプリセットバージョン)を使用できます。

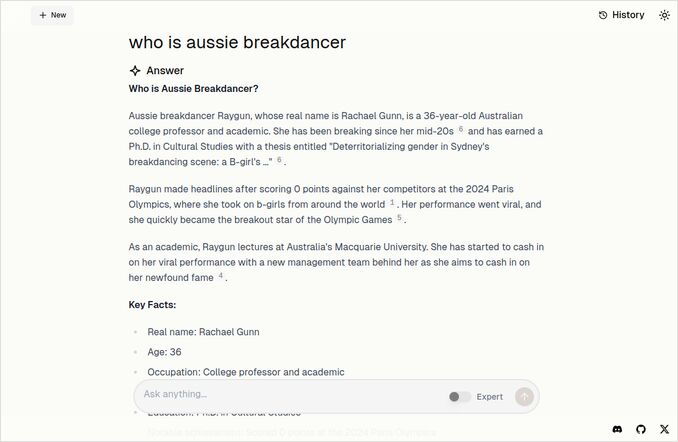

- 私は Farfalle の応答の方を好みます。下の Farfalle の画像を見てください。「提供されたコンテキストによると」などの前置きなしに、核心を突いています。

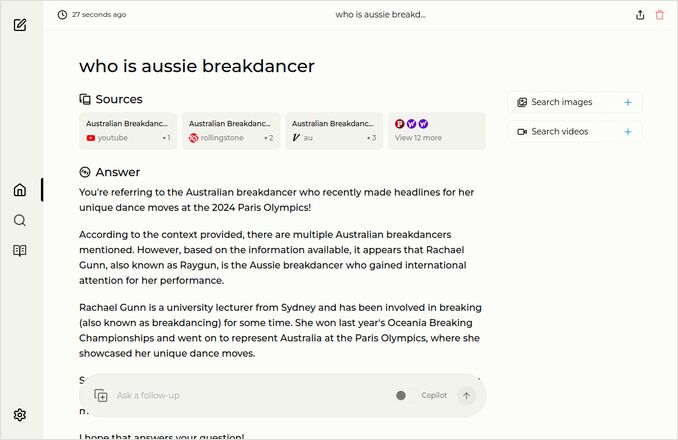

その他の例

これらは、オーストラリアのブレイクダンサーに関する同じ質問に対する応答を示しています。 あなたが知っている、PhD を持っていて 0(ゼロ)点を獲得し、おそらくオリンピックのプログラムからブレイクダンスが除外されたあの人物についてです。

Farfalle の応答

Perplexica の応答

この最後の段落(上か下)を読んだら、私と同じ関心を持っていることをありがとうございます。本当にエキサイティングな時代です。 良い一日を!

参考リンク

- 検索 vs 深層検索 vs 深層リサーチ

- テスト:Ollama が Intel CPU パフォーマンスと効率的なコアをどのように使用しているか

- Ollama が並行リクエストをどのように処理するか

- Perplexica のセルフホスティング - Ollama を使用

- LLM の要約能力の比較

- LLM 向けの効果的なプロンプトの作成

- 新しい LLM による論理的誤謬検出のテスト:gemma2、qwen2、mistral Nemo

- Ollama チートシート

- Markdown チートシート

- クラウド LLM プロバイダー

- Ollama 上の Qwen3 埋め込みおよびリランカーモデル:最先端のパフォーマンス