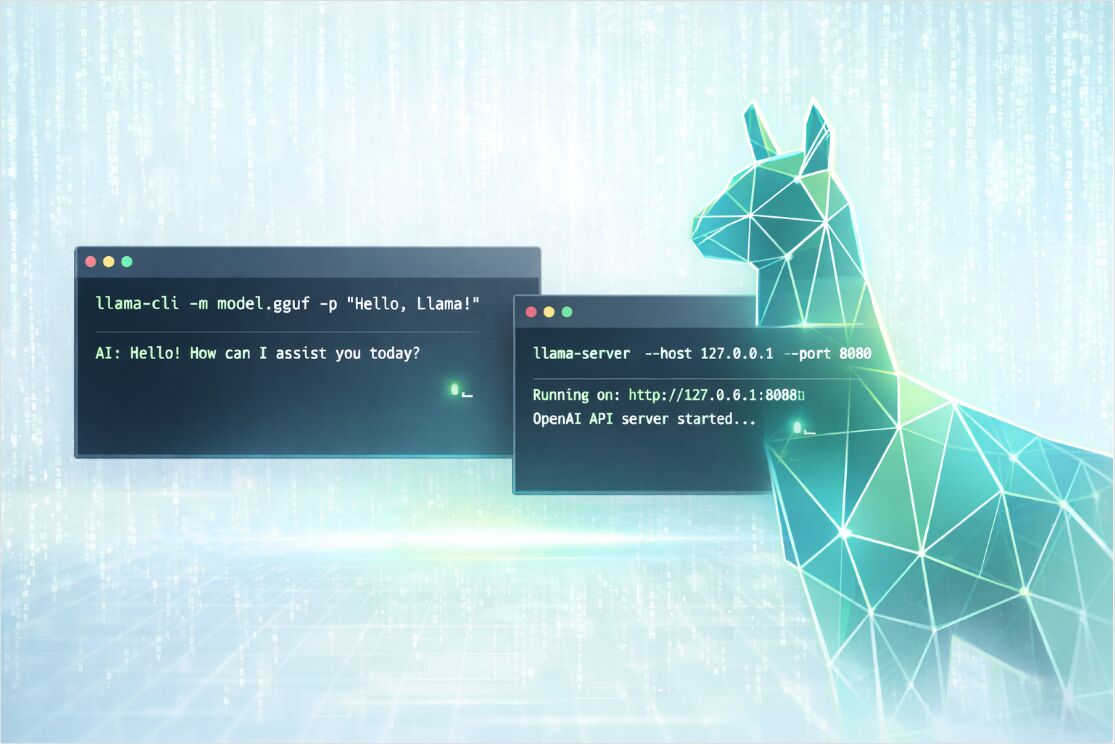

Introduzione a llama.cpp con CLI e Server

Come installare, configurare e utilizzare OpenCode

Torno sempre su llama.cpp per l’inferenza locale: ti offre un controllo che Ollama e altri astraggono, e semplicemente funziona. È facile eseguire modelli GGUF in modo interattivo con llama-cli o esporre un’API HTTP compatibile con OpenAI con llama-server.

Se stai ancora decidendo tra approcci locali, self-hosted e cloud, inizia con la guida principale LLM Hosting nel 2026: Infrastruttura Locale, Self-Hosted e Cloud Confrontata.

Perché llama.cpp nel 2026

llama.cpp è un motore di inferenza leggero con una propensione per:

- portabilità tra CPU e diversi backend GPU,

- latenza prevedibile su una singola macchina,

- flessibilità di deployment, dai laptop ai nodi on-premise.

Brilla quando desideri privacy e funzionamento offline, quando hai bisogno di controllo deterministico sui flag di runtime, o quando vuoi incorporare l’inferenza in un sistema più ampio senza eseguire uno stack pesante basato su Python.

È anche utile comprendere llama.cpp anche se in seguito scegli un runtime server con throughput più elevato. Ad esempio, se il tuo obiettivo è il massimo throughput di servizio sulle GPU, potresti volerlo confrontare con vLLM utilizzando:

vLLM Quickstart: Serving LLM ad Alte Prestazioni

e puoi benchmarkare le scelte degli strumenti in:

Ollama vs vLLM vs LM Studio: Il Modo Migliore per Eseguire LLM Localmente nel 2026?.

Installazione di llama.cpp su Windows, macOS e Linux

Ci sono tre percorsi pratici di installazione, a seconda che tu voglia comodità, portabilità o massime prestazioni.

Installazione tramite gestori di pacchetti

Questa è l’opzione più veloce per “farlo funzionare”.

# macOS o Linux

brew install llama.cpp

# Windows

winget install llama.cpp

# macOS (MacPorts)

sudo port install llama.cpp

# macOS o Linux (Nix)

nix profile install nixpkgs#llama-cpp

Consiglio: dopo l’installazione, verifica che gli strumenti esistano:

llama-cli --version

llama-server --version

Installazione tramite binari precompilati

Se desideri un’installazione pulita senza compilatori, utilizza i binari precompilati ufficiali pubblicati nelle release di GitHub di llama.cpp. Coprono tipicamente più target OS e più backend (varianti solo CPU e abilitate GPU).

Un flusso di lavoro comune:

# 1) Scarica l'archivio giusto per il tuo OS e backend

# 2) Estrailo

# 3) Esegui dalla cartella estratta

./llama-cli --help

./llama-server --help

Compilazione dai sorgenti per il tuo hardware esatto

Se tieni a spremere le migliori prestazioni dal tuo backend CPU/GPU, compila dai sorgenti con CMake.

git clone https://github.com/ggml-org/llama.cpp

cd llama.cpp

# Build CPU

cmake -B build

cmake --build build --config Release

Dopo la compilazione, i binari si trovano tipicamente qui:

ls -la ./build/bin/

Build GPU in un singolo comando

Abilita il backend che corrisponde al tuo hardware (esempi mostrati per CUDA e Vulkan):

# NVIDIA CUDA

cmake -B build -DGGML_CUDA=ON

cmake --build build --config Release

# Vulkan

cmake -B build -DGGML_VULKAN=ON

cmake --build build --config Release

Ubuntu 24.04 + GPU NVIDIA: guida completa alla compilazione

Su Ubuntu 24.04 con una GPU NVIDIA, hai bisogno del toolkit CUDA e di OpenSSL prima di compilare. Ecco una sequenza testata:

1. Installa il toolkit CUDA 13.1

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2404/x86_64/cuda-ubuntu2404.pin

sudo mv cuda-ubuntu2404.pin /etc/apt/preferences.d/cuda-repository-pin-600

wget https://developer.download.nvidia.com/compute/cuda/13.1.1/local_installers/cuda-repo-ubuntu2404-13-1-local_13.1.1-590.48.01-1_amd64.deb

sudo dpkg -i cuda-repo-ubuntu2404-13-1-local_13.1.1-590.48.01-1_amd64.deb

sudo cp /var/cuda-repo-ubuntu2404-13-1-local/cuda-*-keyring.gpg /usr/share/keyrings/

sudo apt-get update

sudo apt-get -y install cuda-toolkit-13-1

2. Aggiungi CUDA al tuo ambiente (aggiungi a ~/.bashrc):

# cuda toolkit

export PATH=/usr/local/cuda-13.1/bin:$PATH

export LD_LIBRARY_PATH=/usr/local/cuda-13.1/lib64:$LD_LIBRARY_PATH

Poi esegui source ~/.bashrc o apri un nuovo terminale.

3. Installa le intestazioni di sviluppo di OpenSSL (necessarie per una compilazione pulita):

sudo apt update

sudo apt install libssl-dev

4. Compila llama.cpp (dalla directory contenente il clone di llama.cpp, con CUDA abilitato):

cmake llama.cpp -B llama.cpp/build -DBUILD_SHARED_LIBS=OFF -DGGML_CUDA=ON

cmake --build llama.cpp/build --config Release -j --clean-first --target llama-cli llama-mtmd-cli llama-server llama-gguf-split llama-embedding

cp llama.cpp/build/bin/llama-* llama.cpp

Questo produce llama-cli, llama-mtmd-cli, llama-server, llama-embedding e llama-gguf-split nella directory llama.cpp.

Puoi anche compilare più backend e scegliere i dispositivi al runtime. Questo è utile se distribuisci la stessa build su macchine eterogenee.

Scegli un modello GGUF e una quantizzazione

Per eseguire l’inferenza, hai bisogno di un file di modello GGUF (*.gguf). GGUF è un formato a file singolo che raggruppa i pesi del modello insieme ai metadati standardizzati necessari da motori come llama.cpp.

Due modi per ottenere un modello

Opzione A: Usa un file GGUF locale

Scarica o copia un GGUF in ./models/:

mkdir -p models

# Posiziona il tuo GGUF in models/my-model.gguf

Poi eseguilo per percorso:

llama-cli -m models/my-model.gguf -p "Ciao! Spiega cosa è llama.cpp." -n 128

Opzione B: Lascia che llama.cpp scarichi da Hugging Face

Le build moderne di llama.cpp possono scaricare da Hugging Face e mantenere i file in una cache locale. Questo è spesso il flusso di lavoro più semplice per esperimenti rapidi.

# Scarica un modello da HF ed esegui un prompt

llama-cli \

--hf-repo ggml-org/tiny-llamas \

--hf-file stories15M-q4_0.gguf \

-p "C'era una volta," \

-n 200

Puoi anche specificare la quantizzazione nel selettore del repo e lasciare che lo strumento selezioni un file corrispondente:

llama-cli \

--hf-repo unsloth/phi-4-GGUF:q4_k_m \

-p "Riassumi il concetto di quantizzazione in un paragrafo." \

-n 160

Se hai bisogno di un flusso di lavoro completamente offline in seguito, --offline forza l’uso della cache e impedisce l’accesso alla rete.

Scelta della quantizzazione per l’inferenza locale

La quantizzazione è la risposta pratica alla domanda “Quale quantizzazione GGUF dovresti scegliere per l’inferenza locale” perché scambia direttamente qualità, dimensione del modello e velocità.

Un punto di partenza pragmatico:

- inizia con una variante Q4 o Q5 per macchine prima su CPU,

- passa a una precisione più alta (o una quantizzazione meno aggressiva) quando puoi permetterti la RAM o la VRAM,

- quando il modello “sembra stupido” per il tuo compito, la soluzione è spesso un modello migliore o una quantizzazione meno aggressiva, non solo regolazioni del campionamento.

Ricorda anche che la finestra di contesto è importante: dimensioni del contesto più grandi aumentano l’uso della memoria (a volte drasticamente), anche quando il file GGUF stesso si adatta.

Quickstart di llama-cli e parametri chiave

llama-cli è il modo più veloce per convalidare che il tuo modello si carica, il tuo backend funziona e i tuoi prompt si comportano come previsto.

Esecuzione minima

llama-cli \

-m models/my-model.gguf \

-p "Scrivi un breve confronto tra TCP e UDP." \

-n 200

Esecuzione interattiva di chat

La modalità conversazione è progettata per i template di chat. Abilita tipicamente il comportamento interattivo e formatta i prompt secondo il template del modello.

llama-cli \

-m models/my-model.gguf \

--conversation \

--system-prompt "Sei un assistente di ingegneria dei sistemi conciso." \

--ctx-size 4096

Per terminare la generazione quando il modello stampa una sequenza specifica, usa un prompt inverso (reverse prompt). Questo è particolarmente utile in modalità interattiva.

I principali flag di llama-cli che contano

Piuttosto che memorizzare 200 flag, concentrati su quelli che dominano correttezza, latenza e memoria.

Modello e download

| Obiettivo | Flag | Quando usarli |

|---|---|---|

| Carica un file locale | -m, --model |

Hai già *.gguf |

| Scarica da Hugging Face | --hf-repo, --hf-file, --hf-token |

Esperimenti rapidi, caching automatizzato |

| Forza cache offline | --offline |

Esecuzioni air-gapped o riproducibili |

Contesto e throughput

| Obiettivo | Flag | Nota pratica |

|---|---|---|

| Aumenta o riduci il contesto | -c, --ctx-size |

Contesti più grandi costano più RAM o VRAM |

| Migliora l’elaborazione del prompt | -b, --batch-size e -ub, --ubatch-size |

Le dimensioni del batch influenzano velocità e memoria |

| Regola la parallelizzazione CPU | -t, --threads e -tb, --threads-batch |

Adatta ai core della tua CPU e alla larghezza di banda della memoria |

Offload GPU e selezione hardware

| Obiettivo | Flag | Nota pratica |

|---|---|---|

| Elenca i dispositivi disponibili | --list-devices |

Utile quando sono compilati più backend |

| Scegli i dispositivi | --device |

Abilita scelte ibride CPU e GPU |

| Offload dei layer | -ngl, --n-gpu-layers |

Uno dei più grandi levieri di velocità |

| Logica Multi-GPU | --split-mode, --tensor-split, --main-gpu |

Utile per host multi-GPU o VRAM disomogenea |

Campionamento e qualità dell’output

| Obiettivo | Flag | Buoni valori predefiniti per iniziare |

|---|---|---|

| Creatività | --temp |

0.2 a 0.9 a seconda del compito |

| Campionamento nucleare | --top-p |

0.9 a 0.98 comune |

| Cutoff token | --top-k |

40 è una baseline classica |

| Riduci la ripetizione | --repeat-penalty e --repeat-last-n |

Particolarmente utile per modelli piccoli |

Carichi di lavoro di esempio con llama-cli

Riassumi un file, non solo un prompt

llama-cli \

-m models/my-model.gguf \

--system-prompt "Riassumi documenti tecnici. Output massimo cinque punti elenco." \

--file ./docs/incident-report.txt \

-n 300

Rendi i risultati più riproducibili

Quando stai debuggando i prompt, fissa il seed e riduci la casualità:

llama-cli \

-m models/my-model.gguf \

-p "Estrai i rischi chiave da questa nota di design." \

-n 200 \

--seed 42 \

--temp 0.2

Quickstart di llama-server con API compatibile OpenAI

llama-server è un server HTTP integrato che può esporre:

- endpoint compatibili con OpenAI per chat, completamenti, embedding e risposte,

- un’interfaccia Web UI per test interattivi,

- endpoint di monitoraggio opzionali per visibilità in produzione.

Avvia un server con un modello locale

llama-server \

-m models/my-model.gguf \

-c 4096

Di default, ascolta su 127.0.0.1:8080.

Per bindare esternamente (ad esempio all’interno di Docker o in una LAN), specifica host e porta:

llama-server \

-m models/my-model.gguf \

-c 4096 \

--host 0.0.0.0 \

--port 8080

Flag del server opzionali ma importanti

| Obiettivo | Flag | Perché è importante |

|---|---|---|

| Concorrenza | --parallel |

Controlla gli slot del server per richieste parallele |

| Miglior throughput sotto carico | --cont-batching |

Abilita il batching continuo |

| Blocca l’accesso | --api-key o --api-key-file |

Autenticazione per le richieste API |

| Abilita metriche Prometheus | --metrics |

Necessario per esporre /metrics |

| Riduci il rischio di rielaborazione dei prompt | --cache-prompt |

Comportamento della cache dei prompt per la latenza |

Se esegui in container, molte impostazioni possono anche essere controllate attraverso le variabili d’ambiente LLAMA_ARG_*.

Esempi di chiamate API

Completamenti chat con curl

curl http://localhost:8080/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"model": "gpt-3.5-turbo",

"messages": [

{ "role": "system", "content": "Sei un assistente utile." },

{ "role": "user", "content": "Dammi una rapida checklist per llama.cpp." }

],

"temperature": 0.7

}'

Consiglio per deployment reali: se imposti --api-key, puoi inviarlo tramite un header x-api-key (o continuare a usare gli header Authorization a seconda del tuo gateway).

Client Python OpenAI mirato a llama-server

Con un server compatibile OpenAI, molti client possono funzionare cambiando solo base_url.

import openai

client = openai.OpenAI(

base_url="http://localhost:8080/v1",

api_key="sk-no-key-required",

)

resp = client.chat.completions.create(

model="gpt-3.5-turbo",

messages=[

{"role": "system", "content": "Sei un assistente conciso."},

{"role": "user", "content": "Spiega threads vs batch size in llama.cpp."},

],

)

print(resp.choices[0].message.content)

Embedding

Gli embedding compatibili con OpenAI sono esposti su /v1/embeddings, ma il modello deve supportare una modalità di pooling degli embedding che non sia none.

curl http://localhost:8080/v1/embeddings \

-H "Content-Type: application/json" \

-H "Authorization: Bearer no-key" \

-d '{

"input": ["ciao", "mondo"],

"model": "GPT-4",

"encoding_format": "float"

}'

Se esegui un modello di embedding dedicato, considera di avviare il server in modalità solo embedding:

llama-server \

-m models/Qwen3-Embedding-0.6B-Q8_0.gguf \

--embeddings \

--host 127.0.0.1 \

--pooling last \

--port 8080

o se vuoi eseguire llama-cpp con un modello di embedding su CPU:

CUDA_VISIBLE_DEVICES="" llama-server \

-m models/Qwen3-Embedding-0.6B-Q8_0.gguf \

--embeddings \

--host 127.0.0.1 \

--pooling last \

--port 8080

provalo così:

CUDA_VISIBLE_DEVICES="" llama-embedding \

-m /path/to/Qwen3-Embedding-0.6B-Q8_0.gguf \

-p "il tuo testo qui" \

--pooling last \

--verbose-prompt

Servizio di più modelli da un singolo processo

Gli esempi sopra legano llama-server a un singolo modello all’avvio. Se hai bisogno di passare tra modelli su base per richiesta — senza riavviare il processo — è per questo che esiste la modalità router. Vedi

Modalità router di llama-server: commutazione dinamica dei modelli senza riavvii.

Per un flusso scriptabile di scaricamento di tutti i modelli che libera la VRAM senza riavviare il router, vedi Scarica Tutti i Modelli Router di llama.cpp Senza Riavviare.

Prestazioni, monitoraggio e indurimento per la produzione

La domanda FAQ “Quali opzioni della riga di comando di llama.cpp contano di più per velocità e memoria” diventa molto più facile quando trattate l’inferenza come un sistema:

- Il limite di memoria è solitamente il primo vincolo (RAM sulla CPU, VRAM sulla GPU).

- La dimensione del contesto è un moltiplicatore di memoria significativo.

- L’offload dei layer GPU è spesso il percorso più veloce per ottenere più token al secondo.

- Dimensioni del batch e thread possono migliorare il throughput ma possono anche aumentare la pressione sulla memoria.

Per una visione più profonda, orientata all’ingegneria, vedi: Prestazioni LLM nel 2026: Benchmark, Colli di Bottiglia & Ottimizzazione.

Se vuoi risultati misurabili in stile llama-cli su una GPU della classe 16 GB—token al secondo, VRAM e carico GPU mentre si variano i contesti (19K / 32K / 64K) su GGUF densi e MoE—vedi Benchmark LLM VRAM 16 GB con llama.cpp (velocità e contesto).

Specificamente per Qwen 3.6, llama.cpp ora supporta la decodifica speculativa Multi-Token Prediction (MTP) integrata che può aumentare significativamente il throughput di generazione. Vedi Qwen 3.6 27B e 35B MTP vs Standard su GPU 16GB per velocità di generazione misurate, sovraccarico VRAM e valori consigliati per --spec-draft-n-max.

Monitoraggio di llama-server con Prometheus e Grafana

llama-server può esporre metriche compatibili con Prometheus su /metrics quando --metrics è abilitato. Questo si abbina naturalmente con le config di scraping Prometheus e dashboard Grafana.

Per dashboard e alert specifici per llama.cpp (e vLLM, TGI): Monitorare l’Inferenza LLM in Produzione (2026): Prometheus & Grafana per vLLM, TGI, llama.cpp. Guide più ampie: Osservabilità: Guida al Monitoraggio, Metriche, Prometheus & Grafana e Osservabilità per Sistemi LLM.

Checklist base di indurimento

Quando il tuo llama-server è raggiungibile oltre localhost:

- usa

--api-key(o--api-key-file) in modo che le richieste siano autenticate, - evita di bindare su

0.0.0.0a meno che tu non ne abbia bisogno, - considera TLS tramite i flag SSL del server o termina TLS su un proxy inverso,

- limita la concorrenza con

--parallelper proteggere la latenza sotto carico.

Soluzioni rapide per la risoluzione dei problemi

Il modello si carica ma le risposte sono strane in chat

Gli endpoint chat funzionano meglio quando il modello ha un template di chat supportato. Se gli output sembrano non strutturati, prova:

- usare

llama-cli --conversationpiù un--system-promptesplicito, - verificare che il tuo modello sia una variante istruzione o chat-tuned,

- testare usando la Web UI del server prima di collegarla a un’applicazione.

Hai esaurito la memoria

Riduci il contesto o scegli una quantizzazione più piccola:

- abbassa

--ctx-size, - riduci

--n-gpu-layersse la VRAM è il problema, - passa a un modello più piccolo o a una quantizzazione più compressa.

È lento su CPU

Inizia con:

--threadsuguale ai tuoi core fisici,- dimensioni del batch moderate,

- valida che hai installato una build che corrisponde alla tua macchina (caratteristiche CPU e backend).