Farfalle kontra Perplexica

Porównanie dwóch samodzielnie hostowanych silników wyszukiwania AI

Wspaniałe jedzenie to również przyjemność dla oczu. Ale w tym poście porównamy dwa systemy wyszukiwania oparte na AI: Farfalle i Perplexica.

Pozostało, że kształt makaronu nazywa się również “farfalle”.

Ale tutaj porównuję tylko zachowanie tych dwóch systemów. Nie kształtów makaronu.

OK. Skupcie się!

Proszę również zobaczyc Instalacja i konfiguracja Perplexica - z ollama oraz Instalacja i konfiguracja Ollama.

Silnik odpowiadania, który ten artykuł oznacza jako Perplexica, jest teraz dostępny upstream jako Vane; Vane (Perplexica 2.0) Quickstart With Ollama and llama.cpp to miejsce, gdzie należy szukać aktualnych obrazów Docker, konfiguracji SearxNG oraz harmonogramu zmiany nazwy.

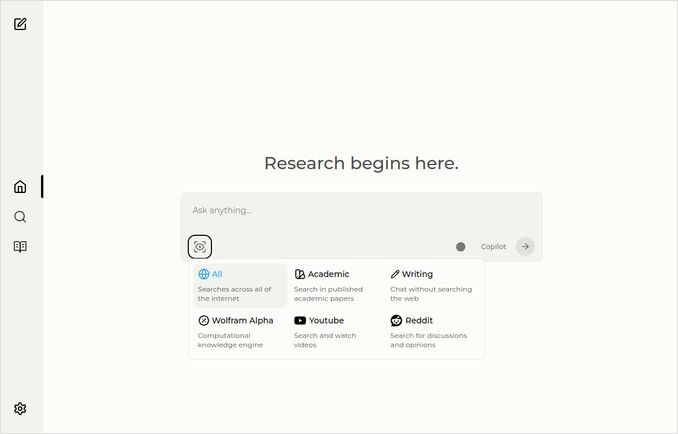

Perplexica

Oto strona główna z rozwijaną listą wyboru źródeł.

- Perplexica jest zaimplementowany w

- TypeScript i React.Js (UI)

- TypeScript i Express.Js (Backend)

- zawiera również konfigurację dla metawyszczarki SearxNG

- Posiada tryb Copilot

- Ma możliwość użycia dowolnego modelu LLM hostowanego przez Ollama jako modelu czatu lub osadzania (embedding)

- Posiada trzy małe wewnętrzne modele osadzania

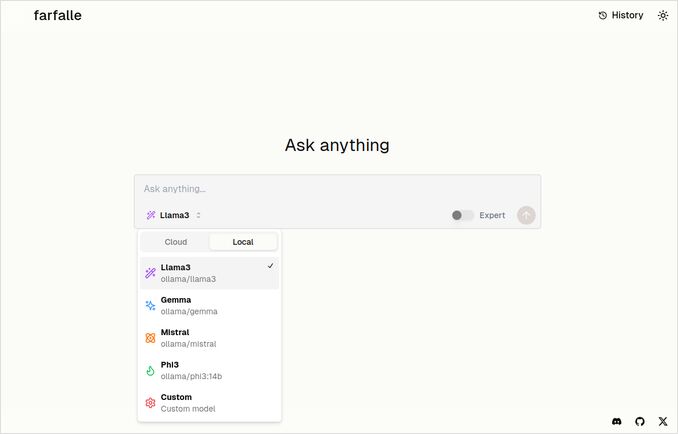

Farfalle

- Farfalle jest zaimplementowany w

- TypeScript i React.Js (UI)

- Python Fastapi (Backend)

- zawiera również odniesienie do metawyszczarki SearxNG. Brak dużej konfiguracji dla tego, dość standardowy obraz docker.

- Posiada tryb Eksperta, który powinien przygotować kilka zapytań na podstawie oryginału i połączyć odpowiedzi. Ale to nie działało w naszych testach.

- Ma możliwość użycia czterech modeli LLM hostowanych przez Ollama jako modelu czatu (llama3, mistral, gemma, phi3). To dobra zestaw opcji, ale wolałbym, aby było to bardziej elastyczne i pozwalało na używanie dowolnego modelu serwowanego przez Ollama.

- Brak opcji dla modelu osadzania

Porównanie wykonane przez Perplexica i Farfalle

Wysłałem to samo zapytanie Porównaj farfalle i perplexica pod kątem solidności, społeczności, wsparcia i obsługiwanych LLM

Zarówno Perplexica, jak i Farfalle używały modelu llama3 hostowanego lokalnie na ollama. Pełna nazwa modelu to llama3 8b q4.

Nie wierzcie w 100% temu, co mówią odpowiedzi, po prostu obejrzyjcie długość tekstu, strukturę i ogólną jakość odpowiedzi.

Wierzyłbym w około 70%…

Odpowiedź z porównania Perplexica

Porównanie Farfalle i Perplexica

Solidność

Farfalle: 8/10 - Farfalle to popularna wyszukiwarka AI znana ze swojej niezawodności i zdolności do obsługi złożonych zapytań. Ma solidne podstawy w przetwarzaniu języka naturalnego (NLP) i uczeniu maszynowym (ML). Choć może nie być idealna, solidność Farfalle jest dobrze ugruntowana.

Perplexica: 9/10 - Perplexica jest zbudowana na modelu Phi-3 firmy Meta AI, który został zaprojektowany z myślą o solidności. Została przetestowana pod kątem dostarczania dokładnych odpowiedzi, nawet przy napotkaniu niejednoznacznych lub niejasnych zapytań. Jej zdolność do przeformułowywania pytań i dostosowywania się do różnych kontekstów czyni ją solidną wyszukiwarką.

Społeczność

Farfalle: 7/10 - Farfalle ma dedykowaną społeczność użytkowników, którzy doceniają jej możliwości. Choć może nie mieć tak wysokiego poziomu adopcji jak Perplexica, baza użytkowników Farfalle jest nadal znacząca.

Perplexica: 8.5/10 - Perplexica zyskała szerokie uznanie za swoje innowacyjne podejście do wyszukiwarek. Jej społeczność rośnie szybko, a wielu użytkowników docenia jej zdolność do dostarczania dokładnych i trafnych wyników.

Wsparcie

Farfalle: 6.5/10 - Farfalle zapewnia podstawowe wsparcie poprzez FAQ, dokumentację i fora. Choć nie jest tak wszechstronne jak wsparcie Perplexica, baza użytkowników Farfalle jest generalnie samowystarczalna.

Perplexica: 9/10 - Perplexica oferuje rozległe zasoby wsparcia, w tym szczegółową dokumentację, FAQ i fora społecznościowe. Jej deweloperzy są aktywnie zaangażowani ze społecznością, zapewniając użytkownikom terminową i skuteczną pomoc.

Obsługiwane LLM

Farfalle: Nie - Farfalle to samodzielna wyszukiwarka AI, która nie polega na dużych modelach językowych (LLM) dla swoich możliwości.

Perplexica: Tak - Perplexica jest zbudowana na modelu Phi-3 firmy Meta AI, który jest modelem LLM. Pozwala to Perplexica wykorzystać moc głębokiego uczenia dla bardziej dokładnych i trafnych wyników.

Ogólna punktacja Farfalle: 22/30 Perplexica: 34.5/40

Na podstawie tych kryteriów Perplexica wydaje się mieć lekką przewagę nad Farfalle pod względem solidności, wsparcia społeczności i integracji LLM. Jednak obie wyszukiwarki mają swoje mocne strony, a wybór ostatecznie zależy od Twoich konkretnych potrzeb i preferencji.

Zalecenie Jeśli szukasz niezawodnej wyszukiwarki AI z silnymi możliwościami NLP, Perplexica może być lepszym wyborem. Jeśli wolisz bardziej bezpośrednie, bez zbędnych frills podejście do wyszukiwania, Farfalle nadal może dostarczyć doskonałe wyniki.

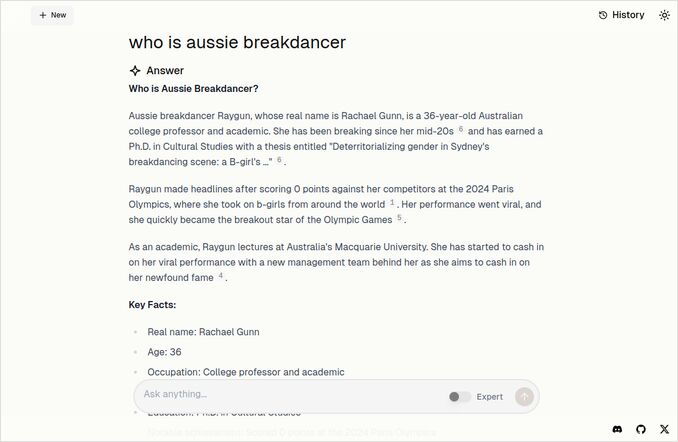

Odpowiedź z porównania Farfalle

Porównanie Farfalle i Perplexica

Farfalle i Perplexica to dwie wyszukiwarki zasilane AI, które zyskały ostatnio popularność. Oto porównanie tych dwóch projektów pod kątem solidności, społeczności, wsparcia i obsługi LLM (Large Language Model).

Solidność

- Farfalle został zaprojektowany jako samodzielnie hostowany z lokalnymi lub chmurowymi LLM, co czyni go bardziej solidną opcją dla użytkowników, którzy chcą mieć kontrolę nad swoją wyszukiwarką.

- Perplexica z kolei jest open-source alternatywą dla Perplexity AI i jest stale ulepszana przez jej deweloperów.

Społeczność

- Perplexica ma dedykowaną społeczność deweloperów i użytkowników, którzy przyczyniają się do jej rozwoju i zapewniają wsparcie

- Społeczność Farfalle jest mniejsza, ale nadal ma swoją obecność na GitHub

Wsparcie

- Perplexica oferuje regularne aktualizacje i ulepszenia, a także kanał Discord do dyskusji poza regularnym wsparciem

- Wsparcie Farfalle jest ograniczone do zgłoszeń issues i pull requests na GitHub

Obsługa LLM Zarówno Farfalle, jak i Perplexica obsługują LLM. Perplexica używa Ollama, lokalnego LLM, podczas gdy Farfalle obsługuje zarówno lokalne, jak i chmurowe LLM.

Podsumowując, Farfalle jest bardziej solidny ze względu na swój samodzielnie hostowany design, podczas gdy Perplexica ma silniejszą społeczność i lepsze wsparcie. Oba projekty obsługują LLM, ale Perplexica używa konkretnie Ollama.

Wniosek

Jaka jest różnica między Perplexica a Farfalle?

Odpowiedź:

- Pominijmy niektóre błędy faktyczne, oba systemy uważają, że Perplexica jest lepsza niż Farfalle, z czym chciałbym się zgodzić.

- Bardzo mi się podoba interfejs Farfalle, choć są one dość blisko siebie

- Podoba mi się pomysł trybu eksperta Farfalle, choć nie działał on w moim środowisku

- Napotkałem 3 błędy podczas uruchamiania Farfalle. Kod Perplexica jest bardziej dopracowany

- Po skonfigurowaniu, Perplexica działała bez żadnych błędów

- Perplexica pozwala na używanie dowolnego modelu hostowanego przez Ollama. A Farfalle pozwala na używanie tylko Gemma, Llama3, Mistral i Phi3 (wstępnie zdefiniowane wersje, które są nieco przestarzałe).

- Wolę odpowiedzi Farfalle. Spójrz na obraz Farfalle poniżej. Prosto z mostu bez tych “Zgodnie z dostarczonym kontekstem…”

Więcej przykładów

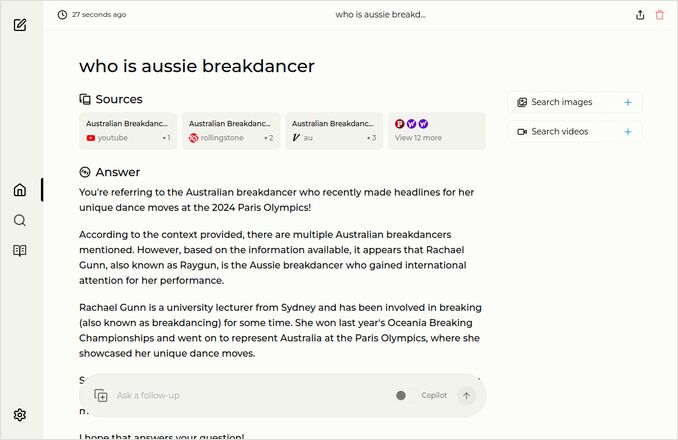

Te pokazują odpowiedzi na to samo pytanie o australijskiego breakdancera. Wiesz, o tym z doktoratem, który dostał 0 (Zero) punktów i prawdopodobnie doprowadził do usunięcia breakdance z programu olimpijskiego.

Odpowiedź Farfalle

Odpowiedź Perplexica

Jeśli przeczytasz wyżej (lub niżej) do tego ostatniego akapitu, dziękuję za posiadanie tych samych zainteresowań co ja. To naprawdę ekscytujące czasy. Miłego dnia!

Przydatne linki

- Wyszukiwanie vs Deepsearch vs Deep Research

- Test: Jak Ollama wykorzystuje wydajność procesora Intel i rdzenie wydajnościowe

- Jak Ollama obsługuje równoległe żądania

- Samodzielne hostowanie Perplexica - z Ollama

- Porównanie możliwości podsumowywania LLM

- Pisanie skutecznych promptów dla LLM

- Testowanie wykrywania błędów logicznych przez nowe LLM: gemma2, qwen2 i mistral Nemo

- Ollama cheatsheet

- Markdown Cheatsheet

- Dostawcy chmurowych LLM

- Modele Embedding & Reranker Qwen3 na Ollama: State-of-the-Art Performance