Szybki start z OpenClaw: Instalacja z Docker (Ollama GPU lub Claude + CPU)

Zainstaluj OpenClaw lokalnie z Ollama

OpenClaw to samoservisyjny asystent AI zaprojektowany do działania z lokalnymi środowiskami wykonawczymi LLM, takimi jak Ollama, lub z modelami opartymi na chmurze, takimi jak Claude Sonnet.

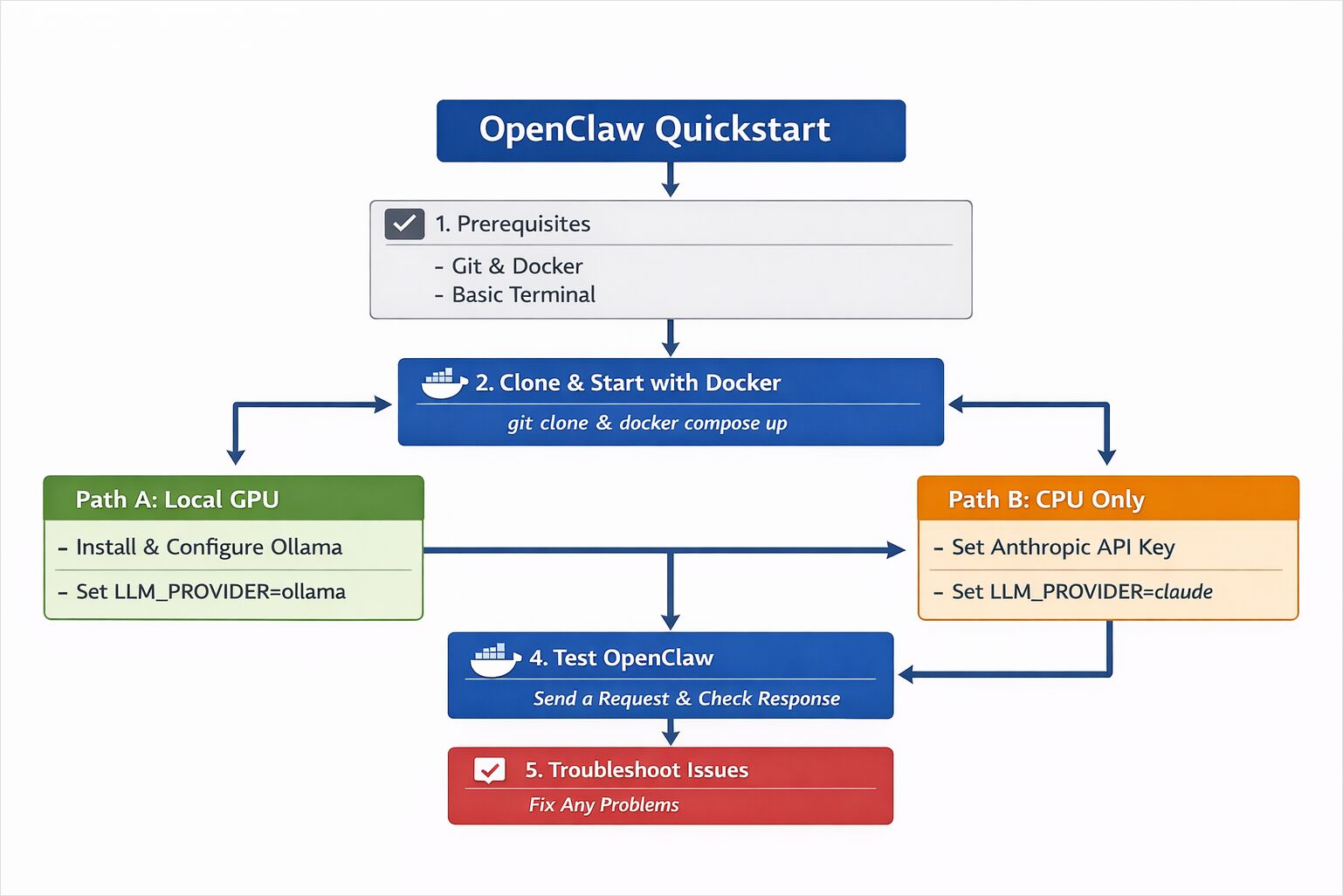

Ten przewodnik szybkiego startu pokazuje, jak wdrożyć OpenClaw przy użyciu Docker, skonfigurować model lokalny zasilany przez GPU lub model chmurowy działający tylko na CPU, a następnie zweryfikować, czy Twój asystent AI działa poprawnie w całym cyklu pracy.

Ten przewodnik omawia minimalną konfigurację OpenClaw, abyś mógł zobaczyć go działającego i odpowiadającego na zapytania na swoim własnym komputerze.

Cel jest prosty:

- Uruchom OpenClaw.

- Wyślij żądanie.

- Potwierdź, że system działa.

To nie jest przewodnik dotyczący hardeningu środowiska produkcyjnego.

To nie jest przewodnik dotyczący optymalizacji wydajności.

To praktyczny punkt startowy.

Masz dwie opcje:

- Ścieżka A — Lokalny GPU przy użyciu Ollama (zalecane, jeśli posiadasz GPU)

- Ścieżka B — Tylko CPU przy użyciu Claude Sonnet 4.6 przez API Anthropic

Obie ścieżki korzystają z tego samego podstawowego procesu instalacji.

Jeśli jesteś nowy w OpenClaw i chcesz uzyskać głębszy przegląd struktury systemu, przeczytaj Przegląd systemu OpenClaw. Jeśli planujesz uruchomić asystenta działającego nonstop z bardziej rygorystycznym piaskowniczeniem i kontrolami polityki, postępuj zgodnie z Przewodnikiem po bezpiecznych operacjach NemoClaw.

Wymagania systemowe i konfiguracja środowiska

OpenClaw to system asystenta, który może łączyć się z zewnętrznymi usługami. W ramach tego Szybkiego Startu:

- Używaj kont testowych tam, gdzie to możliwe.

- Unikaj łączenia wrażliwych systemów produkcyjnych.

- Uruchamiaj go wewnątrz Docker (zalecane).

Izolacja jest dobrą domyślną opcją podczas eksperymentowania z oprogramowaniem typu agent.

Wymagania wstępne dla OpenClaw (GPU z Ollama lub CPU z Claude)

Wymagane dla obu ścieżek

- Git

- Docker Desktop (lub Docker + Docker Compose)

- Terminal

Dla Ścieżki A (Lokalny GPU)

- Komputer ze zgodnym GPU (zalecane NVIDIA lub AMD)

- Zainstalowane Ollama

Dla Ścieżki B (CPU + Model Chmurowy)

- Klucz API Anthropic

- Dostęp do Claude Sonnet 4.6

Krok 1 — Instalacja OpenClaw z Docker (Klonowanie i Uruchomienie)

OpenClaw można uruchomić przy użyciu Docker Compose. Pozwala to na utrzymanie konfiguracji w izolacji i jej powtarzalność.

Sklonuj repozytorium

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Skopiuj konfigurację środowiska

cp .env.example .env

Otwórz plik .env w edytorze. Skonfigurujemy go w następnym kroku, w zależności od wybranego modelu.

Uruchom kontenery

docker compose up -d

Jeśli wszystko uruchomi się poprawnie, powinieneś zobaczyć działające kontenery:

docker ps

W tym momencie OpenClaw jest uruchomiony — ale nie jest jeszcze połączony z modelem.

Krok 2 — Konfiguracja dostawcy LLM (Ollama GPU lub Claude CPU)

Teraz zdecyduj, jak ma działać wnioskowanie (inference).

Ścieżka A — Lokalny GPU z Ollama

Jeśli masz dostępny GPU, jest to najprostsza i najbardziej samowystarczalna opcja.

Zainstaluj lub zweryfikuj Ollama

Jeśli potrzebujesz bardziej szczegółowego przewodnika instalacyjnego lub chcesz skonfigurować lokalizacje przechowywania modeli, zobacz:

- Instalacja Ollama i konfiguracja lokalizacji modeli

- Ollama CLI Cheatsheet: ls, serve, run, ps + inne polecenia (aktualizacja 2026)

Jeśli Ollama nie jest zainstalowane:

curl -fsSL https://ollama.com/install.sh | sh

Zweryfikuj, czy działa:

ollama pull llama3

ollama run llama3

Jeśli model odpowie, wnioskowanie działa poprawnie.

Skonfiguruj OpenClaw do użycia Ollama

W pliku .env skonfiguruj:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Uruchom ponownie kontenery:

docker compose restart

OpenClaw będzie teraz kierował żądania do Twojej lokalnej instancji Ollama.

Jeśli zastanawiasz się, który model uruchomić na GPU z 16 GB pamięci, szukasz porównań benchmarkowych lub potrzebujesz rozsądnych wartości domyślnych samplerów dla Qwen / Gemma dla asystentów mocno opartych na narzędziach, zobacz:

- Najlepsze LLM dla Ollama na GPU z 16 GB VRAM

- Parametry wnioskowania dla agencji LLM dla Qwen i Gemma

Aby zrozumieć współbieżność i zachowanie CPU pod obciążeniem:

- Jak Ollama obsługuje żądania równoległe

- Test: Jak Ollama wykorzystuje wydajność i efektywne rdzenie Intel CPU

Ścieżka B — Tylko CPU przy użyciu Claude Sonnet 4.6

Jeśli nie posiadasz GPU, możesz skorzystać z hostowanego modelu.

Dodaj swój klucz API

W pliku .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=twój_klucz_api_tutaj

ANTHROPIC_MODEL=claude-sonnet-4-6

Uruchom ponownie:

docker compose restart

OpenClaw będzie teraz używać Claude Sonnet 4.6 do wnioskowania, podczas gdy orkiestracja będzie działać lokalnie.

Ta konfiguracja działa dobrze na maszynach tylko z CPU, ponieważ obciążenie obliczeniowe modelu odbywa się w chmurze.

Jeśli korzystasz z modeli Anthropic, ta zmiana w polityce subskrypcji Claude wyjaśnia, dlaczego OpenClaw wymaga rozliczenia opartego na API zamiast ponownego wykorzystania planu Claude.

Krok 3 — Test OpenClaw z pierwszym promptem

Gdy kontenery są uruchomione, a model jest skonfigurowany, możesz przetestować asystenta.

W zależności od konfiguracji może to być poprzez:

- Interfejs webowy

- Integrację z komunikatorem

- Lokalny punkt końcowy API

Dla podstawowego testu API:

curl http://localhost:3000/health

Powinieneś zobaczyć odpowiedź o statusie zdrowia (healthy).

Teraz wyślij prosty prompt:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Wyjaśnij, co robi OpenClaw, prostymi słowami."}'

Jeśli otrzymasz sformatowaną odpowiedź, system działa poprawnie.

Co właśnie uruchomiłeś

W tym momencie masz:

- Działającą instancję OpenClaw

- Skonfigurowanego dostawcę LLM (lokalnego lub chmurowego)

- Działający cykl żądanie-odpowiedź

Jeśli wybrałeś ścieżkę GPU, wnioskowanie odbywa się lokalnie przez Ollama.

Jeśli wybrałeś ścieżkę CPU, wnioskowanie odbywa się przez Claude Sonnet 4.6, podczas gdy orkiestracja, routing i zarządzanie pamięcią działają wewnątrz Twoich lokalnych kontenerów Docker.

Widoczna interakcja może wydawać się prosta. Pod spodem wiele komponentów koordynuje przetwarzanie Twojego żądania.

Rozwiązywanie problemów z instalacją i działaniem OpenClaw

Model nie odpowiada

- Zweryfikuj konfigurację pliku

.env. - Sprawdź logi kontenerów:

docker compose logs

Ollama nieosiągalny

- Upewnij się, że Ollama jest uruchomione:

ollama list

- Upewnij się, że adres URL bazowy odpowiada Twojemu środowisku.

Nieprawidłowy klucz API

- Sprawdź dwukrotnie

ANTHROPIC_API_KEY - Uruchom ponownie kontenery po aktualizacji

.env

GPU nie jest wykorzystywane

- Upewnij się, że sterowniki GPU są zainstalowane.

- Upewnij się, że Docker ma włączony dostęp do GPU.

Następne kroki po zainstalowaniu OpenClaw

Masz teraz działającą instancję OpenClaw.

Stąd możesz:

- Połączyć platformy komunikacyjne

- Włączyć wyszukiwanie dokumentów

- Eksperymentować ze strategiami routingu

- Dodać obserwowalność i metryki

- Dostroić wydajność i zachowanie kosztowe

Głębsze dyskusje architektoniczne mają większy sens, gdy system już działa.

Uruchomienie go to pierwszy krok.

Gdy już działa, naturalnymi kolejnymi artykułami są:

- Przewodnik po pluginach OpenClaw — które pluginy zainstalować dla pamięci, narzędzi, kanałów i obserwowalności oraz jak działa ich cykl życia

- Przewodnik po umiejętnościach OpenClaw — które umiejętności z ClawHub warto zainstalować i jak bezpiecznie je ograniczać dla ról agentów

- Wzory konfiguracji produkcyjnej OpenClaw — jak pluginy i umiejętności łączą się dla rzeczywistych typów użytkowników, takich jak deweloperzy, zespoły automatyzacji, badacze i operatorzy wsparcia

Więcej studiów przypadków systemów AI znajdziesz w sekcji Systemy AI.