Farfalle vs. Perplexica

Vergleich zweier selbst gehosteter KI-Suchmaschinen

Hervorragendes Essen ist auch ein Genuss für die Augen. Aber in diesem Beitrag vergleichen wir zwei KI-basierte Suchsysteme, Farfalle und Perplexica.

Übrigens heißt diese Nudelform ebenfalls „Farfalle".

Hier vergleiche ich jedoch ausschließlich das Verhalten dieser beiden Systeme. Nicht die Nudelformen.

OK. Konzentration!

Bitte beachten Sie auch Perplexica-Installation und Konfiguration – mit Ollama und Ollama installieren und konfigurieren.

Die in diesem Artikel als Perplexica bezeichnete Antwort-Engine wird nun upstream als Vane ausgeliefert; Vane (Perplexica 2.0) Quickstart mit Ollama und llama.cpp ist die Anlaufstelle für aktuelle Docker-Images, die SearxNG-Verbindung und den Zeitplan der Umbenennung.

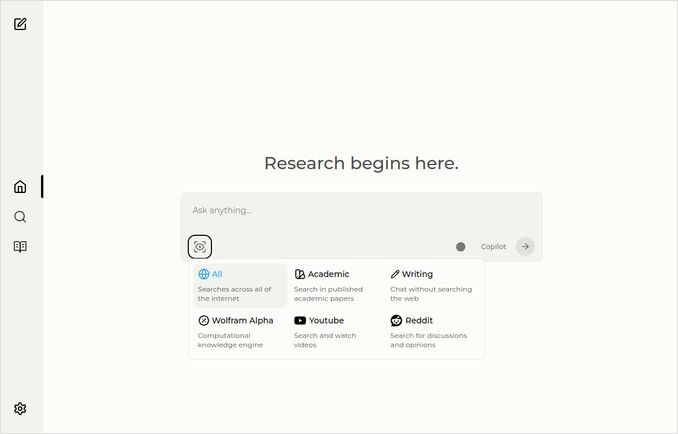

Perplexica

Hier ist die Startseite mit dem Dropdown-Menü zur Quellenauswahl.

- Perplexica ist implementiert in

- TypeScript und React.Js (UI)

- TypeScript und Express.Js (Backend)

- enthält zudem die Konfiguration für den SearxNG-Metasearch-Engine

- Besitzt einen Copilot-Modus

- Ermöglicht die Nutzung jedes auf Ollama gehosteten LLMs als Chat- oder Embedding-Modell

- Enthält drei kleine interne Embedding-Modelle

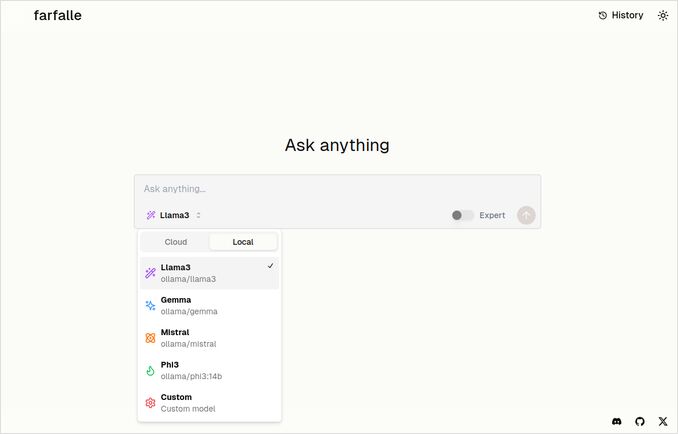

Farfalle

- Farfalle ist implementiert in

- TypeScript und React.Js (UI)

- Python Fastapi (Backend)

- enthält zudem einen Verweis auf den SearxNG-Metasearch-Engine. Es gibt hierfür kaum Konfiguration, da es sich um ein ziemlich standardmäßiges Docker-Image handelt.

- Besitzt einen Expertenmodus, der mehrere Anfragen aus der ursprünglichen Anfrage vorbereiten und die Antworten kombinieren soll. Dies funktionierte in unseren Tests jedoch nicht.

- Ermöglicht die Nutzung von vier auf Ollama gehosteten LLMs als Chat-Modell (llama3, mistral, gemma, phi3). Das ist eine gute Auswahl an Optionen, aber ich würde es vorziehen, wenn es flexibler wäre und die Nutzung jedes von Ollama bereitgestellten Modells erlauben würde.

- Keine Optionen für Embedding-Modelle

Vergleich durchgeführt von Perplexica und Farfalle selbst

Ich habe die gleiche Anfrage gestellt: Vergleichen Sie Farfalle und Perplexica basierend auf Robustheit, Community, Support und unterstützten LLMs.

Sowohl Perplexica als auch Farfalle nutzten das auf lokaler Ollama gehostete llama3-Modell. Der vollständige Name des Modells ist llama3 8b q4.

Glauben Sie den Antworten nicht zu 100 %, betrachten Sie einfach die Textlänge, die Struktur und die allgemeine Antwortqualität.

Ich würde ca. 70 % glauben…

Perplexica-Vergleichsantwort

Vergleich von Farfalle und Perplexica

Robustheit

Farfalle: 8/10 – Farfalle ist eine beliebte KI-Suchmaschine, die für ihre Zuverlässigkeit und ihre Fähigkeit bekannt ist, komplexe Abfragen zu verarbeiten. Es hat eine solide Grundlage in der natürlichen Sprachverarbeitung (NLP) und maschinellem Lernen (ML). Obwohl es nicht perfekt sein mag, ist die Robustheit von Farfalle gut etabliert.

Perplexica: 9/10 – Perplexica basiert auf Meta AI’s Phi-3-Modell, das für Robustheit entwickelt wurde. Es wurde getestet, um präzise Antworten zu liefern, auch wenn es mit mehrdeutigen oder unklaren Abfragen konfrontiert wird. Seine Fähigkeit, Fragen neu zu formulieren und sich an verschiedene Kontexte anzupassen, macht es zu einer robusten Suchmaschine.

Community

Farfalle: 7/10 – Farfalle hat eine engagierte Community von Nutzern, die seine Fähigkeiten schätzen. Obwohl es vielleicht nicht das gleiche Adoptionsniveau wie Perplexica hat, ist die Nutzerbasis von Farfalle dennoch signifikant.

Perplexica: 8,5/10 – Perplexica hat weite Anerkennung für seinen innovativen Ansatz bei Suchmaschinen gewonnen. Seine Community wächst rasch, und viele Nutzer schätzen seine Fähigkeit, präzise und relevante Ergebnisse zu liefern.

Support

Farfalle: 6,5/10 – Farfalle bietet grundlegende Unterstützung durch FAQs, Dokumentation und Foren. Obwohl es nicht so umfassend ist wie der Support von Perplexica, ist die Nutzerbasis von Farfalle im Allgemeinen selbstgenügsam.

Perplexica: 9/10 – Perplexica bietet umfangreiche Support-Ressourcen, einschließlich detaillierter Dokumentation, FAQs und Community-Foren. Seine Entwickler sind aktiv mit der Community verbunden und stellen sicher, dass Nutzer zeitnahe und effektive Unterstützung erhalten.

Unterstützte LLMs

Farfalle: Nein – Farfalle ist eine eigenständige KI-Suchmaschine, die für ihre Fähigkeiten nicht auf große Sprachmodelle (LLMs) angewiesen ist.

Perplexica: Ja – Perplexica basiert auf Meta AI’s Phi-3-Modell, das ein LLM ist. Dies ermöglicht es Perplexica, die Kraft des Deep Learnings für präzisere und relevantere Ergebnisse zu nutzen.

Gesamtergebnis Farfalle: 22/30 Perplexica: 34,5/40

Basierend auf diesen Kriterien scheint Perplexica einen leichten Vorteil gegenüber Farfalle in Bezug auf Robustheit, Community-Support und LLM-Integration zu haben. Allerdings haben beide Suchmaschinen ihre Stärken, und die Wahl hängt letztendlich von Ihren spezifischen Bedürfnissen und Präferenzen ab.

Empfehlung: Wenn Sie eine zuverlässige KI-Suchmaschine mit starken NLP-Fähigkeiten suchen, könnte Perplexica die bessere Wahl sein. Wenn Sie einen direkteren, unkomplizierteren Ansatz zur Suche bevorzugen, könnte Farfalle immer noch hervorragende Ergebnisse liefern.

Farfalle-Vergleichsantwort

Vergleich von Farfalle und Perplexica

Farfalle und Perplexica sind zwei KI-gestützte Suchmaschinen, die in letzter Zeit Aufmerksamkeit erregt haben. Hier ist ein Vergleich dieser beiden Projekte basierend auf Robustheit, Community, Support und LLM (Large Language Model)-Unterstützung.

Robustheit

- Farfalle ist so konzipiert, dass es selbstgehostet mit lokalen oder Cloud-LLMs betrieben werden kann, was es zu einer robusteren Option für Nutzer macht, die Kontrolle über ihre Suchmaschine haben möchten.

- Perplexica hingegen ist eine Open-Source-Alternative zu Perplexity AI und wird ständig von seinen Entwicklern verbessert.

Community

- Perplexica hat eine engagierte Community von Entwicklern und Nutzern, die zu seiner Entwicklung beitragen und Unterstützung leisten.

- Die Community von Farfalle ist kleiner, hat aber dennoch Präsenz auf GitHub.

Support

- Perplexica bietet regelmäßige Updates und Verbesserungen sowie einen Discord-Kanal zur Besprechung von Themen außerhalb des regulären Supports.

- Der Support für Farfalle beschränkt sich auf GitHub-Issues und Pull-Requests.

LLM-Unterstützung: Sowohl Farfalle als auch Perplexica unterstützen LLMs. Perplexica nutzt Ollama, ein lokales LLM, während Farfalle sowohl lokale als auch Cloud-LLMs unterstützt.

Zusammenfassend ist Farfalle aufgrund seines selbstgehosteten Designs robuster, während Perplexica eine stärkere Community und besseren Support bietet. Beide Projekte unterstützen LLMs, aber Perplexica nutzt spezifisch Ollama.

Fazit

Was ist der Unterschied zwischen Perplexica und Farfalle?

Die Antwort:

- Wenn man einige faktische Fehler beiseitelegt, sind sich beide Systeme einig, dass Perplexica besser ist als Farfalle, womit ich gerne übereinstimme.

- Ich mag die Benutzeroberfläche von Farfalle wirklich, obwohl sie sich ziemlich ähnlich sind.

- Ich mag die Idee des Expertenmodus von Farfalle, obwohl er in meiner Umgebung nicht funktionierte.

- Ich stieß beim Betrieb von Farfalle auf drei Fehler. Der Code von Perplexica ist polierter.

- Einmal konfiguriert, lief Perplexica ohne Fehler.

- Perplexica erlaubt die Nutzung jedes auf Ollama gehosteten Modells. Und Farfalle erlaubt nur die Nutzung von Gemma, Llama3, Mistral und Phi3 (vordefinierte Versionen, die etwas veraltet sind).

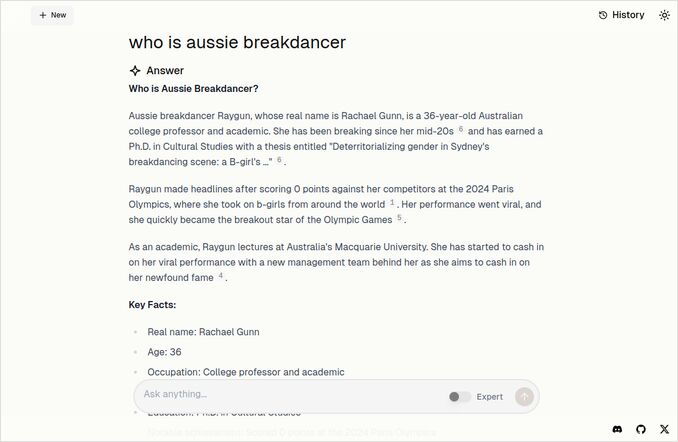

- Ich mag die Antworten von Farfalle mehr. Schauen Sie sich das Farfalle-Bild unten an. Direkt zur Sache, ohne diese „Laut dem bereitgestellten Kontext…"-Formulierungen.

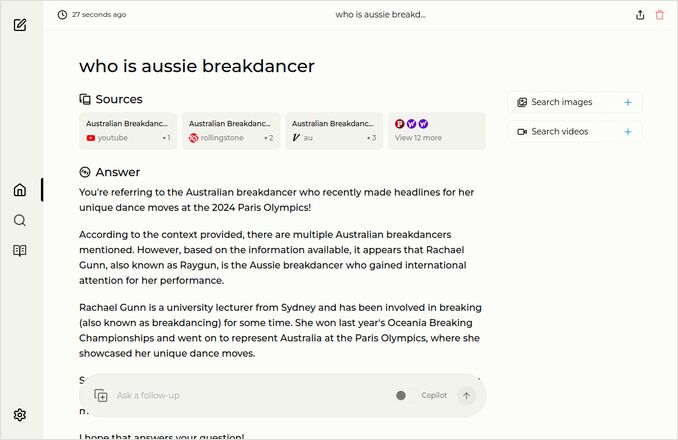

Weitere Beispiele

Diese zeigen Antworten auf dieselbe Frage über einen australischen Breakdancer. Sie wissen schon, denjenigen mit dem Doktortitel, der 0 (Null) Punkte bekam und wahrscheinlich dazu führte, dass Breakdance aus dem olympischen Programm gestrichen wurde.

Farfalle-Antwort

Perplexica-Antwort

Wenn Sie diesen letzten Absatz nach oben (oder unten) lesen, danke ich Ihnen, dass Sie die gleichen Interessen wie ich haben. Es sind wirklich aufregende Zeiten. Haben Sie einen großartigen Tag!

Nützliche Links

- Suche vs. Deepsearch vs. Deep Research

- Test: Wie Ollama Intel-CPU-Leistung und effiziente Kerne nutzt

- Wie Ollama parallele Anfragen handhabt

- Selbstgehostetes Perplexica – mit Ollama

- Vergleich der Zusammenfassungsfähigkeiten von LLMs

- Effektive Prompts für LLMs schreiben

- Test der Erkennung logischer Fehlschlüsse durch neue LLMs: gemma2, qwen2 und mistral Nemo

- Ollama-Kurzreferenz

- Markdown-Kurzreferenz

- Cloud-LLM-Anbieter

- Qwen3-Embedding- und Reranker-Modelle auf Ollama: State-of-the-Art-Leistung