Оллама Эншитификация: ранние признаки

Моё мнение о текущем состоянии разработки Ollama

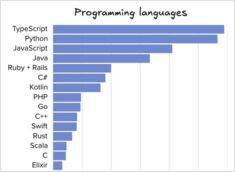

Ollama быстро стал одним из самых популярных инструментов для запуска локальных моделей большого языка (LLM). Его простой интерфейс командной строки и упрощенное управление моделями сделали его предпочтительным вариантом для разработчиков, которые хотят работать с моделями ИИ вне облака.