Modelos de Incorporação e Reordenamento Qwen3 no Ollama: Desempenho de Ponta

Novos e incríveis LLMs disponíveis no Ollama

Os modelos Qwen3 de Embedding e Reranker são os lançamentos mais recentes da família Qwen, projetados especificamente para tarefas avançadas de incorporação (embedding), recuperação e reclassificação de texto.

Prazer para os olhos

Os modelos Qwen3 de Embedding e Reranker representam um avanço significativo no processamento de linguagem natural (PLN) multilíngue, oferecendo desempenho de ponta em tarefas de incorporação e reclassificação de texto. Estes modelos, parte da série Qwen desenvolvida pela Alibaba, foram projetados para suportar uma ampla gama de aplicações, desde a recuperação semântica até a busca de código. Este tipo de capacidade de embedding é fundamental para a construção de sistemas RAG eficazes, conforme detalhado no Tutorial de Geração Aumentada por Recuperação (RAG): Arquitetura, Implementação e Guia de Produção. Embora o Ollama seja uma plataforma open-source popular para hospedar e implantar grandes modelos de linguagem (LLMs), a integração dos modelos Qwen3 com o Ollama não é detalhada explicitamente na documentação oficial. No entanto, os modelos estão acessíveis via Hugging Face, GitHub e ModelScope, permitindo uma implantação local potencial através do Ollama ou ferramentas similares.

Exemplos usando estes modelos

Por favor, veja o código de exemplo em Go usando o Ollama com estes modelos:

- Reclassificação de documentos de texto com Ollama e modelo Qwen3 Embedding - em Go

- Reclassificação de documentos de texto com Ollama e modelo Qwen3 Reranker - em Go

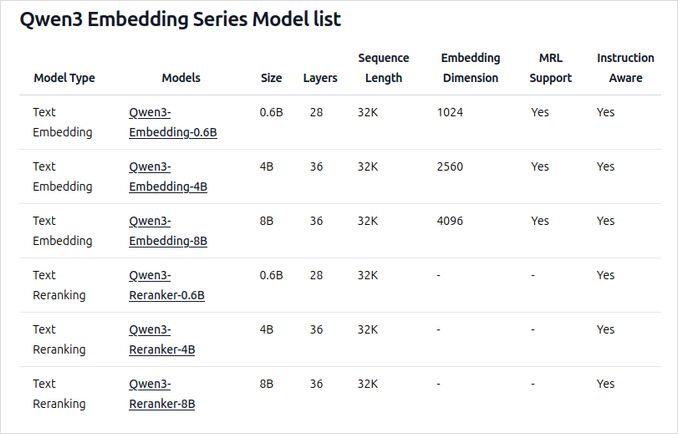

Visão geral dos novos modelos Qwen3 de Embedding e Reranker no Ollama

Estes modelos estão agora disponíveis para implantação no Ollama em vários tamanhos, proporcionando desempenho de ponta e flexibilidade para uma ampla gama de aplicações relacionadas a linguagem e código.

Principais Recursos e Capacidades

-

Tamanhos de Modelo e Flexibilidade

- Disponíveis em múltiplos tamanhos: 0.6B, 4B e 8B parâmetros tanto para tarefas de embedding quanto de reranking.

- O modelo de embedding de 8B atualmente ocupa o lugar nº 1 no ranking multilíngue do MTEB (até 5 de junho de 2025, com uma pontuação de 70,58).

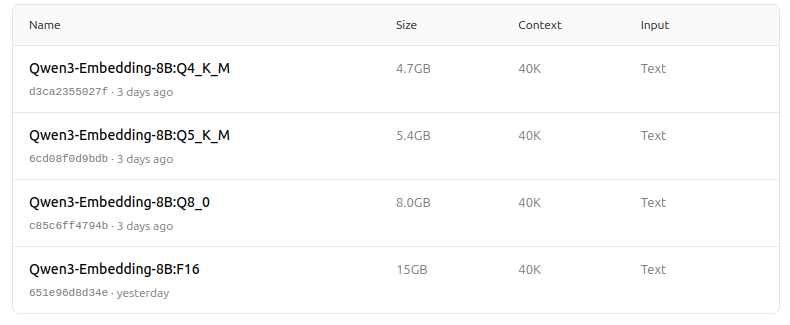

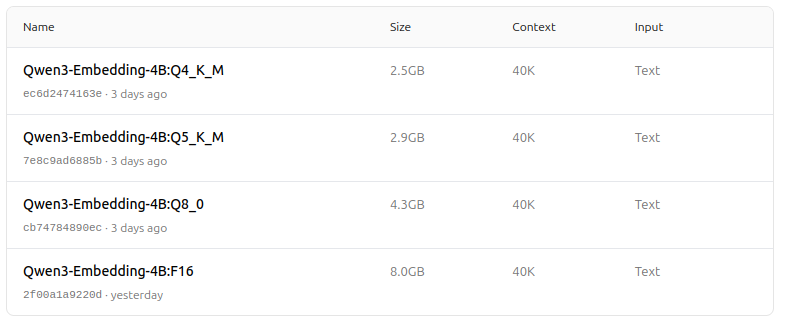

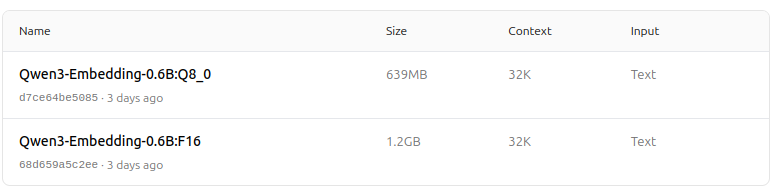

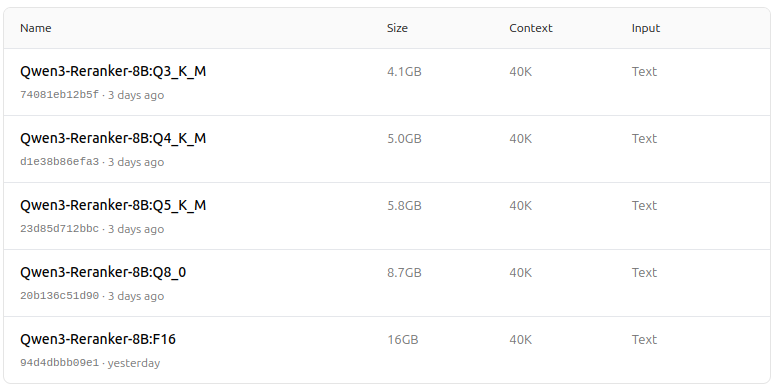

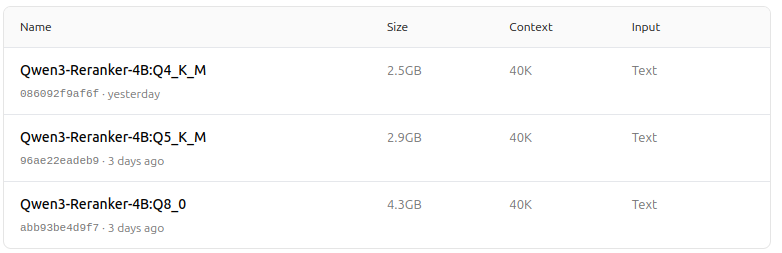

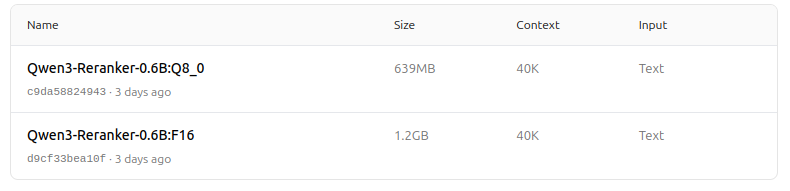

- Suporta uma variedade de opções de quantização (Q4, Q5, Q8, etc.) para equilibrar desempenho, uso de memória e velocidade. A Q5_K_M é recomendada para a maioria dos usuários, pois preserva a maior parte do desempenho do modelo enquanto é eficiente em recursos.

-

Arquitetura e Treinamento

- Construído sobre a fundação Qwen3, aproveitando tanto a arquitetura de dual-encoder (para embeddings) quanto cross-encoder (para reranking).

- Modelo de Embedding: Processa segmentos de texto únicos, extraindo representações semânticas do estado oculto final.

- Modelo de Reranker: Recebe pares de texto (ex: consulta e documento) e gera uma pontuação de relevância usando uma abordagem cross-encoder.

- Modelos de Embedding utilizam um paradigma de treinamento em três etapas: pré-treinamento contrastivo, treinamento supervisionado com dados de alta qualidade e fusão de modelos para generalização e adaptabilidade ótimas.

- Modelos de Reranker são treinados diretamente com dados rotulados de alta qualidade para eficiência e eficácia.

-

Suporte Multilíngue e Multitarefa

- Suporta mais de 100 idiomas, incluindo linguagens de programação, permitindo capacidades robustas de recuperação multilíngue, translingual e de código.

- Modelos de Embedding permitem definições vetoriais flexíveis e instruções definidas pelo usuário para ajustar o desempenho a tarefas ou idiomas específicos.

- Para aplicações que exigem capacidades multimodais além do texto, veja Embeddings Cruzados Modais: Unindo Modalidades de IA.

-

Desempenho e Casos de Uso

- Resultados de ponta em recuperação de texto, recuperação de código, classificação, agrupamento (clustering) e mineração de bitexto.

- Modelos de Reranker destacam-se em vários cenários de recuperação de texto e podem ser combinados sem problemas com modelos de embedding para pipelines de recuperação de ponta a ponta.

Como Usar no Ollama

Você pode executar estes modelos no Ollama com comandos como:

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

Escolha a versão de quantização que melhor se adapta às suas necessidades de hardware e desempenho.

Atualização Dezembro de 2025: Agora o Ollama fornece modelos padrão de embedding Qwen3, do próprio repositório, não do dengcao:

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

Veja mais: https://ollama.com/library/qwen3-embedding

Tabela Resumo

| Tipo de Modelo | Tamanhos Disponíveis | Principais Pontos Fortes | Suporte Multilíngue | Opções de Quantização |

|---|---|---|---|---|

| Embedding | 0.6B, 4B, 8B | Melhores pontuações MTEB, flexível, eficiente, SOTA | Sim (100+ idiomas) | Q4, Q5, Q6, Q8, etc. |

| Reranker | 0.6B, 4B, 8B | Excelente em relevância de pares de texto, eficiente, flexível | Sim | F16, Q4, Q5, etc. |

Ótimas notícias!

Os modelos Qwen3 de Embedding e Reranker no Ollama representam um salto significativo nas capacidades de recuperação de texto e código multilíngue e multitarefa. Com opções de implantação flexíveis, desempenho robusto em benchmarks e suporte para uma ampla gama de idiomas e tarefas, eles são adequados tanto para ambientes de pesquisa quanto de produção.

Zoo de Modelos - Prazer para os olhos agora

Qwen3 Embedding

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

Qwen3 Reranker

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

Ótimo!

Links Úteis

- Text embeddings para RAG e busca — APIs de embedding em Python e fluxo de recuperação antes de exemplos específicos de modelos

- Reclassificação de documentos de texto com Ollama e modelo Qwen3 Embedding - em Go

- Reclassificação de documentos de texto com Ollama e modelo Qwen3 Reranker - em Go

- Ollama cheatsheet

- Mover Modelos do Ollama para Outro Drive ou Pasta

- Auto-hospedagem do Perplexica - com Ollama

- Teste: Como o Ollama está usando o Desempenho do CPU Intel e Núcleos Eficientes

- Comparação de desempenho de velocidade de LLM

- Comparação das Capacidades de Resumo de LLM

- Provedores de LLM na Nuvem

- Como o Ollama Lida com Solicitações Paralelas

- Comparação da qualidade de Tradução de Página Hugo - LLMs no Ollama