Farfalle x Perplexica

Comparando dois motores de busca de IA auto-hospedados

Comida incrível é um prazer também para os seus olhos. Mas, neste post, compararemos dois sistemas de busca baseados em IA, Farfalle e Perplexica.

A propósito, essa forma de massa também é chamada de “farfalle”.

Mas aqui estou comparando apenas como esses dois sistemas se comportam. Não as formas de massa.

OK. Concentrem-se!

Veja também Instalação e configuração do Perplexica - com ollama e Instalar e configurar Ollama.

O motor de respostas que este artigo rotula como Perplexica agora é distribuído oficialmente como Vane; Início Rápido do Vane (Perplexica 2.0) com Ollama e llama.cpp é onde procurar imagens Docker atuais, configuração com SearxNG e o cronograma de renomeação.

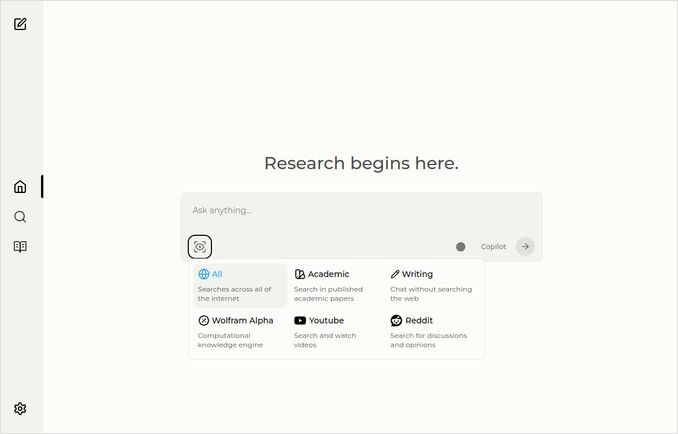

Perplexica

Aqui está a página inicial com o menu suspenso de seleção de fontes.

- O Perplexica é implementado em:

- TypeScript e React.Js (UI)

- TypeScript e Express.Js (Backend)

- também inclui configuração para o motor de metabuscador SearxNG

- Possui um modo Copilot

- Tem a capacidade de usar qualquer LLM hospedado no Ollama como modelo de chat ou embeddings

- Possui três modelos de embedding internos pequenos

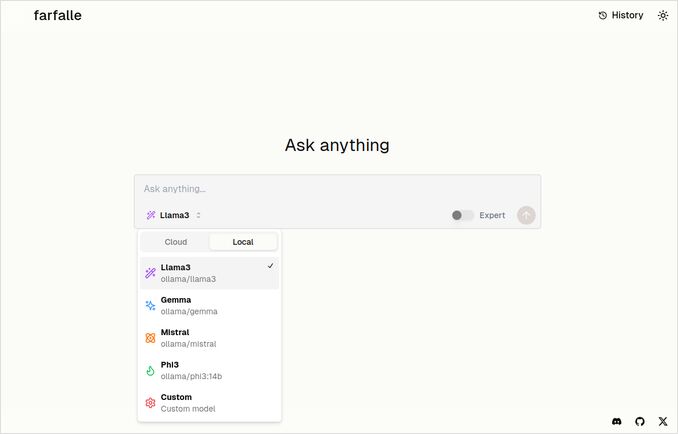

Farfalle

- O Farfalle é implementado em:

- TypeScript e React.Js (UI)

- Python Fastapi (Backend)

- também inclui referência ao motor de metabuscador SearxNG. Pouca configuração para isso, imagem Docker bastante padrão.

- Possui um modo Especialista que deveria preparar várias solicitações com base na original e combinar as respostas. Mas isso não funcionou em nossos testes.

- Tem a capacidade de usar quatro LLMs hospedados no Ollama como modelo de chat (llama3, mistral, gemma, phi3). É um bom conjunto de opções, mas eu preferiria que fosse mais flexível e permitisse usar qualquer modelo que o Ollama sirva.

- Sem opções para modelo de embeddings

Comparação feita pelo próprio Perplexica e Farfalle

Executei a mesma solicitação: Compare farfalle e perplexica com base em robustez, comunidade, suporte e LLMs suportados

Tanto o Perplexica quanto o Farfalle estavam usando o modelo llama3 hospedado localmente no ollama. O nome completo do modelo é llama3 8b q4.

Não acreditem 100% no que as respostas dizem, apenas observem o comprimento do texto, a estrutura e a qualidade geral da resposta.

Acredito em aproximadamente 70%…

Resposta de comparação do Perplexica

Comparação entre Farfalle e Perplexica

Robustez

Farfalle: 8/10 - O Farfalle é um mecanismo de busca de IA popular conhecido por sua confiabilidade e capacidade de lidar com consultas complexas. Possui uma base sólida em processamento de linguagem natural (PLN/NLP) e aprendizado de máquina (ML). Embora não seja perfeito, a robustez do Farfalle está bem estabelecida.

Perplexica: 9/10 - O Perplexica é construído sobre o modelo Phi-3 da Meta AI, projetado para robustez. Foi testado para fornecer respostas precisas mesmo quando confrontado com consultas ambíguas ou pouco claras. Sua capacidade de reformular perguntas e se adaptar a diferentes contextos o torna um mecanismo de busca robusto.

Comunidade

Farfalle: 7/10 - O Farfalle possui uma comunidade dedicada de usuários que apreciam suas capacidades. Embora possa não ter o mesmo nível de adoção que o Perplexica, a base de usuários do Farfalle ainda é significativa.

Perplexica: 8.5/10 - O Perplexica ganhou reconhecimento generalizado por sua abordagem inovadora aos mecanismos de busca. Sua comunidade está crescendo rapidamente, com muitos usuários apreciando sua capacidade de fornecer resultados precisos e relevantes.

Suporte

Farfalle: 6.5/10 - O Farfalle oferece suporte básico através de FAQs, documentação e fóruns. Embora não seja tão abrangente quanto o suporte do Perplexica, a base de usuários do Farfalle é geralmente autossuficiente.

Perplexica: 9/10 - O Perplexica oferece recursos de suporte extensos, incluindo documentação detalhada, FAQs e fóruns da comunidade. Seus desenvolvedores estão ativamente engajados com a comunidade, garantindo que os usuários recebam assistência oportuna e eficaz.

LLMs Suportados

Farfalle: Não - O Farfalle é um mecanismo de busca de IA independente que não depende de grandes modelos de linguagem (LLMs) para suas capacidades.

Perplexica: Sim - O Perplexica é construído sobre o modelo Phi-3 da Meta AI, que é um LLM. Isso permite que o Perplexica aproveite o poder do aprendizado profundo para resultados mais precisos e relevantes.

Pontuação Geral Farfalle: 22/30 Perplexica: 34.5/40

Com base nesses critérios, o Perplexica parece ter uma ligeira vantagem sobre o Farfalle em termos de robustez, suporte da comunidade e integração de LLM. No entanto, ambos os mecanismos de busca têm suas forças, e a escolha depende, em última análise, das suas necessidades e preferências específicas.

Recomendação: Se você procura um mecanismo de busca de IA confiável com fortes capacidades de PLN, o Perplexica pode ser a melhor escolha. Se você prefere uma abordagem mais direta e sem frescuras para a busca, o Farfalle ainda pode fornecer excelentes resultados.

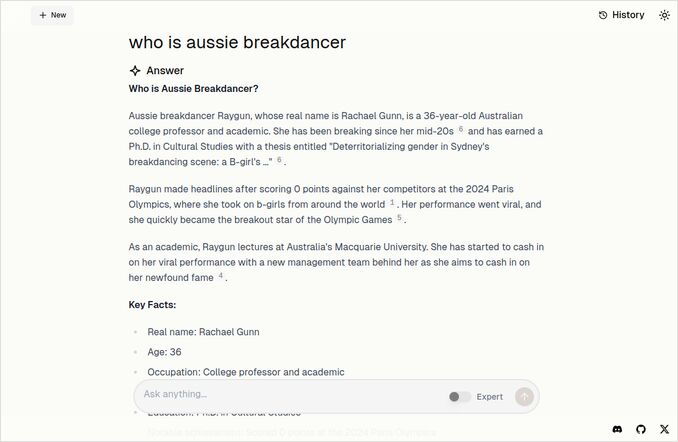

Resposta de comparação do Farfalle

Comparação entre Farfalle e Perplexica

Farfalle e Perplexica são dois motores de busca alimentados por IA que ganharam atenção recentemente. Aqui está uma comparação desses dois projetos com base em robustez, comunidade, suporte e suporte a LLM (Large Language Model).

Robustez

- O Farfalle é projetado para ser auto-hospedado com LLMs locais ou em nuvem, tornando-o uma opção mais robusta para usuários que desejam controle sobre seu mecanismo de busca.

- O Perplexica, por outro lado, é uma alternativa de código aberto ao Perplexity AI e está sendo constantemente melhorado por seus desenvolvedores.

Comunidade

- O Perplexica tem uma comunidade dedicada de desenvolvedores e usuários que contribuem para seu desenvolvimento e fornecem suporte.

- A comunidade do Farfalle é menor, mas ainda tem presença no GitHub.

Suporte

- O Perplexica oferece atualizações e melhorias regulares, bem como um canal Discord para discutir assuntos fora do suporte regular.

- O suporte do Farfalle é limitado a problemas e solicitações de pull no GitHub.

Suporte a LLM: Tanto o Farfalle quanto o Perplexica suportam LLMs. O Perplexica usa o Ollama, um LLM local, enquanto o Farfalle suporta tanto LLMs locais quanto em nuvem.

Em resumo, o Farfalle é mais robusto devido ao seu design auto-hospedado, enquanto o Perplexica tem uma comunidade mais forte e melhor suporte. Ambos os projetos suportam LLMs, mas o Perplexica usa especificamente o Ollama.

Conclusão

Qual é a diferença entre Perplexica e Farfalle?

A resposta:

- Deixando de lado alguns erros factuais, ambos os sistemas acham que o Perplexica é melhor que o Farfalle, com o que eu gostaria de concordar.

- Adoro a interface do Farfalle, embora sejam bastante próximas.

- Gosto da ideia do modo especialista do Farfalle, embora não tenha funcionado no meu ambiente.

- Encontrei 3 bugs ao executar o Farfalle. O código do Perplexica é mais polido.

- Uma vez configurado, o Perplexica rodou sem nenhum erro.

- O Perplexica permite usar qualquer modelo hospedado no Ollama. E o Farfalle permite usar apenas Gemma, Llama3, Mistral e Phi3 (versões pré-definidas, que estão um pouco desatualizadas).

- Gosto mais das respostas do Farfalle. Olhem para a imagem do Farfalle abaixo. Direto ao ponto, sem aqueles “De acordo com o contexto fornecido”…

Mais exemplos

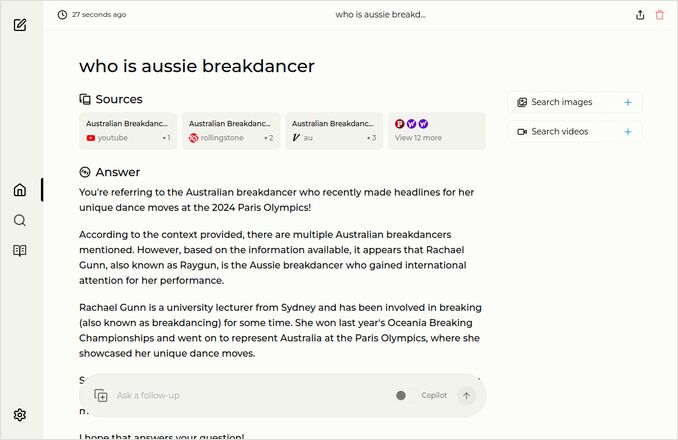

Estes mostram respostas para a mesma pergunta sobre um dançarino de break australiano. Vocês sabem, aquele com PhD que tirou 0 (Zero) pontos e provavelmente causou a remoção do breakdance do programa olímpico.

Resposta do Farfalle

Resposta do Perplexica

Se você ler para cima (ou para baixo) até este último parágrafo, obrigado por terem os mesmos interesses que eu. São tempos realmente emocionantes. Tenham um ótimo dia!

Links úteis

- Search vs Deepsearch vs Deep Research

- Teste: Como o Ollama está usando o Desempenho de CPU Intel e Núcleos Eficientes

- Como o Ollama Lida com Solicitações Paralelas

- Auto-hospedagem do Perplexica - com Ollama

- Comparando Capacidades de Resumo de LLM

- Escrevendo prompts eficazes para LLMs

- Testando detecção de falácias lógicas por novos LLMs: gemma2, qwen2 e mistral Nemo

- Guia de consulta do Ollama

- Guia de consulta do Markdown

- Provedores de LLM em Nuvem

- Modelos de Embedding e Reranker Qwen3 no Ollama: Desempenho de Estado da Arte