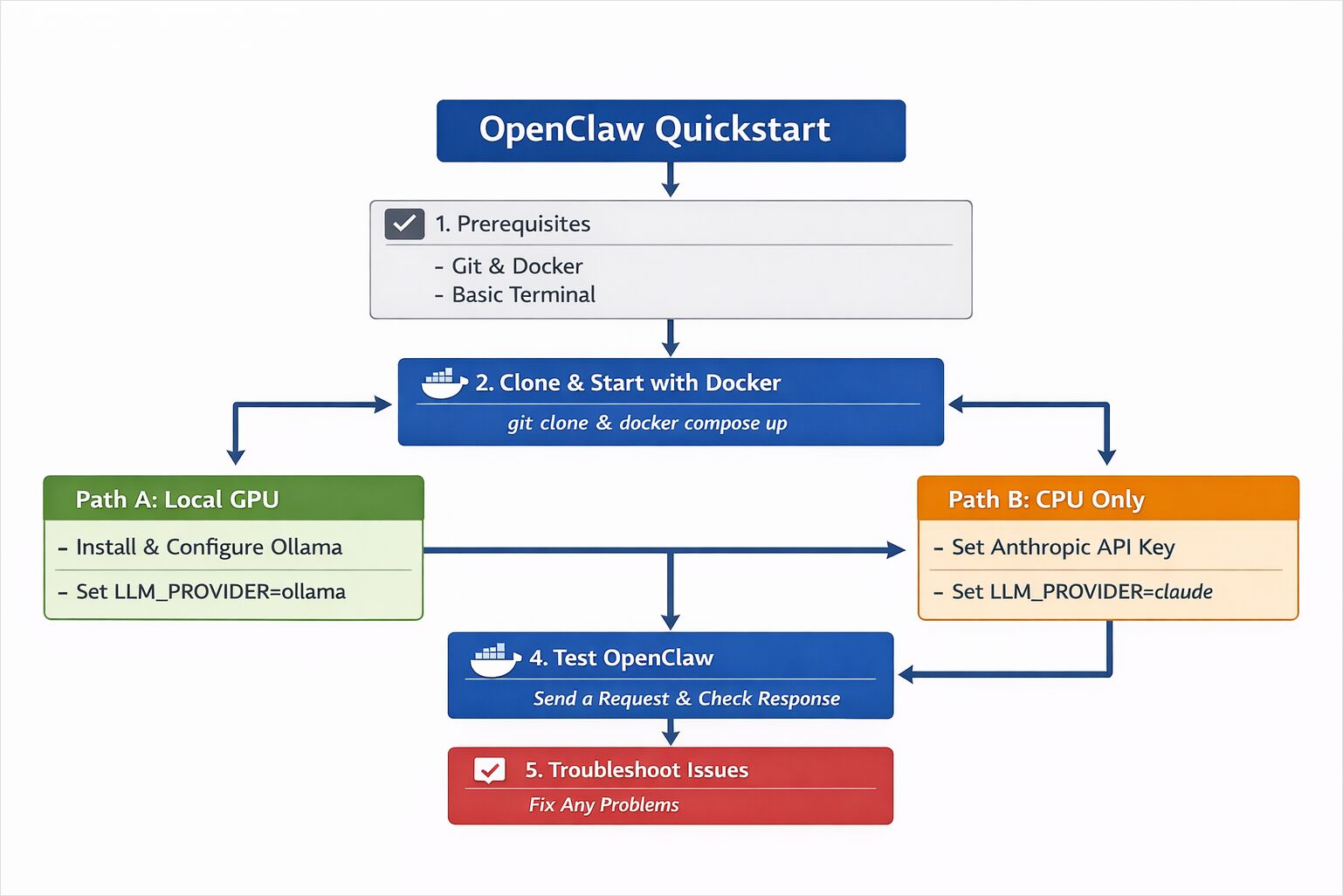

Início Rápido do OpenClaw: Instalação com Docker (Ollama GPU ou Claude + CPU)

Instale o OpenClaw localmente com o Ollama

O OpenClaw é um assistente de IA auto-hospedado, projetado para ser executado com tempos de execução de LLM locais, como Ollama, ou com modelos baseados em nuvem, como o Claude Sonnet.

Este guia de início rápido mostra como implantar o OpenClaw usando Docker, configurar um modelo local com GPU ou um modelo de nuvem apenas com CPU e verificar se o seu assistente de IA está funcionando de ponta a ponta.

Este guia apresenta uma configuração mínima do OpenClaw para que você possa vê-lo em execução e respondendo na sua própria máquina.

O objetivo é simples:

- Colocar o OpenClaw em execução.

- Enviar uma solicitação.

- Confirmar que está funcionando.

Este não é um guia para endurecimento para produção.

Este não é um guia de ajuste de desempenho.

Este é um ponto de partida prático.

Você tem duas opções:

- Caminho A — GPU Local usando o Ollama (recomendado se você tiver uma GPU)

- Caminho B — Apenas CPU usando o Claude Sonnet 4.6 via API da Anthropic

Ambos os caminhos compartilham o mesmo processo básico de instalação.

Se você é novo no OpenClaw e deseja uma visão mais aprofundada de como o sistema está estruturado, leia a visão geral do sistema OpenClaw. Se você planeja executar um assistente sempre ativo com sandboxing mais rigoroso e controles de política, siga o guia de operações seguras do NemoClaw.

Requisitos de Sistema e Configuração do Ambiente

O OpenClaw é um sistema estilo assistente que pode se conectar a serviços externos. Para este Início Rápido:

- Use contas de teste sempre que possível.

- Evite conectar sistemas de produção sensíveis.

- Execute-o dentro do Docker (recomendado).

O isolamento é uma boa configuração padrão ao experimentar com software estilo agente.

Pré-requisitos do OpenClaw (GPU com Ollama ou CPU com Claude)

Necessário para Ambos os Caminhos

- Git

- Docker Desktop (ou Docker + Docker Compose)

- Um terminal

Para o Caminho A (GPU Local)

- Uma máquina com uma GPU compatível (NVIDIA ou AMD recomendadas)

- Ollama instalado

Para o Caminho B (CPU + Modelo em Nuvem)

- Uma chave de API da Anthropic

- Acesso ao Claude Sonnet 4.6

Etapa 1 — Instalar o OpenClaw com Docker (Clonar e Iniciar)

O OpenClaw pode ser iniciado usando o Docker Compose. Isso mantém a configuração contida e reproduzível.

Clonar o repositório

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Copiar a configuração de ambiente

cp .env.example .env

Abra o arquivo .env no seu editor. Nós o configuraremos na próxima etapa, dependendo do caminho do modelo que você escolher.

Iniciar os contêineres

docker compose up -d

Se tudo iniciar corretamente, você deverá ver os contêineres em execução:

docker ps

Neste estágio, o OpenClaw está em execução — mas ainda não está conectado a um modelo.

Etapa 2 — Configurar o Provedor de LLM (Ollama GPU ou Claude CPU)

Agora decida como você quer que a inferência funcione.

Caminho A — GPU Local com Ollama

Se você tiver uma GPU disponível, esta é a opção mais simples e autocontida.

Instalar ou Verificar o Ollama

Se você precisar de um guia de instalação mais detalhado ou quiser configurar os locais de armazenamento de modelos, consulte:

- Instalar Ollama e Configurar o Local dos Modelos

- Guia de Referência Rápida da CLI do Ollama: ls, serve, run, ps + outros comandos (atualização 2026)

Se o Ollama não estiver instalado:

curl -fsSL https://ollama.com/install.sh | sh

Verifique se está funcionando:

ollama pull llama3

ollama run llama3

Se o modelo responder, a inferência está funcionando.

Configurar o OpenClaw para Usar o Ollama

No seu arquivo .env, configure:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Reinicie os contêineres:

docker compose restart

O OpenClaw agora roteará as solicitações para a sua instância local do Ollama.

Se você está decidindo qual modelo executar em uma GPU com 16GB de VRAM, deseja comparações de benchmark ou precisa de padrões de amostragem sensíveis para o Qwen / Gemma para assistentes com muitas ferramentas, consulte:

- Melhores LLMs para Ollama em GPU com 16GB de VRAM

- Parâmetros de inferência de LLM Agente para Qwen e Gemma

Para entender a concorrência e o comportamento da CPU sob carga:

- Como o Ollama Lida com Solicitações Paralelas

- Teste: Como o Ollama usa o Desempenho da CPU Intel e Núcleos Eficientes

Caminho B — Apenas CPU Usando Claude Sonnet 4.6

Se você não tiver uma GPU, pode usar um modelo hospedado.

Adicionar Sua Chave de API

No seu arquivo .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=sua_chave_de_api_aqui

ANTHROPIC_MODEL=claude-sonnet-4-6

Reinicie:

docker compose restart

O OpenClaw agora usará o Claude Sonnet 4.6 para inferência, enquanto a orquestração é executada localmente.

Esta configuração funciona bem em máquinas apenas com CPU, pois o cálculo pesado do modelo ocorre na nuvem.

Se você estiver usando modelos da Anthropic aqui, esta mudança na política de assinatura do Claude explica por que o OpenClaw exige faturamento baseado em API em vez de reutilizar o plano do Claude.

Etapa 3 — Testar o OpenClaw com o Seu Primeiro Prompt

Uma vez que os contêineres estejam em execução e o modelo esteja configurado, você pode testar o assistente.

Dependendo da sua configuração, isso pode ser feito através de:

- Uma interface web

- Uma integração de mensagens

- Um endpoint de API local

Para um teste básico de API:

curl http://localhost:3000/health

Você deverá ver uma resposta de status saudável.

Agora envie um prompt simples:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explique o que o OpenClaw faz em termos simples."}'

Se você receber uma resposta estruturada, o sistema está funcionando.

O Que Você Acabou de Executar

Neste ponto, você tem:

- Uma instância do OpenClaw em execução

- Um provedor de LLM configurado (local ou em nuvem)

- Um loop de solicitação-resposta funcionando

Se você escolheu o caminho da GPU, a inferência ocorre localmente via Ollama.

Se você escolheu o caminho da CPU, a inferência ocorre via Claude Sonnet 4.6, enquanto a orquestração, roteamento e gerenciamento de memória são executados dentro dos seus contêineres Docker locais.

A interação visível pode parecer simples. Por baixo, vários componentes coordenam-se para processar a sua solicitação.

Solução de Problemas na Instalação e em Questões de Tempo de Execução do OpenClaw

Modelo Não Está Respondendo

- Verifique a configuração do seu arquivo

.env. - Verifique os logs do contêiner:

docker compose logs

Ollama Não Está Acessível

- Confirme se o Ollama está em execução:

ollama list

- Certifique-se de que a URL base corresponda ao seu ambiente.

Chave de API Inválida

- Verifique novamente a

ANTHROPIC_API_KEY - Reinicie os contêineres após atualizar o

.env

GPU Não Está Sendo Usada

- Confirme se os drivers da GPU estão instalados.

- Certifique-se de que o Docker tenha acesso à GPU habilitado.

Próximas Etapas Após Instalar o OpenClaw

Agora você tem uma instância do OpenClaw funcionando.

A partir daqui, você pode:

- Conectar plataformas de mensagens

- Habilitar a recuperação de documentos

- Experimentar com estratégias de roteamento

- Adicionar observabilidade e métricas

- Ajustar o comportamento de desempenho e custo

As discussões arquitetônicas mais profundas fazem mais sentido uma vez que o sistema está em execução.

Colocá-lo em operação é o primeiro passo.

Uma vez que estiver em execução, os próximos artigos naturais são:

- Guia de plugins do OpenClaw — quais plugins instalar para memória, ferramentas, canais e observabilidade, e como o ciclo de vida funciona

- Guia de habilidades do OpenClaw — quais habilidades valem a pena instalar do ClawHub e como controlá-las com segurança por papel de agente

- Padrões de configuração de produção do OpenClaw — como plugins e habilidades se combinam para tipos reais de usuários, como desenvolvedores, equipes de automação, pesquisadores e operadores de suporte

Para mais estudos de caso de sistemas de IA, consulte a seção Sistemas de IA.