Strukturierter Daten-Markup mit Hugo verwenden

Wenn das Hugo-Thema keine strukturierten Daten unterstützt...

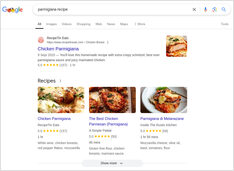

Google zeigt in den Suchergebnissen einige Verbesserungen wie Filmdetails, Stellenanzeigen, Veranstaltungs- und Kursinformationen an, die er aus der Strukturierungsdaten der Website bezieht. Hier ist - Wie man Strukturierungsdaten mit dem Hugo-Generator zur Website hinzufügt.