Ceny DGX Spark AU w głównych sklepach: 6 249–7 999 USD.

Prawdziwe ceny w AUD od australijskich sprzedawców już teraz.

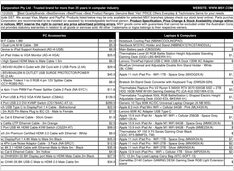

NVIDIA DGX Spark](https://www.glukhov.org/pl/hardware/ai/nvidia-dgx-spark/ “NVIDIA DGX Spark - mały superkomputer AI”) (GB10 Grace Blackwell) jest dostępny w Australii w głównych sklepach z komputerami, z miejscowym zapasem. Jeśli śledzicie ceny i dostępność DGX Spark na świecie, zainteresuje Was zapewne, że ceny w Australii wahają się od 6 249 do 7 999 AUD w zależności od konfiguracji pamięci masowej i sprzedawcy.