Airtable per sviluppatori e DevOps - Piani, API, Webhook e esempi in Go/Python

Airtable - Limiti del piano gratuito, API, webhooks, Go & Python.

Airtable è meglio considerata come una piattaforma low-code costruita intorno a un’interfaccia collaborativa “simile a un foglio di calcolo” - ideale per creare rapidamente strumenti operativi (tracciatori interni, CRM leggeri, pipeline di contenuti, code di valutazione AI) dove gli sviluppatori non devono un’interfaccia amichevole, ma gli sviluppatori necessitano anche di un’API per l’automazione e l’integrazione.

I materiali ufficiali di Airtable descrivono l’API Web come RESTful, utilizzando JSON e codici di stato HTTP standard.

Le due limitazioni che influenzano maggiormente le decisioni di ingegneria sono:

I soffitti rigidi del piano Free: 1.000 record per base, 1.000 chiamate API per workspace al mese, 1 GB di storage per allegati per base, e solo due settimane di storia delle revisioni/snapshot.

Questi numeri sono così bassi che dovresti considerare “Airtable Free” come un prototipo, demo, progetto personale o un piccolo flusso di lavoro interno, non come un data store produttivo interrogato continuamente da servizi.

I limiti di velocità dell’API Web pubblica: Airtable applica 5 richieste al secondo per base e anche 50 richieste al secondo per tutto il traffico che utilizza i token di accesso personale da un utente o un account di servizio. Se superi questi limiti, riceverai un HTTP 429 e (secondo le linee guida di Airtable) devi attendere circa 30 secondi prima di riprovare.

La conseguenza è architettonica: batch dove possibile, caching delle letture, preferisci webhook rispetto al polling per la rilevazione dei cambiamenti e costruisci un meccanismo di riprova/ritardo in ogni client.

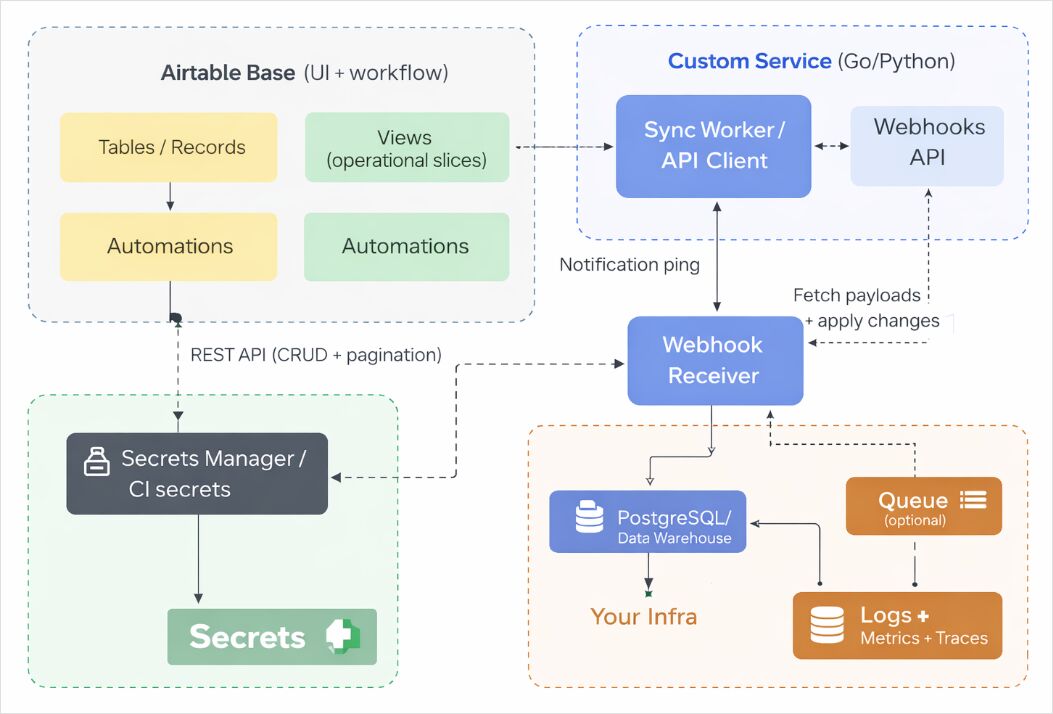

Se desideri utilizzare Airtable in un sistema personalizzato, un modello efficace “DevOps + backend” per la produzione è:

Airtable come interfaccia operativa + fonte leggera di verità per un dataset limitato (regole di routing, code di revisione umana, piani editoriali, passaggi di onboarding clienti).

Un sistema separato (PostgreSQL/warehouse/object storage) come archivio primario duraturo per la scalabilità, l’audit, i backup, l’analisi e le letture/scritture a QPS più elevati.

Uno strato di sincronizzazione che recupera pagine di record (paginazione con offset), invia modifiche in batch e, se necessario, utilizza Airtable Webhooks per ridurre il polling.

Per un’immagine più ampia su oggetti di archiviazione, PostgreSQL, Elasticsearch e strati dati nativi per l’AI, vedi l’articolo Infrastruttura dati per sistemi AI.

Cosa è Airtable e perché gli sviluppatori lo utilizzano come database low-code

L’astrazione centrale di Airtable è la base: un contenitore per tabelle correlate e artefatti del flusso di lavoro (viste, interfacce, automazioni). Nella pratica, una base mappa spesso a un confine di dominio aziendale - Content Ops, Postmortemi incidenti, Valutazioni LLM, Richieste clienti.

All’interno di una base, modelli dei dati come:

Tabelle: analoghe a entità/collections.

Record: righe.

Campi: colonne con tipi ricchi (selezioni, allegati, link, formule, ecc.).

Poi crei diverse “lenti” sulla stessa tabella utilizzando viste-rappresentazioni filtrate/sorte/gruppate ottimizzate per compiti specifici. La documentazione di Airtable sottolinea che le viste ti aiutano a “vedere i record più rilevanti per te” e possono essere personalizzate per diversi consumatori.

Gli sviluppatori si rivolgono ad Airtable quando hanno bisogno di:

Un’interfaccia utente amichevole per gli utenti aziendali per creare/aggiornare rapidamente dati operativi (senza attendere per un’app admin personalizzata).

Un’superficie backend programmabile tramite l’API Web di Airtable per l’ingestione, la sincronizzazione e l’automazione. L’API utilizza semantica REST e JSON, rendendola facile da integrare da servizi Go/Python.

Unione di SaaS/workflow tramite integrazioni e automazioni, dove alcuni passaggi possono essere implementati interamente in Airtable e altri gestiti in codice. Le automazioni di Airtable sono descritte come workflow trigger-action (es. “quando un record è creato → invia un messaggio / aggiorna un record / esegui uno script”).

Airtable è particolarmente produttivo per i team DevOps + AI quando utilizzato come:

Una tabella di configurazione controllata dal cambiamento: ad esempio, metadati dei flag di funzionalità, proprietà del servizio, percorsi di escalation, approvazioni di deployment.

Una coda di revisione umana: ad esempio, output LLM in attesa di validazione, triage di sicurezza, compiti di iterazione dei prompt.

Un indice di metadati per asset che vivono altrove: URI S3, SHA di commit Git, ID di dataset - riducendo la pressione di archiviazione degli allegati su Airtable stesso (importante per il piano Free).

Funzionalità principali di Airtable: base, tabelle, campi, viste, interfacce, estensioni, automazioni e integrazioni

L’“potere” di Airtable non è solo nelle tabelle; è la superficie del flusso di lavoro circostante che fa sì che una base si comporti come una piattaforma leggera per app.

Base e tabelle per la collaborazione strutturata

Una base è dove i team condividono dati strutturati e processano lo stato. L’implicazione ingegneristica pratica è la governance dello schema: se gli utenti aziendali possono rinominare campi o tabelle, i clienti API possono rompersi a meno che non si progetti per i cambiamenti.

Due strategie riducono i danni:

Utilizzare ID stabili nel codice quando possibile. Airtable nota esplicitamente che per gli aggiornamenti dei record i nomi delle tabelle e gli ID delle tabelle possono essere utilizzati indifferentemente, e raccomanda di utilizzare gli ID delle tabelle in modo che non debba cambiare le richieste quando i nomi cambiano.

Documentare i “campi collegati all’API” nelle descrizioni dei campi e trattare i cambiamenti come eventi controllati (review PR / richiesta di cambiamento).

Viste e “lenti” del flusso di lavoro

Le viste ti permettono di filtrare/sortire/gruppare record per processi specifici (vista triage, “da revisionare”, “pronto per il rilascio”). Airtable sottolinea che le viste sono il meccanismo per mostrare solo le “sottoclassi più rilevanti” di record per diversi utenti.

Da un punto di vista di integrazione, puoi progettare una vista come contratto stabile: il tuo lavoro di sincronizzazione legge solo i record nella vista “Esporta”, ad esempio, invece di cercare di replicare tutta la logica di filtraggio in codice. (L’API supporta anche la selezione di record per vista e tramite filtri formula; vedi la sezione API di seguito.)

Estensioni, mercato delle app e “porta i tuoi strumenti”

Airtable supporta le “Estensioni” (precedentemente “Blocchi”), che aggiungono funzionalità all’interno della base (grafici, script, importazioni, ecc.). La panoramica di Airtable descrive le Estensioni come add-on creati da Airtable e terze parti.

Criticamente, le Estensioni non sono supportate nel piano Free, quindi qualsiasi workflow che dipende da esse inizia dal piano Team o superiore.

Automazioni: trigger, azioni e scripting per l’incollatura di integrazione

Le automazioni sono workflow trigger-action: Airtable elenca trigger come “quando un record è creato/aggiornato”, “quando un record entra in una vista”, trigger orari programmabili e “quando un webhook è ricevuto”, tra gli altri.

Le azioni includono la creazione/aggiornamento di record, l’invio di messaggi e (importante per gli sviluppatori) l’esecuzione di codice: l’azione “Esegui uno script” esegue gli script “in background della base” e viene posizionata come la scelta giusta per gli script che desideri eseguire automaticamente.

Tuttavia, “Esegui uno script” è esplicitamente segnalato come non disponibile nel piano Free, che importa se l’architettura assume “utilizzare le automazioni di Airtable per chiamare le nostre API interne.”

API Web e integrazioni come interfaccia ingegneristica

L’API Web di Airtable consente ai sistemi esterni di leggere/scrivere record utilizzando chiamate HTTP standard. La documentazione di Airtable fornisce schemi URL concreti come:

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5 (esempio per il filtraggio tramite formula).

Airtable fornisce anche uno strato di metadati (utile per i pattern “configuration as code” di DevOps), incluso l’elenco delle basi tramite GET https://api.airtable.com/v0/meta/bases e la creazione di una base tramite POST https://api.airtable.com/v0/meta/bases (richiede scope dello schema).

Dall’aspetto dell’autenticazione, Airtable ha abbandonato le chiavi API legacy: la sua cronologia ufficiale di deprecazione include la deprecazione delle chiavi API in vigore il 1 febbraio 2024.

Piani di prezzo di Airtable e limiti del piano Free per gli sviluppatori

I nomi dei piani e i diritti di Airtable cambiano nel tempo, ma la documentazione dei piani correnti di Airtable fornisce quote e vincoli espliciti e rilevanti per l’ingegneria.

Tabella dei piani di Airtable: limiti chiave che influenzano le integrazioni API

| Pian (autogestito a meno che non indicato) | Record per base | Chiamate API per workspace/mese | Storage per allegati per base | Storia delle revisioni/snapshot | Vincoli/Note significativi |

|---|---|---|---|---|---|

| Free | 1.000 | 1.000 | 1 GB | 2 settimane | Nessuna Estensione; ulteriori limitazioni dell’interfaccia utente; limiti dei collaboratori; include crediti AI per editor+ |

| Team | 50.000 | 100.000 | 20 GB | 1 anno | Include Automazioni, Estensioni, Form, Designer dell’interfaccia, Timeline/Gantt, viste bloccate/personali, ecc. |

| Business | 125.000 | Illimitate | 100 GB | 1 anno | Include Sincronizzazione bidirezionale e Pannello Amministratore (e richiede dominii email privati) |

| Enterprise Scale (guidato da vendite) | (varia) | (varia) | (varia) | (varia) | Venduto/gestito da vendite; Business/Enterprise richiedono dominii email privati |

I prezzi dei piani Team e Business nella documentazione dei piani di Airtable sono elencati per collaboratore (fatturazione mensile vs annuale).

Analisi approfondita del piano Free: limiti e implicazioni pratiche per DevOps e sistemi backend

Nel piano Free, ottieni:

1.000 record per base.

Questo è il primo “funzionamento architettonico”: una volta che superi ~1.000 record per un dominio, devi o suddividere in più basi (che complica le integrazioni), archiviare aggressivamente, o spostare il dataset principale altrove (Postgres/warehouse) e mantenere solo “slicing operativi attivi” in Airtable.

1.000 chiamate API per workspace al mese.

Questo è così basso che le strategie di sincronizzazione naive (poll ogni minuto) bruceranno rapidamente la quota. Le linee guida sui limiti delle chiamate API di Airtable descrivono esplicitamente l’API come RESTful e notano che le operazioni di elenco dei record restituiscono pagine di fino a 100; se poll ripetutamente, puoi esaurire rapidamente le chiamate mensili.

Un’integrazione del piano Free dovrebbe quindi predefinito a:

aggiornamenti basati su eventi tramite webhook (quando possibile),

o sincronizzazione guidata dall’utente/manuale,

o un lavoro batch a bassa frequenza (giornaliero),

più caching per evitare letture ripetute. Airtable raccomanda esplicitamente approcci caching/proxy come strategia per gestire i limiti di velocità.

1 GB di storage per allegati per base.

Per i workflow AI/LLM, questo è una trappola se si archiviano PDF, immagini o dataset come allegati. Preferisci archiviare allegati in storage oggetti e mantenere solo URL e metadati in Airtable.

2 settimane di storia delle revisioni/snapshot.

Da un punto di vista del rischio DevOps, la storia limitata riduce la tua capacità di recuperare da modifiche accidentali in massa. Se Airtable è criticamente operativo, dovresti implementare backup/snapshot esterni (job di esportazione API) piuttosto che affidarti solo alla storia delle revisioni.

Il piano Free ha anche limiti di collaborazione e rimozioni di funzionalità che influenzano la consegna:

Collaboratori in lettura illimitati, ma solo 5 collaboratori con permessi Editor/Creatore e 50 Commentatori.

Nessuna Estensione nel piano Free.

Alcune capacità di automazione sono limitate: l’azione “Esegui uno script” è segnalata come non disponibile nel piano Free.

Alternative e concorrenti di Airtable: Notion vs Google Sheets vs Coda vs ClickUp vs PostgreSQL + UI

Airtable non è la risposta predefinita per ogni caso d’uso “tabelle + workflow”. La scelta giusta dipende da se il tuo bisogno principale è:

un magazzino operativo simile a un database con interfaccia utente (Airtable / Coda),

un workspace document-first con database incorporati (Notion),

pure compatibilità con fogli di calcolo (Google Sheets),

gestione compiti/progetti (ClickUp),

o un vero magazzino dati backend con un’interfaccia amministrativa progettata (PostgreSQL + Retool/Appsmith/etc.).

Tabella di confronto tra concorrenti: trade-off ingegneristici (API, UI, scalabilità)

| Strumento | Migliore in | Limiti tipici/modello di limitazione della velocità | Trade-off principali rispetto ad Airtable |

|---|---|---|---|

| Notion | Conoscenza document-centric e database incorporati nei documenti | L’API di Notion è limitata per velocità e applica limiti di richiesta dimensione/base | Eccellente per input RAG e workflow narrativi; i database sono potenti ma spesso meno “ops-table” focalizzati di Airtable; i pattern di integrazione differiscono (richiedono condivisione esplicita con integrazioni). |

| Google Sheets | Interoperabilità con fogli di calcolo, formule, ampia ecosistema | L’API Sheets ha quote per minuto; Google document quota comportamento e raccomanda ~2 MB di payload. | Eccellente quando si necessita di semantica e compatibilità con fogli di calcolo; più difficile costruire esperienze app-like (permessi, form, link relazionali) senza ulteriori strumenti. |

| Coda | Ibridazione documento + tabella con “packs” e automazioni | Coda pubblica che i suoi limiti di velocità dell’API e restituisce 429 quando vengono raggiunti; raccomanda di ritrarsi e riprovare. | Forte fusione documento/tabella; se si desidera un’app operativa base-first simile ad Airtable, il modello di Airtable potrebbe sembrare più chiaro; i limiti di velocità e i limiti dei documenti variano per piano. |

| ClickUp | Gestione compiti/progetti | ClickUp applica limiti di velocità per token e varia i limiti per piano workspace (es. 100 richieste/minuto/token sui piani inferiori, più alti su altri). | Migliore quando “compiti” sono primari; utilizzarlo come database generale è scomodo; forte per workflow ma più debole per modelli schema arbitrari. |

| PostgreSQL + UI (Retool/Appsmith/custom) | Sistema duraturo di record, coerenza forte, scalabilità | Dipende dalla tua infrastruttura; nessun soffitto SaaS-imposto “5 QPS per base” | Più lavoro ingegneristico all’inizio; ma migliore per alta QPS, correttezza rigorosa, audit, query complesse e manutenibilità a lungo termine - poi aggiungi un’interfaccia amministrativa per utenti non sviluppatori. |

Una regola utile: se prevedi letture/scritture ad alta frequenza, esigenze di query complesse o controllo rigoroso dei cambiamenti, tipicamente desideri “Postgres-first”. Se prevedi modifiche pesanti non sviluppatore e iterazioni rapide del workflow, Airtable è convincente - specialmente per strumenti interni - purché si progetti intorno all’API e ai limiti del piano.

Pattern DevOps di Airtable e integrazione API end-to-end con Go e Python

Questa sezione fornisce un percorso completo, orientato alla produzione, da configurazione → autenticazione sicura → client CRUD → paginazione → gestione limiti di velocità → batch → webhook → note di deployment.

Diagramma di integrazione SEO: architettura API di Airtable per sistemi DevOps-friendly

Configurazione e autenticazione: ID stabili, token e privilegio minimo

Preferisci ID di tabella nel codice per ridurre i cambiamenti rovinosi

Airtable nota che i nomi delle tabelle e gli ID delle tabelle possono essere utilizzati indifferentemente e raccomanda gli ID delle tabelle per evitare modifiche alle richieste quando i nomi cambiano.

Nella pratica, questa è una delle decisioni più elevate “Ops hygiene” che puoi prendere per un’integrazione basata su Airtable.

Per localizzare gli ID, Airtable fornisce linee guida su come trovare gli ID delle basi e delle tabelle dagli URL (e tramite documentazione API).

Utilizza Token di Accesso Personale (PAT), non le chiavi API legacy

La lista ufficiale di deprecazione di Airtable include “1 febbraio 2024 - deprecazione delle chiavi API.”

I PAT sono descritti da Airtable come permettono di creare diversi token con diversi ambiti - da stretti (singolo ambito + singola base) a ampi (tutti i workspaces/basi/ambiti permessi dall’utente).

La migliore pratica operativa è: creare diversi PAT per ogni superficie di integrazione (es. un token per sincronizzazione in sola lettura, un altro per percorsi di scrittura) e ruotarli come qualsiasi altro segreto.

Per una resilienza a stile enterprise (l’integrazione non dovrebbe morire quando un dipendente lascia), Airtable descrive account di servizio progettati per integrazioni API, indipendentemente da qualsiasi utente specifico.

Variabili ambiente minimali per entrambi gli esempi Go e Python

# Obbligatori

export AIRTABLE_TOKEN="pat_xxx..." # Token di accesso personale

export AIRTABLE_BASE_ID="appXXXXXXXXXXXXXX" # ID della base

export AIRTABLE_TABLE="tblYYYYYYYYYYYYYY" # Preferisci ID della tabella; il nome della tabella funziona anche

# Opzionali (filtri/comportamento)

export AIRTABLE_PAGE_SIZE="100" # 100 è massimo per elenco record

export AIRTABLE_TIMEOUT_SECONDS="30"

Fondamenti API che plasmano la progettazione client: paginazione, limiti di velocità, batching

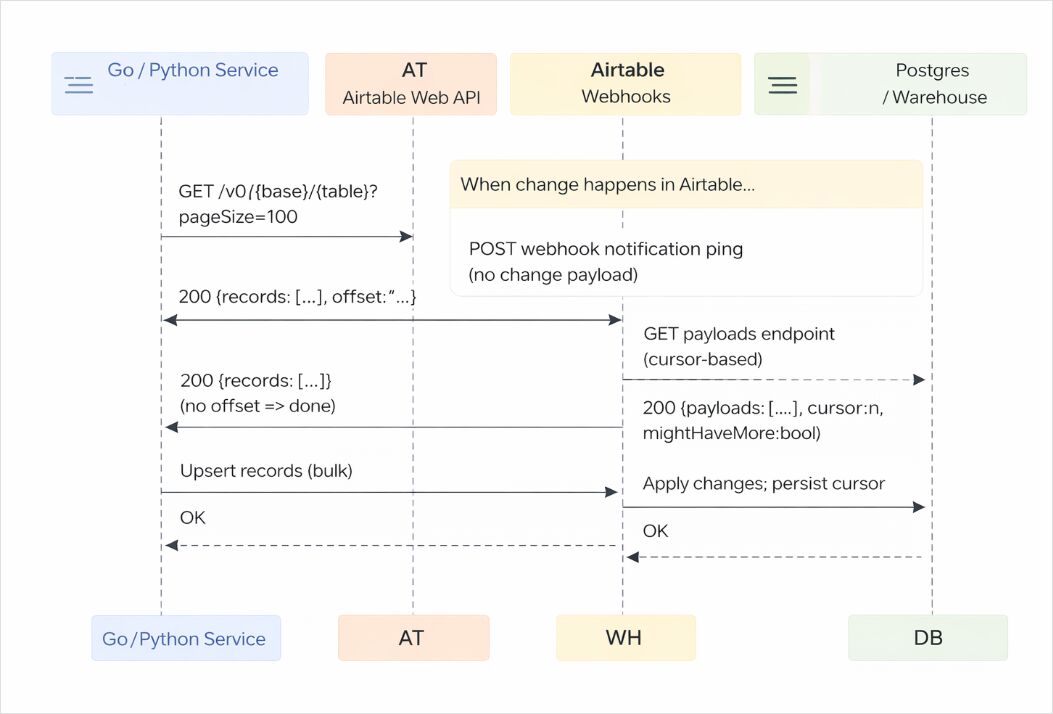

Paginazione: elenco record restituisce fino a 100 record per richiesta

Airtable documenta che le risposte “elenco record” sono paginate fino a 100 record alla volta; se la tabella ha più di 100, devi fare più richieste e utilizzare l’offset restituito come parametro di query della prossima richiesta.

Il parametro pageSize può ridurre la dimensione della pagina, ma 100 è il massimo.

Filtraggio e ordinamento: filterByFormula e parametri di query sort

Airtable fornisce esempi concreti sull’utilizzo di filterByFormula e sort[...] parametri, incluso un modello canonico di URL come:

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5

Limiti di velocità e strategia di riprova: trattare 429 come normale

La documentazione sui limiti di chiamate API di Airtable afferma:

5 richieste al secondo per base,

50 richieste al secondo per utente/account di servizio utilizzando traffico PAT,

e se superi, ricevi un 429 e devi attendere 30 secondi prima che le richieste successive abbiano successo.

La guida di risoluzione dei problemi di Airtable rafforza che 429 può significare che hai superato il limite di velocità di 5 richieste/base al secondo e consiglia di attendere prima di riprovare.

Batch: progetta intorno a “fino a 10 record per richiesta”

Airtable documenta esplicitamente il batching come strategia per i limiti di velocità: l’API “supporta il batching”, gestendo “fino a 10 record per richiesta”.

E Airtable’s “Aggiorna più record” endpoint dimostra la forma della richiesta batch (records: [...]) e supporta anche performUpsert con fieldsToMergeOn.

Diagramma di sequenza SEO: sequenza di chiamate API di Airtable per elenco → paginazione → aggiornamento batch → recupero payload webhook

Esempio Go: client REST di Airtable pronto per la produzione con paginazione, riprova e batching

Questo programma Go dimostra:

Autenticazione PAT tramite Authorization: Bearer ... (l’autenticazione Bearer è richiesta).

Paginazione elenco record utilizzando offset e pageSize (massimo 100).

Gestione limiti di velocità per 429 con fallback Retry-After e linee guida di Airtable “attendere 30 secondi”.

Aggiornamento batch utilizzando l’endpoint ufficiale PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName}.

Forma dell’endpoint di aggiornamento singolo record (semantica PATCH/PUT).

Esempio di filtro (filterByFormula) modello URL.

Requisiti di esecuzione: Go 1.21+ raccomandato; imposta

AIRTABLE_TOKEN,AIRTABLE_BASE_ID,AIRTABLE_TABLE.

// File: main.go

package main

import (

"bytes"

"context"

"encoding/json"

"errors"

"fmt"

"io"

"net/http"

"net/url"

"os"

"strconv"

"time"

)

type AirtableClient struct {

BaseID string

Token string

HTTPClient *http.Client

}

type airtableError struct {

Error interface{} `json:"error"`

}

type Record struct {

ID string `json:"id"`

CreatedTime string `json:"createdTime,omitempty"`

Fields map[string]interface{} `json:"fields"`

}

type listRecordsResponse struct {

Records []Record `json:"records"`

Offset string `json:"offset,omitempty"`

}

func mustEnv(key string) string {

v := os.Getenv(key)

if v == "" {

fmt.Fprintf(os.Stderr, "missing env var: %s\n", key)

os.Exit(2)

}

return v

}

func (c *AirtableClient) doJSON(ctx context.Context, method, rawURL string, body any, out any) (*http.Response, error) {

var reqBody io.Reader

if body != nil {

b, err := json.Marshal(body)

if err != nil {

return nil, fmt.Errorf("marshal body: %w", err)

}

reqBody = bytes.NewReader(b)

}

req, err := http.NewRequestWithContext(ctx, method, rawURL, reqBody)

if err != nil {

return nil, err

}

req.Header.Set("Authorization", "Bearer "+c.Token) // Bearer required

req.Header.Set("Content-Type", "application/json")

// Basic retry loop that treats 429 as normal. Airtable guidance: wait ~30s.

var lastResp *http.Response

for attempt := 0; attempt < 6; attempt++ {

resp, err := c.HTTPClient.Do(req)

if err != nil {

return nil, err

}

lastResp = resp

if resp.StatusCode != http.StatusTooManyRequests {

if out == nil {

return resp, nil

}

defer resp.Body.Close()

if resp.StatusCode < 200 || resp.StatusCode >= 300 {

b, _ := io.ReadAll(resp.Body)

return resp, fmt.Errorf("http %d: %s", resp.StatusCode, string(b))

}

if err := json.NewDecoder(resp.Body).Decode(out); err != nil {

return resp, fmt.Errorf("decode response: %w", err)

}

return resp, nil

}

// 429 handling

resp.Body.Close()

wait := 30 * time.Second // Airtable says wait 30 seconds before subsequent requests succeed

if ra := resp.Header.Get("Retry-After"); ra != "" {

if secs, err := strconv.Atoi(ra); err == nil && secs > 0 {

wait = time.Duration(secs) * time.Second

}

}

time.Sleep(wait)

// Rewind body for retry if needed (only safe because we used bytes.NewReader).

if reqBody != nil {

if seeker, ok := reqBody.(io.Seeker); ok {

_, _ = seeker.Seek(0, io.SeekStart)

}

}

}

return lastResp, errors.New("too many retries after 429")

}

// ListRecords paginates with offset; pageSize max 100

func (c *AirtableClient) ListRecords(ctx context.Context, table string, pageSize int, filterByFormula string) ([]Record, error) {

if pageSize <= 0 || pageSize > 100 {

pageSize = 100

}

var out []Record

var offset string

for {

u := url.URL{

Scheme: "https",

Host: "api.airtable.com",

Path: fmt.Sprintf("/v0/%s/%s", c.BaseID, table),

}

q := u.Query()

q.Set("pageSize", strconv.Itoa(pageSize))

if offset != "" {

q.Set("offset", offset)

}

if filterByFormula != "" {

// Example pattern in Airtable docs

q.Set("filterByFormula", filterByFormula)

}

u.RawQuery = q.Encode()

var page listRecordsResponse

_, err := c.doJSON(ctx, http.MethodGet, u.String(), nil, &page)

if err != nil {

return nil, err

}

out = append(out, page.Records...)

if page.Offset == "" {

return out, nil

}

offset = page.Offset

}

}

// UpdateMultiple demonstrates the official batch PATCH shape.

func (c *AirtableClient) UpdateMultiple(ctx context.Context, table string, records []Record) ([]Record, error) {

type reqBody struct {

Records []Record `json:"records"`

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

var resp struct {

Records []Record `json:"records"`

}

_, err := c.doJSON(ctx, http.MethodPatch, u, reqBody{Records: records}, &resp)

if err != nil {

return nil, err

}

return resp.Records, nil

}

// UpsertMultiple uses performUpsert (fieldsToMergeOn) on the batch update endpoint.

func (c *AirtableClient) UpsertMultiple(ctx context.Context, table string, mergeOn []string, records []Record) error {

body := map[string]any{

"performUpsert": map[string]any{

"fieldsToMergeOn": mergeOn,

},

"records": records,

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

_, err := c.doJSON(ctx, http.MethodPatch, u, body, nil)

return err

}

// UpdateRecord demonstrates single-record PATCH/PUT endpoint semantics.

func (c *AirtableClient) UpdateRecord(ctx context.Context, table, recordID string, fields map[string]any) (Record, error) {

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s/%s", c.BaseID, table, recordID)

body := map[string]any{"fields": fields}

var resp Record

_, err := c.doJSON(ctx, http.MethodPatch, u, body, &resp)

return resp, err

}

func chunk[T any](items []T, n int) [][]T {

if n <= 0 {

return [][]T{items}

}

var out [][]T

for i := 0; i < len(items); i += n {

j := i + n

if j > len(items) {

j = len(items)

}

out = append(out, items[i:j])

}

return out

}

func main() {

ctx, cancel := context.WithTimeout(context.Background(), 60*time.Second)

defer cancel()

token := mustEnv("AIRTABLE_TOKEN")

baseID := mustEnv("AIRTABLE_BASE_ID")

table := mustEnv("AIRTABLE_TABLE")

c := &AirtableClient{

BaseID: baseID,

Token: token,

HTTPClient: &http.Client{

Timeout: 30 * time.Second,

},

}

// Example: list all records filtered by formula (adapt formula to your schema).

records, err := c.ListRecords(ctx, table, 100, "")

if err != nil {

panic(err)

}

fmt.Printf("listed %d records\n", len(records))

// Example: batch update in chunks (Airtable supports batching as a strategy, up to 10 records per request).

// Here we update at most 10 at a time.

var updates []Record

for i := 0; i < len(records) && i < 3; i++ {

updates = append(updates, Record{

ID: records[i].ID,

Fields: map[string]any{

"Visited": true,

},

})

}

for _, part := range chunk(updates, 10) {

updated, err := c.UpdateMultiple(ctx, table, part)

if err != nil {

panic(err)

}

fmt.Printf("updated %d records\n", len(updated))

}

}

Esempio Python: integrazione Airtable con requests e un ricevitore webhook

Questa implementazione Python include:

Chiamate REST dirette con autenticazione Bearer.

Paginazione con offset e pageSize (massimo 100).

Gestione 429 allineata alle linee guida di Airtable (attendere ~30 secondi).

Aggiornamento batch con la forma ufficiale dell’endpoint update-multiple e performUpsert.

Comportamento del ricevitore webhook che riconosce: i ping webhook non includono il payload del cambiamento, quindi devi recuperare i payload separatamente, e i payload sono conservati per 7 giorni; i webhook possono scadere dopo 7 giorni a meno che non vengano aggiornati.

Nota: I dettagli dell’endpoint “List webhook payloads” di Airtable sono riferiti nella guida dei webhook di Airtable, ma il testo pubblico più affidabile è la guida stessa e gli esempi della comunità. I vincoli comportamentali della guida (nessun payload nel ping, conservazione, scadenza) sono i fatti operativi critici.

# File: airtable_client.py

import os

import time

import json

import typing as t

import requests

from urllib.parse import urlencode

AIRTABLE_TOKEN = os.environ["AIRTABLE_TOKEN"]

AIRTABLE_BASE_ID = os.environ["AIRTABLE_BASE_ID"]

AIRTABLE_TABLE = os.environ["AIRTABLE_TABLE"]

SESSION = requests.Session()

SESSION.headers.update({

"Authorization": f"Bearer {AIRTABLE_TOKEN}", # Bearer auth required

"Content-Type": "application/json",

})

def _airtable_request(method: str, url: str, *, params=None, json_body=None, max_retries: int = 5) -> requests.Response:

for attempt in range(max_retries + 1):

resp = SESSION.request(method, url, params=params, json=json_body, timeout=30)

if resp.status_code != 429:

return resp

# Airtable guidance: wait ~30s after 429

retry_after = resp.headers.get("Retry-After")

wait = 30

if retry_after and retry_after.isdigit():

wait = int(retry_after)

time.sleep(wait)

raise RuntimeError(f"Too many retries after 429 for {method} {url}")

def list_records(page_size: int = 100, filter_by_formula: str | None = None) -> list[dict]:

# pageSize max is 100

page_size = min(max(page_size, 1), 100)

base_url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

all_records: list[dict] = []

offset: str | None = None

while True:

params = {"pageSize": page_size}

if offset:

params["offset"] = offset

if filter_by_formula:

# Example pattern documented by Airtable

params["filterByFormula"] = filter_by_formula

resp = _airtable_request("GET", base_url, params=params)

resp.raise_for_status()

data = resp.json()

all_records.extend(data.get("records", []))

offset = data.get("offset")

if not offset:

break

return all_records

def update_multiple_records(records: list[dict], perform_upsert_fields: list[str] | None = None) -> dict:

"""

Uses PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName}

with body { "records": [ { "id": "...", "fields": {...} }, ... ] }

and optional performUpsert, per Airtable docs.

"""

url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

body: dict[str, t.Any] = {"records": records}

if perform_upsert_fields:

body["performUpsert"] = {"fieldsToMergeOn": perform_upsert_fields}

resp = _airtable_request("PATCH", url, json_body=body)

resp.raise_for_status()

return resp.json()

def webhook_receiver_example():

"""

Minimal pattern; in production, use Flask/FastAPI and validate signatures.

Airtable webhooks guide notes:

- Notification ping DOES NOT include the change payload

- Payload must be fetched from the GET payloads endpoint

- Payloads retained 7 days

- Webhooks created via PAT/OAuth expire after 7 days unless refreshed/listed

"""

pass

if __name__ == "__main__":

rows = list_records(page_size=100)

print(f"Fetched {len(rows)} records")

# Example: update first 2 records (chunk in 10s; Airtable supports batching up to 10 records/request as a strategy).

updates = []

for r in rows[:2]:

updates.append({"id": r["id"], "fields": {"Visited": True}})

if updates:

result = update_multiple_records(updates)

print(json.dumps(result, indent=2))

Ricevitore webhook: persistenza del cursore e “nessun payload nel ping”

Per un ricevitore webhook di produzione, i tuoi compiti principali sono:

Restituire una rapida risposta di successo (es. HTTP 204).

Persistere il cursore del webhook in modo che non rielabori i payload vecchi.

Recuperare i payload dopo i ping; la guida dei webhook avverte che l’ordine dei ping non è garantito, ma l’elenco dei payload ha un ordine stabile.

Comprendere conservazione e scadenza: i payload sono conservati 7 giorni; i webhook creati con PAT/OAuth scadono dopo 7 giorni a meno che non vengano aggiornati (elencando i payload può estendere la vita).

Progettare il tuo worker di sincronizzazione in modo che non perda eventi se un ping viene perso: l’approccio “recupera i payload tramite cursore” è il tuo meccanismo duraturo.

Se non vuoi gestire la complessità dell’API Webhook, Airtable stesso suggerisce che alcuni casi d’uso potrebbero essere “più semplici” utilizzando un’Automazione con “Esegui uno script” per fare una richiesta POST al tuo endpoint.

Note di deployment: CI/CD, infrastruttura come codice, sicurezza e backup

CI/CD e sicurezza del rilascio

Tratta le integrazioni di Airtable come qualsiasi altra dipendenza di produzione:

Testa unitariamente il tuo layer di mapping (campo Airtable ↔ modello di dominio).

Aggiungi test contrattuali contro una “base sandbox” dedicata in modo che i cambiamenti di schema vengano rilevati presto.

Monitora i 429 e la latenza; 429 è normale sotto carichi burst perché Airtable impone 5 richieste/sec/base.

Infrastruttura come codice: deploy dell’integrazione, non del foglio di calcolo

Airtable stesso è SaaS, ma il tuo servizio di integrazione può essere deployato con Terraform (AWS Lambda + API Gateway ricevitore webhook, GCP Cloud Run, Kubernetes, ecc.). L’attenzione principale su IaC è solitamente:

Networking per il ricevitore webhook in entrata

Distribuzione dei segreti (PAT in un gestore dei segreti; iniettato a runtime)

Job programmati (cron) per sincronizzazioni periodiche

Osservabilità (log/metriche)

Sicurezza: tieni i token server-side, usa il privilegio minimo, ruota

La documentazione dell’API Enterprise di Airtable avverte che le richieste che espongono i token non devono essere fatte client-side perché i token verrebbero esposti; la norma sicura è richiedere le richieste server-side.

La README ufficiale del client JS di Airtable avverte anche di non mettere le chiavi API su pagine web e suggerisce di utilizzare account separati/accesso condiviso se necessario.

Combinando questo con lo scoping PAT (solo azioni richieste + solo basi richieste) ottieni una postura pratica di privilegio minimo.

Backup e recupero da disastri: non affidarti alla breve storia delle revisioni

La storia delle revisioni del piano Free è due settimane, Team/Business sono un anno.

Se Airtable è critico per l’azienda, implementa:

Snapshots di esportazione basati sull’API in archiviazione oggetti (giornalieri)

Replicazione in un data store duraturo (Postgres/warehouse)

Ingestione basata su cursore dei webhook dove applicabile, comprendendo che la conservazione dei payload è 7 giorni.

Lunghezza URL e complessità filtro: pianifica il fallback POST

Airtable impone un limite di lunghezza URL di 16.000 caratteri per le richieste Web API e raccomanda workaround; notevolmente, afferma che esiste una versione POST dell’endpoint GET list table records per mettere le opzioni nel corpo della richiesta invece che nei parametri di query.

Questo è rilevante se il tuo pipeline DevOps costruisce espressioni complesse filterByFormula o lunghi sort/field lists.

Progettando intorno ai limiti del piano Free, limiti standard di velocità e cattura dei cambiamenti basata su cursore, Airtable può essere un’interfaccia “ops UI + superficie di integrazione” estremamente efficace per team DevOps e focalizzati su AI - specialmente quando abbinato a un data store duraturo per scalabilità e auditabilità.