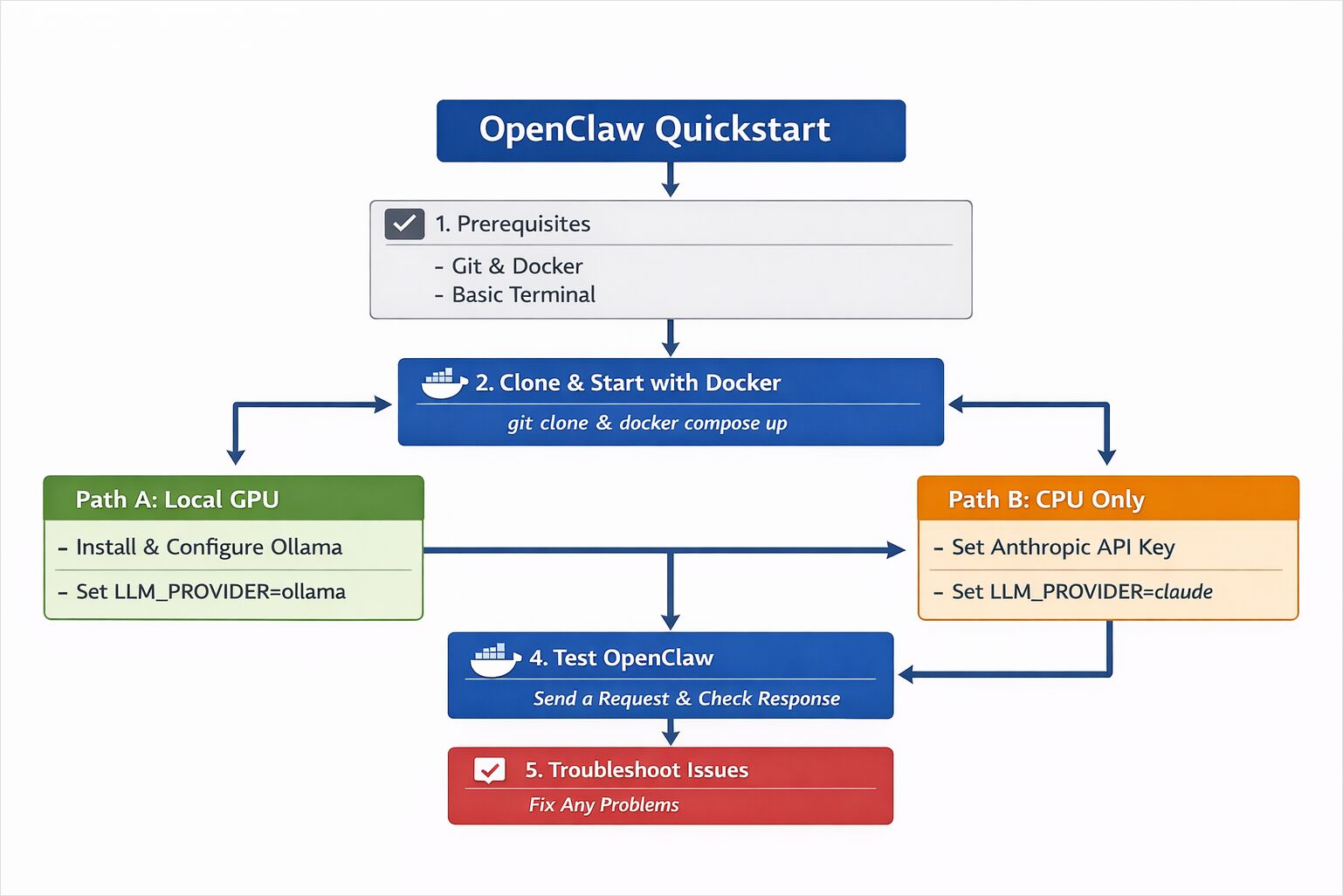

OpenClaw Quickstart: Installazione con Docker (Ollama GPU o Claude CPU)

Installa OpenClaw localmente con Ollama

OpenClaw è un assistente AI autoospitato progettato per funzionare con runtime locale LLM come Ollama o con modelli basati su cloud come Claude Sonnet.

Questo quickstart mostra come distribuire OpenClaw utilizzando Docker, configurare un modello locale alimentato da GPU o un modello su CPU basato su cloud, e verificare che il tuo assistente AI funzioni in modo end-to-end.

Questo documento guida attraverso un setup minimo di OpenClaw in modo che tu possa vederlo funzionare e rispondere sulla tua macchina.

L’obiettivo è semplice:

- Far funzionare OpenClaw.

- Inviare una richiesta.

- Confermare che funziona.

Questo non è un documento per la messa in produzione. Questo non è un documento per l’ottimizzazione delle prestazioni. Questo è un punto di partenza pratico.

Hai due opzioni:

- Percorso A — GPU locale utilizzando Ollama (raccomandato se hai una GPU)

- Percorso B — Solo CPU utilizzando Claude Sonnet 4.6 tramite API di Anthropic

Entrambi i percorsi condividono lo stesso processo di installazione principale.

Se sei nuovo di OpenClaw e desideri un’overview più approfondita su come è strutturato il sistema, leggi il panoramica del sistema OpenClaw.

Requisiti del sistema e configurazione dell’ambiente

OpenClaw è un sistema di tipo assistente che può connettersi a servizi esterni. Per questo Quickstart:

- Utilizza account di test quando possibile.

- Evita di collegare sistemi sensibili in produzione.

- Esegui il tutto all’interno di Docker (raccomandato).

L’isolamento è un buon default quando si sperimenta con software di tipo agente.

Requisiti di OpenClaw (GPU con Ollama o CPU con Claude)

Richiesti per entrambi i percorsi

- Git

- Docker Desktop (o Docker + Docker Compose)

- Un terminale

Per il Percorso A (GPU locale)

- Una macchina con una GPU compatibile (NVIDIA o AMD raccomandate)

- Ollama installato

Per il Percorso B (CPU + modello su cloud)

- Una chiave API di Anthropic

- Accesso a Claude Sonnet 4.6

Passo 1 — Installare OpenClaw con Docker (Clona & Avvia)

OpenClaw può essere avviato utilizzando Docker Compose. Questo mantiene l’installazione contenuta e riproducibile.

Clona il repository

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Copia la configurazione dell’ambiente

cp .env.example .env

Apri .env nel tuo editor. Lo configureremo nel passo successivo

in base al percorso del modello che sceglierai.

Avvia i container

docker compose up -d

Se tutto parte correttamente, dovresti vedere i container in esecuzione:

docker ps

A questo punto, OpenClaw è in esecuzione — ma non è ancora connesso a un modello.

Passo 2 — Configura il fornitore LLM (Ollama GPU o Claude CPU)

Ora decidi come desideri che l’inferenza funzioni.

Percorso A — GPU locale con Ollama

Se hai una GPU disponibile, questa è l’opzione più semplice e più autonoma.

Installa o Verifica Ollama

Se hai bisogno di una guida di installazione più dettagliata o se desideri configurare le posizioni di archiviazione dei modelli, vedi:

- Installare Ollama e Configurare la Posizione dei Modelli

- Ollama CLI Cheatsheet: ls, serve, run, ps + altri comandi (aggiornamento 2026)

Se Ollama non è installato:

curl -fsSL https://ollama.com/install.sh | sh

Verifica che funzioni:

ollama pull llama3

ollama run llama3

Se il modello risponde, l’inferenza funziona.

Configura OpenClaw per utilizzare Ollama

Nel tuo file .env, configura:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Riavvia i container:

docker compose restart

OpenClaw utilizzerà ora le richieste per la tua istanza locale di Ollama.

Se stai decidendo quale modello eseguire su una GPU con 16GB di VRAM o se desideri confronti di benchmark, vedi:

Per comprendere la concorrenza e il comportamento della CPU sotto carico:

- Come Ollama Gestisce le Richieste Parallele

- Test: Come Ollama utilizza le Prestazioni della CPU Intel e i Core Efficienti

Percorso B — Solo CPU utilizzando Claude Sonnet 4.6

Se non hai una GPU, puoi utilizzare un modello ospitato.

Aggiungi la tua chiave API

Nel tuo file .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Riavvia:

docker compose restart

OpenClaw utilizzerà ora Claude Sonnet 4.6 per l’inferenza, mentre l’orchestrazione avviene localmente.

Questo setup funziona bene su macchine con solo CPU perché i calcoli pesanti del modello avvengono in cloud.

Passo 3 — Testa OpenClaw con il primo prompt

Una volta che i container sono in esecuzione e il modello è configurato, puoi testare l’assistente.

A seconda del tuo setup, potrebbe essere attraverso:

- Un’interfaccia web

- Un’integrazione di messaggistica

- Un endpoint API locale

Per un test API base:

curl http://localhost:3000/health

Dovresti vedere una risposta di stato sana.

Ora invia un prompt semplice:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Spiega cosa fa OpenClaw in termini semplici."}'

Se ricevi una risposta strutturata, il sistema funziona.

Cosa Hai Appena Eseguito

A questo punto, hai:

- Un’istanza OpenClaw in esecuzione

- Un fornitore LLM configurato (locale o cloud)

- Un ciclo di richiesta-risposta funzionante

Se hai scelto il percorso GPU, l’inferenza avviene localmente tramite Ollama.

Se hai scelto il percorso CPU, l’inferenza avviene tramite Claude Sonnet 4.6, mentre l’orchestrazione, il routing e il gestione della memoria avvengono all’interno dei tuoi container Docker locali.

L’interazione visibile potrebbe sembrare semplice. Sotto, diversi componenti si coordinano per processare la tua richiesta.

Risoluzione dei Problemi di Installazione e Funzionamento di OpenClaw

Modello Non Risponde

- Verifica la configurazione del tuo file

.env. - Controlla i log dei container:

docker compose logs

Ollama Non Raggiungibile

- Conferma che Ollama sia in esecuzione:

ollama list

- Assicurati che l’URL base corrisponda al tuo ambiente.

Chiave API Non Valida

- Verifica nuovamente

ANTHROPIC_API_KEY - Riavvia i container dopo aver aggiornato

.env

GPU Non Utilizzata

- Conferma che i driver della GPU siano installati.

- Assicurati che Docker abbia accesso abilitato alla GPU.

Passi Successivi Dopo l’Installazione di OpenClaw

Ora hai un’istanza OpenClaw funzionante.

Da qui, puoi:

- Collegare piattaforme di messaggistica

- Abilitare la ricerca di documenti

- Sperimentare con strategie di routing

- Aggiungere osservabilità e metriche

- Ottimizzare le prestazioni e il comportamento dei costi

Le discussioni architettoniche più approfondite acquistano senso una volta che il sistema è in esecuzione.

Farlo funzionare è il primo passo.