Construyendo un BFF de GraphQL con Apollo Server

Optimice las APIs del frontend con GraphQL BFF y Apollo Server

El patrón Backend for Frontend (BFF) combinado con GraphQL y Apollo Server crea una arquitectura poderosa para aplicaciones web modernas.

Optimice las APIs del frontend con GraphQL BFF y Apollo Server

El patrón Backend for Frontend (BFF) combinado con GraphQL y Apollo Server crea una arquitectura poderosa para aplicaciones web modernas.

Comandos de Elasticsearch para búsqueda, indexación y análisis

Elasticsearch es un potente motor de búsqueda y análisis distribuido construido sobre Apache Lucene. Esta hoja de referencia integral cubre los comandos esenciales, las mejores prácticas y referencias rápidas para trabajar con clústeres de Elasticsearch.

Construya servidores MCP para asistentes de IA con ejemplos en Python

El Protocolo de Contexto del Modelo (MCP) está revolucionando la forma en que los asistentes de IA interactúan con fuentes de datos externas y herramientas. En esta guía, exploraremos cómo construir servidores MCP en Python, con ejemplos centrados en las capacidades de búsqueda en la web y raspado.

Referencia rápida para comandos de Docker Model Runner

Docker Model Runner (DMR) es la solución oficial de Docker para ejecutar modelos de IA localmente, introducida en abril de 2025. Esta guía rápida proporciona una referencia rápida para todos los comandos esenciales, configuraciones y mejores prácticas.

Compare Docker Model Runner y Ollama para LLM local

Correr modelos de lenguaje grandes (LLMs) localmente ha ganado popularidad cada vez mayor por razones de privacidad, control de costos y capacidades fuera de línea. El paisaje cambió significativamente en abril de 2025 cuando Docker introdujo Docker Model Runner (DMR), su solución oficial para la implementación de modelos de IA.

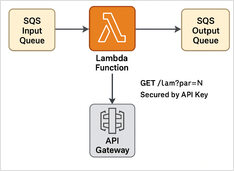

Ejemplo paso a paso

Aquí tenemos un ejemplo de Lambda en Python para procesador de mensajes SQS + API REST con protección mediante clave API + Terraform script para desplegarlo en ejecución sin servidor.

+ Ejemplos Específicos Utilizando LLMs de Pensamiento

En este post, exploraremos dos formas de conectar tu aplicación Python a Ollama: 1. A través de HTTP REST API; 2. A través de la biblioteca oficial de Python de Ollama.

Las APIs ligeramente diferentes requieren un enfoque especial.

Aquí tienes una comparación lado a lado del soporte de salida estructurada (obtención de JSON confiable) en los principales proveedores de LLM, junto con ejemplos mínimos en Python.