Modelo de IA Flux de texto a imagen

Novedoso modelo de IA para generar imágenes a partir de texto

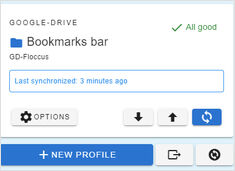

Recientemente, Black Forest Labs publicó un conjunto de modelos de IA de texto a imagen. Estos modelos se dicen que tienen una calidad de salida mucho mayor. Probémoslos