Farfalle frente a Perplexica

Comparando dos motores de búsqueda de IA autoalojados

La comida increíble también es un placer para la vista. Pero en esta entrada compararemos dos sistemas de búsqueda basados en IA, Farfalle y Perplexica.

Por cierto, esta forma de pasta también se llama “farfalle”.

Pero aquí solo estoy comparando cómo se comportan estos dos sistemas. No las formas de pasta.

¡De acuerdo! ¡Concentrémonos!

Por favor, vea también: Instalación y configuración de Perplexica - con ollama y Instalar y configurar Ollama.

El motor de respuestas que este artículo etiqueta como Perplexica ahora se distribe como Vane; Inicio rápido de Vane (Perplexica 2.0) con Ollama y llama.cpp es el lugar donde buscar las imágenes Docker actuales, la conexión con SearxNG y el cronograma del cambio de nombre.

Perplexica

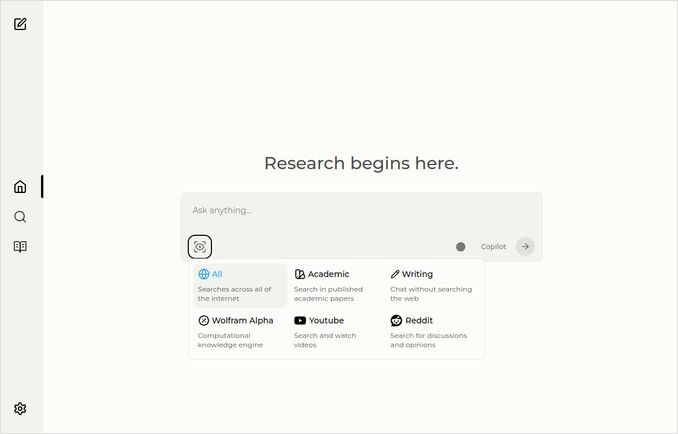

Aquí está la página de inicio con el menú desplegable de selección de fuentes.

- Perplexica está implementado en:

- TypeScript y React.Js (UI)

- TypeScript y Express.Js (Backend)

- También incluye la configuración para el motor de metabúsqueda SearxNG

- Tiene un modo Copilot

- Tiene la capacidad de utilizar cualquier LLM alojado en Ollama como modelo de chat o de incrustaciones (embeddings)

- Tiene tres modelos de incrustación internos pequeños

Farfalle

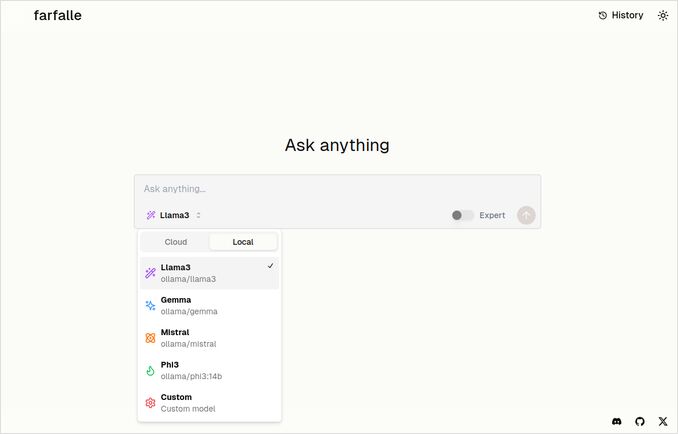

- Farfalle está implementado en:

- TypeScript y React.Js (UI)

- Python Fastapi (Backend)

- También incluye una referencia para el motor de metabúsqueda SearxNG. No hay mucha configuración para esto, es una imagen Docker bastante estándar.

- Tiene un modo Experto que debería preparar varias solicitudes a partir de la original y combinar las respuestas. Pero esto no funcionó en nuestra prueba.

- Tiene la capacidad de utilizar cuatro LLMs alojados en Ollama como modelo de chat (llama3, mistral, gemma, phi3). Ese es un buen conjunto de opciones, pero preferiría que fuera más flexible y permitiera usar cualquier modelo que Ollama sirva.

- No hay opciones para el modelo de incrustaciones

Comparación realizada por Perplexica y Farfalle ellos mismos

He ejecutado la misma solicitud: Comparar Farfalle y Perplexica basándose en robustez, comunidad, soporte y LLM soportados

Tanto Perplexica como Farfalle estaban utilizando el modelo llama3 alojado en ollama local. El nombre completo del modelo es llama3 8b q4.

No creas el 100% de lo que dicen las respuestas, solo mira la longitud del texto, la estructura y la calidad general de la respuesta.

Yo creería aproximadamente el 70%…

Respuesta de comparación de Perplexica

Comparación de Farfalle y Perplexica

Robustez

Farfalle: 8/10 - Farfalle es un motor de búsqueda de IA popular conocido por su fiabilidad y capacidad para manejar consultas complejas. Tiene una base sólida en procesamiento de lenguaje natural (NLP) y aprendizaje automático (ML). Aunque puede que no sea perfecto, la robustez de Farfalle está bien establecida.

Perplexica: 9/10 - Perplexica se construye sobre el modelo Phi-3 de Meta AI, diseñado para ser robusto. Se ha probado para proporcionar respuestas precisas incluso cuando se enfrenta a consultas ambiguas o poco claras. Su capacidad para parafrasear preguntas y adaptarse a diferentes contextos lo convierte en un motor de búsqueda robusto.

Comunidad

Farfalle: 7/10 - Farfalle tiene una comunidad dedicada de usuarios que aprecian sus capacidades. Aunque puede que no tenga el mismo nivel de adopción que Perplexica, la base de usuarios de Farfalle sigue siendo significativa.

Perplexica: 8.5/10 - Perplexica ha ganado un reconocimiento generalizado por su enfoque innovador a los motores de búsqueda. Su comunidad está creciendo rápidamente, con muchos usuarios que aprecian su capacidad para proporcionar resultados precisos y relevantes.

Soporte

Farfalle: 6.5/10 - Farfalle proporciona soporte básico a través de preguntas frecuentes, documentación y foros. Aunque no es tan completo como el soporte de Perplexica, la base de usuarios de Farfalle es generalmente autosuficiente.

Perplexica: 9/10 - Perplexica ofrece extensos recursos de soporte, incluyendo documentación detallada, preguntas frecuentes y foros de la comunidad. Sus desarrolladores están activamente involucrados con la comunidad, asegurando que los usuarios reciban asistencia oportuna y efectiva.

LLMs Soportados

Farfalle: No - Farfalle es un motor de búsqueda de IA independiente que no depende de modelos de lenguaje grandes (LLMs) para sus capacidades.

Perplexica: Sí - Perplexica se construye sobre el modelo Phi-3 de Meta AI, que es un LLM. Esto permite a Perplexica aprovechar el poder del aprendizaje profundo para resultados más precisos y relevantes.

Puntuación General Farfalle: 22/30 Perplexica: 34.5/40

Basado en estos criterios, Perplexica parece tener una ligera ventaja sobre Farfalle en términos de robustez, soporte de la comunidad e integración de LLM. Sin embargo, ambos motores de búsqueda tienen sus fortalezas y la elección depende en última instancia de tus necesidades y preferencias específicas.

Recomendación Si buscas un motor de búsqueda de IA fiable con fuertes capacidades de NLP, Perplexica podría ser la mejor opción. Si prefieres un enfoque más directo y sin adornos para la búsqueda, Farfalle aún podría proporcionar excelentes resultados.

Respuesta de comparación de Farfalle

Comparación de Farfalle y Perplexica

Farfalle y Perplexica son dos motores de búsqueda impulsados por IA que han ganado atención en tiempos recientes. Aquí hay una comparación de estos dos proyectos basada en robustez, comunidad, soporte y soporte de LLM (Modelo de Lenguaje Grande).

Robustez

- Farfalle está diseñado para ser autoalojado con LLMs locales o en la nube, lo que lo hace una opción más robusta para los usuarios que quieren controlar su motor de búsqueda.

- Por otro lado, Perplexica es una alternativa de código abierto a Perplexity AI y está siendo mejorada constantemente por sus desarrolladores.

Comunidad

- Perplexica tiene una comunidad dedicada de desarrolladores y usuarios que contribuyen a su desarrollo y proporcionan soporte.

- La comunidad de Farfalle es más pequeña, pero aún tiene presencia en GitHub.

Soporte

- Perplexica ofrece actualizaciones y mejoras regulares, así como un canal de Discord para discutir temas fuera del soporte regular.

- El soporte de Farfalle se limita a problemas y solicitudes de extracción (pull requests) en GitHub.

Soporte de LLM Tanto Farfalle como Perplexica soportan LLMs. Perplexica usa Ollama, un LLM local, mientras que Farfalle soporta LLMs tanto locales como en la nube.

En resumen, Farfalle es más robusto debido a su diseño autoalojado, mientras que Perplexica tiene una comunidad más fuerte y mejor soporte. Ambos proyectos soportan LLMs, pero Perplexica usa específicamente Ollama.

Conclusión

¿Cuál es la diferencia entre Perplexica y Farfalle?

La respuesta:

- Dejando de lado algunos errores fácticos, ambos sistemas creen que Perplexica es mejor que Farfalle, con lo cual yo estaría de acuerdo.

- Me gusta mucho la interfaz de usuario de Farfalle, aunque están bastante cerca.

- Me gusta la idea del modo experto de Farfalle, aunque no funcionó en mi entorno.

- Me encontré con 3 errores al ejecutar Farfalle. El código de Perplexica está más pulido.

- Una vez configurado, Perplexica funcionó sin ningún error.

- Perplexica permite usar cualquier modelo alojado en Ollama. Y Farfalle permite usar solo Gemma, Llama3, Mistral y Phi3 (versiones predefinidas, que son un poco anticuadas).

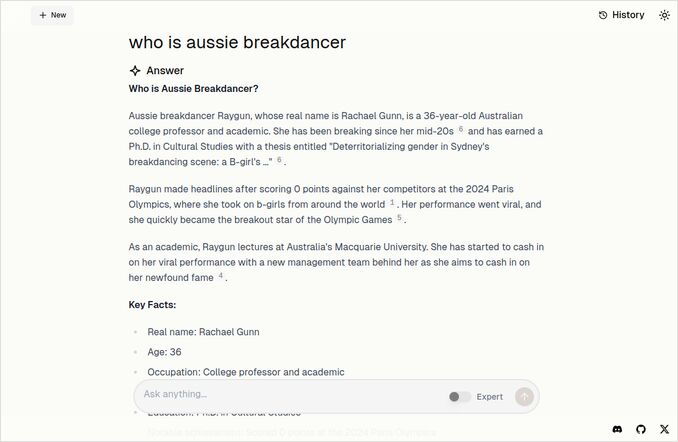

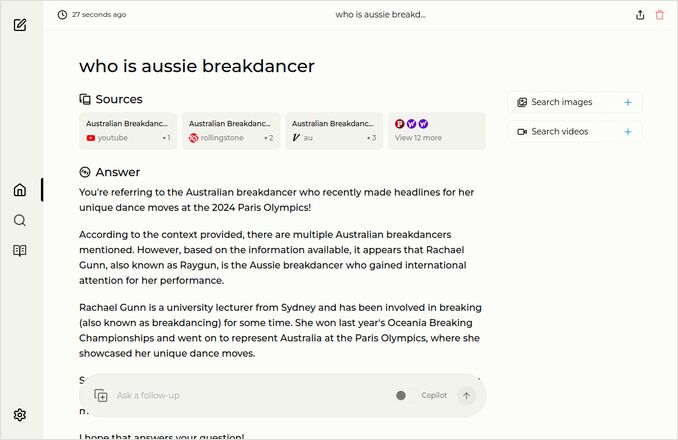

- Me gustan más las respuestas de Farfalle. Mira la imagen de Farfalle a continuación. Directo al grano sin esos “Según el contexto proporcionado”…

Más ejemplos

Estos muestran respuestas a la misma pregunta sobre un bailarín de breakdance australiano. Ya sabes, el que tiene un PhD, obtuvo 0 (Cero) puntos y probablemente hizo que se eliminara el breakdancing del programa de los Juegos Olímpicos.

Respuesta de Farfalle

Respuesta de Perplexica

Si lees hacia arriba (o hacia abajo) este último párrafo, gracias por tener los mismos intereses que yo. Son tiempos realmente emocionantes. ¡Que tengas un gran día!

Enlaces útiles

- Búsqueda vs Búsqueda Profunda vs Investigación Profunda

- Prueba: Cómo Ollama utiliza el Rendimiento de CPU Intel y Núcleos Eficientes

- Cómo Ollama Maneja Solicitudes Paralelas

- Autoalojamiento de Perplexica - con Ollama

- Comparando Capacidades de Resumen de LLM

- Escribir prompts efectivos para LLMs

- Prueba de detección de falacias lógicas por nuevos LLMs: gemma2, qwen2 y mistral Nemo

- Hoja de trucos de Ollama

- Hoja de trucos de Markdown

- Proveedores de LLM en la Nube

- Modelos de Incrustación y Reranker de Qwen3 en Ollama: Rendimiento de Estado del Arte