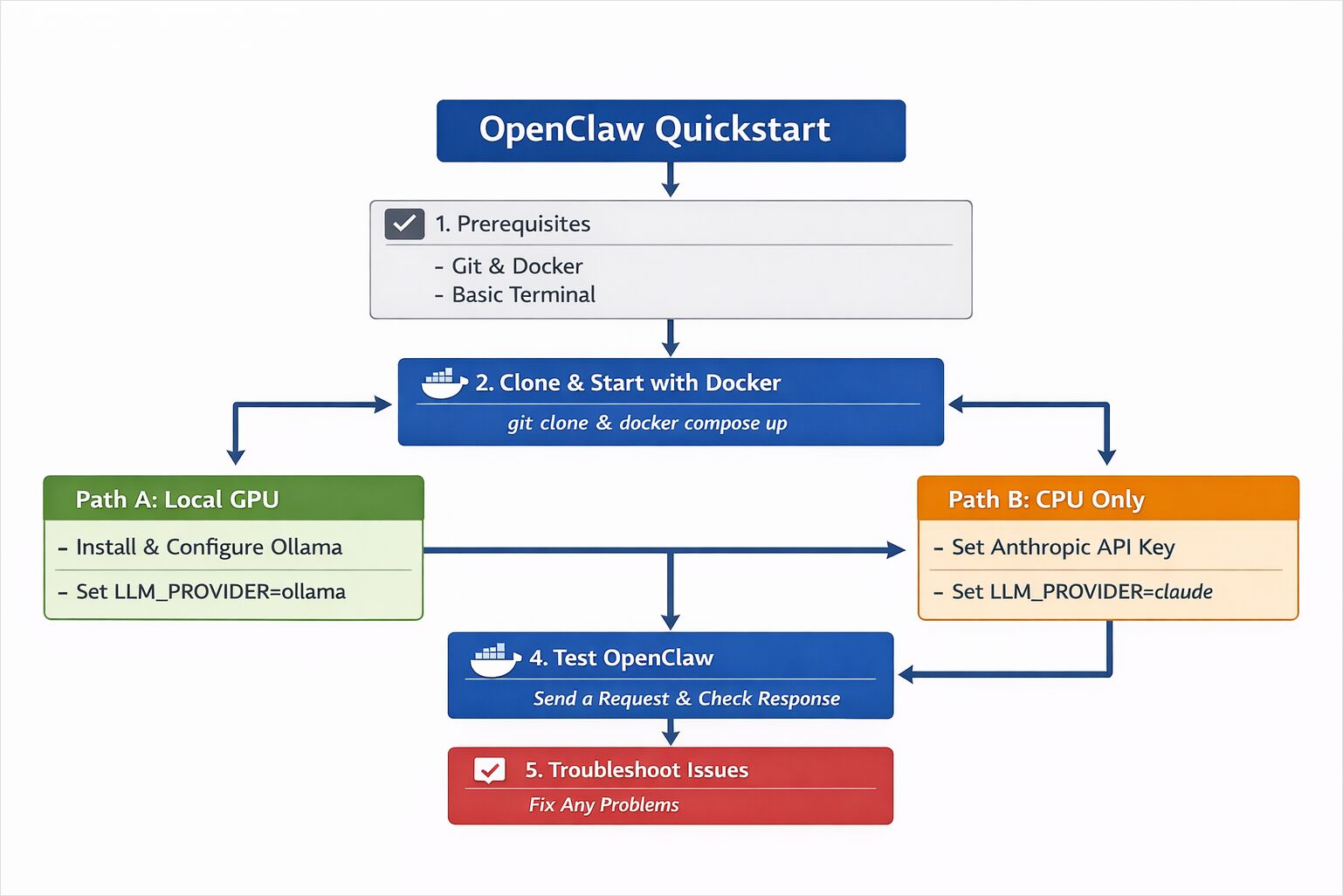

OpenClaw Quickstart: Установка с Docker (Ollama GPU или Claude CPU)

Установите OpenClaw локально с Ollama

OpenClaw — это самоуправляемый AI-ассистент, предназначенный для работы с локальными LLM-движками, такими как Ollama, или с облачными моделями, такими как Claude Sonnet.

Это руководство по быстрому старту показывает, как развернуть OpenClaw с помощью Docker, настроить либо локальную модель с поддержкой GPU, либо облачную модель только для CPU, а также проверить работоспособность вашего AI-ассистента от начала до конца.

Это руководство поможет вам установить минимальную конфигурацию OpenClaw, чтобы вы могли увидеть его работу и получить ответы на своем устройстве.

Цель проста:

- Запустить OpenClaw.

- Отправить запрос.

- Подтвердить его работоспособность.

Это не руководство по усилению системы для продакшена. Это не руководство по настройке производительности. Это практическая отправная точка.

У вас есть два варианта:

- Путь А — Локальный GPU с использованием Ollama (рекомендуется, если у вас есть GPU)

- Путь Б — Только CPU с использованием Claude Sonnet 4.6 через API Anthropic

Оба пути используют одинаковый базовый процесс установки.

Если вы новичок в OpenClaw и хотите получить более глубокое представление о структуре системы, прочитайте обзор системы OpenClaw.

Требования к системе и настройка среды

OpenClaw — это система типа ассистента, которая может подключаться к внешним сервисам. Для этого быстрого старта:

- Используйте тестовые аккаунты, где это возможно.

- Избегайте подключения к чувствительным продакшен-системам.

- Запускайте его внутри Docker (рекомендуется).

Изоляция — хорошая отправная точка при экспериментах с программным обеспечением типа агентов.

Предварительные требования OpenClaw (GPU с Ollama или CPU с Claude)

Требуется для обоих путей

- Git

- Docker Desktop (или Docker + Docker Compose)

- Терминал

Для пути А (Локальный GPU)

- Устройство с совместимым GPU (рекомендуется NVIDIA или AMD)

- Установленный Ollama

Для пути Б (CPU + Облачная модель)

- Ключ API Anthropic

- Доступ к Claude Sonnet 4.6

Шаг 1 — Установка OpenClaw с Docker (Клонирование и запуск)

OpenClaw можно запустить с помощью Docker Compose. Это позволяет содержать настройку и делать её воспроизводимой.

Клонирование репозитория

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Копирование конфигурации окружения

cp .env.example .env

Откройте .env в вашем редакторе. Мы настроим его на следующем шаге в зависимости от выбранного вами пути модели.

Запуск контейнеров

docker compose up -d

Если всё запускается правильно, вы должны увидеть работающие контейнеры:

docker ps

На этом этапе OpenClaw работает — но он ещё не подключен к модели.

Шаг 2 — Настройка поставщика LLM (Ollama GPU или Claude CPU)

Теперь решите, как вы хотите, чтобы работала инференция.

Путь А — Локальный GPU с Ollama

Если у вас есть доступный GPU, это самый простой и самодостаточный вариант.

Установка или проверка Ollama

Если вам нужна более подробная инструкция по установке или вы хотите настроить расположение моделей, см.:

- Установка Ollama и настройка расположения моделей

- Шпаргалка по CLI Ollama: ls, serve, run, ps + другие команды (обновление 2026)

Если Ollama не установлен:

curl -fsSL https://ollama.com/install.sh | sh

Проверьте его работу:

ollama pull llama3

ollama run llama3

Если модель отвечает, инференция работает.

Настройка OpenClaw для использования Ollama

В вашем файле .env настройте:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Перезапустите контейнеры:

docker compose restart

Теперь OpenClaw будет перенаправлять запросы на вашу локальную инстанцию Ollama.

Если вы решаете, какую модель запускать на GPU с 16ГБ видеопамяти или хотите сравнить производительность, см.:

Чтобы понять параллелизм и поведение CPU под нагрузкой:

- Как Ollama обрабатывает параллельные запросы

- Тест: Как Ollama использует производительность Intel CPU и эффективные ядра

Путь Б — Только CPU с использованием Claude Sonnet 4.6

Если у вас нет GPU, вы можете использовать хостинговую модель.

Добавление вашего ключа API

В вашем файле .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Перезапустите:

docker compose restart

Теперь OpenClaw будет использовать Claude Sonnet 4.6 для инференции, в то время как оркестрация будет выполняться локально.

Эта настройка хорошо работает на устройствах только с CPU, так как тяжёлые вычисления модели происходят в облаке.

Шаг 3 — Тестирование OpenClaw с первым запросом

Как только контейнеры запущены и модель настроена, вы можете протестировать ассистента.

В зависимости от вашей настройки это может быть через:

- Веб-интерфейс

- Интеграцию с мессенджером

- Локальный API-эндпоинт

Для базового теста API:

curl http://localhost:3000/health

Вы должны увидеть ответ о здоровом статусе.

Теперь отправьте простой запрос:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Объясните, что делает OpenClaw простыми словами."}'

Если вы получили структурированный ответ, система работает.

Что вы только что запустили

На этом этапе у вас есть:

- Рабочая инстанция OpenClaw

- Настроенный поставщик LLM (локальный или облачный)

- Рабочий цикл запроса-ответа

Если вы выбрали путь GPU, инференция происходит локально через Ollama.

Если вы выбрали путь CPU, инференция происходит через Claude Sonnet 4.6, в то время как оркестрация, маршрутизация и обработка памяти выполняются внутри ваших локальных Docker-контейнеров.

Видимое взаимодействие может выглядеть простым. Под капотом несколько компонентов координируются для обработки вашего запроса.

Устранение неполадок при установке и работе OpenClaw

Модель не отвечает

- Проверьте конфигурацию

.env. - Проверьте логи контейнеров:

docker compose logs

Ollama недоступен

- Подтвердите, что Ollama работает:

ollama list

- Убедитесь, что базовый URL соответствует вашей среде.

Недействительный ключ API

- Дважды проверьте

ANTHROPIC_API_KEY - Перезапустите контейнеры после обновления

.env

GPU не используется

- Подтвердите, что драйверы GPU установлены.

- Убедитесь, что Docker имеет доступ к GPU.

Следующие шаги после установки OpenClaw

Теперь у вас есть рабочая инстанция OpenClaw.

Отсюда вы можете:

- Подключить платформы обмена сообщениями

- Включить извлечение документов

- Экспериментировать с стратегиями маршрутизации

- Добавить наблюдаемость и метрики

- Настроить производительность и поведение затрат

Более глубокие архитектурные обсуждения имеют больше смысла, когда система работает.

Первый шаг — сделать её работоспособной.