Enshittificación de Ollama - Las primeras señales

Mi visión sobre el estado actual del desarrollo de Ollama

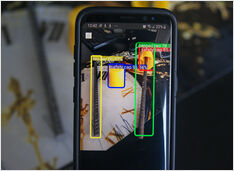

Ollama ha pasado rápidamente a ser una de las herramientas más populares para ejecutar modelos de lenguaje grande (LLM) en local.

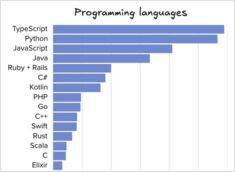

Su CLI simple y su gestión de modelos optimizada han convertido a Ollama en una opción preferida para desarrolladores que desean trabajar con modelos de IA fuera de la nube.