Airtable für Entwickler und DevOps – Pläne, API, Webhooks und Go/Python-Beispiele

Airtable – Grenzen des kostenlosen Plans, API, Webhooks, Go & Python.

Airtable ist am besten als eine Low-Code-Plattform für Anwendungen zu verstehen, die um eine kooperative „datenbankähnliche“ Tabellenansicht herum gebaut ist – ideal für die schnelle Erstellung von operativen Tools (interne Tracker, leichte CRM-Systeme, Inhaltspipelines, AI-Bewertungsqueues), bei denen Nicht-Entwickler eine freundliche Oberfläche benötigen, aber Entwickler auch eine API-Oberfläche für Automatisierung und Integration benötigen.

Airtables eigene Materialien beschreiben die Web-API als RESTful, mit JSON und Standard-HTTP-Statuscodes.

Die beiden Einschränkungen, die die ingenieurtechnischen Entscheidungen am stärksten prägen, sind:

Die kostenlosen Plan-Hard-Ceiling: 1.000 Datensätze pro Base, 1.000 API-Aufrufe pro Workspace pro Monat, 1 GB Anhangspeicher pro Base und nur zwei Wochen Revision/ Snapshot-Geschichte.

Diese Zahlen sind niedrig genug, dass Sie „Free Airtable“ als Prototyp, Demo, Hobby-Projekt oder sehr kleiner interner Workflow behandeln sollten, nicht als Produktionsdatenspeicher, der kontinuierlich von Diensten abgefragt wird.

Die öffentlichen Web-API-Rate-Limits: Airtable erzwingt 5 Anfragen pro Sekunde pro Base und auch 50 Anfragen pro Sekunde für alle Verkehr mit persönlichen Zugriffstoken von einem bestimmten Benutzer oder Dienstkonto. Wenn Sie diese überschreiten, erhalten Sie HTTP 429 und (gemäß Airtable-Richtlinien) müssen Sie ca. 30 Sekunden warten, bevor Sie erneut versuchen.

Die Konsequenz ist architektonisch: Batchen wo immer möglich, Caches für Lesen, bevorzugen Sie Webhooks gegenüber Polling für Änderungserkennung und bauen Sie Retry/Backoff in jeden Client ein.

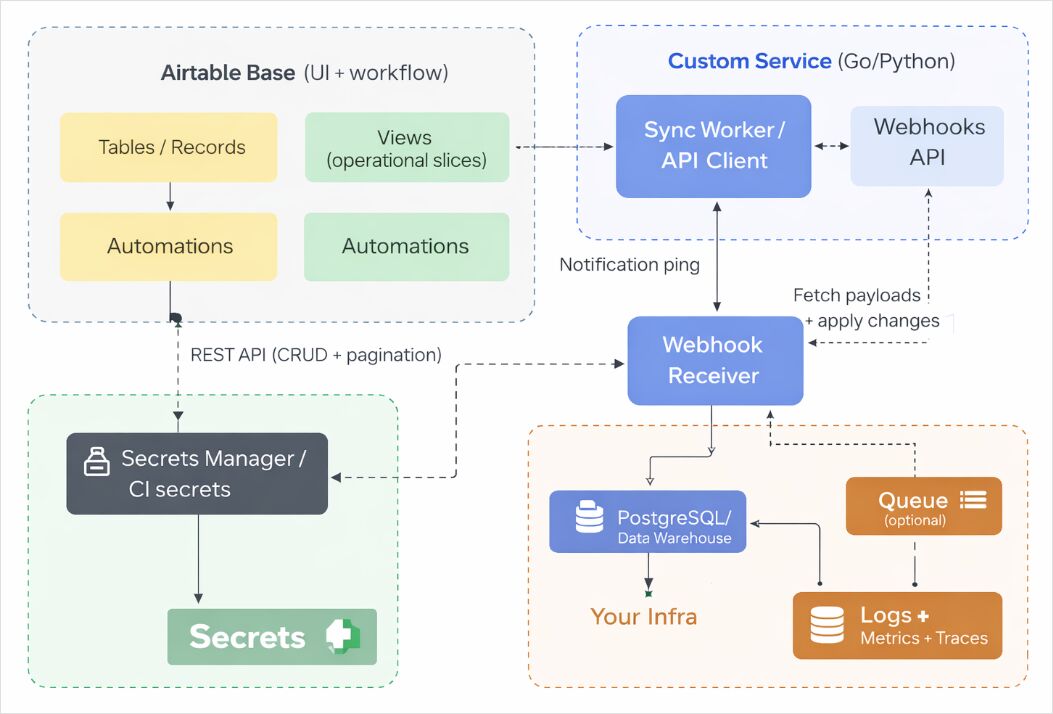

Wenn Sie Airtable in einem maßgeschneiderten System verwenden möchten, ist ein effektives „DevOps + Backend“-Produktionsmuster:

Airtable als operativer UI + leichte Quelle der Wahrheit für einen begrenzten Datensatz (Routing-Regeln, menschliche Prüfqueues, Redaktionspläne, Kunden-Onboarding-Schritte).

Ein separates System (PostgreSQL/warehouse/Object Storage) als der widerstandsfähige primäre Speicher für Skalierung, Audit, Backups, Analytics und höhere QPS-Lese-/Schreibvorgänge.

Eine Sync-Schicht, die Seiten von Datensätzen (Offset-Pagination) zieht, Änderungen in Batches pushen und optional Airtable Webhooks verwenden, um Polling zu reduzieren.

Für das breitere Bild – Objektstorage, PostgreSQL, Elasticsearch und AI-native Datenebenen – siehe den Artikel Data Infrastructure for AI Systems.

Was ist Airtable und warum verwenden Entwickler es als Low-Code-Datenbank

Der Kernabstraktion von Airtable ist die Base: ein Container für verwandte Tabellen und Workflow-Artefakte (Ansichten, Schnittstellen, Automatisierungen). In der Praxis entspricht eine Base oft einem Geschäftsdomänen-Grenze – Content-Operations, Incident Postmortems, LLM-Evaluierungen, Kundenanfragen.

Innerhalb einer Base modellieren Sie Daten als:

Tabellen: Analog zu Entitäten/Collectionen.

Datensätze: Zeilen.

Felder: Spalten mit reichen Typen (Auswahlen, Anhänge, Links, Formeln, usw.).

Sie erstellen dann mehrere „Linsen“ über die gleiche Tabelle mit Ansichten – gefilterte/sortierte/gruppierte Darstellungen, die für spezifische Aufgaben optimiert sind. Airtables Dokumentation betont, dass Ansichten Ihnen helfen, „die für Sie relevantesten Datensätze zu sehen“ und können für verschiedene Verbraucher angepasst werden.

Entwickler greifen zu Airtable, wenn sie benötigen:

Eine benutzerfreundliche UI für Geschäftsbenutzer, um operativen Daten schnell zu erstellen/zu aktualisieren (ohne auf ein benutzerdefiniertes Admin-App zu warten).

Eine programmierbare Backend-Oberfläche über die Airtable Web API für Eingabe, Sync und Automatisierung. Die API verwendet REST-Semantik und JSON, was die Integration von Go/Python-Diensten einfach macht.

Verknüpfung von SaaS/Workflows über Integrationen und Automatisierungen, wobei einige Schritte vollständig in Airtable implementiert werden können und andere in Code behandelt werden. Airtable-Automatisierungen werden als Trigger-Aktion-Workflows beschrieben (z. B. „wenn Datensatz erstellt → Nachricht senden / Datensatz aktualisieren / Skript ausführen“).

Airtable ist besonders produktiv für DevOps + AI-Teams, wenn es als:

Eine änderungskontrollierte Konfigurations-Tabelle verwendet wird: z. B. Feature-Flag-Metadaten, Service-Eigentümer, Eskalationspfade, Deployment-Zustimmungen.

Eine Menschenprüfungswarteschlange: z. B. LLM-Ausgaben, die auf Validierung, Sicherheitsprüfung, Prompt-Iterationen warten.

Ein Metadatenindex für Assets, die anderswo leben: S3-URIs, Git-Commit-SHAs, Dataset-IDs – minimieren Sie den Anhangsspeicherdruck auf Airtable selbst (wichtig auf Free).

Kernfunktionen von Airtable: Bases, Tabellen, Felder, Ansichten, Schnittstellen, Erweiterungen, Automatisierungen und Integrationen

Die „Kraft“ von Airtable besteht nicht nur in Tabellen; es ist die umgebende Workflow-Oberfläche, die eine Base wie eine leichte App-Plattform verhält.

Bases und Tabellen für strukturierte Zusammenarbeit

Eine Base ist der Ort, an dem Teams strukturierte Daten und Prozesszustände gemeinsam besitzen. Die praktische ingenieurtechnische Implikation ist Schema-Governance: wenn Geschäftsbenutzer Felder oder Tabellen umbenennen, können Ihre API-Clienten brechen, es sei denn, Sie planen für Änderungen.

Zwei Taktiken reduzieren Brüche:

Verwenden Sie in Code so weit wie möglich stabile IDs. Airtable weist explizit darauf hin, dass Tabellenamen und Tabellen-IDs austauschbar sind und empfiehlt Tabellen-IDs, damit Sie keine Anfragen ändern müssen, wenn Namen sich ändern.

Dokumentieren Sie „API-koppelte Felder“ in Feldbeschreibungen und behandeln Sie Änderungen als kontrollierte Ereignisse (PR-Review / Änderungsantrag).

Ansichten und Workflow-„Linsen“

Ansichten ermöglichen das Filtern/Sortieren/Gruppieren von Datensätzen für bestimmte Prozesse (Triage-Ansicht, „bedarf Prüfung“, „bereit zum Versenden“). Airtable betont Ansichten als Mechanismus, um nur die „relevantesten“ Datensatz-Teilmengen für unterschiedliche Benutzer anzuzeigen.

Aus der Integrationssicht können Sie eine Ansicht als stabile Vereinbarung entwerfen: Ihre Sync-Aufgabe liest nur Datensätze in der „Export“-Ansicht, anstatt den gesamten Filterlogik in Code zu replizieren. (Die API unterstützt auch das Auswählen von Datensätzen über Ansichten und über Formelfilter; siehe den API-Abschnitt unten.)

Erweiterungen, Apps-Marktplatz und „Bring your own Tooling“

Airtable unterstützt „Erweiterungen“ (früher „Blocks“), die Fähigkeiten innerhalb der Base hinzufügen (Diagramme, Skripte, Imports, usw.). Airtables eigene Übersicht beschreibt Erweiterungen als Add-ons, die von Airtable und Dritten entwickelt wurden.

Kritisch: Erweiterungen werden nicht auf dem Free-Plan unterstützt, also startet jeder Workflow, der darauf angewiesen ist, bei Team oder höher.

Automatisierungen: Trigger, Aktionen und Skriptierung für Integrationen

Automatisierungen sind Trigger-Aktion-Workflows: Airtable listet Trigger ein, einschließlich „wenn ein Datensatz erstellt/aktualisiert wird“, „wenn ein Datensatz eine Ansicht betritt“, geplante Zeit-Trigger und „wenn ein Webhook empfangen wird“, unter anderen.

Aktionen umfassen das Erstellen/Aktualisieren von Datensätzen, das Senden von Nachrichten und (wichtig für Entwickler) das Ausführen von Code: die Aktion „Ein Skript ausführen“ führt Skripte „im Hintergrund der Base“ aus und wird als die richtige Wahl für Skripte positioniert, die automatisch ausgeführt werden sollen.

Allerdings ist „Ein Skript ausführen“ explizit als nicht verfügbar auf dem Free-Plan markiert, was wichtig ist, wenn Ihre Architekturannahme lautet: „Verwenden Sie Airtable-Automatisierungen, um unsere internen APIs aufzurufen.“

Web API und Integrationen als ingenieurtechnische Schnittstelle

Airtables Web API ermöglicht externen Systemen, Datensätze über Standard-HTTP-Aufrufe zu lesen/schreiben. Die Airtable-Dokumentation gibt konkrete URL-Muster an, wie z. B.:

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5 (Beispiel für Formelfilterung).

Airtable bietet auch eine Metadaten-Schicht an (nützlich für DevOps „Konfiguration als Code“-Muster), einschließlich der Auflistung von Bases über GET https://api.airtable.com/v0/meta/bases und der Erstellung einer Base über POST https://api.airtable.com/v0/meta/bases (erfordert Schema-Scope).

In Bezug auf Authentifizierung hat Airtable sich von veralteten API-Schlüsseln abgewandt: sein offizieller Stilllegungszeitplan umfasst API-Schlüssel-Stilllegung ab dem 1. Februar 2024.

Airtable-Zahlungspläne und die Free-Plan-Grenzen für Entwickler

Airtables Plan-Namen und Berechtigungen ändern sich im Laufe der Zeit, aber Airtables aktuelle Plan-Dokumentation bietet explizite, ingenieurtechnisch relevante Quoten und Einschränkungen.

Airtable-Plan-Tabelle: Schlüsselleistungsmerkmale, die API-Integrationen beeinflussen

| Plan (Selbstbedienung, sofern nicht anders angegeben) | Datensätze pro Base | API-Aufrufe pro Workspace / Monat | Anhangsspeicher pro Base | Revision/ Snapshot-Geschichte | Auffällige Einschränkungen / Notizen |

|---|---|---|---|---|---|

| Free | 1.000 | 1.000 | 1 GB | 2 Wochen | Keine Erweiterungen; zusätzliche UI-Einschränkungen; Begrenzungen für Mitwirkende; enthält AI-Credits pro Editor+ |

| Team | 50.000 | 100.000 | 20 GB | 1 Jahr | Enthält Automatisierungen, Erweiterungen, Formulare, Interface-Designer, Timeline/Gantt, gesperrte/privilegierte Ansichten und mehr |

| Business | 125.000 | Unbegrenzt | 100 GB | 1 Jahr | Enthält Two-way Sync und Admin-Panel (und erfordert private E-Mail-Domains) |

| Enterprise Scale (verkaufsgeführt) | (variiert) | (variiert) | (variiert) | (variiert) | Verkauft/gemanagt durch Verkauf; Business/Enterprise erfordern private E-Mail-Domains |

Team- und Business-Plan-Preise in Airtables Plan-Dokumentation sind pro Mitwirkender (monatlich vs. jährlich) gelistet.

Tiefergang in den Free-Plan: Grenzen und praktische Auswirkungen für DevOps und Backend-Systeme

Auf Free erhalten Sie:

1.000 Datensätze pro Base.

Dies ist die erste „Architektur-Forcierung“: sobald Sie etwa 1.000 Datensätze für einen Bereich überschreiten, müssen Sie entweder in mehrere Bases aufteilen (was Integrationskomplexität verursacht), aggressiv archivieren oder den primären Datensatz anderswo bewegen (Postgres/warehouse) und nur aktive operative Slices in Airtable behalten.

1.000 API-Aufrufe pro Workspace pro Monat.

Dies ist niedrig genug, dass naive Sync-Strategien (jede Minute abfragen) schnell die Quote verbrauchen. Airtables API-Aufrufgrenzenleitfaden beschreibt explizit die API als RESTful und weist darauf hin, dass List-Record-Operationen bis zu 100 Datensätze pro Seite zurückgeben; wenn Sie häufig abfragen, können Sie die monatlichen Aufrufe schnell erschöpfen.

Ein Free-Plan-Integration sollte daher standardmäßig:

eventgesteuerte Updates über Webhooks (wenn möglich),

oder Nutzer-gesteuerte / manuelle Sync,

oder einen sehr niedrigfrequenten Batch-Job (täglich),

plus Caching, um wiederholte Lesen zu vermeiden. Airtable empfiehlt explizit Caching/Proxy-Ansätze als Strategie zur Verwaltung von Rate-Limits.

1 GB Anhangsspeicher pro Base.

Für AI/LLM-Workflows ist dies ein Hinterhalt, wenn Sie PDFs, Bilder oder Datensätze als Anhänge speichern. Vorzuziehen ist das Speichern von Anhängen in Objektstorage und das Behalten nur von URLs und Metadaten in Airtable.

2 Wochen Revision/ Snapshot-Geschichte.

Aus der DevOps-Risiko-Sicht reduziert begrenzte Geschichte Ihre Fähigkeit, sich von unabsichtlichen Massenänderungen zu erholen. Wenn Airtable operativ kritisch ist, sollten Sie externe Backups/Snapshots (API-Export-Jobs) implementieren, anstatt sich allein auf Revisionsgeschichte zu verlassen.

Free hat auch Zusammenarbeitseinschränkungen und Funktionenentfernungen, die für die Lieferung wichtig sind:

Unbegrenzte Leser mit nur 5 Mitwirkende mit Editor/Creator-Berechtigungen und 50 Kommentatoren.

Keine Erweiterungen auf Free.

Einige Automatisierungsfähigkeiten sind eingeschränkt: die Aktion „Ein Skript ausführen“ ist auf Free als nicht verfügbar markiert.

Airtable-Alternativen und Wettbewerber: Notion vs Google Sheets vs Coda vs ClickUp vs PostgreSQL + UI

Airtable ist nicht die Standardantwort für jeden „Tabellen + Workflow“-Nutzungsfall. Die richtige Wahl hängt davon ab, ob Ihre primäre Bedürfnis ist:

eine datenbankähnliche operatives Lager mit UI (Airtable / Coda),

ein dokumentzentriertes Arbeitsraum mit eingebetteten Datenbanken (Notion),

reine Tabellenverträglichkeit (Google Sheets),

Aufgaben/Projektmanagement (ClickUp),

oder ein echtes Backend-Datenspeicher mit einem speziell gebauten Admin-UI (PostgreSQL + Retool/Appsmith/etc.).

Wettbewerber-Vergleichstabelle: ingenieurtechnische Kompromisse (API, UI, Skalierung)

| Tool | Bestes | Typische Grenzen/Rate-Limit-Modell | Schlüsselkompromisse im Vergleich zu Airtable |

|---|---|---|---|

| Notion | Dokumentzentrierte Kenntnisse + eingebettete Datenbanken in Dokumenten | Notion API ist rate limited und erzwingt Anforderungsgöße/Grundgrenzen. | Ausgezeichnet für Dokumente/RAG-Eingaben und narrative Workflows; Datenbanken sind mächtig, aber oft weniger „ops-tabelle“-fokussiert als Airtable; Integrationsmuster unterscheiden sich (explizites Teilen mit Integrationen erforderlich). |

| Google Sheets | Tabellenverträglichkeit, Formeln, breites Ökosystem | Sheets API hat Minutenquoten; Google Dokumente Quotenverhalten und empfiehlt ~2 MB Nutzlasten. | Gut, wenn Sie Tabellensemantik und Kompatibilität benötigen; schwerer, App-ähnliche Erfahrungen (Berechtigungen, Formulare, relationale Links) ohne zusätzliche Tools zu bauen. |

| Coda | Dokument + Tabelle Hybrid mit „Packs“ und Automatisierung | Coda veröffentlicht, dass seine API-Rate-Limits und 429 zurückgibt, wenn Grenzen erreicht sind; empfiehlt, zurückzugehen und erneut zu versuchen. | Starke Dokument/Tabelle-Fusion; wenn Sie Airtable-stilige base-first-Operative Apps benötigen, fühlt sich Airtables Modell klarer an; Rate-Limits und Dokumentgrenzen variieren je nach Plan. |

| ClickUp | Aufgaben/Projektmanagement | ClickUp wendet pro-Token-Rate-Limits an und variiert Grenzen je nach Workspace-Plan (z. B. 100 Anfragen/Minute/Token auf niedrigeren Ebenen, höher auf anderen). | Bestes, wenn „Aufgaben“ primär sind; als allgemeine Datenbank zu verwenden ist unangenehm; stark für Workflow, aber schwächer für beliebige Schema-Modellierung. |

| PostgreSQL + UI (Retool/Appsmith/custom) | Beständiges System der Aufzeichnung, starke Konsistenz, Skalierung | Hängt von Ihrer Infrastruktur ab; keine SaaS-erzwungenen „5 QPS pro Base“-Art-Obergrenzen | Mehr ingenieurtechnische Arbeit von vornherein; aber bestes für hohe QPS, strikte Korrektheit, Audit, komplexe Abfragen und langfristige Wartbarkeit – füge ein Admin-UI für Nicht-Dev-Benutzer hinzu. |

Ein nützlicher Regel: wenn Sie höhere Lesen/Schreiben-Frequenz, komplexe Abfragen oder strikte Änderungssteuerung voraussehen, benötigen Sie typischerweise „Postgres-first“. Wenn Sie schwere nicht-Dev-Bearbeitung und schnelle Workflow-Iteration voraussehen, ist Airtable überzeugend – besonders für interne Tools – sofern Sie sich um API- und Plan-Grenzen planen.

Airtable DevOps-Muster und End-to-End-API-Integration mit Go und Python

Dieser Abschnitt gibt einen vollständigen, produktionsorientierten Weg von der Konfiguration → sichere Authentifizierung → CRUD-Clients → Pagination → Rate-Limit-Handling → Batchverarbeitung → Webhooks → Deployment-Notizen.

SEO-Integration-Diagramm: Airtable API-Architektur für DevOps-freundliche Systeme

Konfiguration und Authentifizierung: stabile IDs, Token und minimale Berechtigung

Verwenden Sie in Code bevorzugt Table-IDs, um Bruchveränderungen zu reduzieren

Airtable weist darauf hin, dass Table-Namen und Table-IDs austauschbar sind und empfiehlt Table-IDs, um Änderungen an Anfragen zu vermeiden, wenn Namen sich ändern.

In der Praxis ist dies eine der höchsten Leverage-„Ops-Hygiene“-Entscheidungen, die Sie für eine Airtable-gebackene Integration treffen können.

Um IDs zu finden, bietet Airtable Anleitungen, wie man Base- und Table-IDs aus URLs (und über API-Dokumentation) findet.

Verwenden Sie Personal Access Tokens (PATs), nicht veraltete API-Schlüssel

Airtables offizielle Stilllegungsliste umfasst „1. Februar 2024 - API-Schlüssel-Stilllegung.“

PATs werden von Airtable als ermöglichen, mehrere Token mit unterschiedlichen Scopes zu erstellen – von eng (einzelner Scope + einzelne Base) bis breit (alle Workspaces/Bases/Scopes, die vom Benutzer erlaubt sind).

Die betriebliche Best-Practice ist: erstellen Sie mehrere PATs pro Integrationsoberfläche (z. B. einen Token für read-only-Sync, einen anderen für write-Pfade) und rotieren Sie sie wie andere Geheimnisse.

Für enterprise-artige Resilienz (Integration sollte nicht sterben, wenn ein Mitarbeiter geht), beschreibt Airtable Service-Konten, die für API-Integrationen unabhängig von jedem spezifischen Benutzer entworfen sind.

Minimale Umgebungsvariablen für beide Go- und Python-Beispiele

# Erforderlich

export AIRTABLE_TOKEN="pat_xxx..." # Personal Access Token

export AIRTABLE_BASE_ID="appXXXXXXXXXXXXXX" # Base ID

export AIRTABLE_TABLE="tblYYYYYYYYYYYYYY" # Prefer table ID; table name also works

# Optional (Filters/Verhalten)

export AIRTABLE_PAGE_SIZE="100" # 100 ist max für list records

export AIRTABLE_TIMEOUT_SECONDS="30"

API-Grundlagen, die Client-Design prägen: Pagination, Rate-Limits, Batchverarbeitung

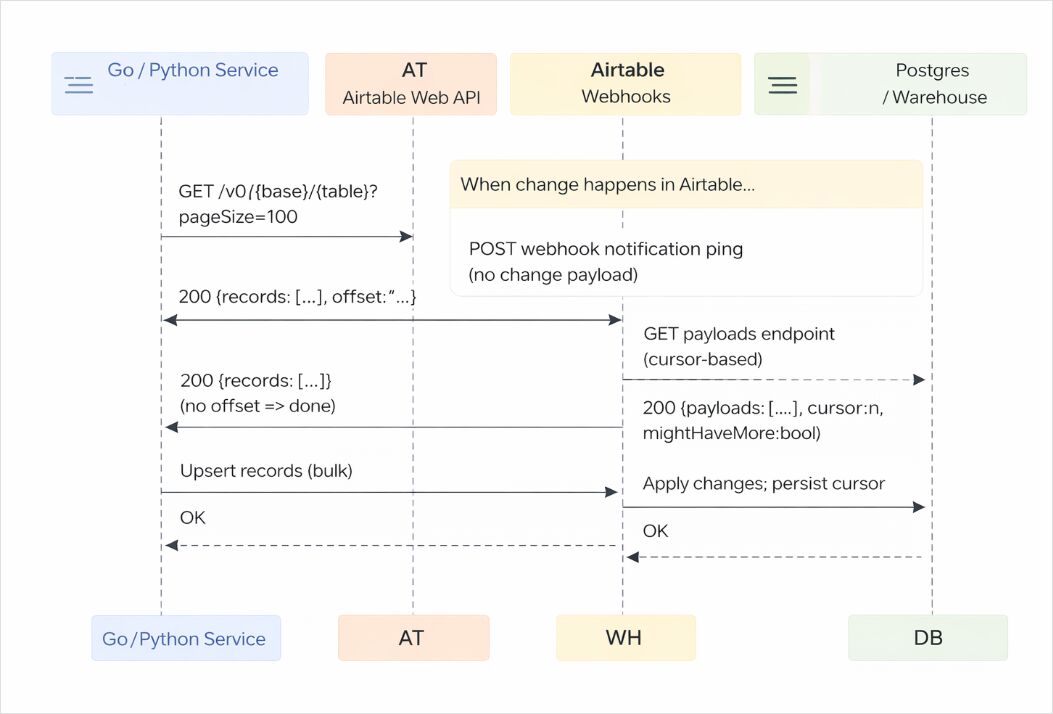

Pagination: list records gibt bis zu 100 Datensätze pro Anfrage zurück

Airtable dokumentiert, dass „list records“-Antworten in bis zu 100 Datensätzen pro Mal paginiert werden; wenn die Tabelle mehr als 100 hat, müssen Sie mehrere Anfragen stellen und die zurückgegebene offset als Abfrageparameter für die nächste Anfrage verwenden.

Der pageSize-Parameter kann die Seitengröße reduzieren, aber 100 ist die maximale.

Filtern und Sortieren: filterByFormula und sort-Abfrageparameter

Airtable bietet konkrete Beispiele für die Verwendung von filterByFormula und sort[...]-Parametern an, einschließlich eines kanonischen URL-Formats wie:

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5

Rate-Limits und Retry-Strategie: behandeln Sie 429 als normal

Airtables API-Aufrufgrenzen-Dokumentation besagt:

5 Anfragen pro Sekunde pro Base,

50 Anfragen pro Sekunde pro Benutzer/Dienstkonto mit PAT-Verkehr,

und wenn überschritten, erhalten Sie eine 429 und müssen 30 Sekunden warten, bevor nachfolgende Anfragen erfolgreich sind.

Airtables Problembehandlungsleitfaden unterstreicht, dass 429 bedeuten kann, dass Sie die 5 Anfragen/Base/Sekunde-Rate-Limit überschritten haben, und rät, vor dem erneuten Versuchen zu warten.

Batchverarbeitung: planen Sie um „bis zu 10 Datensätze pro Anfrage“

Airtable dokumentiert explizit Batchverarbeitung als Rate-Limit-Strategie: die API „unterstützt Batchverarbeitung“, die „bis zu 10 Datensätze pro Anfrage“ verarbeitet.

Und Airtables „Mehrere Datensätze aktualisieren“-Endpunkt demonstriert das Batch-Anfrageformat (records: [...]) und unterstützt auch performUpsert mit fieldsToMergeOn.

SEO-Abfolgediagramm: Airtable API-Aufrufabfolge für list → paginieren → Batch-Aktualisierung → Webhook-Payload-Abfrage

Go-Beispiel: produktionsreifer Airtable REST-Client mit Pagination, Retry und Batchverarbeitung

Dieses Go-Programm demonstriert:

PAT-Authentifizierung über Authorization: Bearer ... (Bearer-Auth ist erforderlich).

Liste-Datensätze-Pagination mit offset und pageSize (max 100).

Rate-Limit-Handling für 429 mit Retry-After-Backup und Airtables „warte 30 Sekunden“-Richtlinien.

Batch-Aktualisierung mit dem offiziellen PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName}-Format.

Einzel-Datensatz-Aktualisierungsendpunkt-Format (PATCH/PUT-Semantik).

Filterbeispiel (filterByFormula) URL-Muster.

Ausführungsvoraussetzungen: Go 1.21+ empfohlen; setzen Sie

AIRTABLE_TOKEN,AIRTABLE_BASE_ID,AIRTABLE_TABLE.

// Datei: main.go

package main

import (

"bytes"

"context"

"encoding/json"

"errors"

"fmt"

"io"

"net/http"

"net/url"

"os"

"strconv"

"time"

)

type AirtableClient struct {

BaseID string

Token string

HTTPClient *http.Client

}

type airtableError struct {

Error interface{} `json:"error"`

}

type Record struct {

ID string `json:"id"`

CreatedTime string `json:"createdTime,omitempty"`

Fields map[string]interface{} `json:"fields"`

}

type listRecordsResponse struct {

Records []Record `json:"records"`

Offset string `json:"offset,omitempty"`

}

func mustEnv(key string) string {

v := os.Getenv(key)

if v == "" {

fmt.Fprintf(os.Stderr, "missing env var: %s\n", key)

os.Exit(2)

}

return v

}

func (c *AirtableClient) doJSON(ctx context.Context, method, rawURL string, body any, out any) (*http.Response, error) {

var reqBody io.Reader

if body != nil {

b, err := json.Marshal(body)

if err != nil {

return nil, fmt.Errorf("marshal body: %w", err)

}

reqBody = bytes.NewReader(b)

}

req, err := http.NewRequestWithContext(ctx, method, rawURL, reqBody)

if err != nil {

return nil, err

}

req.Header.Set("Authorization", "Bearer "+c.Token) // Bearer required

req.Header.Set("Content-Type", "application/json")

// Basic retry loop that treats 429 as normal. Airtable guidance: wait ~30s.

var lastResp *http.Response

for attempt := 0; attempt < 6; attempt++ {

resp, err := c.HTTPClient.Do(req)

if err != nil {

return nil, err

}

lastResp = resp

if resp.StatusCode != http.StatusTooManyRequests {

if out == nil {

return resp, nil

}

defer resp.Body.Close()

if resp.StatusCode < 200 || resp.StatusCode >= 300 {

b, _ := io.ReadAll(resp.Body)

return resp, fmt.Errorf("http %d: %s", resp.StatusCode, string(b))

}

if err := json.NewDecoder(resp.Body).Decode(out); err != nil {

return resp, fmt.Errorf("decode response: %w", err)

}

return resp, nil

}

// 429 handling

resp.Body.Close()

wait := 30 * time.Second // Airtable says wait 30 seconds before subsequent requests succeed

if ra := resp.Header.Get("Retry-After"); ra != "" {

if secs, err := strconv.Atoi(ra); err == nil && secs > 0 {

wait = time.Duration(secs) * time.Second

}

}

time.Sleep(wait)

// Rewind body for retry if needed (only safe because we used bytes.NewReader).

if reqBody != nil {

if seeker, ok := reqBody.(io.Seeker); ok {

_, _ = seeker.Seek(0, io.SeekStart)

}

}

}

return lastResp, errors.New("too many retries after 429")

}

// ListRecords paginates with offset; pageSize max 100

func (c *AirtableClient) ListRecords(ctx context.Context, table string, pageSize int, filterByFormula string) ([]Record, error) {

if pageSize <= 0 || pageSize > 100 {

pageSize = 100

}

var out []Record

var offset string

for {

u := url.URL{

Scheme: "https",

Host: "api.airtable.com",

Path: fmt.Sprintf("/v0/%s/%s", c.BaseID, table),

}

q := u.Query()

q.Set("pageSize", strconv.Itoa(pageSize))

if offset != "" {

q.Set("offset", offset)

}

if filterByFormula != "" {

// Example pattern in Airtable docs

q.Set("filterByFormula", filterByFormula)

}

u.RawQuery = q.Encode()

var page listRecordsResponse

_, err := c.doJSON(ctx, http.MethodGet, u.String(), nil, &page)

if err != nil {

return nil, err

}

out = append(out, page.Records...)

if page.Offset == "" {

return out, nil

}

offset = page.Offset

}

}

// UpdateMultiple demonstrates the official batch PATCH shape.

func (c *AirtableClient) UpdateMultiple(ctx context.Context, table string, records []Record) ([]Record, error) {

type reqBody struct {

Records []Record `json:"records"`

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

var resp struct {

Records []Record `json:"records"`

}

_, err := c.doJSON(ctx, http.MethodPatch, u, reqBody{Records: records}, &resp)

if err != nil {

return nil, err

}

return resp.Records, nil

}

// UpsertMultiple uses performUpsert (fieldsToMergeOn) on the batch update endpoint.

func (c *AirtableClient) UpsertMultiple(ctx context.Context, table string, mergeOn []string, records []Record) error {

body := map[string]any{

"performUpsert": map[string]any{

"fieldsToMergeOn": mergeOn,

},

"records": records,

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

_, err := c.doJSON(ctx, http.MethodPatch, u, body, nil)

return err

}

// UpdateRecord demonstrates single-record PATCH/PUT endpoint semantics.

func (c *AirtableClient) UpdateRecord(ctx context.Context, table, recordID string, fields map[string]any) (Record, error) {

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s/%s", c.BaseID, table, recordID)

body := map[string]any{"fields": fields}

var resp Record

_, err := c.doJSON(ctx, http.MethodPatch, u, body, &resp)

return resp, err

}

func chunk[T any](items []T, n int) [][]T {

if n <= 0 {

return [][]T{items}

}

var out [][]T

for i := 0; i < len(items); i += n {

j := i + n

if j > len(items) {

j = len(items)

}

out = append(out, items[i:j])

}

return out

}

func main() {

ctx, cancel := context.WithTimeout(context.Background(), 60*time.Second)

defer cancel()

token := mustEnv("AIRTABLE_TOKEN")

baseID := mustEnv("AIRTABLE_BASE_ID")

table := mustEnv("AIRTABLE_TABLE")

c := &AirtableClient{

BaseID: baseID,

Token: token,

HTTPClient: &http.Client{

Timeout: 30 * time.Second,

},

}

// Beispiel: alle Datensätze listen, gefiltert durch Formel (anpassen Sie die Formel an Ihr Schema).

records, err := c.ListRecords(ctx, table, 100, "")

if err != nil {

panic(err)

}

fmt.Printf("listed %d records\n", len(records))

// Beispiel: Batch-Aktualisierung in Blöcken (Airtable unterstützt Batchverarbeitung als Strategie, bis zu 10 Datensätze pro Anfrage).

// Hier aktualisieren wir maximal 10 gleichzeitig.

var updates []Record

for i := 0; i < len(records) && i < 3; i++ {

updates = append(updates, Record{

ID: records[i].ID,

Fields: map[string]any{

"Besucht": true,

},

})

}

for _, part := range chunk(updates, 10) {

updated, err := c.UpdateMultiple(ctx, table, part)

if err != nil {

panic(err)

}

fmt.Printf("updated %d records\n", len(updated))

}

}

Python-Beispiel: Airtable-Integration mit requests und einem Webhook-Receiver

Dieses Python-Implementierung umfasst:

Direkte REST-Aufrufe mit Bearer-Auth.

Pagination mit offset und pageSize (max 100).

429-Handling gemäß Airtable-Richtlinien (ca. 30 Sekunden warten).

Batch-Aktualisierung mit dem offiziellen update-multiple-Endpunkt-Format und performUpsert.

Webhook-Receiver-Verhalten, das bestätigt: Webhook-Pings enthalten keine Änderungspayload, also müssen Sie Payloads separat abrufen, und Payloads werden für 7 Tage beibehalten; Webhooks können nach 7 Tagen ablaufen, es sei denn, sie werden erneut gelistet.

Hinweis: Die Details des „List webhook payloads“-Endpunkts von Airtable werden in der Airtable-Webhooks-Leitfaden referenziert, aber der zuverlässigste öffentlich indexierte Text ist der Leitfaden selbst und Community-Beispiele. Die Leitfadenverhaltensbeschränkungen (keine Payload im Ping, Beibehaltung, Ablauf) sind die kritischen betrieblichen Fakten.

# Datei: airtable_client.py

import os

import time

import json

import typing as t

import requests

from urllib.parse import urlencode

AIRTABLE_TOKEN = os.environ["AIRTABLE_TOKEN"]

AIRTABLE_BASE_ID = os.environ["AIRTABLE_BASE_ID"]

AIRTABLE_TABLE = os.environ["AIRTABLE_TABLE"]

SESSION = requests.Session()

SESSION.headers.update({

"Authorization": f"Bearer {AIRTABLE_TOKEN}", # Bearer auth required

"Content-Type": "application/json",

})

def _airtable_request(method: str, url: str, *, params=None, json_body=None, max_retries: int = 5) -> requests.Response:

for attempt in range(max_retries + 1):

resp = SESSION.request(method, url, params=params, json=json_body, timeout=30)

if resp.status_code != 429:

return resp

# Airtable guidance: wait ~30s after 429

retry_after = resp.headers.get("Retry-After")

wait = 30

if retry_after and retry_after.isdigit():

wait = int(retry_after)

time.sleep(wait)

raise RuntimeError(f"Too many retries after 429 for {method} {url}")

def list_records(page_size: int = 100, filter_by_formula: str | None = None) -> list[dict]:

# pageSize max is 100

page_size = min(max(page_size, 1), 100)

base_url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

all_records: list[dict] = []

offset: str | None = None

while True:

params = {"pageSize": page_size}

if offset:

params["offset"] = offset

if filter_by_formula:

# Example pattern documented by Airtable

params["filterByFormula"] = filter_by_formula

resp = _airtable_request("GET", base_url, params=params)

resp.raise_for_status()

data = resp.json()

all_records.extend(data.get("records", []))

offset = data.get("offset")

if not offset:

break

return all_records

def update_multiple_records(records: list[dict], perform_upsert_fields: list[str] | None = None) -> dict:

"""

Uses PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName}

with body { "records": [ { "id": "...", "fields": {...} }, ... ] }

and optional performUpsert, per Airtable docs.

"""

url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

body: dict[str, t.Any] = {"records": records}

if perform_upsert_fields:

body["performUpsert"] = {"fieldsToMergeOn": perform_upsert_fields}

resp = _airtable_request("PATCH", url, json_body=body)

resp.raise_for_status()

return resp.json()

def webhook_receiver_example():

"""

Minimal pattern; in production, use Flask/FastAPI and validate signatures.

Airtable webhooks guide notes:

- Notification ping DOES NOT include the change payload

- Payload must be fetched from the GET payloads endpoint

- Payloads retained 7 days

- Webhooks created via PAT/OAuth expire after 7 days unless refreshed/listed

"""

pass

if __name__ == "__main__":

rows = list_records(page_size=100)

print(f"Fetched {len(rows)} records")

# Example: update first 2 records (chunk in 10s; Airtable supports batching up to 10 records/request as a strategy).

updates = []

for r in rows[:2]:

updates.append({"id": r["id"], "fields": {"Besucht": True}})

if updates:

result = update_multiple_records(updates)

print(json.dumps(result, indent=2))

Webhook-Receiver: Cursor-Persistenz und „keine Payload im Ping“

Für einen produktionsfähigen Webhook-Receiver sind Ihre Hauptaufgaben:

Eine schnelle Erfolgsantwort zurückgeben (z. B. HTTP 204).

Den Webhook-Cursor persistieren, damit Sie alte Payloads nicht erneut verarbeiten.

Payloads nach Pings abrufen; der Webhooks-Leitfaden warnt, dass die Ping-Reihenfolge nicht garantiert ist, aber Payload-Listen haben eine stabile Reihenfolge.

Verstehen Sie Beibehaltung und Ablauf: Payloads werden 7 Tage beibehalten; Webhooks, die mit PAT/OAuth erstellt wurden, verfallen nach 7 Tagen, es sei denn, sie werden erneut gelistet.

Entwerfen Sie Ihren Sync-Arbeitsprozess so, dass er keine Ereignisse verpasst, wenn ein Ping verloren geht: der „Payloads über Cursor abrufen“-Ansatz ist Ihr zuverlässiges Mechanismus.

Wenn Sie die Komplexität der Webhooks-API nicht verwalten möchten, schlägt Airtable selbst vor, dass einige Use-Cases „einfacher“ sein können, indem Sie eine Automatisierung mit „Ein Skript ausführen“ verwenden, um eine POST-Anfrage an Ihr Endpunkt zu senden.

Deployment-Notizen: CI/CD, Infra-as-Code, Sicherheit und Backups

CI/CD und Release-Sicherheit

Behandeln Sie Airtable-Integrationen wie jede andere Produktionsabhängigkeit:

Testen Sie Ihre Mapping-Schicht (Airtable-Feld ↔ Domain-Modell) mit Einheitstests.

Fügen Sie Vertragstests gegen eine dedizierte „Sandbox Base“ hinzu, damit Schema-Änderungen früh erkannt werden.

Überwachen Sie 429s und Latenz; 429 ist unter Burst-Lasten normal, da Airtable 5 Anfragen/Sekunde/Base erzwingt.

Infra as Code: Deployen Sie die Integration, nicht die Tabellenansicht

Airtable selbst ist SaaS, aber Ihr Integrationsservice kann mit Terraform (AWS Lambda + API Gateway Webhook-Receiver, GCP Cloud Run, Kubernetes, usw.) deployed werden. Der Fokus auf IaC ist normalerweise:

Netzwerk für eingehenden Webhook-Receiver

Geheimnisse-Verteilung (PAT in einem Geheimnisse-Manager; injiziert zur Laufzeit)

Geplante Jobs (cron) für periodische Reconciliation-Syncs

Beobachtbarkeit (Logs/Metriken)

Sicherheit: Halten Sie Tokens serverseitig, verwenden Sie minimale Berechtigung, rotieren Sie

Airtable Enterprise API-Dokumentation warnt, dass Anfragen, die Tokens exponieren, nicht clientseitig gemacht werden sollten, da Tokens exponiert werden würden; der sichere Standard ist serverseitige Anfragen.

Airtables offizielle JS-Client README warnt auch vor dem Platzieren von API-Schlüsseln auf Webseiten und schlägt vor, bei Bedarf separate Konten/Geteilte Zugriff zu verwenden.

Kombinieren Sie dies mit PAT-Bereichsgrenzen (nur erforderliche Aktionen + nur erforderliche Bases) und Sie erhalten eine praktische minimale Berechtigungsposition.

Backups und Katastrophenwiederherstellung: Verlassen Sie sich nicht auf kurze Revisionsgeschichte

Free-Plan-Revisionsgeschichte ist zwei Wochen, Team/Business sind ein Jahr.

Wenn Airtable für Geschäfts-kritische Zwecke ist, implementieren Sie:

API-basierte Export-Snapshots in Objektstorage (täglich)

Replikation in einen widerstandsfähigen Datenspeicher (Postgres/warehouse)

Cursor-basierte Webhook-Einbindung, wo anwendbar, mit Verständnis für Payload-Beibehaltung, die 7 Tage beträgt.

URL-Länge und Filterkomplexität: Planen Sie für POST-Fallback

Airtable erzwingt eine 16.000-Characters-URL-Länge-Grenze für Web API-Anfragen und empfiehlt Umgehungen; insbesondere erwähnt es, dass es eine POST-Version des GET list table records Endpunkts gibt, um Optionen in den Anfragebody zu legen anstatt in Query-Parametern.

Dies ist wichtig, wenn Ihr DevOps-Pipeline komplexe filterByFormula-Ausdrücke oder lange Sortierungen/Feldlisten baut.

Durch das Entwerfen um Free-Plan-Kapazitäten, Standard-Rate-Limits und cursorbasierte Änderungserfassung kann Airtable eine hochwirksame „ops UI + Integrationsoberfläche“ für DevOps- und AI-orientierte Teams sein – besonders wenn sie mit einem widerstandsfähigen Speicher für Skalierung und Auditabilität kombiniert wird.