Comparação: Qwen3:30b vs GPT-OSS:20b

Comparando velocidade, parâmetros e desempenho desses dois modelos

Aqui está uma comparação entre Qwen3:30b e GPT-OSS:20b, focando na seguir instruções e parâmetros de desempenho, especificações e velocidade.

Comparando velocidade, parâmetros e desempenho desses dois modelos

Aqui está uma comparação entre Qwen3:30b e GPT-OSS:20b, focando na seguir instruções e parâmetros de desempenho, especificações e velocidade.

Estimativas aproximadas de custos de hospedagem versus assinatura.

Aqui está uma informação rápida sobre Write.as / WriteFreely – como se encaixa no fediverse, onde obter hospedagem gerenciada, qual é a tendência de uso e como autohospedar (além de estimativas de custos).

+ Exemplos Específicos Utilizando LLMs de Raciocínio

Neste post, exploraremos duas maneiras de conectar sua aplicação Python ao Ollama: 1. Via API REST HTTP; 2. Via a biblioteca oficial Python do Ollama.

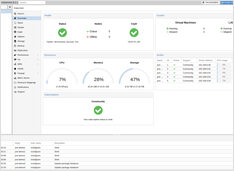

O que é o Proxmox?

Ambiente Virtual Proxmox (Proxmox VE) é uma plataforma de orquestração de datacenter e hipervisor tipo 1 de código aberto construída sobre o Debian.

Preços de GPUs de Consumo Adequadas para IA - RTX 5080 e RTX 5090

Vamos comparar os preços das GPUs de consumo de topo, adequadas em particular para LLMs e para IA em geral. Especificamente, estou a olhar para Preços da RTX-5080 e RTX-5090. Eles caíram ligeiramente.

Não é muito agradável.

Os modelos GPT-OSS da Ollama apresentam problemas recorrentes no manuseio de saída estruturada, especialmente quando utilizados com frameworks como LangChain, SDK da OpenAI, vllm e outros.

Algumas maneiras de obter saídas estruturadas do Ollama

Modelos de Linguagem de Grande Escala (LLMs) são poderosos, mas em produção raramente queremos parágrafos de texto livre. Em vez disso, queremos dados previsíveis: atributos, fatos ou objetos estruturados que você possa alimentar em um aplicativo. Isso é Saída Estruturada de LLM.

Testei tanto o Kubuntu quanto o KDE Neon; o Kubuntu é mais estável.

Para os fãs do KDE Plasma, duas distribuições Linux frequentemente surgem nas discussões: Kubuntu e KDE Neon. Elas podem parecer semelhantes — ambas vêm com o KDE Plasma como ambiente de desktop padrão, ambas são baseadas no Ubuntu e ambas são amigáveis para iniciantes.

Meu próprio teste de agendamento de modelos Ollama

Aqui estou comparando quanto VRAM a nova versão do Ollama alocava para o modelo em relação à versão anterior do Ollama. A nova versão é pior.

Notas sobre a configuração de IP estático no Linux

Este guia irá guiá-lo através do processo de alteração do endereço IP estático em um servidor Ubuntu.

Minha visão sobre o estado atual do desenvolvimento do Ollama

A Ollama tornou-se rapidamente uma das ferramentas mais populares para executar LLMs localmente.

Sua CLI simples e gestão de modelos simplificada tornaram-na uma opção preferencial para desenvolvedores que desejam trabalhar com modelos de IA fora da nuvem.

Plataforma alternativa de voz sobre IP

Mumble é um aplicativo de voz sobre IP (VoIP) gratuito e de código aberto, projetado principalmente para comunicação de voz em tempo real. Ele utiliza uma arquitetura cliente-servidor, onde os usuários se conectam a um servidor compartilhado para conversar entre si.

Visão geral rápida das principais interfaces de usuário para Ollama em 2025

O Ollama hospedado localmente permite executar modelos de linguagem grandes na sua própria máquina, mas usá-lo via linha de comando não é amigável. Aqui estão vários projetos de código aberto que oferecem interfaces estilo ChatGPT que se conectam a uma instância local do Ollama.

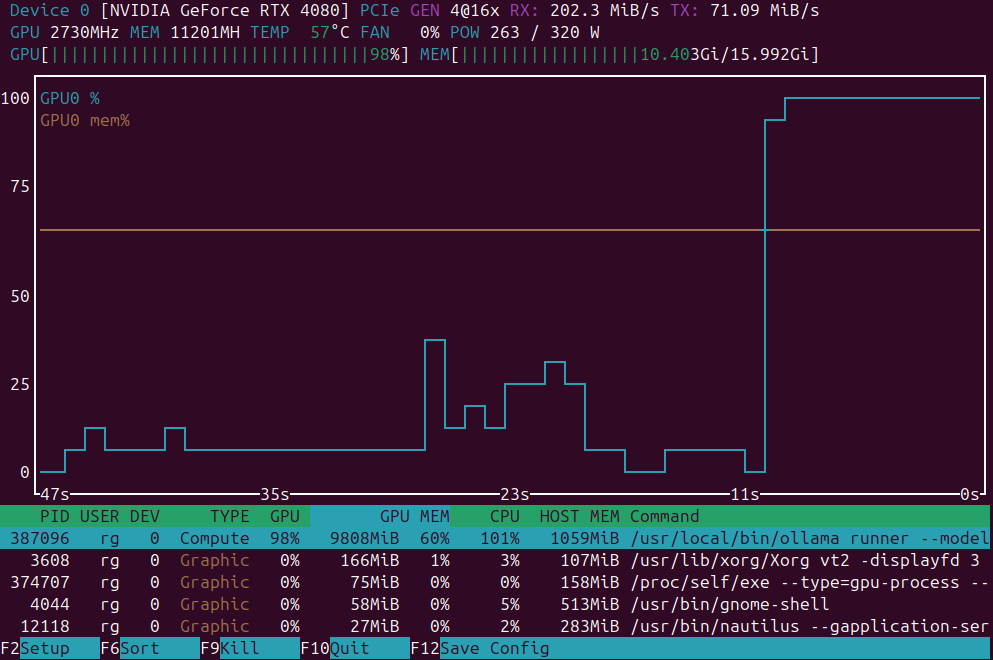

Pequena lista de aplicativos para monitoramento de carga da GPU

Aplicações de monitoramento de carga da GPU: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

Instalando o Kubernetes k3s em um cluster homelab

Aqui está um passo a passo para a instalação de um cluster K3s de 3 nós em servidores bare-metal (1 mestre + 2 workers).

Visão geral muito breve das variantes do Kubernetes

Comparando distribuições de Kubernetes auto-hospedado para hospedagem em servidores bare-metal ou domésticos, focando na facilidade de instalação, desempenho, requisitos de sistema e conjunto de recursos.