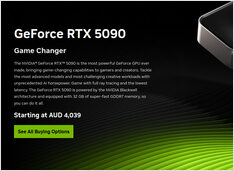

Preços do DGX Spark AU: US$ 6.249–US$ 7.999 em grandes varejistas

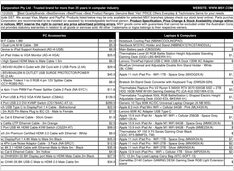

Preços reais em AUD de varejistas australianos agora

O NVIDIA DGX Spark (GB10 Grace Blackwell) está agora disponível na Austrália nas principais lojas de computadores, com estoque local. Se você tem acompanhado os preços e disponibilidade globais do DGX Spark, terá interesse em saber que os preços na Austrália variam de A$ 6.249 a A$ 7.999, dependendo da configuração de armazenamento e do varejista.