GraphQL BFF bouwen met Apollo Server

Optimizeer frontend APIs met GraphQL BFF en Apollo Server

De Backend for Frontend (BFF) patroon gecombineerd met GraphQL en Apollo Server creëert een krachtige architectuur voor moderne webtoepassingen.

Optimizeer frontend APIs met GraphQL BFF en Apollo Server

De Backend for Frontend (BFF) patroon gecombineerd met GraphQL en Apollo Server creëert een krachtige architectuur voor moderne webtoepassingen.

Elasticsearch-commando's voor zoeken, indexeren en analyse

Elasticsearch is een krachtige gedistribueerde zoek- en analyse-engine gebouwd op Apache Lucene. Dit uitgebreide naslagwerk dekt essentiële commando’s, best practices en snelle referenties voor het werken met Elasticsearch-clusters.

Maak MCP-servers voor AI-assistenten met Python-voorbeelden

De Model Context Protocol (MCP) is revolutionair voor de manier waarop AI-assistenten met externe gegevensbronnen en tools interacteren. In deze gids bespreken we hoe je MCP-servers in Python kunt bouwen, met voorbeelden gericht op webzoekfuncties en web scraping.

Snelle verwijzing naar Docker Model Runner-commands

Docker Model Runner (DMR) is de officiële oplossing van Docker voor het lokaal uitvoeren van AI-modellen, geïntroduceerd in april 2025. Deze cheatsheet biedt een snelle verwijzing naar alle essentiële opdrachten, configuraties en beste praktijken.

Vergelijk Docker Model Runner en Ollama voor lokale LLM

Het uitvoeren van grote taalmodellen (LLMs) lokaal is steeds populairder geworden vanwege privacy, kostcontrole en offlinefunctionaliteiten. Het landschap is aanzienlijk veranderd in april 2025 toen Docker Docker Model Runner (DMR) introduceerde, hun officiële oplossing voor AI-modellering.

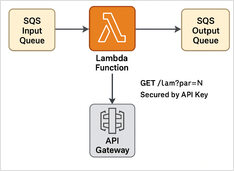

Stap-voor-stap voorbeeld

Hier hebben we een Python Lambda-voorbeeld van een SQS-berichtverwerker + REST API met API-sleutelbeveiliging + Terraform script om het te implementeren voor serverloze uitvoering.

+ Specifieke Voorbeelden Met Denkende LLMs

In dit bericht gaan we twee manieren bespreken om je Python-toepassing te verbinden met Ollama: 1. Via de HTTP REST API; 2. Via de officiële Ollama Python-bibliotheek.

Ietwat afwijkende API's vereisen een speciale aanpak.

Hieronder volgt een vergelijking van de ondersteuning voor gestructureerde output (betrouwbaar JSON terugkrijgen) bij populaire LLM-aanbieders, plus minimale Python-voorbeelden