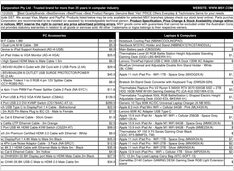

Precios de DGX Spark AU: $6.249-$7.999 en principales minoristas

Precios reales en AUD de minoristas australianos ahora

El NVIDIA DGX Spark (GB10 Grace Blackwell) ya está disponible en Australia en los principales minoristas de PC con stock local. Si has estado siguiendo los precios y disponibilidad globales del DGX Spark, te interesará saber que los precios en Australia oscilan entre $6.249 y $7.999 AUD, dependiendo de la configuración de almacenamiento y del minorista.