Airtable dla programistów i DevOps - plany, API, Webhooki oraz przykłady w Go i Pythonie

Airtable - ograniczenia planu bezpłatnego, API, webhooks, Go & Python.

Airtable najlepiej można opisać jako platformę o niskim poziomie kodowania, zbudowaną wokół współdzielonego interfejsu “spreadsheet-like” (podobnego do arkusza kalkulacyjnego), który jest świetny do szybkiego tworzenia narzędzi operacyjnych (wewnętrznych śledzi, lekkich CRM, potoków treści, kolejek ocen AI), gdzie nieprogramiści potrzebują przyjaznego interfejsu, a programiści potrzebują powierzchni API do automatyzacji i integracji.

Własne materiały Airtable opisują Web API jako RESTful, korzystając z JSON i standardowych kodów statusów HTTP.

Dwa ograniczenia, które najbardziej kształtują decyzje inżynierskie, to:

Ściśle określone suwaki w planie Free: 1 000 rekordów na bazę, 1 000 wywołań API na przestrzeń roboczą na miesiąc, 1 GB miejsca na załączniki na bazę, oraz tylko dwie tygodnie historii wersji/snapshotów.

Te liczby są wystarczająco niskie, aby traktować “Free Airtable” jako prototyp, demonstrację, projekt hobbystyczny lub bardzo mały wewnętrzny przepływ pracy, a nie jako produkcyjne magazynowanie danych, które są ciągle kwerendowane przez usługi.

Ograniczenia limitów przepustowości publicznego Web API: Airtable wymusza 5 żądań/sekunda na bazę i także 50 żądań/sekunda dla wszystkich ruchu korzystającego z tokenów dostępu osobistych z danego użytkownika lub konta usługi. Jeśli przekroczysz te limity, otrzymasz HTTP 429 i (według wskazówek Airtable) musisz zaczekać ok. 30 sekund, zanim ponowisz próbę.

Konsekwencją jest architektoniczna: zachodź w kroki, kachuj odczyty, preferuj webhooki nad opóźnieniem dla wykrywania zmian i buduj ponowne próby/odstępy w każdym kliencie.

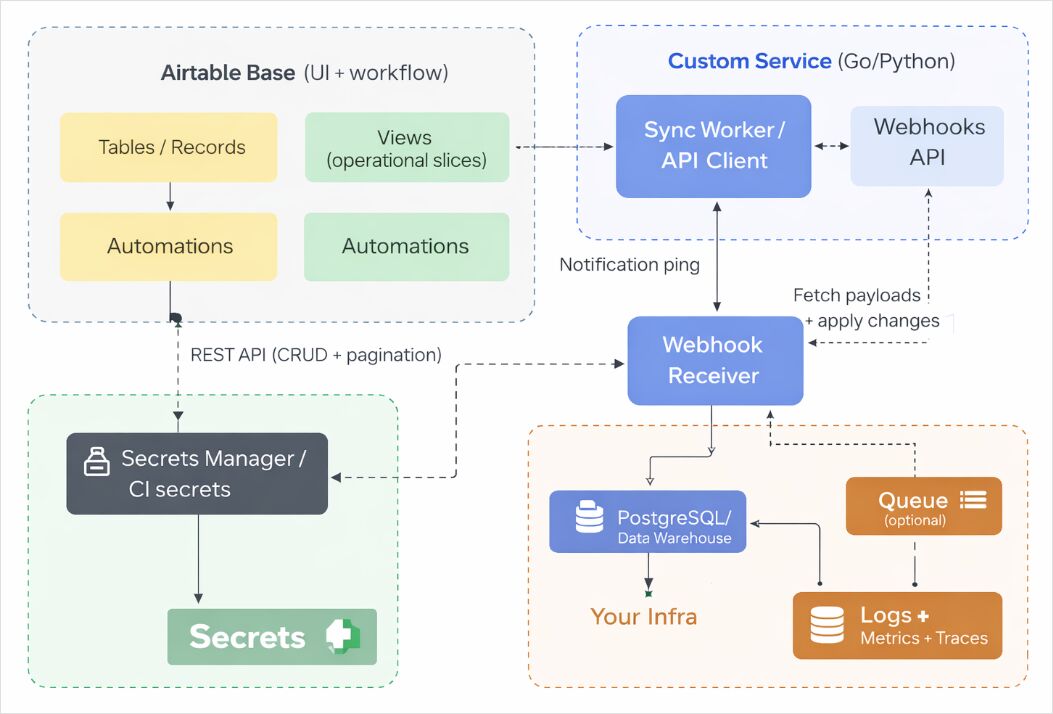

Jeśli chcesz Airtable w systemie niestandardowym, skuteczny wzorzec “DevOps + backend” w środowisku produkcyjnym to:

Airtable jako operacyjny interfejs + lekkie źródło prawdy dla ograniczonego zestawu danych (reguły routingu, kolejki do przeglądu przez ludzi, plany edycyjne, kroki wdrażania klienta).

Oddzielny system (PostgreSQL/magazyn/obiektowe magazynowanie) jako trwały magazyn główny dla skalowalności, audytu, kopii zapasowych, analiz i wyższych QPS odczytów/zapisów.

Warstwa synchronizacji, która pobiera strony rekordów (offset pagination), wysyła zmiany w partiiach i opcjonalnie korzysta z webhooków Airtable, aby zmniejszyć opóźnienie.

Dla ogólnego obrazu: magazynowanie obiektowe, PostgreSQL, Elasticsearch i warstwy danych natywnych dla AI - zobacz artykuł Infrastruktura danych dla systemów AI.

Co to jest Airtable i dlaczego deweloperzy korzystają z niego jako bazę danych o niskim poziomie kodowania

Kernowy abstrakcja Airtable to baza: kontener dla powiązanych tabel i artefaktów procesu pracy (widoki, interfejsy, automatyzacje). W praktyce, baza często mapuje się na granice dziedzin biznesowych - operacje treści, postmortemy incydentów, oceny LLM, żądania klientów.

Wewnątrz bazy modelujesz dane jako:

Tabele: analogiczne do jednostek/collections.

Rekordy: wiersze.

Pola: kolumny z bogatymi typami (wybory, załączniki, linki, formuły itp.).

Następnie tworzysz wiele “lup” nad tą samą tabelą za pomocą widoków - filtrowanych, posortowanych, grupowanych reprezentacji zoptymalizowanych dla konkretnych zadań. Dokumentacja Airtable podkreśla, że widoki pomagają Ci “widzieć rekordy najbardziej istotne dla Ciebie” i mogą być dostosowane do różnych odbiorców.

Deweloperzy odnoszą się do Airtable, gdy potrzebują:

Przyjaznego interfejsu użytkownika dla użytkowników biznesowych, aby szybko tworzyć/aktualizować dane operacyjne (bez oczekiwania na niestandardową aplikację administracyjną).

Programowalnej powierzchni backendu poprzez Web API Airtable do importu, synchronizacji i automatyzacji. API korzysta z semantyki REST i JSON, co sprawia, że łatwe jest do integracji z usługami Go/Python.

Łączenie SaaS/flow za pomocą integracji i automatyzacji, gdzie niektóre kroki mogą być w pełni zaimplementowane w Airtable, a inne obsłużone w kodzie. Automatyzacje Airtable opisuje się jako przepływy działania (np. “kiedy utworzono rekord → wysłać wiadomość / zaktualizować rekord / uruchomić skrypt”).

Airtable jest szczególnie produktywny dla zespołów DevOps + AI, gdy jest używany jako:

Tabela kontrolowana zmianami: np. metadane flag funkcji, własność usług, ścieżki eskalacji, zatwierdzenia wdrażania.

Kolejka do przeglądu przez ludzi: np. wyjścia LLM czekające na weryfikację, triaż bezpieczeństwa, zadania iteracji promptów.

Indeks metadanych dla aktywów znajdujących się gdzie indziej: URI S3, SHA commitów Git, ID zestawów danych - minimalizując presję magazynowania załączników na samym Airtable (ważne w przypadku Free).

Główne funkcje Airtable: bazy, tabele, pola, widoki, interfejsy, rozszerzenia, automatyzacje i integracje

“Siła” Airtable nie jest tylko w tabelach; to otaczająca je powierzchnia procesu pracy, która sprawia, że baza zachowuje się jak lekka platforma aplikacji.

Bazy i tabele do strukturalnej współpracy

Baza to miejsce, gdzie zespoły współwlasnią strukturalne dane i stan procesu. Praktyczny implikacja inżynierska to rządzenie schematem: jeśli użytkownicy biznesowi mogą zmieniać nazwy pól lub tabel, Twoi klienci API mogą się zepsuć, chyba że zaprojektujesz zmiany.

Dwa taktiki zmniejszają awarie:

Użyj stabilnych ID w kodzie, jeśli to możliwe. Airtable jawnie zauważa, że przy aktualizacjach rekordów nazwy tabel i ID tabel mogą być używane zamiennie, i zaleca ID tabel, aby nie musieć zmieniać żądań, gdy nazwy się zmieniają.

Dokumentuj “pole sprzężone z API” w opisach pól i traktuj zmiany jako kontrolowane wydarzenia (przegląd PR / żądanie zmiany).

Widoki i “lupy” procesu pracy

Widoki umożliwiają filtrowanie/sortowanie/grupowanie rekordów dla konkretnych procesów (widok triażu, “do przeglądu”, “gotowy do wysyłki”). Airtable podkreśla, że widoki są mechanizmem, który pokazuje tylko “najbardziej istotne” podzbiory rekordów dla różnych użytkowników.

Z perspektywy integracji, możesz zaprojektować widok jako stabilny kontrakt: np. Twój job synchronizacyjny odczytuje tylko rekordy w widoku “Eksport”, zamiast próbować powtórzyć wszystkie logiki filtrowania w kodzie. (API również obsługuje wybieranie rekordów według widoku i za pomocą formuł filtrowania; zobacz sekcję API poniżej.)

Rozszerzenia, rynki aplikacji i “przyniesienie własnych narzędzi”

Airtable obsługuje “Rozszerzenia” (wcześniej “Blocks”), które dodają możliwości wewnątrz bazy (wykresy, skrypty, importy itp.). Własna przeglądarka Airtable przedstawia rozszerzenia jako dodatki stworzone przez Airtable i trzecie strony.

Krytycznie, Rozszerzenia nie są obsługiwane w planie Free, więc każdy proces pracy zależny od nich zaczyna się od zespołu lub wyższych planów.

Automatyzacje: wyzwalacze, działania i skryptowanie jako klej integracji

Automatyzacje to przepływy działania: Airtable podaje wyzwalacze, w tym “kiedy utworzono/aktualizowano rekord”, “kiedy rekord wejdzie do widoku”, wyzwalacze czasowe, i “kiedy otrzymano webhook”, między innymi.

Dziaania obejmują tworzenie/aktualizowanie rekordów, wysyłanie wiadomości i (ważne dla deweloperów) uruchamianie kodu: działanie “Uruchom skrypt” uruchamia skrypty “w tle bazy” i jest położone jako właściwy wybór dla skryptów, które mają być wykonywane automatycznie.

Jednak “Uruchom skrypt” jest jawnie oznaczone jako niedostępne w planie Free, co ma znaczenie, jeśli założenie architektury to “użyj automatyzacji Airtable, aby wywołać nasze wewnętrzne API”.

Web API i integracje jako interfejs inżynieryjny

Web API Airtable umożliwia systemom zewnętrznym odczytywanie/zapisywanie rekordów za pomocą standardowych wywołań HTTP. Dokumentacja Airtable podaje konkretny wzór URL, tak jak:

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5 (przykład dla filtrowania formuł).

Airtable również udostępnia warstwę metadanych (korzystną dla wzorców “konfiguracja jako kod” w DevOps), w tym listowanie baz za pomocą GET https://api.airtable.com/v0/meta/bases i tworzenie bazy za pomocą POST https://api.airtable.com/v0/meta/bases (wymaga zakresów schematu).

W kwestii uwierzytelniania, Airtable odstępuje od starszych kluczy API: jego oficjalny harmonogram wygasania zawiera wygasanie kluczy API w dniu 1 lutego 2024 r..

Plany cenowe Airtable i limity planu Free dla deweloperów

Nazwy planów i przywileje Airtable zmieniają się w czasie, ale bieżąca dokumentacja planów Airtable zawiera jawne, inżyniersko znaczące kwoty i ograniczenia.

Tabela planów Airtable: kluczowe limity wpływające na integracje API

| Plan (self-serve, chyba że zaznaczone) | Rekordy na bazę | Wywołania API na przestrzeń roboczą / miesiąc | Magazynowanie załączników na bazę | Historia wersji/snapshotów | Znaczące ograniczenia / uwagi |

|---|---|---|---|---|---|

| Free | 1 000 | 1 000 | 1 GB | 2 tygodnie | Brak rozszerzeń; dodatkowe ograniczenia interfejsu; limity współpracowników; zawiera kredyty AI na edytora+ |

| Team | 50 000 | 100 000 | 20 GB | 1 rok | Zawiera automatyzacje, rozszerzenia, formularze, projektanta interfejsu, Timeline/Gantt, widoki zablokowane/ osobiste i więcej |

| Business | 125 000 | Nieograniczone | 100 GB | 1 rok | Zawiera dwukierunkową synchronizację i panel administratora (i wymaga prywatnych domen e-mail) |

| Enterprise Scale (sprzedaż) | (zmienna) | (zmienna) | (zmienna) | (zmienna) | Sprzedawane/ zarządzane przez sprzedaż; Business/Enterprise wymagają prywatnych domen e-mail |

Ceny planów Team i Business w dokumentacji planów Airtable są wypisane na użytkownika (opłata miesięczna vs roczna).

Głębokie badanie planu Free: limity i praktyczne konsekwencje dla DevOps i systemów backend

W planie Free otrzymujesz:

1 000 rekordów na bazę.

To pierwsza “architektoniczna funkcja wymuszająca”: raz przekroczysz ok. 1 000 rekordów dla dziedziny, albo dzielisz na wiele baz (co komplikuje integracje), albo agresywnie archiwizujesz, albo przenosisz główny zestaw danych gdzie indziej (Postgres/magazyn) i zachowujesz tylko “aktywne” wersje operacyjne w Airtable.

1 000 wywołań API na przestrzeń roboczą na miesiąc.

To niskie wystarczające, aby prostego strategii synchronizacji (kwerenda co minutę) szybko zużyła kwotę. Dokumentacja limitów wywołań API Airtable jawnie opisuje API jako RESTful i zauważa, że operacje listy rekordów zwracają strony z maksymalnie 100 rekordami; jeśli powtarzysz kwerendy, szybko wyczerpiesz miesięczne wywołania.

Dlatego integracja w planie Free powinna domyślnie korzystać z:

aktualizacji opartych na wydarzeniach za pośrednictwem webhooków (jeśli to możliwe),

lub synchronizacji ręcznej / użytkownika,

lub bardzo niskiej częstotliwości zadania w partii (codziennie),

plus kachowania, aby uniknąć powtarzanych odczytów. Airtable jawnie zaleca podejście kachowania/proxy jako strategię zarządzania limitami przepustowości.

1 GB miejsca na załączniki na bazę.

Dla AI/LLM, to pułap, jeśli przechowujesz PDFy, obrazy lub zestawy danych jako załączniki. Preferuj przechowywanie załączników w magazynie obiektowym i przechowuj tylko URL-y i metadane w Airtable.

2 tygodnie historii wersji/snapshotów.

Z punktu widzenia DevOps, ograniczona historia zmniejsza Twoją zdolność do odzyskiwania się z przypadkowych zmian masowych. Jeśli Airtable jest krytyczny operacyjnie, powinieneś zaimplementować zewnętrzne kopie zapasowe/snapshoty (zadania eksportu API), a nie polegać tylko na historii wersji.

Plan Free ma również ograniczenia współpracy i usunięcia funkcji, które mają znaczenie dla dostawy:

Nieograniczone współpracownicy tylko do odczytu, ale tylko 5 współpracowników z uprawnieniami Edytor/Creator i 50 Komentarzy.

Brak Rozszerzeń w planie Free.

Niektóre możliwości automatyzacji są ograniczone: działanie “Uruchom skrypt” jest oznaczone jako niedostępne w planie Free.

Alternatywy i konkurenci Airtable: Notion vs Google Sheets vs Coda vs ClickUp vs PostgreSQL + UI

Airtable nie jest domyślną odpowiedzią na każde “tabele + workflow” użycie. Prawidłowy wybór zależy od tego, czy Twoja główną potrzebą jest:

bazę operacyjną podobną do bazy danych z interfejsem (Airtable / Coda),

przestrzeń pracy opartą na dokumentach z wbudowanymi bazami danych (Notion),

zupełną kompatybilność arkuszy kalkulacyjnych (Google Sheets),

zarządzanie zadaniami / projektami (ClickUp),

czy prawdziwy magazyn danych backend z celowo zaprojektowanym interfejsem administratora (PostgreSQL + Retool/Appsmith/etc.).

Tabela porównania konkurencji: inżynierskie kompromisy (API, UI, skalowalność)

| Narzędzie | Najlepsze w | Typowe limity / model ograniczania przepustowości | Kluczowe kompromisy w porównaniu do Airtable |

|---|---|---|---|

| Notion | Dokumentacja i bazy danych wbudowane w dokumenty | API Notion jest ograniczany i wymusza rozmiar żądania / podstawowe limity. | Świetne do dokumentów / RAG wejść i narracyjnych przepływów pracy; bazy danych są potężne, ale często mniej “ops-table” skupione niż Airtable; wzorce integracji różnią się (potrzeba jawnej udostępniania do integracji). |

| Google Sheets | Kompatybilność arkuszy kalkulacyjnych, formuły, szeroka ekosystema | API Sheets ma limity na minutę; Google dokumenty sugerują ~2 MB ładunki. | Świetne, gdy potrzebujesz semantyki arkuszy i kompatybilności; trudniej tworzyć doświadczenia aplikacyjne (uprawnienia, formularze, relacyjne łączenie) bez dodatkowego narzędzia. |

| Coda | Hybryda dokumentu i tabeli z “pakami” i automatyzacją | Coda deklaruje, że jego API ogranicza przepustowość i zwraca 429, gdy są przekroczone; zaleca cofanie się i ponowne próby. | Silna fuzja dokumentu / tabeli; jeśli chcesz aplikacje operacyjne typu Airtable, model Airtable może wydawać się jaśniejszy; limity przepustowości i limity dokumentów różnią się w zależności od planu. |

| ClickUp | Zarządzanie zadaniami / projektami | ClickUp stosuje limity na tokenach i zmienia limity w zależności od planu przestrzeni roboczej (np. 100 żądań/min/na token w niższych poziomach, wyższe w innych). | Najlepsze, gdy “zadania” są głównym elementem; użycie jako ogólna baza danych jest trudne; silne w przepływach pracy, ale słabsze w modelowaniu arbitralnych schematów. |

| PostgreSQL + UI (Retool/Appsmith/custom) | Trwały system rekordu, silna spójność, skalowalność | Zależy od Twojej infrastruktury; brak SaaS-wymuszonych “5 QPS na bazę” typowych suwaków | Więcej pracy inżynierskiej od początku; ale najlepsze dla wysokiego QPS, ścisłej poprawności, audytu, złożonych zapytań i długoterminowej utrzywalności - potem dodaj interfejs administratora dla użytkowników niebędących deweloperami. |

Użyteczna zasada: jeśli przewidujesz częste odczyty / zapisy, złożone potrzeby zapytań lub ścisły kontrola zmian, zazwyczaj chcesz “Postgres-first”. Jeśli przewidujesz ciężką edycję przez nieprogramistów i szybkie iteracje przepływów pracy, Airtable jest przekonujący - szczególnie dla narzędzi wewnętrznych - pod warunkiem, że zaprojektujesz wokół API i plan limitów.

Wzorce DevOps Airtable i end-to-end integracja API z Go i Python

Ta sekcja daje kompletną, produkcyjną ścieżkę od konfiguracji → bezpiecznego uwierzytelnienia → klientów CRUD → paginacji → obsługi limitów przepustowości → partii → webhooków → notatek wdrażania.

Diagram integracji SEO: architektura API Airtable dla systemów przyjaznych DevOps

Konfiguracja i uwierzytelnienie: stabilne ID, tokeny i minimalne uprawnienia

Preferuj ID tabel w kodzie, aby zmniejszyć zmiany

Airtable zauważa, że nazwy tabel i ID tabel mogą być używane zamiennie i zaleca ID tabel, aby uniknąć zmian żądań, gdy nazwy się zmieniają.

W praktyce, to jedna z największych wyższych “higienicznych decyzji Ops”, które możesz podejmować dla integracji opartej na Airtable.

Aby znaleźć ID, Airtable udostępnia wskazówki dotyczące znajdowania ID baz i tabel z URL (i przez dokumentację API).

Użyj tokenów dostępu osobistych (PAT), a nie starszych kluczy API

Oficjalna lista wygasania Airtable zawiera “1 lutego 2024 r. - wygasanie kluczy API”.

PATs są opisane przez Airtable jako umożliwiające tworzenie wielu tokenów z różnymi zakresami - od wąskich (jeden zakres + jedna baza) do szerokich (wszystkie przestrzenie robocze / bazy / zakresy dozwolone przez użytkownika).

Praktyczna operacyjna najlepsza praktyka to: tworzenie wielu PATs na powierzchnię integracji (np. jeden token do synchronizacji tylko do odczytu, inny do ścieżek zapisu) i obracanie ich jak każdy inny sekret.

Dla odporności typu enterprise (integracja nie powinna umierać, gdy pracownik opuszcza firmę), Airtable opisuje konta usługi zaprojektowane do integracji API, niezależnie od konkretnego użytkownika.

Minimalne zmienne środowiskowe dla przykładów Go i Python

# Wymagane

export AIRTABLE_TOKEN="pat_xxx..." # Token dostępu osobistego

export AIRTABLE_BASE_ID="appXXXXXXXXXXXXXX" # ID bazy

export AIRTABLE_TABLE="tblYYYYYYYYYYYYYY" # Preferowany ID tabeli; nazwa tabeli również działa

# Opcjonalne (filtry / zachowanie)

export AIRTABLE_PAGE_SIZE="100" # 100 to maksymalny rozmiar listy rekordów

export AIRTABLE_TIMEOUT_SECONDS="30"

Fundamentalne podstawy API kształtujące projekt klienta: paginacja, limity przepustowości, partia

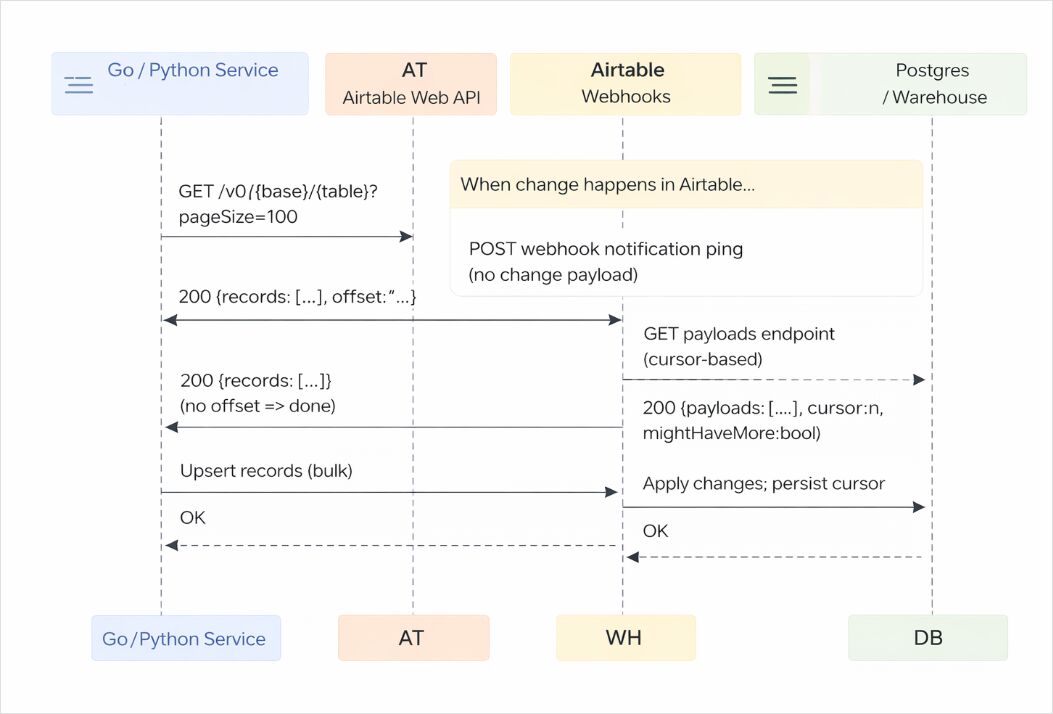

Paginacja: listy rekordów zwracają do 100 rekordów na żądanie

Airtable dokumentuje, że odpowiedzi “listy rekordów” są stronicowane do 100 rekordów naraz; jeśli tabela ma więcej niż 100, musisz wykonać wiele żądań i użyć zwracanego offsetu jako parametru zapytania dla następnego żądania.

Parametr pageSize może zmniejszyć rozmiar strony, ale 100 to maksimum.

Filtracja i sortowanie: filterByFormula i parametry sortowania

Airtable udostępnia konkretne przykłady użycia filterByFormula i parametrów sort[...], w tym klasyczny kształt URL takiego jak:

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5

Limity przepustowości i strategia ponownego prób: traktuj 429 jako normalne

Dokumentacja limitów wywołań API Airtable mówi:

5 żądań na sekundę na bazę,

50 żądań na sekundę na użytkownika / konto usługi korzystającego z ruchu PAT,

i jeśli przekroczysz, otrzymasz 429 i musisz zaczekać 30 sekund, zanim kolejne żądania będą udane.

Przewodnik rozwiązywania problemów Airtable podkreśla, że 429 może oznaczać, że przekroczyłeś limit 5 req/base/sec i radzi, aby poczekać przed ponownym próbą.

Partie: projektuj wokół “do 10 rekordów na żądanie”

Airtable jawnie dokumentuje partycjonowanie jako strategię limitu przepustowości: API “wspiera partycjonowanie”, obsługując “do 10 rekordów na żądanie”.

A także endpoint Airtable “Update multiple records” demonstruje kształt żądania partii (records: [...]) i również obsługuje performUpsert z fieldsToMergeOn.

Diagram sekwencji SEO: sekwencja wywołań API Airtable dla listy → paginacji → partii aktualizacji → pobrania ładunku webhook

Przykład Go: gotowy do produkcji klient REST Airtable z paginacją, ponownymi próbami i partiami

Ten program Go demonstruje:

Uwierzytelnienie PAT przez Authorization: Bearer ... (Bearer auth jest wymagane).

Paginację listy rekordów za pomocą offset i pageSize (maksymalnie 100).

Zarządzanie limitami przepustowości dla 429 z fallbackiem Retry-After i wskazówkami Airtable “czekać ok. 30 sekund”.

Partię aktualizacji za pomocą oficjalnego PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName} kształtu.

Kształt punktu końcowego aktualizacji pojedynczego rekordu (semantyka PATCH/PUT).

Przykład filtrowania (filterByFormula) wzorca URL.

Wymagania do działania: zalecane Go 1.21+; ustaw

AIRTABLE_TOKEN,AIRTABLE_BASE_ID,AIRTABLE_TABLE.

// Plik: main.go

package main

import (

"bytes"

"context"

"encoding/json"

"errors"

"fmt"

"io"

"net/http"

"net/url"

"os"

"strconv"

"time"

)

type AirtableClient struct {

BaseID string

Token string

HTTPClient *http.Client

}

type airtableError struct {

Error interface{} `json:"error"`

}

type Record struct {

ID string `json:"id"`

CreatedTime string `json:"createdTime,omitempty"`

Fields map[string]interface{} `json:"fields"`

}

type listRecordsResponse struct {

Records []Record `json:"records"`

Offset string `json:"offset,omitempty"`

}

func mustEnv(key string) string {

v := os.Getenv(key)

if v == "" {

fmt.Fprintf(os.Stderr, "missing env var: %s\n", key)

os.Exit(2)

}

return v

}

func (c *AirtableClient) doJSON(ctx context.Context, method, rawURL string, body any, out any) (*http.Response, error) {

var reqBody io.Reader

if body != nil {

b, err := json.Marshal(body)

if err != nil {

return nil, fmt.Errorf("marshal body: %w", err)

}

reqBody = bytes.NewReader(b)

}

req, err := http.NewRequestWithContext(ctx, method, rawURL, reqBody)

if err != nil {

return nil, err

}

req.Header.Set("Authorization", "Bearer "+c.Token) // Bearer wymagany

req.Header.Set("Content-Type", "application/json")

// Prosty pętla ponownych prób, która traktuje 429 jako normalne. Wskazówki Airtable: czekać ok. 30s.

var lastResp *http.Response

for attempt := 0; attempt < 6; attempt++ {

resp, err := c.HTTPClient.Do(req)

if err != nil {

return nil, err

}

lastResp = resp

if resp.StatusCode != http.StatusTooManyRequests {

if out == nil {

return resp, nil

}

defer resp.Body.Close()

if resp.StatusCode < 200 || resp.StatusCode >= 300 {

b, _ := io.ReadAll(resp.Body)

return resp, fmt.Errorf("http %d: %s", resp.StatusCode, string(b))

}

if err := json.NewDecoder(resp.Body).Decode(out); err != nil {

return resp, fmt.Errorf("decode response: %w", err)

}

return resp, nil

}

// Obsługa 429

resp.Body.Close()

wait := 30 * time.Second // Wskazówki Airtable: czekać 30 sekund przed kolejnymi żądaniami

if ra := resp.Header.Get("Retry-After"); ra != "" {

if secs, err := strconv.Atoi(ra); err == nil && secs > 0 {

wait = time.Duration(secs) * time.Second

}

}

time.Sleep(wait)

// Przewinięcie ciała dla ponownego prób, jeśli jest to konieczne (bezpieczne, ponieważ używamy bytes.NewReader).

if reqBody != nil {

if seeker, ok := reqBody.(io.Seeker); ok {

_, _ = seeker.Seek(0, io.SeekStart)

}

}

}

return lastResp, errors.New("too many retries after 429")

}

// ListRecords paginuje z offsetem; pageSize maksymalnie 100

func (c *AirtableClient) ListRecords(ctx context.Context, table string, pageSize int, filterByFormula string) ([]Record, error) {

if pageSize <= 0 || pageSize > 100 {

pageSize = 100

}

var out []Record

var offset string

for {

u := url.URL{

Scheme: "https",

Host: "api.airtable.com",

Path: fmt.Sprintf("/v0/%s/%s", c.BaseID, table),

}

q := u.Query()

q.Set("pageSize", strconv.Itoa(pageSize))

if offset != "" {

q.Set("offset", offset)

}

if filterByFormula != "" {

// Przykład wzorca w dokumentacji Airtable

q.Set("filterByFormula", filterByFormula)

}

u.RawQuery = q.Encode()

var page listRecordsResponse

_, err := c.doJSON(ctx, http.MethodGet, u.String(), nil, &page)

if err != nil {

return nil, err

}

out = append(out, page.Records...)

if page.Offset == "" {

return out, nil

}

offset = page.Offset

}

}

// UpdateMultiple demonstruje oficjalny kształt PATCH.

func (c *AirtableClient) UpdateMultiple(ctx context.Context, table string, records []Record) ([]Record, error) {

type reqBody struct {

Records []Record `json:"records"`

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

var resp struct {

Records []Record `json:"records"`

}

_, err := c.doJSON(ctx, http.MethodPatch, u, reqBody{Records: records}, &resp)

if err != nil {

return nil, err

}

return resp.Records, nil

}

// UpsertMultiple używa performUpsert (fieldsToMergeOn) na endpointze aktualizacji partii.

func (c *AirtableClient) UpsertMultiple(ctx context.Context, table string, mergeOn []string, records []Record) error {

body := map[string]any{

"performUpsert": map[string]any{

"fieldsToMergeOn": mergeOn,

},

"records": records,

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

_, err := c.doJSON(ctx, http.MethodPatch, u, body, nil)

return err

}

// UpdateRecord demonstruje semantykę punktu końcowego PATCH/PUT dla pojedynczego rekordu.

func (c *AirtableClient) UpdateRecord(ctx context.Context, table, recordID string, fields map[string]any) (Record, error) {

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s/%s", c.BaseID, table, recordID)

body := map[string]any{"fields": fields}

var resp Record

_, err := c.doJSON(ctx, http.MethodPatch, u, body, &resp)

return resp, err

}

func chunk[T any](items []T, n int) [][]T {

if n <= 0 {

return [][]T{items}

}

var out [][]T

for i := 0; i < len(items); i += n {

j := i + n

if j > len(items) {

j = len(items)

}

out = append(out, items[i:j])

}

return out

}

func main() {

ctx, cancel := context.WithTimeout(context.Background(), 60*time.Second)

defer cancel()

token := mustEnv("AIRTABLE_TOKEN")

baseID := mustEnv("AIRTABLE_BASE_ID")

table := mustEnv("AIRTABLE_TABLE")

c := &AirtableClient{

BaseID: baseID,

Token: token,

HTTPClient: &http.Client{

Timeout: 30 * time.Second,

},

}

// Przykład: lista wszystkich rekordów z filtrem formuły (przystosuj formułę do swojego schematu).

records, err := c.ListRecords(ctx, table, 100, "")

if err != nil {

panic(err)

}

fmt.Printf("listed %d records\n", len(records))

// Przykład: aktualizacja w partii w fragmentach (Airtable obsługuje partycjonowanie jako strategię, maksymalnie 10 na żądanie).

// Tutaj aktualizujemy maksymalnie 10 na raz.

var updates []Record

for i := 0; i < len(records) && i < 3; i++ {

updates = append(updates, Record{

ID: records[i].ID,

Fields: map[string]any{

"Visited": true,

},

})

}

for _, part := range chunk(updates, 10) {

updated, err := c.UpdateMultiple(ctx, table, part)

if err != nil {

panic(err)

}

fmt.Printf("updated %d records\n", len(updated))

}

}

Przykład Pythona: integracja Airtable z requests i odbiornikiem webhook

Ta implementacja Pythona zawiera:

Bezpośrednie wywołania REST z uwierzytelnieniem Bearer.

Paginację z offset i pageSize (maksymalnie 100).

Obsługę 429 zgodną z wskazówkami Airtable (czekać ok. 30 sekund).

Aktualizację partii z oficjalnym endpointem update-multiple i performUpsert.

Zachowanie odbiornika webhook, który potwierdza: webhook pings nie zawierają ładunku zmian, więc musisz osobno pobrać ładunki, a ładunki są przechowywane przez 7 dni; webhooki mogą wygasać po 7 dniach, chyba że zostaną odświeżone.

Uwaga: szczegóły endpointu Airtable “List webhook payloads” są odniesione w przewodniku webhook Airtable, ale najbardziej niezawodnie indeksowany publiczny tekst to sam przewodnik i przykłady społecznościowe. Krytyczne fakty operacyjne przewodnika (brak ładunku w ping, przechowywanie, wygasanie) to kluczowe fakty.

# Plik: airtable_client.py

import os

import time

import json

import typing as t

import requests

from urllib.parse import urlencode

AIRTABLE_TOKEN = os.environ["AIRTABLE_TOKEN"]

AIRTABLE_BASE_ID = os.environ["AIRTABLE_BASE_ID"]

AIRTABLE_TABLE = os.environ["AIRTABLE_TABLE"]

SESSION = requests.Session()

SESSION.headers.update({

"Authorization": f"Bearer {AIRTABLE_TOKEN}", # Uwierzytelnienie Bearer wymagane

"Content-Type": "application/json",

})

def _airtable_request(method: str, url: str, *, params=None, json_body=None, max_retries: int = 5) -> requests.Response:

for attempt in range(max_retries + 1):

resp = SESSION.request(method, url, params=params, json=json_body, timeout=30)

if resp.status_code != 429:

return resp

# Wskazówki Airtable: czekać ok. 30s po 429

retry_after = resp.headers.get("Retry-After")

wait = 30

if retry_after and retry_after.isdigit():

wait = int(retry_after)

time.sleep(wait)

raise RuntimeError(f"Zbyt wiele ponownych prób po 429 dla {method} {url}")

def list_records(page_size: int = 100, filter_by_formula: str | None = None) -> list[dict]:

# pageSize maksymalnie 100

page_size = min(max(page_size, 1), 100)

base_url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

all_records: list[dict] = []

offset: str | None = None

while True:

params = {"pageSize": page_size}

if offset:

params["offset"] = offset

if filter_by_formula:

# Przykład wzorca opisany przez Airtable

params["filterByFormula"] = filter_by_formula

resp = _airtable_request("GET", base_url, params=params)

resp.raise_for_status()

data = resp.json()

all_records.extend(data.get("records", []))

offset = data.get("offset")

if not offset:

break

return all_records

def update_multiple_records(records: list[dict], perform_upsert_fields: list[str] | None = None) -> dict:

"""

Używa PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName}

z ciałem { "records": [ { "id": "...", "fields": {...} }, ... ] }

i opcjonalnym performUpsert, zgodnie z dokumentacją Airtable.

"""

url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

body: dict[str, t.Any] = {"records": records}

if perform_upsert_fields:

body["performUpsert"] = {"fieldsToMergeOn": perform_upsert_fields}

resp = _airtable_request("PATCH", url, json_body=body)

resp.raise_for_status()

return resp.json()

def webhook_receiver_example():

"""

Minimalny wzorzec; w produkcji użyj Flask/FastAPI i zweryfikuj podpisy.

Przewodnik webhook Airtable zauważa:

- Powiadomienie ping nie zawiera ładunku zmian

- Ładunki muszą być pobrane z endpointu GET payloads

- Ładunki są przechowywane przez 7 dni

- Webhooki utworzone przez PAT/OAuth wygasają po 7 dniach, chyba że zostaną odświeżone/listowane

"""

pass

if __name__ == "__main__":

rows = list_records(page_size=100)

print(f"Pobrano {len(rows)} rekordów")

# Przykład: aktualizacja pierwszych 2 rekordów (podziel w 10s; Airtable obsługuje partycjonowanie do 10 rekordów/żądanie jako strategię).

updates = []

for r in rows[:2]:

updates.append({"id": r["id"], "fields": {"Visited": True}})

if updates:

result = update_multiple_records(updates)

print(json.dumps(result, indent=2))

Odbiornik webhook: trwałość kursora i “brak ładunku w ping”

Dla produkcyjnego odbiornika webhook, Twoje kluczowe zadania to:

Zwrot szybkiego odpowiedzi sukcesu (np. HTTP 204).

Trwałe przechowywanie kursora webhook, aby nie ponownie przetwarzać starych ładunków.

Pobieranie ładunków po pings; przewodnik webhook ostrzega, że kolejność pingów nie jest gwarantowana, ale listy ładunków mają stabilną kolejność.

Zrozumienie przechowywania i wygasania: ładunki są przechowywane przez 7 dni; webhooki utworzone przez PAT/OAuth wygasają po 7 dniach, chyba że zostaną odświeżone (listowanie ładunków może wydłużyć życie).

Zaprojektuj swój pracownika synchronizacji tak, aby nie przegapił wydarzeń, jeśli ping zostanie utracony: metoda “pobierz ładunki za pomocą kursora” to Twój trwały mechanizm.

Jeśli nie chcesz zarządzać złożonością API webhook, Airtable sam sugeruje, że niektóre przypadki użycia mogą być “bardziej proste” za pomocą Automatyzacji z “Uruchom skrypt”, który wysyła żądanie POST do Twojego punktu końcowego.

Uwagi dotyczące wdrażania: CI/CD, infrastruktura jako kod, bezpieczeństwo i kopie zapasowe

CI/CD i bezpieczeństwo wypuszczenia

Traktuj integracje Airtable jak każdy inny produktowy zależność:

Testuj swoje warstwy mapowania (pole Airtable ↔ model dziedzinowy).

Dodaj testy kontraktu w dedykowanej bazie “sandbox”, aby wczesnie wykrywać zmiany schematu.

Monitoruj 429 i opóźnienia; 429 jest normalne pod obciążeniem impulsowym, ponieważ Airtable wymusza 5 req/sec/base.

Infrastruktura jako kod: wdrażaj integrację, a nie arkusz

Airtable sam w sobie jest SaaS, ale Twoja usługa integracji może być wdrażana z Terraform (AWS Lambda + API Gateway odbiornik webhook, GCP Cloud Run, Kubernetes itp.). Skupienie się na IaC zwykle obejmuje:

Sieć dla wewnętrznych odbiorników webhook

Rozproszenie sekretów (PAT w menedżerze sekretów; wstrzyknięty w czasie działania)

Zadania zaplanowane (cron) do okresowych synchronizacji

Obserwowalność (logi/metryki)

Bezpieczeństwo: zachowuj tokeny po stronie serwera, używaj minimalnych uprawnień, obracaj

Dokumentacja API Enterprise Airtable ostrzega, że żądania ujawniające tokeny nie powinny być wykonywane po stronie klienta, ponieważ tokeny zostaną ujawnione; bezpieczna norma to żądania po stronie serwera.

Oficjalna dokumentacja README klienta JS Airtable również ostrzega przed umieszczaniem kluczy API na stronach sieciowych i sugeruje użycie osobnych kont / udostępniania, jeśli to konieczne.

Połączone z zakresem PAT (tylko wymagane działania + tylko wymagane bazy) otrzymujesz praktyczne postawy minimalnych uprawnień.

Kopie zapasowe i odzyskiwanie po awarii: nie opieraj się na krótkiej historii zmian

Historia zmian w planie Free to dwie tygodnie, Team/Business to roczna.

Jeśli Airtable jest krytyczny biznesowo, zaimplementuj:

Kopie zapasowe na podstawie API do magazynu obiektowego (codziennie)

Replicację do trwało magazynu (Postgres/magazyn)

W przypadku odpowiednich miejsc, wdrażanie webhook z kursorami, zrozumiając, że przechowywanie ładunków to 7 dni.

Długość URL i złożoność filtru: planuj na fallback do POST

Airtable wymusza limit długości URL 16 000 znaków dla żądań Web API i zaleca alternatywy; szczególnie stwierdza, że istnieje POST wersja GET endpointu listy tabel, aby umieścić opcje w ciele żądania zamiast parametrów zapytania.

To ma znaczenie, jeśli Twój pipeline DevOps tworzy złożone filterByFormula wyrażenia lub długie sortowania / listy pól.

Projektując wokół suwaków planu Free, standardowych limitów przepustowości i przechwytywania zmian opartych na kursorze, Airtable może być bardzo skutecznym “interfejsem operacyjnym + powierzchnią integracji” dla zespołów DevOps i skupionych na AI - szczególnie, gdy jest połączony z trwałą bazą danych dla skalowalności i audytu.