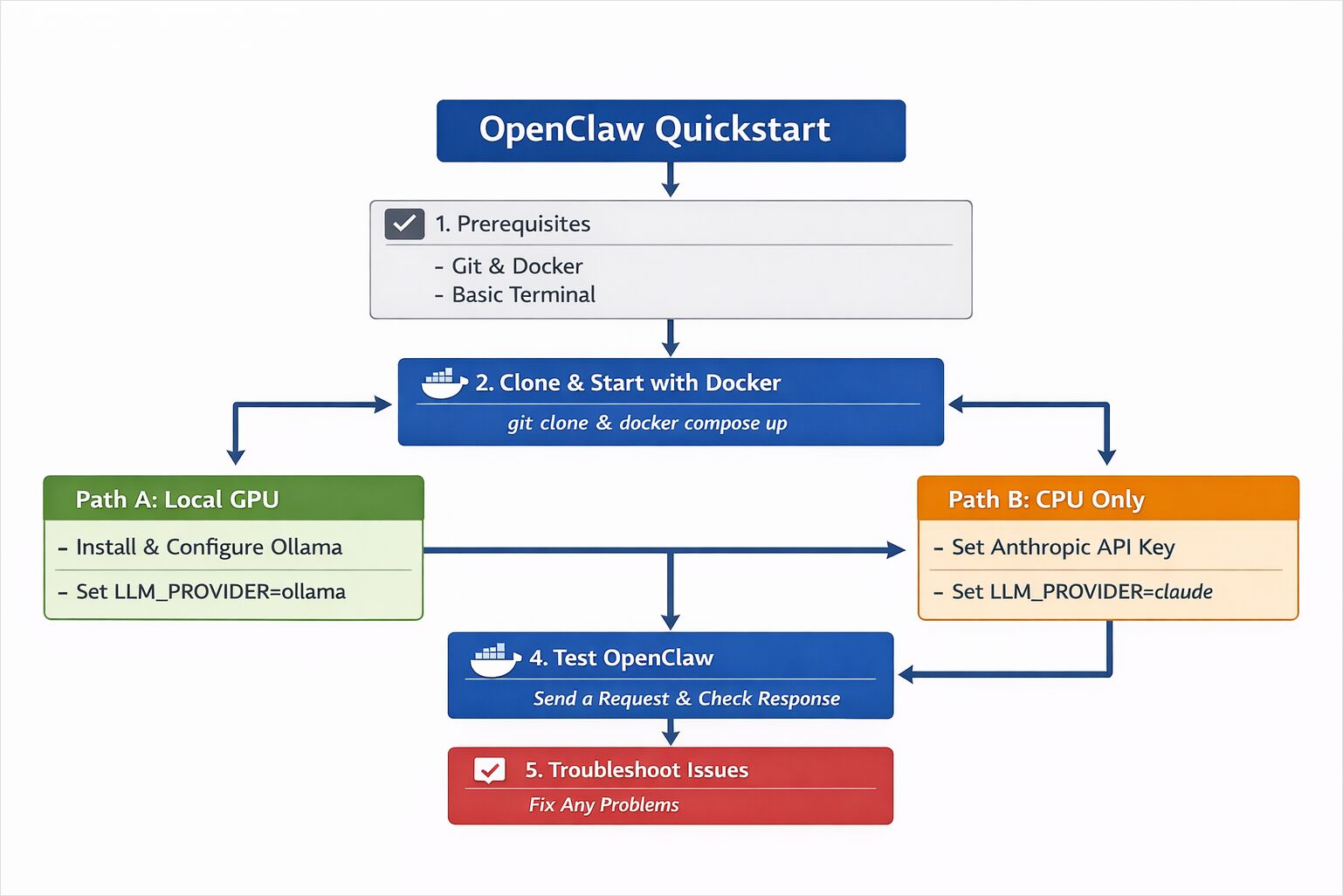

OpenClaw Quickstart: Instalacja za pomocą Docker (Ollama GPU lub Claude CPU)

Zainstaluj OpenClaw lokalnie z użyciem Ollama

OpenClaw to samowystarczalny asystent AI, który można uruchomić z lokalnymi środowiskami uruchomieniowymi LLM, takimi jak Ollama, lub z modelami opartymi o chmurę, takimi jak Claude Sonnet.

Ten przewodnik pokazuje, jak wdrożyć OpenClaw za pomocą Dockera, skonfigurować model lokalny z GPU lub model oparty na CPU w chmurze, a także potwierdzić, że Twój asystent AI działa poprawnie od końca do końca.

Ten przewodnik pokazuje minimalne ustawienie OpenClaw, dzięki czemu możesz zobaczyć, jak działa i odpowiada na Twoim własnym komputerze.

Celem jest proste:

- Uruchomienie OpenClaw.

- Wyślij żądanie.

- Potwierdzenie, że działa.

To nie jest przewodnik po wzmocnieniu systemu do produkcji. To nie jest przewodnik po optymalizacji wydajności. To praktyczny punkt wyjścia.

Masz dwa opcje:

- Ścieżka A — lokalny GPU z użyciem Ollama (zalecana, jeśli masz GPU)

- Ścieżka B — tylko CPU z użyciem Claude Sonnet 4.6 przez API Anthropic

Obie ścieżki dzielą się tym samym podstawowym procesem instalacji.

Jeśli jesteś nowy w OpenClaw i chcesz uzyskać głębszy przegląd tego, jak jest strukturalnie zbudowany system, przeczytaj ogólny opis systemu OpenClaw.

Wymagania systemowe i konfiguracja środowiska

OpenClaw to system typu asystent, który może łączyć się z zewnętrznymi usługami. Dla tego przewodnika:

- W miarę możliwości używaj testowych kont.

- Unikaj łączenia wrażliwych systemów produkcyjnych.

- Uruchamiaj wewnątrz Docker (zalecane).

Izolacja to dobre ustawienie domyślne, gdy eksperymentujesz z oprogramowaniem typu agent.

Wymagania wstępne OpenClaw (GPU z Ollama lub CPU z Claude)

Wymagane dla obu ścieżek

- Git

- Docker Desktop (lub Docker + Docker Compose)

- Terminal

Dla ścieżki A (lokalny GPU)

- Komputer z kompatybilnym GPU (NVIDIA lub AMD zalecane)

- Zainstalowany Ollama

Dla ścieżki B (tylko CPU + model w chmurze)

- Klucz API Anthropic

- Dostęp do Claude Sonnet 4.6

Krok 1 — Instalacja OpenClaw z użyciem Docker (kopia i uruchomienie)

OpenClaw można uruchomić za pomocą Docker Compose. To utrzymuje ustawienie w izolacji i umożliwia powtarzalność.

Skopiuj repozytorium

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Skopiuj konfigurację środowiska

cp .env.example .env

Otwórz plik .env w edytorze. Skonfigurujemy go w kolejnym kroku, w zależności od wybranej ścieżki modelu.

Uruchom kontenery

docker compose up -d

Jeśli wszystko zostanie uruchomione poprawnie, powinieneś zobaczyć działające kontenery:

docker ps

W tym momencie OpenClaw jest uruchomiony — ale jeszcze nie jest połączony z modelem.

Krok 2 — Konfiguracja dostawcy LLM (Ollama GPU lub Claude CPU)

Teraz postanów, jak chcesz, aby inferencja działała.

Ścieżka A — lokalny GPU z Ollama

Jeśli masz dostęp do GPU, to jest najprostsza i najbardziej samowystarczalna opcja.

Zainstaluj lub sprawdź Ollama

Jeśli potrzebujesz bardziej szczegółowego przewodnika instalacyjnego lub chcesz skonfigurować lokalizacje przechowywania modeli, zobacz:

- Zainstaluj Ollama i skonfiguruj lokalizację modeli

- Pomocnik CLI Ollama: ls, serve, run, ps + inne polecenia (aktualizacja 2026)

Jeśli Ollama nie jest zainstalowany:

curl -fsSL https://ollama.com/install.sh | sh

Sprawdź, czy działa:

ollama pull llama3

ollama run llama3

Jeśli model odpowiada, inferencja działa.

Skonfiguruj OpenClaw do użycia Ollama

W pliku .env skonfiguruj:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Uruchom ponownie kontenery:

docker compose restart

OpenClaw będzie teraz kierował żądania do lokalnej instancji Ollama.

Jeśli decydujesz, który model uruchomić na GPU z 16 GB pamięci wirtualnej lub chcesz zobaczyć porównania wydajności, zobacz:

Aby zrozumieć współbieżność i zachowanie CPU przy obciążeniu:

- Jak Ollama obsługuje żądania równoległe

- Test: Jak Ollama wykorzystuje wydajność procesora Intel i efektywne jądra

Ścieżka B — tylko CPU z użyciem Claude Sonnet 4.6

Jeśli nie masz GPU, możesz użyć modelu hostowanego.

Dodaj swój klucz API

W pliku .env:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

Uruchom ponownie:

docker compose restart

OpenClaw będzie teraz używał Claude Sonnet 4.6 do inferencji, podczas gdy orkestracja działa lokalnie.

To ustawienie działa dobrze na maszynach z tylko CPU, ponieważ ciężka obliczeniowa część modelu odbywa się w chmurze.

Krok 3 — Testowanie OpenClaw pierwszym promptem

Po uruchomieniu kontenerów i skonfigurowaniu modelu możesz przetestować asystenta.

W zależności od Twojej konfiguracji, może to odbywać się przez:

- interfejs sieciowy

- integrację z komunikacją

- lokalny punkt końcowy API

Dla podstawowego testu API:

curl http://localhost:3000/health

Powinieneś zobaczyć odpowiedź o stanie zdrowia.

Teraz wysyłaj prosty prompt:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Wyjaśnij, co robi OpenClaw w prostych słowach."}'

Jeśli otrzymasz strukturalną odpowiedź, system działa.

Co właśnie uruchomiłeś

W tym momencie masz:

- działającą instancję OpenClaw

- skonfigurowanego dostawcę LLM (lokalnego lub w chmurze)

- działający pętlę żądania i odpowiedzi

Jeśli wybrałeś ścieżkę GPU, inferencja odbywa się lokalnie za pomocą Ollama.

Jeśli wybrałeś ścieżkę CPU, inferencja odbywa się za pomocą Claude Sonnet 4.6, podczas gdy orkestracja, routing i obsługa pamięci odbywa się wewnątrz lokalnych kontenerów Docker.

Widoczna interakcja może wyglądać prosto. Pod spodem, wiele komponentów koordynuje się, aby przetworzyć Twoje żądanie.

Rozwiązywanie problemów z instalacją i działaniem OpenClaw

Model nie odpowiada

- Sprawdź konfigurację

.env. - Sprawdź logi kontenerów:

docker compose logs

Ollama nie jest dostępny

- Potwierdź, że Ollama działa:

ollama list

- Upewnij się, że adres URL podstawowy odpowiada Twojemu środowisku.

Nieprawidłowy klucz API

- Sprawdź ponownie

ANTHROPIC_API_KEY. - Uruchom kontenery ponownie po aktualizacji

.env.

GPU nie jest używany

- Potwierdź, że są zainstalowane sterowniki GPU.

- Upewnij się, że Docker ma włączony dostęp do GPU.

Kolejne kroki po zainstalowaniu OpenClaw

Teraz masz działającą instancję OpenClaw.

Od tego momentu możesz:

- połączyć platformy komunikacyjne

- włączyć odzyskiwanie dokumentów

- eksperymentować z strategiami routingu

- dodać obserwowalność i metryki

- dostrajać wydajność i zachowanie kosztów

Głębsze dyskusje architektoniczne mają więcej sensu, gdy system działa.

Zapewnienie jego działania to pierwszy krok.