Ollama モデルの保存場所を変更する

Ollama の LLM モデルファイルは非常に多くのディスク領域を占有します。

ollama のインストール 後、すぐに Ollama を再設定して、新しい場所にモデルを保存するようにするのが良いでしょう。そうすれば、新しいモデルをプルした際に、古い場所にダウンロードされなくなります。

Ollama について

Ollama は、LLM AI モデル へのテキストベースのフロントエンドであり、それらをホストするための API も提供します。 Ollama と vLLM、Docker Model Runner、LocalAI、そしてクラウドプロバイダーとの包括的な比較(コストやインフラストラクチャのトレードオフを含む)については、LLM ホスティング:ローカル、セルフホスト、クラウドインフラストラクチャの比較 を参照してください。

Ollama のインストール

https://ollama.com/download へアクセスしてください。

Linux での Ollama のインストール手順は以下の通りです:

curl -fsSL https://ollama.com/install.sh | sh

Windows 用の Ollama は以下のページにあります:https://ollama.com/download/windows Mac 用もあります:https://ollama.com/download/macOllamaSetup.exe

Ollama モデルのダウンロード、一覧表示、削除

Ollama モデルをダウンロードするには: Ollama ライブラリ (https://ollama.com/library) にアクセスし、必要なモデルを検索してください。そこでモデルのタグやサイズも確認できます。

次に、以下のコマンドを実行します:

ollama pull gemma2:latest

# または、16GB VRAM にすっきり収まる少し賢いモデルを取得:

ollama pull gemma2:27b-instruct-q3_K_S

# または:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

ローカルリポジトリにある Ollama のモデルを確認するには:

ollama list

不要なモデルを削除するには:

ollama rm qwen2:7b-instruct-q8_0 # 例

Ollama モデルの保存場所

デフォルトでは、モデルファイルは以下の場所に保存されます:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

Ollama がコンテナ内で実行される際にも同様の保存場所に関する懸念が生じます。モデルとサーバーの状態を名前付きボリュームまたはバインドマウントに配置したい場合、およびデフォルトの /root/.ollama パスとは異なるレイアウトが必要な場合は(オプションで)OLLAMA_MODELS を使用します。GPU リザベーション、OLLAMA_HOST、アップグレード、ロールバックパターンを含む完全な Compose レイアウトについては、Docker Compose による Ollama の実行(GPU および永続的モデルストレージ付) を参照してください。

Windows での Ollama モデルパスの設定

Windows で環境変数を作成するには、以下の手順に従ってください:

- Windows の設定を開く。

- システムへ移動。

- 詳細を選択。

- 詳細なシステム設定を選択。

- 詳細タブへ移動。

- 環境変数…を選択。

- 新規…をクリック。

- モデルを保存したい場所を指す変数として

OLLAMA_MODELSを作成します。

Linux での Ollama モデルの移動

ollama systemd サービスのパラメータを編集します:

sudo systemctl edit ollama.service

または

sudo xed /etc/systemd/system/ollama.service

これでエディタが開きます。

[Service] セクションの下に、各環境変数に対して Environment ラインを追加します:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

保存して終了します。

また、User と Group パラメータも存在し、これらはそのフォルダへのアクセス権限を持っている必要があります。

systemd をリロードし、Ollama を再起動します:

sudo systemctl daemon-reload

sudo systemctl restart ollama

何か問題が発生した場合は:

systemctl status ollama.service

sudo journalctl -u ollama.service

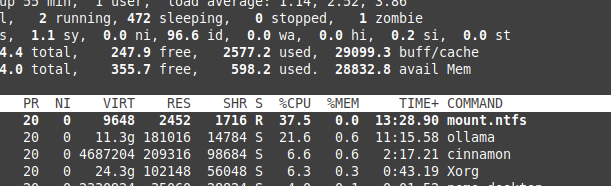

NTFS 上のファイル保存によるオーバーヘッド

Linux を実行しており、モデルを NTFS 形式のパーティションに保存している場合、モデルの読み込み速度が 20% 以上遅くなることに注意してください。

Windows で特定のフォルダに Ollama をインストール

モデルと共に:

.\OllamaSetup.exe /DIR=D:\OllamaDir

Ollama API を内部ネットワークに公開

ここでは内部とはローカルネットワークを指します。

サービス設定に以下を追加します:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

これにより、ネットワーク上でプレーン HTTP API が公開されます。自動 HTTPS、正しいストリーミング、Caddy または Nginx 経由の WebSocket プロキシ、およびエッジの強化(タイムアウト、バッファリング、API 前のオプション認証)については、Caddy または Nginx による HTTPS ストリーミングのためのリバースプロキシ背後の Ollama を使用してください。

公開ポートを開けないでリモートデバイスから Ollama にアクセスするには、プライベートオーバーレイ(Tailscale)または WireGuard を使用します。詳しくは 公開ポートなしの Tailscale または WireGuard を通じたリモート Ollama アクセス を参照してください。

Ollama が他のローカルおよびクラウド LLM オプションにどのように適合するかを確認するには、LLM ホスティング:ローカル、セルフホスト、クラウドインフラストラクチャの比較 ガイドを確認してください。