OpenClaw クイックスタート: Docker でインストール (Ollama GPU または Claude CPU)

ローカルに OpenClaw を Ollama でインストールする

OpenClawは、OllamaなどのローカルLLMランタイムや、Claude Sonnetなどのクラウドベースのモデルを使用して動作する、セルフホスト型のAIアシスタントです。

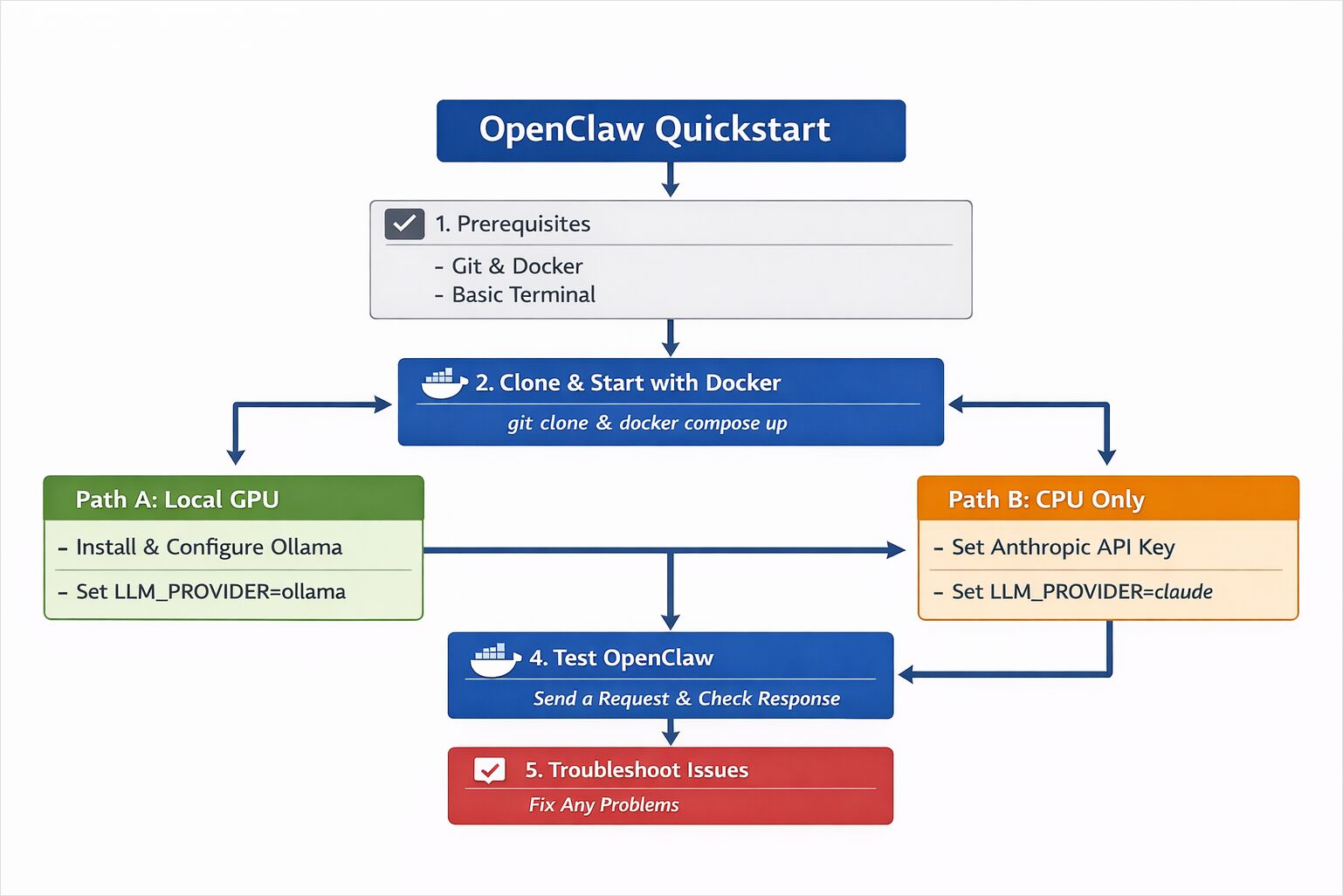

このクイックスタートでは、Dockerを使用してOpenClawをデプロイし、GPUを搭載したローカルモデルまたはCPU専用のクラウドモデルを構成し、AIアシスタントがエンドツーエンドで動作することを確認する方法を示します。

このガイドでは、OpenClawの最小限のセットアップを説明し、自分のマシン上で動作して応答することを確認できます。

目標は単純です:

- OpenClawを動作させます。

- リクエストを送信します。

- それが動作することを確認します。

これは生産性の強化ガイドではありません。

これはパフォーマンスのチューニングガイドではありません。

これは実用的なスタート地点です。

2つのオプションがあります:

- パスA — ローカルGPU Ollamaを使用(GPUがある場合は推奨)

- パスB — CPU専用 Anthropic APIを介してClaude Sonnet 4.6を使用

両方のパスは同じコアのインストールプロセスを共有しています。

OpenClawに初めて触れる場合は、システムの構造についてより深く理解したい場合は、OpenClawシステム概要を参照してください。

システム要件と環境設定

OpenClawは、外部サービスに接続できるアシスタントスタイルのシステムです。このクイックスタートでは:

- できる限りテストアカウントを使用してください。

- 敏感な生産システムへの接続は避けてください。

- Docker内で実行することを推奨します(Docker DesktopまたはDocker + Docker Compose)。

エージェントスタイルのソフトウェアを試行錯誤する際には、分離が良いデフォルトです。

OpenClawの前提条件(GPU + OllamaまたはCPU + Claude)

両方のパスで必要なもの

- Git

- Docker Desktop(またはDocker + Docker Compose)

- テルミナル

パスA(ローカルGPU)

- 互換性のあるGPUを搭載したマシン(NVIDIAまたはAMDが推奨)

- Ollamaがインストール済み

パスB(CPU + クラウドモデル)

- Anthropic APIキー

- Claude Sonnet 4.6へのアクセス

ステップ1 — Dockerを使用してOpenClawをインストール(クローン&起動)

Docker Composeを使用してOpenClawを起動できます。これにより、セットアップが含まれており、再現性が高まります。

リポジトリをクローン

git clone https://github.com/openclaw/openclaw.git

cd openclaw

環境設定ファイルをコピー

cp .env.example .env

.envファイルをエディタで開き、次のステップで選択したモデルパスに応じて設定します。

コンテナを起動

docker compose up -d

すべてが正しく起動すれば、コンテナが実行されているはずです:

docker ps

この段階では、OpenClawは動作していますが、モデルにはまだ接続されていません。

ステップ2 — LLMプロバイダの設定(Ollama GPUまたはClaude CPU)

今から、推論がどのように動作するかを決めます。

パスA — ローカルGPUを使用してOllamaを設定

GPUが利用できる場合は、最もシンプルで自立的なオプションです。

Ollamaをインストールまたは確認

より詳細なインストールガイドが必要な場合や、モデルのストレージ場所を設定したい場合は、以下を参照してください:

Ollamaがインストールされていない場合は:

curl -fsSL https://ollama.com/install.sh | sh

動作を確認します:

ollama pull llama3

ollama run llama3

モデルが応答すれば、推論が動作しています。

Ollamaを使用してOpenClawを設定

.envファイルで以下を設定します:

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

コンテナを再起動します:

docker compose restart

これで、OpenClawはローカルのOllamaインスタンスにリクエストをルーティングします。

16GBのGPUでどのモデルを実行するかを決めたい場合、またはベンチマーク比較をしたい場合は、以下を参照してください:

並列リクエストの処理方法や、CPUの負荷下での動作を理解したい場合は、以下を参照してください:

パスB — CPU専用でClaude Sonnet 4.6を使用

GPUが利用できない場合は、ホストされたモデルを使用できます。

APIキーを追加

.envファイルに以下を追加します:

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

再起動します:

docker compose restart

これで、OpenClawはClaude Sonnet 4.6を使用して推論を行い、オーケストレーションはローカルで実行されます。

この構成は、CPU専用のマシンでも動作します。重いモデルの計算はクラウドで行われるためです。

ステップ3 — あなたの最初のプロンプトでOpenClawをテスト

コンテナが動作し、モデルが構成された後、アシスタントをテストできます。

設定に応じて、これは以下を通じて実行されます:

- ウェブインターフェース

- メッセージングの統合

- ローカルのAPIエンドポイント

基本的なAPIテストのために:

curl http://localhost:3000/health

健全なステータス応答が表示されるはずです。

今、単純なプロンプトを送信してみましょう:

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explain what OpenClaw does in simple terms."}'

構造化された応答を受け取れば、システムは動作しています。

今実行した内容

この時点で、あなたは以下を実現しています:

- 動作中のOpenClawのインスタンス

- 設定済みのLLMプロバイダ(ローカルまたはクラウド)

- 動作中のリクエスト-応答ループ

GPUのパスを選択した場合は、推論はローカルのOllama経由で行われます。

CPUのパスを選択した場合は、推論はClaude Sonnet 4.6経由で行われ、オーケストレーション、ルーティング、メモリ処理はローカルのDockerコンテナ内で実行されます。

見えるインタラクションはシンプルに見えるかもしれませんが、裏では複数のコンポーネントが協力してリクエストを処理しています。

OpenClawのインストールおよびランタイムのトラブルシューティング

モデルが応答しない

.env設定を確認してください。- コンテナログを確認してください:

docker compose logs

Ollamaにアクセスできない

- Ollamaが動作しているか確認してください:

ollama list

- ベースURLが環境に合っているか確認してください。

無効なAPIキー

ANTHROPIC_API_KEYを再度確認してください。.envを更新した後、コンテナを再起動してください。

GPUが使用されていない

- GPUドライバがインストールされているか確認してください。

- DockerにGPUアクセスが有効になっているか確認してください。

OpenClawをインストールした後の次のステップ

これで、動作するOpenClawのインスタンスが手元にあります。

ここから、以下を行えます:

- メッセージングプラットフォームを接続

- ドキュメントの検索機能を有効化

- ルーティング戦略を試行錯誤

- オブザーバビリティとメトリクスを追加

- パフォーマンスとコストの挙動を調整

システムが動作している状態では、より深いアーキテクチャに関する議論が意味を持ちます。

システムを稼働させることが最初のステップです。