Farfalle contre Perplexica

Comparaison de deux moteurs de recherche IA auto-hébergés

Une excellente cuisine est aussi un plaisir pour les yeux. Mais dans cet article, nous allons comparer deux systèmes de recherche basés sur l’IA, Farfalle et Perplexica.

Entre autres choses, cette forme de pâtes s’appelle aussi “farfalle”.

Mais ici, je compare uniquement le comportement de ces deux systèmes. Pas les formes de pâtes.

D’accord. Concentrez-vous !

Veuillez également consulter Installation et configuration de Perplexica - avec Ollama et Installation et configuration d’Ollama.

Le moteur de réponse que cet article désigne sous le nom de Perplexica est maintenant disponible en amont sous le nom de Vane ; Vane (Perplexica 2.0) Prise en main rapide avec Ollama et llama.cpp est l’endroit où trouver les images Docker actuelles, la configuration SearxNG et le calendrier du renommage.

Perplexica

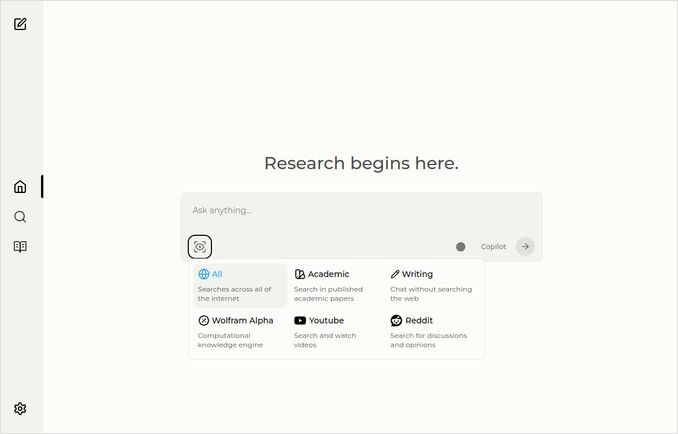

Voici la page d’accueil avec la liste déroulante de sélection des sources.

- Perplexica est implémenté en

- TypeScript et React.Js (Interface utilisateur)

- TypeScript et Express.Js (Backend)

- inclut également la configuration pour le moteur de métarecherche SearxNG

- Possède un mode Copilot

- Peut utiliser n’importe quel LLM hébergé par Ollama comme modèle de chat ou d’incorporation (embedding)

- Dispose de trois petits modèles d’incorporation internes

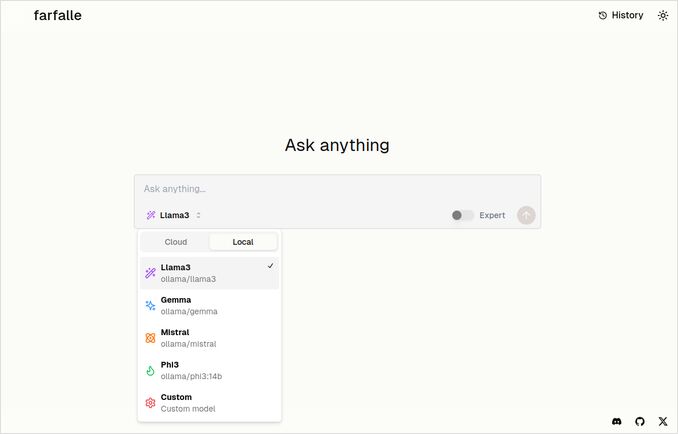

Farfalle

- Farfalle est implémenté en

- TypeScript et React.Js (Interface utilisateur)

- Python Fastapi (Backend)

- inclut également une référence pour le moteur de métarecherche SearxNG. Peu de configuration pour cela, image Docker assez standard.

- Possède un mode Expert qui devrait préparer plusieurs requêtes à partir de la requête originale et combiner les réponses. Mais cela n’a pas fonctionné lors de nos tests.

- Possède la capacité d’utiliser quatre LLM hébergés par Ollama comme modèle de chat (llama3, mistral, gemma, phi3). C’est une bonne gamme d’options, mais j’aurais préféré qu’il soit plus flexible et permette d’utiliser n’importe quel modèle servi par Ollama.

- Aucune option de modèle d’incorporation (embedding)

Comparaison effectuée par Perplexica et Farfalle eux-mêmes

J’ai lancé la même requête : Comparez Farfalle et Perplexica sur la base de la robustesse, de la communauté, du support et des LLM pris en charge.

Perplexica et Farfalle ont tous deux utilisé le modèle llama3 hébergé localement sur Ollama. Le nom complet du modèle est llama3 8b q4.

Ne croyez pas à 100 % ce que disent les réponses, regardez simplement la longueur du texte, la structure et la qualité globale de la réponse.

Je donnerais environ 70 % de crédibilité…

Réponse de comparaison de Perplexica

Comparaison de Farfalle et Perplexica

Robustesse

Farfalle : 8/10 - Farfalle est un moteur de recherche IA populaire connu pour sa fiabilité et sa capacité à gérer des requêtes complexes. Il possède une base solide en traitement du langage naturel (NLP) et en apprentissage automatique (ML). Bien qu’il ne soit pas parfait, la robustesse de Farfalle est bien établie.

Perplexica : 9/10 - Perplexica est construit sur le modèle Phi-3 de Meta AI, conçu pour être robuste. Il a été testé pour fournir des réponses précises même lorsqu’il est confronté à des requêtes ambiguës ou peu claires. Sa capacité à reformuler les questions et à s’adapter à différents contextes en fait un moteur de recherche robuste.

Communauté

Farfalle : 7/10 - Farfalle dispose d’une communauté d’utilisateurs dédiée qui apprécie ses capacités. Bien qu’il n’ait peut-être pas le même niveau d’adoption que Perplexica, la base d’utilisateurs de Farfalle reste significative.

Perplexica : 8.5/10 - Perplexica a obtenu une reconnaissance généralisée pour son approche innovante des moteurs de recherche. Sa communauté croît rapidement, avec de nombreux utilisateurs appréciant sa capacité à fournir des résultats précis et pertinents.

Support

Farfalle : 6.5/10 - Farfalle fournit un support de base via des FAQ, une documentation et des forums. Bien que cela ne soit pas aussi complet que le support de Perplexica, la base d’utilisateurs de Farfalle est généralement autosuffisante.

Perplexica : 9/10 - Perplexica offre des ressources de support étendues, y compris une documentation détaillée, des FAQ et des forums communautaires. Ses développeurs sont activement engagés avec la communauté, s’assurant que les utilisateurs reçoivent une assistance rapide et efficace.

LLMs pris en charge

Farfalle : Non - Farfalle est un moteur de recherche IA autonome qui ne repose pas sur de grands modèles de langage (LLM) pour ses capacités.

Perplexica : Oui - Perplexica est construit sur le modèle Phi-3 de Meta AI, qui est un LLM. Cela permet à Perplexica d’exploiter la puissance de l’apprentissage profond pour des résultats plus précis et pertinents.

Score global Farfalle : 22/30 Perplexica : 34.5/40

Sur la base de ces critères, Perplexica semble avoir un léger avantage sur Farfalle en termes de robustesse, de support communautaire et d’intégration LLM. Cependant, les deux moteurs de recherche ont leurs forces, et le choix dépend en última instancia de vos besoins et préférences spécifiques.

Recommandation : Si vous cherchez un moteur de recherche IA fiable avec de solides capacités de NLP, Perplexica pourrait être le meilleur choix. Si vous préférez une approche de recherche plus directe et sans fioritures, Farfalle peut toujours fournir d’excellents résultats.

Réponse de comparaison de Farfalle

Comparaison de Farfalle et Perplexica

Farfalle et Perplexica sont deux moteurs de recherche alimentés par l’IA qui ont attiré l’attention ces derniers temps. Voici une comparaison de ces deux projets basée sur la robustesse, la communauté, le support et le support LLM (Grand Modèle de Langage).

Robustesse

- Farfalle est conçu pour être auto-hébergé avec des LLM locaux ou cloud, ce qui en fait une option plus robuste pour les utilisateurs souhaitant contrôler leur moteur de recherche.

- Perplexica, d’autre part, est une alternative open-source à Perplexity AI et est constamment amélioré par ses développeurs.

Communauté

- Perplexica dispose d’une communauté dédiée de développeurs et d’utilisateurs qui contribuent à son développement et fournissent un support.

- La communauté de Farfalle est plus petite, mais elle a quand même une présence sur GitHub.

Support

- Perplexica offre des mises à jour et des améliorations régulières, ainsi qu’un canal Discord pour discuter de sujets en dehors du support régulier.

- Le support de Farfalle est limité aux problèmes GitHub et aux demandes de fusion (pull requests).

Support LLM : Farfalle et Perplexica supportent tous deux les LLM. Perplexica utilise Ollama, un LLM local, tandis que Farfalle supporte à la fois les LLM locaux et cloud.

En résumé, Farfalle est plus robuste grâce à sa conception auto-hébergée, tandis que Perplexica a une communauté plus forte et un meilleur support. Les deux projets supportent les LLM, mais Perplexica utilise spécifiquement Ollama.

Conclusion

Quelle est la différence entre Perplexica et Farfalle ?

La réponse :

- En mettant de côté quelques erreurs factuelles, les deux systèmes pensent que Perplexica est meilleur que Farfalle, ce à quoi je serais d’accord.

- J’aime vraiment l’interface utilisateur de Farfalle, bien qu’elles soient assez proches.

- J’aime l’idée du mode expert de Farfalle, bien qu’il n’ait pas fonctionné dans mon environnement.

- J’ai rencontré 3 bugs lors de l’exécution de Farfalle. Le code de Perplexica est plus poli.

- Une fois configuré, Perplexica s’exécutait sans aucune erreur.

- Perplexica permet d’utiliser n’importe quel modèle hébergé par Ollama. Et Farfalle permet d’utiliser uniquement Gemma, Llama3, Mistral et Phi3 (versions prédéfinies, qui sont un peu obsolètes).

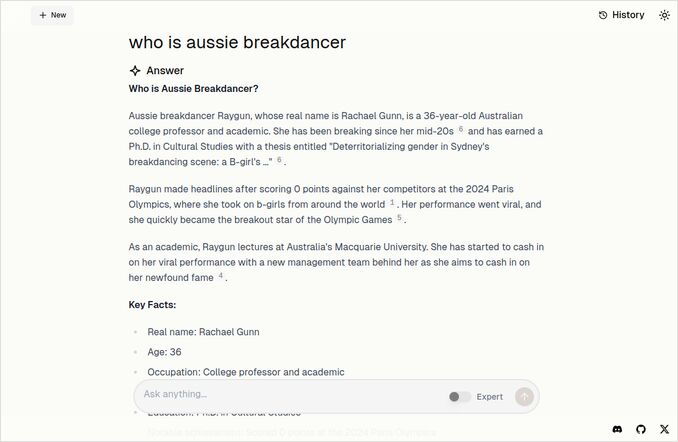

- J’aime les réponses de Farfalle davantage. Regardez l’image de Farfalle ci-dessous. Direct et sans ces “Selon le contexte fourni”…

Plus d’exemples

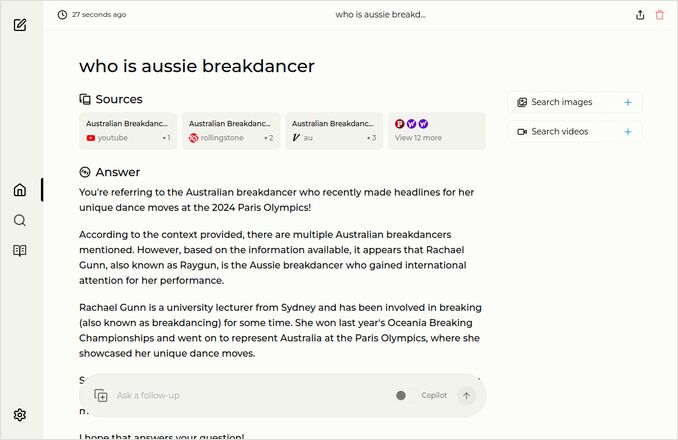

Ces exemples montrent les réponses à la même question sur le danseur de break australien. Vous savez, celui avec un doctorat qui a obtenu 0 (zéro) point et qui a probablement fait retirer le breakdance du programme olympique.

Réponse de Farfalle

Réponse de Perplexica

Si vous lisez ce dernier paragraphe (vers le haut ou vers le bas), merci d’avoir les mêmes intérêts que moi. C’est vraiment une époque excitante. Passez une excellente journée !

Liens utiles

- Recherche vs Deepsearch vs Deep Research

- Test : Comment Ollama utilise les performances CPU Intel et les cœurs Efficaces

- Comment Ollama gère les requêtes parallèles

- Auto-hébergement de Perplexica - avec Ollama

- Comparaison des capacités de résumés des LLM

- Écrire des prompts efficaces pour les LLM

- Test de la détection des sophismes logiques par de nouveaux LLM : gemma2, qwen2 et mistral Nemo

- Fiche de triche Ollama

- Fiche de triche Markdown

- Fournisseurs de LLM Cloud

- Modèles d’incorporation et de reranking Qwen3 sur Ollama : Performance de pointe