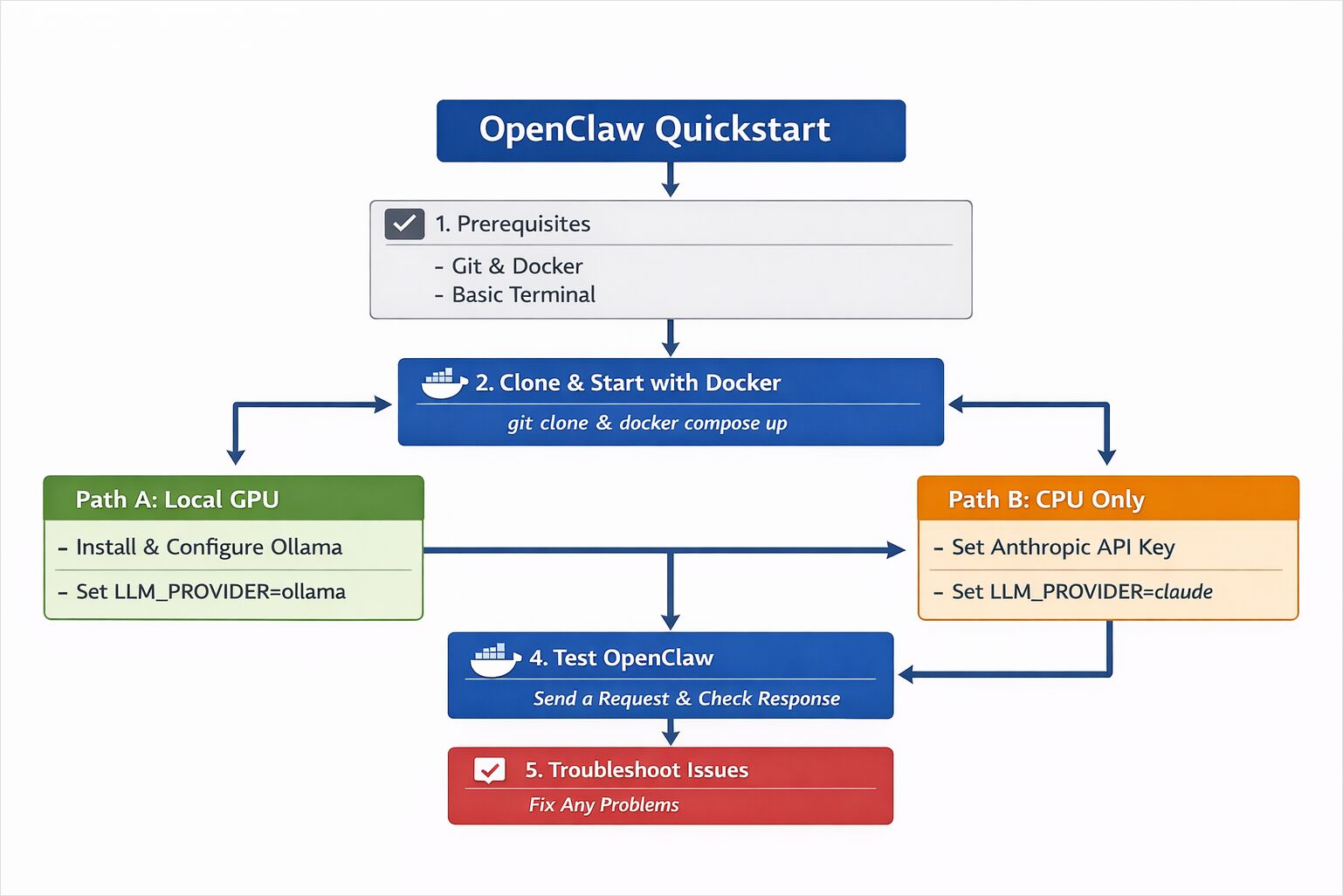

OpenClaw Quickstart : Installation avec Docker (Ollama GPU ou Claude + CPU)

Installer OpenClaw localement avec Ollama

OpenClaw est un assistant IA auto-hébergé conçu pour fonctionner avec des runtime LLM locaux comme Ollama ou avec des modèles cloud tels que Claude Sonnet.

Ce guide de démarrage rapide montre comment déployer OpenClaw avec Docker, configurer un modèle local alimenté par GPU ou un modèle cloud utilisant uniquement le CPU, et vérifier que votre assistant IA fonctionne de bout en bout.

Ce guide vous accompagne dans une configuration minimale d’OpenClaw pour que vous puissiez le voir fonctionner et répondre sur votre propre machine.

L’objectif est simple :

- Faire fonctionner OpenClaw.

- Envoyer une requête.

- Confirmer que tout fonctionne.

Ce n’est pas un guide de durcissement pour la production.

Ce n’est pas un guide de réglage des performances.

C’est un point de départ pratique.

Vous avez deux options :

- Option A — GPU local utilisant Ollama (recommandé si vous disposez d’un GPU)

- Option B — CPU uniquement utilisant Claude Sonnet 4.6 via l’API Anthropic

Les deux options partagent le même processus d’installation de base.

Si vous découvrez OpenClaw et souhaitez une vue d’ensemble plus approfondie de la structure du système, lisez la vue d’ensemble du système OpenClaw. Si vous prévoyez d’exécuter un assistant toujours actif avec une sandboxing plus stricte et des contrôles de politique, suivez le guide d’opérations sécurisées NemoClaw.

Configuration système et mise en place de l’environnement

OpenClaw est un système de type assistant qui peut se connecter à des services externes. Pour ce démarrage rapide :

- Utilisez des comptes de test whenever possible.

- Évitez de connecter des systèmes de production sensibles.

- Exécutez-le dans Docker (recommandé).

L’isolation est une bonne valeur par défaut lors de l’expérimentation avec des logiciels de type agent.

Prérequis OpenClaw (GPU avec Ollama ou CPU avec Claude)

Requis pour les deux options

- Git

- Docker Desktop (ou Docker + Docker Compose)

- Un terminal

Pour l’Option A (GPU local)

- Une machine avec un GPU compatible (NVIDIA ou AMD recommandé)

- Ollama installé

Pour l’Option B (CPU + Modèle cloud)

- Une clé API Anthropic

- Un accès à Claude Sonnet 4.6

Étape 1 — Installer OpenClaw avec Docker (Cloner & Démarrer)

OpenClaw peut être démarré à l’aide de Docker Compose. Cela garde la configuration contenue et reproductible.

Cloner le dépôt

git clone https://github.com/openclaw/openclaw.git

cd openclaw

Copier la configuration de l’environnement

cp .env.example .env

Ouvrez .env dans votre éditeur. Nous le configurerons à l’étape suivante en fonction de l’option de modèle que vous choisissez.

Démarrer les conteneurs

docker compose up -d

Si tout démarre correctement, vous devriez voir des conteneurs en cours d’exécution :

docker ps

À ce stade, OpenClaw est en cours d’exécution — mais il n’est pas encore connecté à un modèle.

Étape 2 — Configurer le fournisseur LLM (Ollama GPU ou Claude CPU)

Décidez maintenant comment vous souhaitez que l’inférence fonctionne.

Option A — GPU local avec Ollama

Si vous avez un GPU disponible, c’est l’option la plus simple et la plus autonome.

Installer ou vérifier Ollama

Si vous avez besoin d’un guide d’installation plus détaillé ou si vous souhaitez configurer les emplacements de stockage des modèles, consultez :

- Installer Ollama et configurer l’emplacement des modèles

- Fiche de référence CLI Ollama : ls, serve, run, ps + autres commandes (mise à jour 2026)

Si Ollama n’est pas installé :

curl -fsSL https://ollama.com/install.sh | sh

Vérifiez qu’il fonctionne :

ollama pull llama3

ollama run llama3

Si le modèle répond, l’inférence fonctionne.

Configurer OpenClaw pour utiliser Ollama

Dans votre fichier .env, configurez :

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

Redémarrez les conteneurs :

docker compose restart

OpenClaw routera désormais les requêtes vers votre instance locale Ollama.

Si vous hésitez sur le modèle à exécuter sur un GPU 16 Go ou si vous souhaitez des comparaisons de benchmarks, ou si vous avez besoin de valeurs par défaut de sampler Qwen / Gemma sensées pour les assistants lourds en outils, consultez :

Pour comprendre la concurrence et le comportement du CPU sous charge :

- Comment Ollama gère les requêtes parallèles

- Test : Comment Ollama utilise les cœurs Performance et Efficace du CPU Intel

Option B — CPU uniquement utilisant Claude Sonnet 4.6

Si vous ne disposez pas de GPU, vous pouvez utiliser un modèle hébergé.

Ajouter votre clé API

Dans votre fichier .env :

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=votre_cle_api_ici

ANTHROPIC_MODEL=claude-sonnet-4-6

Redémarrez :

docker compose restart

OpenClaw utilisera désormais Claude Sonnet 4.6 pour l’inférence tandis que l’orchestration s’exécute localement.

Cette configuration fonctionne bien sur les machines CPU uniquement car le calcul de modèle lourd se fait dans le cloud.

Si vous utilisez des modèles Anthropic ici, ce changement de politique d’abonnement Claude explique pourquoi OpenClaw nécessite une facturation basée sur l’API au lieu de réutiliser les plans Claude.

Étape 3 — Tester OpenClaw avec votre première invite

Une fois les conteneurs en cours d’exécution et le modèle configuré, vous pouvez tester l’assistant.

Selon votre configuration, cela peut se faire via :

- Une interface web

- Une intégration de messagerie

- Un point de terminaison API local

Pour un test API de base :

curl http://localhost:3000/health

Vous devriez voir une réponse de statut sain.

Envoyez maintenant une invite simple :

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Expliquez ce que fait OpenClaw en termes simples."}'

Si vous recevez une réponse structurée, le système fonctionne.

Ce que vous venez d’exécuter

À ce stade, vous avez :

- Une instance OpenClaw en cours d’exécution

- Un fournisseur LLM configuré (local ou cloud)

- Une boucle de requête-réponse fonctionnelle

Si vous avez choisi l’option GPU, l’inférence se fait localement via Ollama.

Si vous avez choisi l’option CPU, l’inférence se fait via Claude Sonnet 4.6, tandis que l’orchestration, le routage et la gestion de la mémoire s’exécutent à l’intérieur de vos conteneurs Docker locaux.

L’interaction visible peut sembler simple. En dessous, plusieurs composants coordonnent le traitement de votre requête.

Dépannage de l’installation et des problèmes d’exécution d’OpenClaw

Le modèle ne répond pas

- Vérifiez votre configuration

.env. - Vérifiez les journaux des conteneurs :

docker compose logs

Ollama inaccessible

- Confirmez que Ollama est en cours d’exécution :

ollama list

- Assurez-vous que l’URL de base correspond à votre environnement.

Clé API invalide

- Vérifiez

ANTHROPIC_API_KEY - Redémarrez les conteneurs après la mise à jour de

.env

Le GPU n’est pas utilisé

- Confirmez que les pilotes GPU sont installés.

- Assurez-vous que Docker a l’accès GPU activé.

Étapes suivantes après l’installation d’OpenClaw

Vous avez maintenant une instance OpenClaw fonctionnelle.

D’ici là, vous pouvez :

- Connecter des plateformes de messagerie

- Activer la récupération de documents

- Expérimenter avec les stratégies de routage

- Ajouter l’observabilité et les métriques

- Ajuster les performances et le comportement des coûts

Les discussions architecturales plus approfondies prennent plus de sens une fois que le système est en cours d’exécution.

Le rendre opérationnel est la première étape.

Une fois qu’il est en cours d’exécution, les articles suivants naturels sont :

- Guide des plugins OpenClaw — quels plugins installer pour la mémoire, les outils, les canaux et l’observabilité, et comment fonctionne le cycle de vie

- Guide des compétences OpenClaw — quelles compétences valent la peine d’être installées depuis ClawHub, et comment les limiter en toute sécurité selon le rôle de l’agent

- Modèles de configuration de production OpenClaw — comment les plugins et les compétences se combinent pour de vrais types d’utilisateurs tels que les développeurs, les équipes d’automatisation, les chercheurs et les opérateurs de support

Pour plus d’études de cas de systèmes IA, consultez la section Systèmes IA.