Créer un BFF GraphQL avec Apollo Server

Optimisez les API frontend avec GraphQL BFF et Apollo Server

Le Backend for Frontend (BFF) combiné à GraphQL et à Apollo Server crée une architecture puissante pour les applications web modernes.

Optimisez les API frontend avec GraphQL BFF et Apollo Server

Le Backend for Frontend (BFF) combiné à GraphQL et à Apollo Server crée une architecture puissante pour les applications web modernes.

Commandes Elasticsearch pour la recherche, l'indexation et l'analyse.

Elasticsearch est un puissant moteur de recherche et d’analyse distribué construit sur Apache Lucene. Ce mémo complet couvre les commandes essentielles, les meilleures pratiques et les références rapides pour travailler avec des clusters Elasticsearch.

Construisez des serveurs MCP pour des assistants IA avec des exemples en Python

Le protocole de contexte du modèle (MCP) révolutionne la manière dont les assistants IA interagissent avec des sources de données externes et des outils. Dans ce guide, nous explorerons comment construire des serveurs MCP en Python, avec des exemples axés sur les capacités de recherche web et de scraping.

Référence rapide des commandes Docker Model Runner

Docker Model Runner (DMR) est la solution officielle de Docker pour exécuter des modèles d’IA localement, introduite en avril 2025. Cette fiche pratique fournit un référentiel rapide pour toutes les commandes essentielles, les configurations et les bonnes pratiques.

Comparez Docker Model Runner et Ollama pour un LLM local

Exécuter des grands modèles de langage (LLMs) localement a de plus en plus de popularité pour la confidentialité, le contrôle des coûts et les capacités hors ligne. Le paysage s’est considérablement transformé en avril 2025 lorsque Docker a introduit Docker Model Runner (DMR), sa solution officielle pour le déploiement de modèles d’IA.

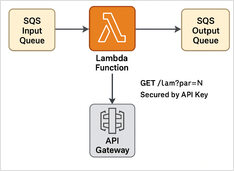

Exemple étape par étape

Voici un exemple de traitement de message SQS avec Python Lambda + API REST avec protection par clé API + Terraform script pour le déployer en exécution serverless.

+ Exemples concrets utilisant des LLMs de réflexion

Dans cet article, nous allons explorer deux façons de connecter votre application Python à Ollama : 1. Via HTTP REST API ; 2. Via la bibliothèque Python officielle d’Ollama.

Des API légèrement différentes nécessitent une approche particulière.

Voici une comparaison côte à côte du support de la sortie structurée (obtention de JSON fiable) chez les principaux fournisseurs de LLM, ainsi que des exemples Python minimaux.