AI

Performance des LLM en 2026 : Benchmarks, Goulots d'étranglement et Optimisation

Hébergement autonome des LLM et souveraineté en IA

Contrôlez les données et les modèles avec des LLM hébergés localement

L’hébergement local des LLM permet de garder les données, les modèles et l’inférence sous votre contrôle : une approche pratique pour atteindre la souveraineté en IA pour les équipes, les entreprises et les nations.

Comparaison des performances des LLM sur Ollama sur une GPU avec 16 Go de VRAM

Test de vitesse du LLM sur RTX 4080 avec 16 Go de VRAM

Exécuter des modèles de langage volumineux localement vous offre la confidentialité, la capacité hors ligne et un coût API nul. Ce benchmark révèle exactement ce à quoi on peut s’attendre à partir de 14 modèles populaires LLMs sur Ollama sur un RTX 4080.

Les 17 projets Python les plus populaires sur GitHub

Répos Python tendances de janvier 2026

L’écosystème Python ce mois-ci est dominé par Claude Skills et les outils d’agents IA. Cette analyse examine les dépôts Python les plus tendances sur GitHub.

Top 23 des projets Rust tendance sur GitHub - Janvier 2026

Dépôts Rust tendance de janvier 2026

L’écosystème Rust explose avec des projets innovants, en particulier dans les outils de codage en IA et les applications terminales. Ce panorama analyse les dépôts Rust les plus tendance sur GitHub ce mois-ci.

Top 19 des projets Go tendance sur GitHub - Janvier 2026

Dépôts Go tendance de janvier 2026

L’écosystème Go continue de prospérer avec des projets innovants couvrant l’outillage IA, les applications auto-hébergées et l’infrastructure développeur. Ce panorama analyse les dépôts Go les plus tendance sur GitHub ce mois-ci.

Guide Anaconda vs Miniconda vs Mamba

Choisissez le bon gestionnaire de paquets Python

Ce guide complet fournit des informations de base et une comparaison détaillée d’Anaconda, Miniconda et Mamba (https://www.glukhov.org/fr/developer-tools/local-dev-platforms/anaconda-vs-miniconda-vs-mamba/ “Comparaison d’Anaconda, Miniconda et Mamba”) - trois outils puissants qui sont devenus essentiels pour les développeurs Python et les scientifiques des données travaillant avec des dépendances complexes et des environnements de calcul scientifique.

Open WebUI : interface auto-hébergée pour LLM

Alternative auto-hébergée de ChatGPT pour les LLM locaux

Open WebUI est une application web puissante, extensible et riche en fonctionnalités pour interagir avec les grands modèles de langage, hébergée localement.

Événements Tech à Melbourne à Ne Pas Manquer en 2026

Le calendrier technologique essentiel de Melbourne pour 2026

La communauté technologique de Melbourne continue de prospérer en 2026 avec une impressionnante programmation de conférences, rencontres et ateliers couvrant le développement logiciel, l’informatique en nuage, l’IA, la cybersécurité et les technologies émergentes.

vLLM : Démarrage rapide pour le déploiement de LLM hautes performances - en 2026

Inférence rapide de LLM avec l'API OpenAI

vLLM est un moteur d’inférence et de déploiement à haut débit et économe en mémoire pour les grands modèles de langage (LLM), développé par le Sky Computing Lab de l’Université de Californie à Berkeley.

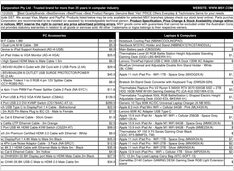

Tarifs DGX Spark AU : 6 249 $ à 7 999 $ chez les principaux détaillants

Prix AUD réels provenant de détaillants australiens dès maintenant.

Le NVIDIA DGX Spark (GB10 Grace Blackwell) est désormais disponible en Australie chez les principaux détaillants d’ordinateurs avec un stock local. Si vous suivez les prix et la disponibilité mondiaux du DGX Spark, vous serez intéressé de savoir que les prix en Australie varient de 6 249 $ à 7 999 $ AUD selon la configuration de stockage et le détaillant.

Détecter le contenu AI de mauvaise qualité : Techniques et signaux d'alerte

Guide technique pour la détection de contenu généré par IA

La prolifération du contenu généré par l’IA a créé un nouveau défi : distinguer les écrits humains authentiques du « brouillon d’IA » - du texte synthétique de faible qualité, produit en masse.

Auto-hébergement de Cognee : choisir un LLM sur Ollama

Test de Cognee avec des LLM locaux - résultats réels

Cognee est un framework Python permettant de construire des graphes de connaissances à partir de documents en utilisant des LLM. Mais fonctionne-t-il avec des modèles auto-hébergés ?

BAML vs Instructor : Sorties structurées des LLM

Sorties de LLM type-sûres avec BAML et Instructor

Lors de l’utilisation de grands modèles de langage en production, obtenir des sorties structurées et de type sûr est essentiel. Deux frameworks populaires - BAML et Instructor - adoptent des approches différentes pour résoudre ce problème.

Choisir le bon LLM pour Cognee : configuration locale d'Ollama

Réflexions sur les LLM pour Cognee auto-hébergé

Choisir le meilleur LLM pour Cognee exige de trouver un équilibre entre la qualité de construction des graphes, les taux de hallucination et les contraintes matérielles. Cognee excelle avec des modèles plus grands et peu hallucinants (32B+) via Ollama mais des options de taille moyenne conviennent pour des configurations plus légères.