Farfalle versus Perplexica

Twee zelfgehoste AI-zoekmachines vergeleken

Geweldige eten is ook een plezier voor de ogen. Maar in dit bericht vergelijken we twee op AI gebaseerde zoeksystemen: Farfalle en Perplexica.

Overigens heet deze vorm van pasta ook wel “farfalle”.

Hier vergelijken we echter alleen hoe deze twee systemen zich gedragen. Niet de pastavormen.

Oké, concentreer je!

Zie ook Installatie en configuratie van Perplexica - met Ollama en Ollama installeren en configureren.

De antwoordenmotor die in dit artikel Perplexica wordt genoemd, komt upstream nu als Vane; Vane (Perplexica 2.0) Snelstart met Ollama en llama.cpp is de plek om te kijken voor huidige Docker-images, SearxNG-koppeling en de timeline van de naamswijziging.

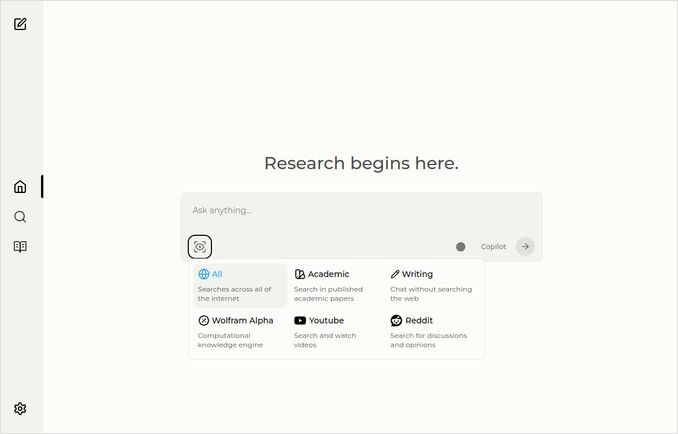

Perplexica

Hier is de startpagina met de vervolgkeuzelijst voor bronselectie.

- Perplexica is geïmplementeerd in

- TypeScript en React.Js (UI)

- TypeScript en Express.Js (Backend)

- bevat ook configuratie voor de SearxNG-metazoekmachine

- Heeft een Copilot-modus

- Heeft de mogelijkheid om elk Ollama-gehoste LLM te gebruiken als chat- of embedding-model

- Heeft drie kleine interne embedding-modellen

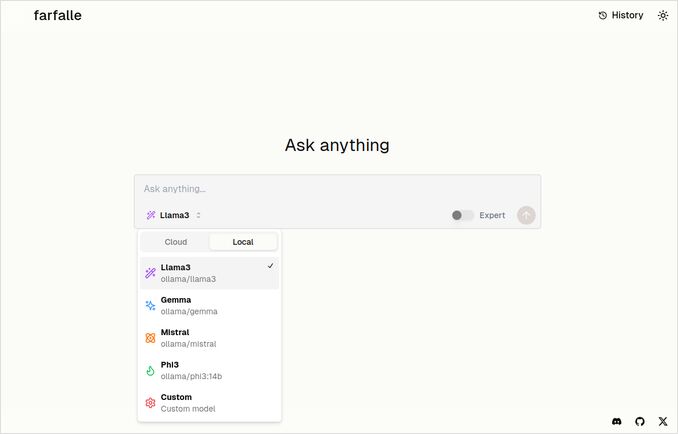

Farfalle

- Farfalle is geïmplementeerd in

- TypeScript en React.Js (UI)

- Python Fastapi (Backend)

- bevat ook referenties voor de SearxNG-metazoekmachine. Er is niet veel configuratie voor nodig, het is vrij standaard Docker-image.

- Heeft een Expert-modus die diverse aanvragen op basis van de originele vraag zou moeten voorbereiden en de antwoorden combineren. Maar dit werkte niet in onze test.

- Heeft de mogelijkheid om vier Ollama-gehoste LLM’s te gebruiken als chatmodel (llama3, mistral, gemma, phi3). Dat is een goede set opties, maar ik zou het liever zien als flexibeler, zodat elk model dat Ollama biedt gebruikt kan worden.

- Geen opties voor embedding-model

Vergelijking door Perplexica en Farfalle zelf

Ik heb dezelfde vraag gesteld: Vergelijk farfalle en perplexica op basis van robuustheid, community, ondersteuning en ondersteunde LLM’s.

Zowel Perplexica als Farfalle gebruikten het llama3-model dat lokaal op Ollama gehost werd. De volledige naam van het model is llama3 8b q4.

Geloof niet 100% wat de antwoorden zeggen, bekijk gewoon de tekstlengte, structuur en de algehele kwaliteit van het antwoord.

Ik zou ongeveer 70% geloven…

Perplexica’s vergelijkingsantwoord

Vergelijking van Farfalle en Perplexica

Robuustheid

Farfalle: 8/10 - Farfalle is een populaire AI-zoekmachine die bekend staat om zijn betrouwbaarheid en het vermogen om complexe queries te hanteren. Het heeft een sterke basis in natuurlijke taalverwerking (NLP) en machine learning (ML). Hoewel het misschien niet perfect is, is de robuustheid van Farfalle goed gevestigd.

Perplexica: 9/10 - Perplexica is gebouwd op het Phi-3-model van Meta AI, dat ontworpen is voor robuustheid. Het is getest om nauwkeurige antwoorden te geven, zelfs bij dubbelzinnige of onduidelijke queries. Het vermogen om vragen om te formuleren en zich aan te passen aan verschillende contexten maakt het een robuuste zoekmachine.

Community

Farfalle: 7/10 - Farfalle heeft een toegewijde community van gebruikers die zijn mogelijkheden waarderen. Hoewel het misschien niet dezelfde mate van adoptie heeft als Perplexica, is de gebruikersbasis van Farfalle nog steeds aanzienlijk.

Perplexica: 8.5/10 - Perplexica heeft brede erkenning genoten voor zijn innovatieve aanpak van zoekmachines. De community groeit snel, met veel gebruikers die het vermogen waarderen om nauwkeurige en relevante resultaten te bieden.

Ondersteuning

Farfalle: 6.5/10 - Farfalle biedt basisondersteuning via FAQs, documentatie en forums. Hoewel het niet zo uitgebreid is als de ondersteuning van Perplexica, is de gebruikersbasis van Farfalle over het algemeen zelfstandig.

Perplexica: 9/10 - Perplexica biedt uitgebreide ondersteuningsbronnen, inclusief gedetailleerde documentatie, FAQs en community-forums. De ontwikkelaars zijn actief betrokken bij de community, zodat gebruikers tijdige en effectieve assistentie ontvangen.

Ondersteunde LLM’s

Farfalle: Nee - Farfalle is een standalone AI-zoekmachine die niet afhankelijk is van grote taalmodellen (LLM’s) voor zijn mogelijkheden.

Perplexica: Ja - Perplexica is gebouwd op het Phi-3-model van Meta AI, wat een LLM is. Dit stelt Perplexica in staat om de kracht van diep leren te benutten voor nauwkeuriger en relevanter resultaten.

Totale score Farfalle: 22/30 Perplexica: 34.5/40

Op basis van deze criteria lijkt Perplexica een lichte voorsprong te hebben ten opzichte van Farfalle qua robuustheid, community-ondersteuning en LLM-integratie. Echter, beide zoekmachines hebben hun sterke punten en de keuze hangt uiteindelijk af van uw specifieke behoeften en voorkeuren.

Aanbeveling: Als u op zoek bent naar een betrouwbare AI-zoekmachine met sterke NLP-mogelijkheden, is Perplexica misschien de betere keuze. Als u een meer rechttoe-rechtaan, eenvoudige aanpak van zoeken preferent, kan Farfalle nog steeds uitstekende resultaten bieden.

Farfalle’s vergelijkingsantwoord

Vergelijking van Farfalle en Perplexica

Farfalle en Perplexica zijn twee door AI aangedreven zoekmachines die de laatste tijd aandacht hebben getrokken. Hier is een vergelijking van deze twee projecten op basis van robuustheid, community, ondersteuning en LLM (Large Language Model) ondersteuning.

Robuustheid

- Farfalle is ontworpen om zelf gehost te worden met lokale of cloud-LLM’s, waardoor het een robuuster optie is voor gebruikers die controle willen over hun zoekmachine.

- Perplexica is daarentegen een open-source alternatief voor Perplexity AI en wordt voortdurend verbeterd door de ontwikkelaars.

Community

- Perplexica heeft een toegewijde community van ontwikkelaars en gebruikers die bijdragen aan de ontwikkeling en ondersteuning bieden.

- De community van Farfalle is kleiner, maar heeft nog steeds een aanwezigheid op GitHub.

Ondersteuning

- Perplexica biedt regelmatige updates en verbeteringen, evenals een Discord-kanaal om zaken te bespreken buiten de reguliere ondersteuning om.

- De ondersteuning van Farfalle is beperkt tot GitHub-bugs en pull requests.

LLM-ondersteuning: Zowel Farfalle als Perplexica ondersteunen LLM’s. Perplexica gebruikt Ollama, een lokale LLM, terwijl Farfalle zowel lokale als cloud-LLM’s ondersteunt.

Samenvattend is Farfalle robuuster door zijn ontwerp voor self-hosting, terwijl Perplexica een sterkere community en betere ondersteuning heeft. Beide projecten ondersteunen LLM’s, maar Perplexica gebruikt specifiek Ollama.

Conclusie

Wat is het verschil tussen Perplexica en Farfalle?

Het antwoord:

- Behoudens enkele feitelijke fouten, denken beide systemen dat Perplexica beter is dan Farfalle, waar ik het mee eens ben.

- Ik vind de Farfalle-UI echt leuk, hoewel ze best dicht bij elkaar liggen.

- Ik vind het idee van de expert-modus van Farfalle leuk, hoewel het niet werkte in mijn omgeving.

- Ik kwam 3 bugs tegen bij het draaien van Farfalle. Perplexica-code is meer gepolijst.

- Eenmaal geconfigureerd, liep Perplexica zonder enige fouten.

- Perplexica stelt je in staat om elk Ollama-gehost model te gebruiken. Farfalle stelt je alleen in staat om Gemma, Llama3, Mistral en Phi3 te gebruiken (voorgedefinieerde versies, die een beetje verouderd zijn).

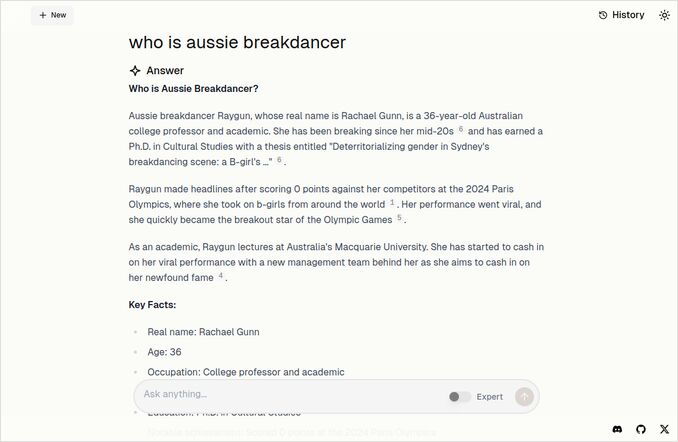

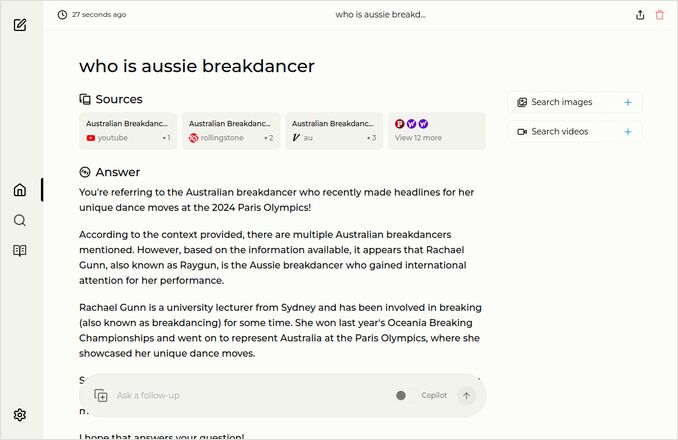

- Ik vind de antwoorden van Farfalle leuker. Kijk naar de Farfalle-afbeelding hieronder. Rechtstreeks naar de kern, zonder die zinnen als “Volgens de verstrekte context”…

Meer voorbeelden

Deze tonen antwoorden op dezelfde vraag over een Australische breakdancer. Je weet wel, degene met een PhD die 0 (nul) punten kreeg en waarschijnlijk de breakdancing uit het olympische programma liet verwijderen.

Farfalle-antwoord

Perplexica-antwoord

Als je hierboven (of hieronder) leest, bedankt voor het delen van dezelfde interesses als ik. Het zijn echt spannende tijden. Heb een geweldige dag!

Nuttige links

- Zoeken vs Diepzoeken vs Diep Onderzoek

- Test: Hoe Ollama Intel CPU-prestaties en efficiënte kernen gebruikt

- Hoe Ollama parallelle aanvragen behandelt

- Perplexica zelf hosten - met Ollama

- Vergelijking van LLM-samenvattingsmogelijkheden

- Effectieve prompts schrijven voor LLM’s

- Testen van logische valkuilen detectie door nieuwe LLM’s: gemma2, qwen2 en mistral Nemo

- Ollama-cheatblad

- Markdown Cheatblad

- Cloud LLM-aanbieders

- Qwen3 Embedding & Reranker-modellen op Ollama: State-of-the-Art prestaties