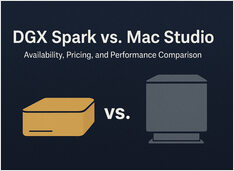

Benchmarks de LLM com 16 GB de VRAM usando llama.cpp (velocidade e contexto)

Velocidade de tokens do llama.cpp com 16 GB de VRAM (tabelas).

Aqui estou comparando a velocidade de vários LLMs executados em uma GPU com 16 GB de VRAM, escolhendo o melhor para auto-hospedagem.