Self-Hosting Cognee: Kiezen voor LLM op Ollama

Cognee testen met lokale LLMs - reële resultaten

Cognee is een Python-framework voor het bouwen van kennisgrafieken uit documenten met behulp van LLMs. Werkt het echter met zelfgehoste modellen?

Cognee testen met lokale LLMs - reële resultaten

Cognee is een Python-framework voor het bouwen van kennisgrafieken uit documenten met behulp van LLMs. Werkt het echter met zelfgehoste modellen?

Typeveilig LLM-uitvoer met BAML en Instructor

Bij het werken met grote taalmodellen in productie is het verkrijgen van gestructureerde, typeveilige uitvoer van kritiek belang. Twee populaire frameworks - BAML en Instructor - nemen verschillende benaderingen om dit probleem op te lossen.

Overdenkingen over LLMs voor self-hosted Cognee

Kiezen voor de Beste LLM voor Cognee vereist het balanceren van de kwaliteit van het bouwen van grafieken, hallucinatiepercentages en hardwarebeperkingen. Cognee excelleert met grotere modellen met lage hallucinatiepercentages (32B+) via Ollama, maar middelgrote opties werken voor lichtere opstellingen.

Essentiële snelkoppelingen en magische opdrachten

Start de Jupyter Notebook productiviteit op met essentiële sneltoetsen, magische commando’s en workflow-tips die uw data science- en ontwikkelingservaring kunnen transformeren.

Maak AI-zoekagents aan met Python en Ollama

De Ollama Python-bibliotheek bevat nu native OLlama web zoekfunctie mogelijkheden. Met slechts een paar regels code kunt u uw lokale LLMs verrijken met real-time informatie van het web, waardoor hallucinaties worden verminderd en de nauwkeurigheid wordt verbeterd.

Kies de juiste vector database voor uw RAG-stack

Het kiezen van de juiste vectorstore kan prestaties, kosten en schaalbaarheid van uw RAG-toepassing bepalen. Deze uitgebreide vergelijking dekt de meest populaire opties in 2024-2025.

Maak AI zoekagents met Go en Ollama

Ollama’s Web Search API laat je lokale LLMs verrijken met real-time webinformatie. Deze gids laat je zien hoe je web zoekfunctionaliteiten in Go kunt implementeren, van eenvoudige API-aanroepen tot volledig uitgeruste zoekagenten.

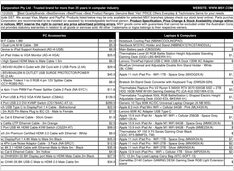

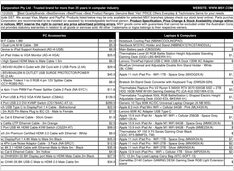

RAM-prijzen stijgen met 163-619% door de vraag naar AI die de aanvoer onder druk zet.

De geheugenmarkt ervaart eind 2025 ongekende prijsschommelingen, waarbij RAM-prijzen dramatisch stijgen in alle segmenten.

Vergelijk de beste lokale LLM-hosting-tools in 2026. API-rijpheid, hardware-ondersteuning, tool-aanroepen en reële toepassingen.

Het lokaal uitvoeren van LLMs is nu praktisch voor ontwikkelaars, startups en zelfs enterprise teams.

Maar het kiezen van het juiste hulpmiddel — Ollama, vLLM, LM Studio, LocalAI of anderen — hangt af van je doelen:

Maak robuuste AI/ML-pijplijnen met Go-microservices

Aan de slag met AI- en ML-werkbelastingen die steeds complexer worden, is het belangrijk dat er robuuste orkestratiesystemen zijn. De eenvoud, prestaties en gelijktijdigheid van Go maken het ideaal om de orkestratielag van ML-pijplijnen te bouwen, zelfs als de modellen zelf in Python zijn geschreven.

Vereenig tekst, afbeeldingen en audio in gedeelde embedding-ruimtes

Cross-modale ingebedden stellen een doorbraak voor in de kunstmatige intelligentie, waardoor begrip en redeneren mogelijk worden over verschillende gegefstypen binnen een gedeelde representatie-ruimte.

Implementeer enterprise AI op budgethardware met open modellen

De democratisering van AI is een feit. Met open-source LLM’s zoals Llama, Mistral en Qwen die nu eigen modellen rivaliseren, kunnen teams krachtige AI-infrastructuur op consumentenhardware bouwen – kosten drastisch verlagen terwijl volledige controle over gegevensprivacy en implementatie behouden blijft.

LongRAG, Self-RAG, GraphRAG – technieken van de volgende generatie

Generatie met Retrieval-Augmented Generation (RAG) is veel verder gevorderd dan eenvoudige vectorgelijkheidszoekopdrachten. LongRAG, Self-RAG en GraphRAG vertegenwoordigen de vooruitstekende mogelijkheden op dit gebied.

Versnel FLUX.1-dev met GGUF-quantisatie

FLUX.1-dev is een krachtig tekst-naar-afbeelding model dat indrukwekkende resultaten produceert, maar zijn geheugengebruik van 24GB+ maakt het lastig om te draaien op veel systemen. GGUF-quantisatie van FLUX.1-dev biedt een oplossing, met een verminderings van het geheugengebruik met ongeveer 50% terwijl de afbeeldingskwaliteit goed behouden blijft.

Stel contextgroottes in in Docker Model Runner met omzeilingen

Het instellen van contextgrootte in Docker Model Runner is complexer dan het zou moeten zijn.

AI-model voor het aanvullen van afbeeldingen met tekstinstructies

Black Forest Labs heeft FLUX.1-Kontext-dev, een geavanceerd beeld-naar-beeld AI-model dat bestaande beelden verrijkt met behulp van tekstinstructies, vrijgegeven.