Airtable pour les développeurs et les DevOps - Plans, API, Webhooks et exemples en Go/Python

Airtable - Limites du plan gratuit, API, webhooks, Go et Python.

Airtable est mieux pensé comme une plateforme d’application à faible code construite autour d’une interface collaborative “ressemblant à une feuille de calcul” - idéale pour créer rapidement des outils opérationnels (suivi interne, CRM léger, pipelines de contenu, files d’attente d’évaluation d’IA) où les non-développeurs ont besoin d’une interface amicale, mais les développeurs ont aussi besoin d’une surface API pour l’automatisation et l’intégration.

Les propres matériaux d’Airtable décrivent l’API Web comme RESTful, utilisant JSON, et les codes d’état HTTP standards.

Les deux contraintes qui façonnent le plus fortement les décisions d’ingénierie sont :

Les plafonds durs du plan Gratuit : 1 000 enregistrements par base, 1 000 appels API par espace de travail par mois, 1 Go de stockage d’attachements par base, et uniquement deux semaines d’historique de révision/snapshot.

Ces chiffres sont suffisamment bas pour que vous considériez “Airtable Gratuit” comme un prototype, démonstration, projet amateur ou très petit flux interne, et non comme un magasin de données continuement interrogé par des services.

Les limites de taux d’API Web publiques : Airtable impose 5 requêtes/seconde par base et aussi 50 requêtes/seconde pour tout le trafic utilisant des tokens d’accès personnels d’un utilisateur ou d’un compte de service. Si vous dépassez ces limites, vous recevrez HTTP 429 et (selon les recommandations d’Airtable) devez attendre environ 30 secondes avant de réessayer.

La conséquence est architecturale : batchez autant que possible, cachez les lectures, préférez les webhooks au sondage pour la détection des changements, et intégrez un mécanisme de réessai/retard dans chaque client.

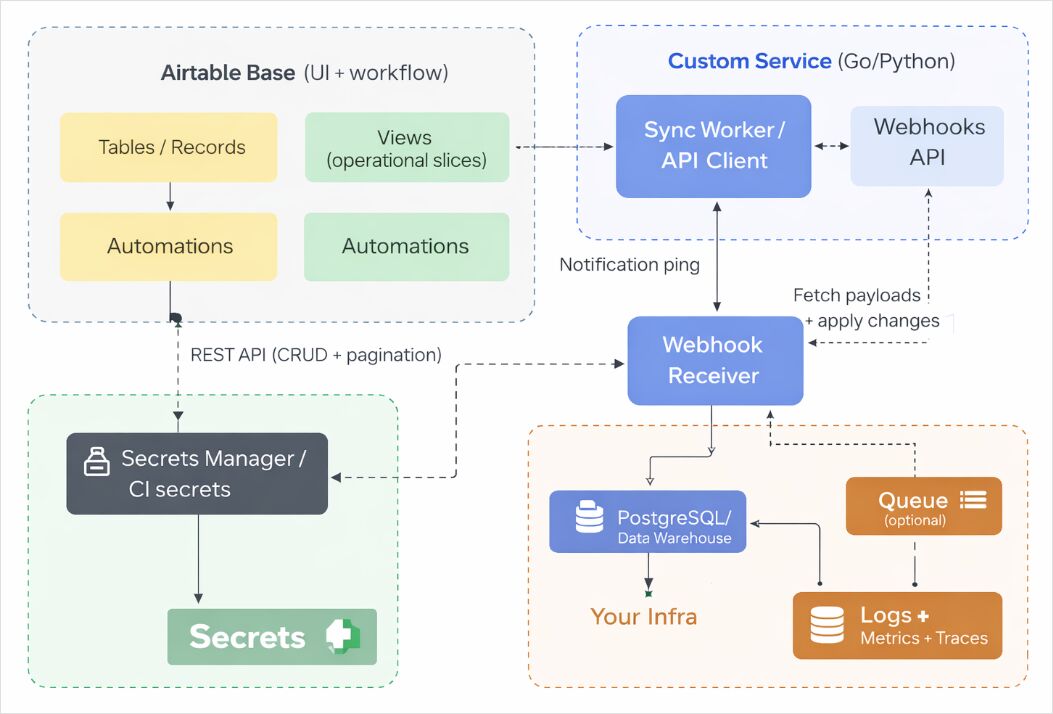

Si vous souhaitez utiliser Airtable dans un système personnalisé, un motif “DevOps + backend” efficace en production est :

Airtable comme interface opérationnelle + source de vérité légère pour un ensemble de données borné (règles de routage, files d’attente de revue humaine, plans éditoriaux, étapes d’onboarding client).

Un système séparé (PostgreSQL/entrepôt/stockage d’objets) comme le magasin principal durable pour l’échelle, l’audit, les sauvegardes, l’analytique et les lectures/écritures à QPS plus élevés.

Une couche de synchronisation qui tire des pages d’enregistrements (pagination par décalage), pousse les changements par lots, et utilise éventuellement les webhooks d’Airtable pour réduire le sondage.

Pour le tableau plus large - stockage d’objets, PostgreSQL, Elasticsearch et couches de données natives pour l’IA - voir l’article Infrastructure de données pour les systèmes d’IA.

Qu’est-ce qu’Airtable et pourquoi les développeurs l’utilisent comme base à faible code

L’abstraction centrale d’Airtable est la base : un conteneur pour des tables et artefacts de workflow liés (vues, interfaces, automatisations). En pratique, une base map souvent à une limite de domaine métier - Opérations de contenu, Post-mortems d’incident, Évaluations LLM, Demandes client.

À l’intérieur d’une base, vous modélisez les données comme :

Tables : analogues aux entités/collections.

Enregistrements : lignes.

Champs : colonnes avec des types riches (sélections, attaches, liens, formules, etc.).

Vous créez ensuite plusieurs “lentilles” sur la même table à l’aide des vues - représentations filtrées/triées/groupées optimisées pour des tâches spécifiques. La documentation d’Airtable souligne que les vues vous aident à “voir les enregistrements les plus pertinents pour vous” et peuvent être personnalisées pour différents consommateurs.

Les développeurs s’orientent vers Airtable lorsqu’ils ont besoin de :

Une interface utilisateur conviviale pour les utilisateurs métier pour créer/mettre à jour rapidement des données opérationnelles (sans attendre une application admin personnalisée).

Une surface arrière-plan programmable via l’API Web d’Airtable pour l’ingestion, la synchronisation et l’automatisation. L’API utilise des sémantiques REST et JSON, ce qui rend l’intégration directe depuis les services Go/Python.

Gluer des SaaS/workflows via des intégrations et automatisations, où certaines étapes peuvent être implémentées entièrement dans Airtable et d’autres gérées en code. Les automatisations d’Airtable sont décrites comme des workflows déclencheur-action (ex. : “lors de la création d’un enregistrement → envoyer un message / mettre à jour un enregistrement / exécuter un script”).

Airtable est particulièrement productif pour les équipes DevOps + IA lorsqu’il est utilisé comme :

Un tableau de configuration contrôlé par les changements : ex. : métadonnées des drapeaux de fonctionnalité, propriété des services, chemins d’escalade, approbations de déploiement.

Une file d’attente de revue humaine : ex. : sorties LLM en attente de validation, triage de sécurité, tâches d’itération de prompt.

Un index de métadonnées pour les actifs qui résident ailleurs : URI S3, SHAs de commit Git, IDs de jeux de données - minimisant la pression de stockage d’attachements sur Airtable lui-même (important sur le plan Gratuit).

Fonctionnalités centrales d’Airtable : bases, tables, champs, vues, interfaces, extensions, automatisations et intégrations

Le “pouvoir” d’Airtable n’est pas seulement les tables ; c’est la surface de workflow entourant qui fait d’une base un plateau d’applications léger.

Bases et tables pour la collaboration structurée

Une base est le lieu où les équipes co-possèdent des données structurées et le processus d’état. L’implication pratique en ingénierie est la gouvernance de schéma : si les utilisateurs métier peuvent renommer des champs ou des tables, vos clients API peuvent se briser à moins que vous ne conceviez pour les changements.

Deux tactiques réduisent les cassures :

Utiliser des IDs stables en code autant que possible. Airtable note explicitement pour les mises à jour d’enregistrements que les noms de table et les IDs de table peuvent être utilisés interchangeablent, et recommande les IDs de table afin que vous n’ayez pas à modifier les requêtes lorsque les noms changent.

Documenter les “champs couplés à l’API” dans les descriptions des champs et traiter les changements comme des événements contrôlés (revue de PR / demande de changement).

Vues et “lentilles” de workflow

Les vues vous permettent de filtrer/trier/grouper des enregistrements pour des processus spécifiques (vue de triage, “à réviser”, “prêt à déployer”). Airtable met en avant les vues comme le mécanisme pour afficher uniquement les sous-ensembles “les plus pertinents” d’enregistrements pour différents utilisateurs.

Du point de vue de l’intégration, vous pouvez concevoir une vue comme un contrat stable : votre travail de synchronisation lit uniquement les enregistrements de la vue “Export”, par exemple, au lieu d’essayer de reproduire toute la logique de filtrage en code. (L’API prend également en charge la sélection d’enregistrements par vue et via des filtres de formule ; voir la section API ci-dessous.)

Extensions, marché d’applications et “apportez vos propres outils”

Airtable prend en charge les “Extensions” (anciennement appelés “Blocks”), qui ajoutent des fonctionnalités à l’intérieur de la base (graphiques, scripts, importations, etc.). La vue d’Airtable sur les Extensions les décrit comme des compléments construits par Airtable et des tiers.

Critiquement, les Extensions ne sont pas prises en charge sur le plan Gratuit, donc tout workflow dépendant d’elles commence à partir du plan Team ou supérieur.

Automatisations : déclencheurs, actions et scriptage pour le collage d’intégration

Les automatisations sont des workflows déclencheur-action : Airtable liste les déclencheurs incluant “lors de la création/mise à jour d’un enregistrement”, “lorsqu’un enregistrement entre dans une vue”, des déclencheurs de temps planifiés, et “lors de la réception d’un webhook”, entre autres.

Les actions incluent la création/mise à jour d’enregistrements, l’envoi de messages, et (important pour les développeurs) l’exécution de code : l’action “Exécuter un script” exécute les scripts “en arrière-plan de la base” et est positionnée comme le choix approprié pour les scripts que vous souhaitez exécuter automatiquement.

Cependant, “Exécuter un script” est explicitement marqué comme inaccessible sur le plan Gratuit, ce qui a de l’importance si votre hypothèse d’architecture est “utiliser les automatisations d’Airtable pour appeler nos propres API internes”.

API Web et intégrations comme interface d’ingénierie

L’API Web d’Airtable permet aux systèmes externes de lire/écrire des enregistrements via des appels HTTP standards. La documentation d’Airtable donne des modèles d’URL concrets tels que :

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5 (exemple de filtrage par formule).

Airtable fournit également une couche de métadonnées (utile pour les schémas “configuration comme code” en DevOps), incluant la liste des bases via GET https://api.airtable.com/v0/meta/bases et la création d’une base via POST https://api.airtable.com/v0/meta/bases (nécessite des portées de schéma).

En termes d’authentification, Airtable s’est éloigné des anciens clés API : son calendrier officiel de dépériscence inclut la dépériscence des clés API effective le 1er février 2024.

Plans de tarification d’Airtable et limites du plan Gratuit pour les développeurs

Les noms de plans et les droits d’Airtable changent au fil du temps, mais la documentation actuelle des plans d’Airtable fournit des quotas et des contraintes explicites et pertinentes pour l’ingénierie.

Tableau des plans d’Airtable : limites clés qui impactent les intégrations API

| Plan (auto-servi sauf indication) | Enregistrements par base | Appels API par espace de travail / mois | Stockage d’attachements par base | Historique de révision/snapshot | Contraintes/notes notables |

|---|---|---|---|---|---|

| Gratuit | 1 000 | 1 000 | 1 Go | 2 semaines | Aucune extension ; limites supplémentaires de l’interface ; limites de collaborateurs ; inclut des crédits d’IA par éditeur+ |

| Team | 50 000 | 100 000 | 20 Go | 1 an | Inclut les automatisations, les extensions, les formulaires, le concepteur d’interfaces, le calendrier/Gantt, les vues verrouillées/privées, et plus |

| Business | 125 000 | Illimité | 100 Go | 1 an | Inclut la synchronisation bidirectionnelle et le panneau d’administration (et nécessite des domaines d’e-mails privés) |

| Échelle Enterprise (dirigée par les ventes) | (varie) | (varie) | (varie) | (varie) | Vendu/géré par les ventes ; Business/Enterprise nécessitent des domaines d’e-mails privés |

Le prix des plans Team et Business d’Airtable est indiqué par collaborateur (mensuel vs annuel).

Analyse approfondie du plan Gratuit : limites et implications pratiques pour les systèmes DevOps et backend

Sur le plan Gratuit, vous obtenez :

1 000 enregistrements par base.

C’est la première “fonctionnalité d’architecture forçante” : une fois que vous dépassez environ 1 000 enregistrements pour un domaine, vous devez soit fractionner en plusieurs bases (ce qui complique les intégrations), soit archiver activement, soit déplacer le dataset principal ailleurs (Postgres/entrepôt) et garder uniquement des “slices opérationnels actifs” dans Airtable.

1 000 appels API par espace de travail par mois.

C’est suffisamment bas pour que des stratégies de synchronisation naïves (sondage toutes les minutes) épuisent rapidement la cote. Le guide des limites d’appel API d’Airtable décrit explicitement l’API comme RESTful et souligne que les opérations de lecture d’enregistreements retournent des pages de jusqu’à 100 ; si vous sondez répétitivement, vous pouvez épuiser rapidement les appels mensuels.

Une intégration sur plan Gratuit devrait donc par défaut utiliser :

des mises à jour événementielles via des webhooks (quand c’est possible),

ou des synchronisations manuelles/par utilisateur,

ou un travail de batch à faible fréquence (quotidien),

et un cache pour éviter les lectures répétées. Airtable recommande explicitement les approches de mise en cache/proxy comme stratégie pour gérer les limites de taux.

1 Go de stockage d’attachements par base.

Pour les workflows d’IA/LLM, c’est un piège si vous stockez des PDF, images ou jeux de données comme des attachements. Préférez stocker les attachements dans un stockage d’objets et garder uniquement les URLs et métadonnées dans Airtable.

2 semaines d’historique de révision/snapshot.

Du point de vue du risque DevOps, une histoire limitée réduit votre capacité à récupérer après des changements accidentels en masse. Si Airtable est critique opérationnellement, vous devriez implémenter des sauvegardes/snapshots externes (tâches d’export API) plutôt que de vous reposer uniquement sur l’historique de révision.

Le plan Gratuit a également des limites de collaboration et des suppressions de fonctionnalités qui affectent la livraison :

Collaborateurs en lecture seule illimités, mais uniquement 5 collaborateurs avec les permissions Éditeur/Créateur et 50 Commentateurs.

Aucune extension sur le plan Gratuit.

Certaines capacités d’automatisation sont restreintes : l’action “Exécuter un script” est marquée comme non disponible sur le plan Gratuit.

Alternatives et concurrents d’Airtable : Notion vs Google Sheets vs Coda vs ClickUp vs PostgreSQL + UI

Airtable n’est pas la réponse par défaut pour chaque cas d’utilisation “tables + workflow”. Le bon choix dépend de savoir si votre besoin principal est :

un magasin opérationnel de type base avec une interface (Airtable / Coda),

un espace de travail centré sur les documents avec des bases de données intégrées (Notion),

une compatibilité totale avec les feuilles de calcul (Google Sheets),

la gestion de tâches/projets (ClickUp),

ou un véritable magasin de données backend avec une interface admin conçue (PostgreSQL + Retool/Appsmith/etc.).

Tableau de comparaison des concurrents : compromis d’ingénierie (API, interface, échelle)

| Outil | Meilleur pour | Limites typiques/Modèle de limitation de taux | Compromis clés par rapport à Airtable |

|---|---|---|---|

| Notion | Connaissance document-centrée + bases de données intégrées dans les documents | L’API de Notion est limitée par taux et impose la taille de la requête/limites basiques. | Excellent pour les entrées RAG et les workflows narratifs ; les bases de données sont puissantes mais souvent moins “opératoires” que celles d’Airtable ; les schémas d’intégration diffèrent (nécessitent un partage explicite avec les intégrations). |

| Google Sheets | Interopérabilité des feuilles de calcul, formules, écosystème large | L’API des feuilles a des quotas par minute ; Google recommande des payloads de ~2 Mo. | Idéal lorsque vous avez besoin de la sémantique et de la compatibilité des feuilles de calcul ; plus difficile de construire des expériences en application sans outils supplémentaires (permissions, formulaires, liens relationnels). |

| Coda | Hybridation document + table avec “packs” et automatisation | Coda indique que ses limites de taux API et renvoie 429 lorsqu’elles sont atteintes ; recommande de reculer et de réessayer. | Forte fusion document/table ; si vous souhaitez des applications opérationnelles de type base d’Airtable, le modèle d’Airtable peut sembler plus clair ; les limites de taux et les limites de documents varient selon le plan. |

| ClickUp | Gestion de tâches/projets | ClickUp applique des limites de taux par token et varie les limites selon le plan d’espace de travail (ex. : 100 req/min/token sur les niveaux inférieurs, plus élevées sur d’autres). | Meilleur lorsque les “tâches” sont primordiales ; l’utilisation comme base de données générale est maladroite ; fort pour les workflows mais plus faible pour le modélisation de schémas arbitraires. |

| PostgreSQL + UI (Retool/Appsmith/personnalisé) | Système de référence durable, cohérence forte, échelle | Dépend de votre infrastructure ; aucun plafond SaaS-imposé du type “5 QPS par base” | Plus de travail d’ingénierie au départ ; mais idéal pour les QPS élevés, la correction stricte, l’audit, les requêtes complexes et la maintenabilité à long terme - puis ajoutez une interface admin pour les non-développeurs. |

Une règle utile : si vous prévoyez des lectures/écritures à haute fréquence, des besoins de requêtes complexes ou un contrôle strict des changements, vous souhaitez généralement “PostgreSQL-first”. Si vous prévoyez des éditions importantes non-développeurs et des itérations rapides de workflow, Airtable est convaincant - surtout pour les outils internes - à condition de concevoir autour de l’API et des limites de plan.

Modèles DevOps d’Airtable et intégration API end-to-end avec Go et Python

Cette section donne un chemin complet, orienté production, de la configuration → authentification sécurisée → clients CRUD → pagination → gestion des limites de taux → batch → webhooks → notes de déploiement.

Diagramme d’intégration SEO : architecture d’API d’Airtable pour des systèmes DevOps-friendly

Configuration et authentification : IDs stables, tokens et privilèges minimaux

Privilégier les IDs de table en code pour réduire les changements brisants

Airtable note que les noms de table et les IDs de table peuvent être utilisés interchangeablement et recommande les IDs de table pour éviter les changements de requêtes lorsque les noms changent.

En pratique, c’est l’une des décisions “hygiène ops” les plus rentables que vous puissiez prendre pour une intégration basée sur Airtable.

Pour localiser les IDs, Airtable fournit des directives sur la façon de trouver les IDs de base et de table à partir des URL (et via les docs API).

Utiliser les Tokens d’Accès Personnels (PAT), pas les anciennes clés API

La liste officielle de dépériscence d’Airtable inclut “1er février 2024 - dépériscence des clés API”.

Les PAT sont décrits par Airtable comme permettant de créer plusieurs tokens avec des portées différentes - de restreintes (une seule portée + une seule base) à larges (tous les espaces de travail/bases/portées permises par l’utilisateur).

La meilleure pratique opérationnelle est : créer plusieurs PAT par surface d’intégration (ex. : un token pour la synchronisation en lecture seule, un autre pour les chemins d’écriture) et les faire tourner comme tout autre secret.

Pour une résilience de type entreprise (l’intégration ne devrait pas mourir lorsque qu’un employé part), Airtable décrit des comptes de service conçus pour les intégrations API, indépendants de tout utilisateur spécifique.

Variables d’environnement minimales pour les exemples Go et Python

# Obligatoires

export AIRTABLE_TOKEN="pat_xxx..." # Token d'accès personnel

export AIRTABLE_BASE_ID="appXXXXXXXXXXXXXX" # ID de base

export AIRTABLE_TABLE="tblYYYYYYYYYYYYYY" # Préférer l'ID de table ; le nom de table fonctionne également

# Optionnels (filtres/comportement)

export AIRTABLE_PAGE_SIZE="100" # 100 est le maximum pour lister les enregistreements

export AIRTABLE_TIMEOUT_SECONDS="30"

Fondamentaux API qui façonnent la conception client : pagination, limites de taux, batch

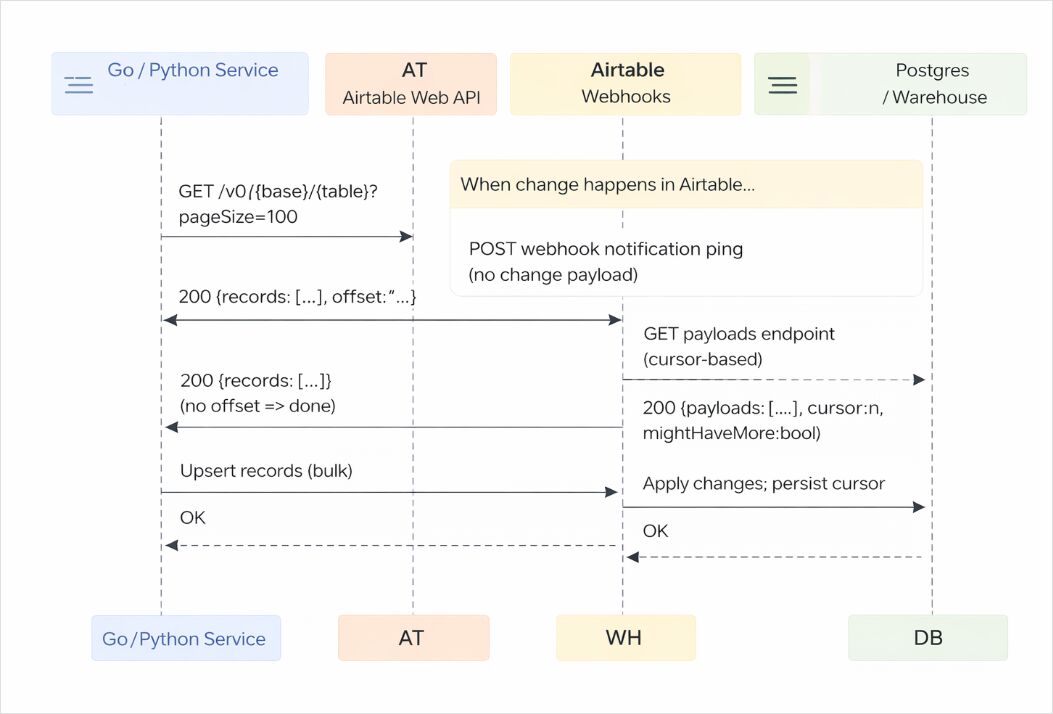

Pagination : lister les enregistrements retourne jusqu’à 100 enregistrements par requête

Airtable documente que les réponses “list records” sont paginées jusqu’à 100 enregistrements à la fois ; si la table a plus de 100, vous devez faire plusieurs requêtes et utiliser l’offset retourné comme paramètre de requête pour la prochaine requête.

Le paramètre pageSize peut réduire la taille de la page, mais 100 est le maximum.

Filtres et tri : filterByFormula et paramètres de tri

Airtable fournit des exemples concrets de l’utilisation de filterByFormula et des paramètres sort[...], y compris une forme canonique d’URL telle que :

https://api.airtable.com/v0/{your_app_id}/Flavors?filterByFormula=Rating%3D5

Limites de taux et stratégie de réessai : traiter 429 comme normal

La documentation des limites d’appel API d’Airtable indique :

5 requêtes par seconde par base,

50 requêtes par seconde par utilisateur/compte de service utilisant le trafic PAT,

et si vous les dépassez, vous recevez un 429 et devez attendre 30 secondes avant que les requêtes suivantes réussissent.

Le guide de dépannage d’Airtable renforce que 429 peut signifier que vous avez dépassé la limite de 5 req/base/sec et conseille d’attendre avant de réessayer.

Batch : concevoir autour de “jusqu’à 10 enregistrements par requête”

Airtable documente explicitement le batch comme une stratégie de limite de taux : l’API “prend en charge le batch”, gérant “jusqu’à 10 enregistrements par requête”.

Et l’endpoint “Mettre à jour plusieurs enregistrements” d’Airtable démontre la forme de la requête batch (records: [...]) et supporte également performUpsert avec fieldsToMergeOn.

Diagramme de séquence SEO : séquence d’appel d’API d’Airtable pour lister → paginer → mettre à jour en batch → récupérer le payload des webhooks

Exemple Go : client REST d’Airtable prêt à la production avec pagination, réessais et batch

Ce programme Go démontre :

L’authentification PAT via Authorization: Bearer ... (l’authentification Bearer est requise).

La pagination de liste d’enregistrements avec offset et pageSize (max 100).

La gestion des limites de taux pour 429 avec fallback sur Retry-After et les conseils d’Airtable d’attendre 30 secondes.

Mise à jour en batch via l’endpoint officiel PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName}.

Forme de l’endpoint de mise à jour d’enregistrement unique (sémantique PATCH/PUT).

Exemple de filtrage (filterByFormula) du motif d’URL.

Exigences d’exécution : Go 1.21+ recommandé ; définir

AIRTABLE_TOKEN,AIRTABLE_BASE_ID,AIRTABLE_TABLE.

// Fichier : main.go

package main

import (

"bytes"

"context"

"encoding/json"

"errors"

"fmt"

"io"

"net/http"

"net/url"

"os"

"strconv"

"time"

)

type AirtableClient struct {

BaseID string

Token string

HTTPClient *http.Client

}

type airtableError struct {

Error interface{} `json:"error"`

}

type Record struct {

ID string `json:"id"`

CreatedTime string `json:"createdTime,omitempty"`

Fields map[string]interface{} `json:"fields"`

}

type listRecordsResponse struct {

Records []Record `json:"records"`

Offset string `json:"offset,omitempty"`

}

func mustEnv(key string) string {

v := os.Getenv(key)

if v == "" {

fmt.Fprintf(os.Stderr, "missing env var: %s\n", key)

os.Exit(2)

}

return v

}

func (c *AirtableClient) doJSON(ctx context.Context, method, rawURL string, body any, out any) (*http.Response, error) {

var reqBody io.Reader

if body != nil {

b, err := json.Marshal(body)

if err != nil {

return nil, fmt.Errorf("marshal body: %w", err)

}

reqBody = bytes.NewReader(b)

}

req, err := http.NewRequestWithContext(ctx, method, rawURL, reqBody)

if err != nil {

return nil, err

}

req.Header.Set("Authorization", "Bearer "+c.Token) // Bearer required

req.Header.Set("Content-Type", "application/json")

// Boucle de réessai basique qui traite 429 comme normal. Guidance d'Airtable : attendre ~30s.

var lastResp *http.Response

for attempt := 0; attempt < 6; attempt++ {

resp, err := c.HTTPClient.Do(req)

if err != nil {

return nil, err

}

lastResp = resp

if resp.StatusCode != http.StatusTooManyRequests {

if out == nil {

return resp, nil

}

defer resp.Body.Close()

if resp.StatusCode < 200 || resp.StatusCode >= 300 {

b, _ := io.ReadAll(resp.Body)

return resp, fmt.Errorf("http %d: %s", resp.StatusCode, string(b))

}

if err := json.NewDecoder(resp.Body).Decode(out); err != nil {

return resp, fmt.Errorf("decode response: %w", err)

}

return resp, nil

}

// Gestion de 429

resp.Body.Close()

wait := 30 * time.Second // Guidance d'Airtable : attendre 30 secondes avant que les requêtes suivantes réussissent

if ra := resp.Header.Get("Retry-After"); ra != "" {

if secs, err := strconv.Atoi(ra); err == nil && secs > 0 {

wait = time.Duration(secs) * time.Second

}

}

time.Sleep(wait)

// Revenir en arrière du corps pour le réessai si nécessaire (sécurisé car on a utilisé bytes.NewReader).

if reqBody != nil {

if seeker, ok := reqBody.(io.Seeker); ok {

_, _ = seeker.Seek(0, io.SeekStart)

}

}

}

return lastResp, errors.New("trop de réessais après 429")

}

// ListRecords paginates with offset; pageSize max 100

func (c *AirtableClient) ListRecords(ctx context.Context, table string, pageSize int, filterByFormula string) ([]Record, error) {

if pageSize <= 0 || pageSize > 100 {

pageSize = 100

}

var out []Record

var offset string

for {

u := url.URL{

Scheme: "https",

Host: "api.airtable.com",

Path: fmt.Sprintf("/v0/%s/%s", c.BaseID, table),

}

q := u.Query()

q.Set("pageSize", strconv.Itoa(pageSize))

if offset != "" {

q.Set("offset", offset)

}

if filterByFormula != "" {

// Exemple de motif dans la documentation d'Airtable

q.Set("filterByFormula", filterByFormula)

}

u.RawQuery = q.Encode()

var page listRecordsResponse

_, err := c.doJSON(ctx, http.MethodGet, u.String(), nil, &page)

if err != nil {

return nil, err

}

out = append(out, page.Records...)

if page.Offset == "" {

return out, nil

}

offset = page.Offset

}

}

// UpdateMultiple démontre la forme officielle de la requête PATCH en batch.

func (c *AirtableClient) UpdateMultiple(ctx context.Context, table string, records []Record) ([]Record, error) {

type reqBody struct {

Records []Record `json:"records"`

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

var resp struct {

Records []Record `json:"records"`

}

_, err := c.doJSON(ctx, http.MethodPatch, u, reqBody{Records: records}, &resp)

if err != nil {

return nil, err

}

return resp.Records, nil

}

// UpsertMultiple utilise performUpsert (fieldsToMergeOn) sur l'endpoint de mise à jour en batch.

func (c *AirtableClient) UpsertMultiple(ctx context.Context, table string, mergeOn []string, records []Record) error {

body := map[string]any{

"performUpsert": map[string]any{

"fieldsToMergeOn": mergeOn,

},

"records": records,

}

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s", c.BaseID, table)

_, err := c.doJSON(ctx, http.MethodPatch, u, body, nil)

return err

}

// UpdateRecord démontre les sémantiques de l'endpoint de mise à jour d'enregistrement unique (PATCH/PUT).

func (c *AirtableClient) UpdateRecord(ctx context.Context, table, recordID string, fields map[string]any) (Record, error) {

u := fmt.Sprintf("https://api.airtable.com/v0/%s/%s/%s", c.BaseID, table, recordID)

body := map[string]any{"fields": fields}

var resp Record

_, err := c.doJSON(ctx, http.MethodPatch, u, body, &resp)

return resp, err

}

func chunk[T any](items []T, n int) [][]T {

if n <= 0 {

return [][]T{items}

}

var out [][]T

for i := 0; i < len(items); i += n {

j := i + n

if j > len(items) {

j = len(items)

}

out = append(out, items[i:j])

}

return out

}

func main() {

ctx, cancel := context.WithTimeout(context.Background(), 60*time.Second)

defer cancel()

token := mustEnv("AIRTABLE_TOKEN")

baseID := mustEnv("AIRTABLE_BASE_ID")

table := mustEnv("AIRTABLE_TABLE")

c := &AirtableClient{

BaseID: baseID,

Token: token,

HTTPClient: &http.Client{

Timeout: 30 * time.Second,

},

}

// Exemple : lister tous les enregistrements filtrés par formule (adaptez la formule à votre schéma).

records, err := c.ListRecords(ctx, table, 100, "")

if err != nil {

panic(err)

}

fmt.Printf("listed %d records\n", len(records))

// Exemple : mise à jour en batch par morceaux (Airtable prend en charge le batch comme stratégie, jusqu'à 10 enregistrements par requête).

// Ici, on met à jour au maximum 10 à la fois.

var updates []Record

for i := 0; i < len(records) && i < 3; i++ {

updates = append(updates, Record{

ID: records[i].ID,

Fields: map[string]any{

"Visited": true,

},

})

}

for _, part := range chunk(updates, 10) {

updated, err := c.UpdateMultiple(ctx, table, part)

if err != nil {

panic(err)

}

fmt.Printf("updated %d records\n", len(updated))

}

}

Exemple Python : intégration Airtable avec requests et un récepteur de webhook

Cette implémentation Python inclut :

Des appels REST directs avec l’authentification Bearer.

La pagination avec offset et pageSize (max 100).

Gestion de 429 alignée sur les conseils d’Airtable (attendre ~30 secondes).

Mise à jour en batch avec la forme officielle de l’endpoint update-multiple et performUpsert.

Comportement du récepteur de webhook qui reconnaît : les pings de webhook n’incluent pas le payload de changement, donc vous devez récupérer les payloads séparément, et les payloads sont conservés pendant 7 jours ; les webhooks peuvent expirer après 7 jours sauf s’ils sont rafraîchis.

Note : Les détails de l’endpoint “Lister les payloads de webhook” d’Airtable sont référencés dans le guide des webhooks d’Airtable, mais le texte public le plus fiablement indexé est le guide lui-même et les exemples de la communauté. Les contraintes opérationnelles du guide (aucun payload dans le ping, conservation, expiration) sont les faits opérationnels critiques.

# Fichier : airtable_client.py

import os

import time

import json

import typing as t

import requests

from urllib.parse import urlencode

AIRTABLE_TOKEN = os.environ["AIRTABLE_TOKEN"]

AIRTABLE_BASE_ID = os.environ["AIRTABLE_BASE_ID"]

AIRTABLE_TABLE = os.environ["AIRTABLE_TABLE"]

SESSION = requests.Session()

SESSION.headers.update({

"Authorization": f"Bearer {AIRTABLE_TOKEN}", # Authentification Bearer requise

"Content-Type": "application/json",

})

def _airtable_request(method: str, url: str, *, params=None, json_body=None, max_retries: int = 5) -> requests.Response:

for attempt in range(max_retries + 1):

resp = SESSION.request(method, url, params=params, json=json_body, timeout=30)

if resp.status_code != 429:

return resp

# Guidance d'Airtable : attendre ~30s après 429

retry_after = resp.headers.get("Retry-After")

wait = 30

if retry_after and retry_after.isdigit():

wait = int(retry_after)

time.sleep(wait)

raise RuntimeError(f"Too many retries after 429 for {method} {url}")

def list_records(page_size: int = 100, filter_by_formula: str | None = None) -> list[dict]:

# pageSize max is 100

page_size = min(max(page_size, 1), 100)

base_url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

all_records: list[dict] = []

offset: str | None = None

while True:

params = {"pageSize": page_size}

if offset:

params["offset"] = offset

if filter_by_formula:

# Exemple de motif documenté par Airtable

params["filterByFormula"] = filter_by_formula

resp = _airtable_request("GET", base_url, params=params)

resp.raise_for_status()

data = resp.json()

all_records.extend(data.get("records", []))

offset = data.get("offset")

if not offset:

break

return all_records

def update_multiple_records(records: list[dict], perform_upsert_fields: list[str] | None = None) -> dict:

"""

Utilise PATCH https://api.airtable.com/v0/{baseId}/{tableIdOrName}

avec le corps { "records": [ { "id": "...", "fields": {...} }, ... ] }

et performUpsert optionnel, selon la documentation d'Airtable.

"""

url = f"https://api.airtable.com/v0/{AIRTABLE_BASE_ID}/{AIRTABLE_TABLE}"

body: dict[str, t.Any] = {"records": records}

if perform_upsert_fields:

body["performUpsert"] = {"fieldsToMergeOn": perform_upsert_fields}

resp = _airtable_request("PATCH", url, json_body=body)

resp.raise_for_status()

return resp.json()

def webhook_receiver_example():

"""

Schéma minimal ; en production, utilisez Flask/FastAPI et validez les signatures.

Le guide des webhooks d'Airtable note :

- La notification ping NE CONTIENT PAS le payload de changement

- Le payload doit être récupéré à partir de l'endpoint GET des payloads

- Les payloads sont conservés 7 jours

- Les webhooks créés via PAT/OAuth expirent après 7 jours sauf s'ils sont rafraîchis/listés

"""

pass

if __name__ == "__main__":

rows = list_records(page_size=100)

print(f"Fetched {len(rows)} records")

# Exemple : mettre à jour les 2 premiers enregistrements (découper en 10s ; Airtable prend en charge le batch jusqu'à 10 enregistrements par requête).

updates = []

for r in rows[:2]:

updates.append({"id": r["id"], "fields": {"Visited": True}})

if updates:

result = update_multiple_records(updates)

print(json.dumps(result, indent=2))

Récepteur de webhook : persistance du curseur et “aucun payload dans le ping”

Pour un récepteur de webhook en production, vos tâches principales sont :

Retourner une réponse de succès rapide (ex. : HTTP 204).

Persister le curseur du webhook pour ne pas retraiter les anciens payloads.

Récupérer les payloads après les pings ; le guide des webhooks prévient que l’ordre des pings n’est pas garanti, mais les listes de payloads ont un ordre stable.

Comprendre la conservation et l’expiration : les payloads sont conservés 7 jours ; les webhooks créés avec PAT/OAuth expirent après 7 jours sauf s’ils sont rafraîchis (la liste des payloads peut prolonger leur durée de vie).

Concevoir votre travailleur de synchronisation de manière à ne pas manquer d’événements si un ping est perdu : l’approche “récupérer les payloads par curseur” est votre mécanisme durable.

Si vous ne souhaitez pas gérer la complexité de l’API des webhooks, Airtable lui-même suggère que certains cas d’utilisation peuvent être “plus directs” en utilisant une Automatisation avec “Exécuter un script” pour faire une requête POST à votre point de terminaison.

Notes de déploiement : CI/CD, infra-as-code, sécurité et sauvegardes

CI/CD et sécurité de publication

Traitez les intégrations Airtable comme tout autre dépendance de production :

Testez unitairement votre couche de mappage (champ Airtable ↔ modèle de domaine).

Ajoutez des tests de contrat contre une “base de test dédiée” pour détecter les changements de schéma tôt.

Surveillez les 429 et la latence ; 429 est normal sous les charges ponctuelles car Airtable impose 5 req/sec/base.

Infra comme code : déployer l’intégration, pas la feuille de calcul

Airtable lui-même est un SaaS, mais votre service d’intégration peut être déployé avec Terraform (AWS Lambda + API Gateway récepteur de webhook, GCP Cloud Run, Kubernetes, etc.). Le focus IaC est généralement :

Réseau pour le récepteur de webhook entrant

Distribution des secrets (PAT dans un gestionnaire de secrets ; injecté à l’exécution)

Travaux planifiés (cron) pour des synchronisations périodiques de concordance

Observabilité (logs/métriques)

Sécurité : gardez les tokens côté serveur, utilisez le privilège minimum, faites tourner

La documentation de l’API Enterprise d’Airtable avertit que les requêtes exposant les tokens ne devraient pas être faites côté client car les tokens seraient exposés ; la norme sûre est les requêtes côté serveur.

La README officielle du client JS d’Airtable avertit également de ne pas placer les clés API sur les pages web et suggère d’utiliser des comptes séparés/accès partagé si nécessaire.

Combinez cela avec le scoping des PAT (seules les actions requises + seules les bases requises) et vous obtenez une posture pratique de privilège minimum.

Sauvegardes et récupération après sinistre : ne vous appuyez pas sur l’historique de révision court

L’historique de révision du plan Gratuit est deux semaines, Team/Business sont un an.

Si Airtable est critique pour le métier, implémentez :

Des snapshots d’export API vers un stockage d’objets (quotidiennement)

Une réplication dans un magasin durable (Postgres/entrepôt)

Une ingestion par curseur des webhooks applicables, en comprenant que la conservation des payloads est de 7 jours.

Longueur d’URL et complexité de filtre : prévoyez un fallback POST

Airtable impose une limite de longueur d’URL de 16 000 caractères pour les requêtes Web API et recommande des contournements ; notamment, il indique qu’il existe une version POST de l’endpoint GET lister les enregistrements de table pour mettre les options dans le corps de la requête au lieu des paramètres de requête.

Cela a de l’importance si votre pipeline DevOps construit des expressions filterByFormula complexes ou des longs tri/ listes de champs.

En concevant autour des plafonds du plan Gratuit, des limites de taux standard, et de la capture de changement basée sur le curseur, Airtable peut être un “interface opérationnelle + surface d’intégration” très efficace pour les équipes DevOps et orientées IA - surtout lorsqu’il est associé à un magasin durable pour l’échelle et l’auditabilité.